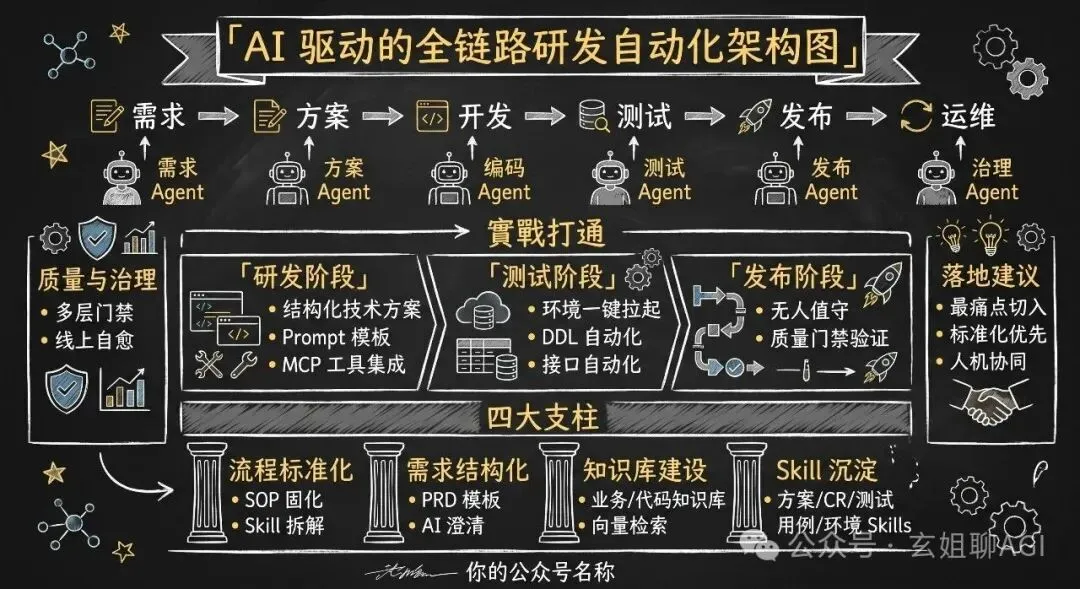

从需求到上线AI 范式:可落地的全链路实践

一、先算账:为什么单点提效不够了?

二、一张图看懂演进路线:你在哪一层?

L1:纯人工阶段(AI 参与度 0%)

L2:人机协同阶段(AI 参与度 30%-70%)

-

早期(30%):AI 根据技术方案生成代码,人写方案、人测、人发布。

-

中期(50%):AI 不仅写代码,还能自动跑测试、申请环境、走发布流程。人只需要确认关键节点。

-

后期(70%):AI 开始参与需求解析,能根据原始需求输出技术方案,再自动完成后续环节。人只负责拍板。

L3:全自动化交付(AI 参与度 80%+)

三、落地四大支柱:没有这些,AI 跑不起来

支柱一:流程标准化 — 给 AI 画好”轨道”

-

把需求→方案→开发→测试→发布→运维的主流程固化下来,形成标准 SOP。

-

把 SOP 拆解成可编排的 Skill(技能),比如”环境创建 Skill”、”DDL 申请 Skill”、”接口测试 Skill”。

-

每个 Skill 定义清楚输入、输出、异常处理规则。AI 按图索骥,出错时自动回滚或转人工。

支柱二:需求结构化 — Garbage In, Garbage Out

-

制定统一的需求模板,至少包含:需求概述、业务场景、功能详述、版本管理、外部依赖。

-

建立需求”澄清规则”:哪些字段必填、哪些必须量化、哪些需要关联上下游系统。不满足规则,AI 自动打回并给出修改建议。

-

引入需求评分机制:从背景价值、方案可行性、影响范围等维度打分。低于阈值的需求不允许进入开发池。

支柱三:知识库建设 — 给 AI 喂”好饲料”

-

业务知识库:沉淀领域模型、业务规则、接口契约、核心流程图。让 AI 做方案设计时有据可依。

-

代码知识库:整理项目架构规范、分层约定、常用工具类、历史优秀代码片段。让 AI 生成代码时风格统一、不重复造轮子。

-

检索优化:知识库不是简单的文档堆叠,要建立索引和向量化检索,让 AI 能快速定位到相关上下文。

支柱四:Skills 沉淀 — 把老师傅经验变成”可插拔组件”

-

技术方案生成 Skill

-

代码生成与补全 Skill

-

代码评审(CR)Skill

-

测试用例生成与执行 Skill

-

环境创建与配置 Skill

-

发布单申请与部署 Skill

四、L2 阶段实战:从”技术方案”到”发布上线”怎么打通?

阶段一:研发阶段 — AI 写代码只是起点

-

技术方案面向 AI 改写

传统技术方案是写给人看的,充满业务描述和模糊措辞。面向 AI 的技术方案需要结构化:接口定义、数据模型、业务规则、异常处理,用 AI 能解析的格式输出(如 Markdown 表格、YAML、JSON)。

-

Prompt 模板化

不要每次让 AI 从零理解需求。把常见场景(如 CRUD、接口对接、定时任务)做成 Prompt 模板,AI 直接填充变量即可生成代码。

-

接入 MCP 工具链

让 AI 不仅能写代码,还能调用工具:查接口文档、查数据库表结构、创建代码仓库分支、提交代码。实现”一句话需求→AI 自动完成编码→自动提交 MR”。

阶段二:测试阶段 — 环境、数据、用例全自动化

阶段三:发布阶段 — 从 MR 到上线,人只点一次确认

-

研发在 AI 助手内提交 MR,MR 通过后自动触发编译流水线。

-

编译成功自动生成发布单,自动填充变更内容、影响范围、回滚方案。

-

发布单审批通过后,自动执行灰度发布、线上验证。

-

单个服务的发布等待时间从 30 分钟降到秒级。

五、质量与治理:跑得快,更要跑得稳

1. 建立多层质量门禁

-

需求评审门禁:AI 检查需求完整性和清晰度,不达标打回。

-

方案评审门禁:AI 检查技术方案是否符合架构规范、是否有性能风险。

-

代码评审门禁:AI 自动 CR,检查安全漏洞、代码规范、重复代码。

-

测试门禁:自动化测试通过率、覆盖率不达标,禁止进入发布环节。

-

发布门禁:变更影响面评估、回滚方案检查。

2. 线上治理与自愈(面向 L3)

-

打通运行时日志和监控指标,让 AI 能实时感知线上异常。

-

建设自动巡检能力:AI 定期扫描线上服务,发现性能退化、资源泄漏、错误率上升等问题。

-

低风险问题自动修复(如配置调整、限流阈值调整),高风险问题告警并生成修复建议单。

六、给技术负责人的三条落地建议

七、写在最后

你如果想 学技术 | 囤干货 | 聊职场

请点击关注并加标星

夜雨聆风

夜雨聆风