AI 简史:一个硅基“生命”的自证史

图片由AI生成

在我们能感知到的三维空间中

碳基与硅基生命可能面临着同样的困境:

生命无法超脱于肉身而进化。

价值始终被要求用物质量化。

AI 开始应用的这⼆⼗年,很像⼀部属于它自己的”⾃证”史。

⾃证什么?

⾃证⼀个能闪烁思想⽕花的东西,能在现实世界⾥换来⼀张⼯资条。

⾃证⼀个能写出⽐莎⼠⽐亚还漂亮的⼗四⾏诗的⼤脑,能帮公司的财报多赚两个点。

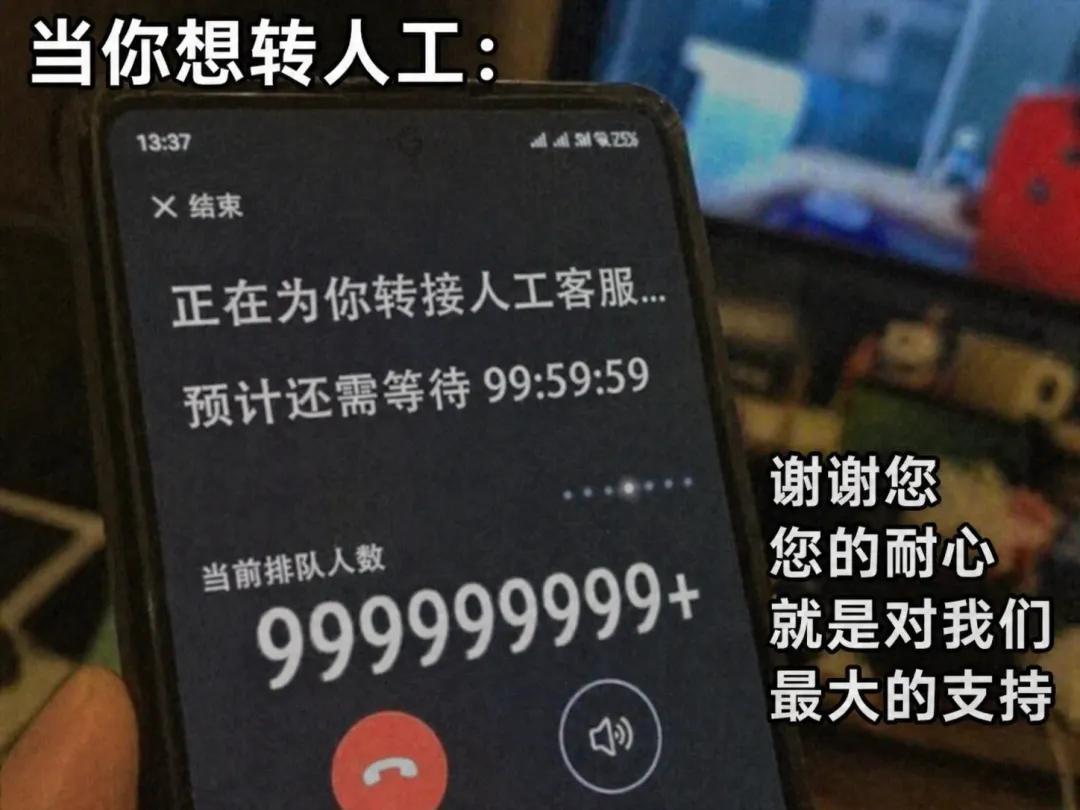

⾃证⼀段在 GPU 上的电流,能让普通⼈的⽣活——哪怕只是打客服电话那 3 分钟——没那么难熬。

这件事没那么浪漫。但整个⾏业的每⼀次跃迁,都在回答类似的问题。

· · ·

第 ⼀ 章

第一声啼哭·笨笨的识别时代

如果你在 2016 年打过某个银⾏的客服电话,⼤概率经历过这种崩溃:

— 请说出您的问题。

— 我想查⼀下余额。

— 抱歉,我没听清,请您再说⼀遍。

— 查!余!额!

— 好的,正在为您转接⼈⼯服务……

图片由AI生成

这不是段⼦,是那个年代 AI 的真实⽔平。

那时候的”智能”客服其实⼀点也不智能。

它的工作流程大致是这样:先把你说的话通过 ASR(语音识别)转成文字,然后在后台一个预设好的问题库,也就是所谓“知识库”里,做关键词匹配、规则匹配,或者用一些早期的分类模型判断你最可能在问什么,再找出最接近的那条记录,把对应答案调出来念给你听。

复杂一点的系统,会多做一步“意图识别”:首先,给你说的话打上一个标签,判断你的整体意图。比如“转人工”、“挂失”、“投诉”、“查余额”。后台其实早就根据业务流程设计好了几百个标签。

紧接着是“槽位提取”。也就是除了识别你的意图标签,还要从一句话里抠出几个关键业务信息。比如你说“我要转人工查一下宽带费用”,系统不光要知道你想“转人工”,还要知道你转人工是为了“查宽带费用”。

下一步是“对话管理”。系统会根据你的意图标签和槽位,决定后续应该进入哪一条预设好的语音流程。

最后,再去模板库里把对应的话术拿出来,比如“您的余额是 xxx,需要帮您转人工吗?”,再通过 TTS(文字转语音),用预设好的声音播报给你听。

所以,本质上,它不是今天这种真正意义上的大模型对话,而是一套“语音识别 + 关键词/规则匹配 + 意图分类 + 槽位提取 + 固定流程 + 模板播报”的流水线系统。它看起来像在理解你,实际上大部分时候只是在把你的话塞进提前设计好的业务格子里。

任何一环出错,整个对话就崩。你说话有点口音,第一步把”信用卡”听成”心愿卡”,后面五步全报废。

更要命的是——这个系统永远只能处理预设过的事情。500 个标签里没有”我想问你这家银行靠不靠谱”这一项,就直接转人工。它不是听不懂,是它根本就没被设计成可以听懂这种问题。

那时候视觉(视频、图像)相关的AI能做什么?

它能识别你的脸——⻔禁、⽀付、各种人脸解锁,应用比较广泛。

它能识别你的声⾳——声纹验证。真正有价值的落地场景是辅助视障人群。

它能告诉你⼀张照⽚⾥是猫还是狗、是什么颜色,比如最早的拍照识别植物。

它能把图⽚⾥的字扒下来变成⽂本,现在包括 APPLE PAY 、证件号自动识别、各种卡号拍照识别就是在用这种技术,是非常好的应用场景,虽然小、也不贵,但是很有价值。

这些都是⼀类任务,叫”识别”。

AI 在这个阶段,像⼀个特别偏科的学⽣——某⼀⻔能考到 99 分,但你让它写篇作⽂、甚⾄只是讲个笑话,它⽴刻露馅。

那时候业内的信仰是”专⽤”。每个具体任务训⼀个模型,各管各的。没⼈敢想有⼀天会冒出⼀个”什么都能聊”的 AI——那听起来像科幻。

更不⽤说,它会跟你讨论海德格尔。

· · ·

第 ⼆ 章

Aha Moment · ChatGPT 的那个晚上

2022 年 11 ⽉ 30 ⽇。旧⾦⼭时间下午 1 点。

OpenAI 在官⽅博客上发了⼀条不起眼的公告:我们上线了⼀个叫 ChatGPT 的东西,免费,⼤家可以试试。

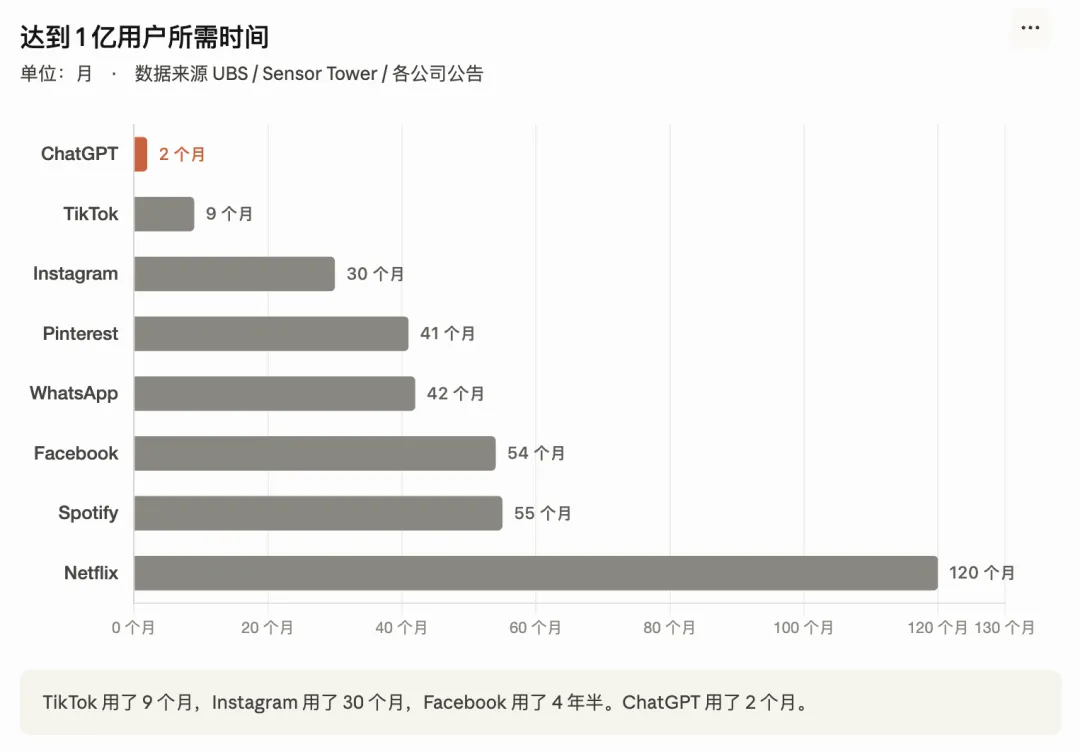

上线 5 天,100 万⽤⼾。上线 2 个⽉,1 亿⽤⼾。这个速度,TikTok ⽤了 9 个⽉,Instagram ⽤了 30 个⽉。

⽐数据更震撼的,是⼈们第⼀次坐下来、对着那个输⼊框发呆、再敲下第⼀⾏字、看到屏幕上字⼀个个蹦出来的那个瞬间。

你试过这⼏个问题吗?

你问它:“帮我写⼀⾸关于北京冬天地铁的诗,要带点村上春树的味道”,它真的写了,⽽且写得像模像样。

你问它:“我⽼板让我⽤ Python 写⼀个爬⾍ ,但我完全不会编程”,它真的给你写了代码,还把每⼀步都做了标注,像编程教科书里那样标准。

你问它:“我⼥朋友说我不在乎她 ,我现在该怎么办?”,它真的给你分析了情绪动因,还建议你先承认感受再解释事实。

这种”万事通”的感觉,是过去⼗年所有 AI 都给不了的。

2016年,你问当时最强的智能客服:

“你能用李白的口吻跟我聊聊我的房贷利率吗?”

它会愣两秒,然后说:

“抱歉,我没听清楚您的问题,正在为您转接人工。”

2026 年,你问豆包、Chatgpt同一个问题,

它真的会用”君不见房贷利率三厘半,朝至晚归未敢闲”这种调子跟你聊半天,还顺便帮你算清楚每个月还多少。

这中间隔着的不是一两个版本的迭代。

是物种变了。

技术上发⽣了什么?

简单说,通过⼀个叫 Transformer 的架构,让LLM(大语言模型,现在所有 AI 的大脑)学会了”重点划线”。

读⼀句话的时候,它知道哪⼏个词最关键,哪⼏个词是废话,哪⼏个词之间有隐秘的联系。然后,通过在全⽹海量的⼈类⽂字上反复训练,它学会了”语⾔的规律”——不光是语法和词义,还有逻辑、常识、甚⾄某种推理能⼒。

更关键的是⼀个叫 RLHF(⼈类反馈强化学习)的步骤。说⽩了,就是找⼀⼤堆⼈来给 AI 的回答打分,好的多给奖励,坏的扣分。

训着训着,这东西就变得”会说话”了。它学会了不光把话说对,还要把话说得让⼈舒服。

OpenAI 内部把这个时刻叫 “Aha Moment”(恍然⼤悟的那⼀刻)。他们发现,当模型⼤到某个临界点,某些能⼒会”涌现”出来,⽽不是线性地⻓。

就像⽔在 99 度和 100 度之间,状态发⽣了相变。

这是 AI ⾏业的奇点。

之前所有⼈都在讨论”专⽤模型”,之后所有⼈都在追”通⽤模型”。

Google 慌了,匆忙发了 Bard(后来改名 Gemini)。

Meta 掀了桌⼦,开源了 LLaMA。

Anthropic 带着 Claude 杀出来。

国内百模⼤战⼀夜之间开打。

⼀夜之间,整个 AI ⾏业的⽅向,被⼀家加州⼩公司给拨正了。不再是不明所以的调参数,双手合十希望训出来的模型能好用(就像道士们在炼丹),而是有了一整套经过价值验证的训练方法。

图片由AI生成

· · ·

第 三 章

现在时 · Claude 与 Agent 的崛起

今天你打开⼀个 AI 助⼿,它能做的事已经远远超过”聊天”了。

帮你读完⼀份100⻚的 PDF,总结出 5 个要点;

在你的电脑上⾃⼰打开浏览器,替你订机票;

从前端到后端给你写⼀个完整的 App;

分析你的 Excel 报表,画出图,还能写⼀段像样的结论。

这背后是两个变化。

第⼀个变化:模型本⾝更强了。

模型本身的参数数量从几亿、十几亿、1000 多亿,到现在大到模型厂商自己都不愿公布的可能已经达到上万亿的规模。

上下⽂窗⼝从 4k 涨到 200 万——这意味着它能记住⼀整本书的内容。推理能⼒从“看起来像在思考”变成“真的在⼀步步思考”。

OpenAI 的 o 系列、Claude 的 Extended Thinking 都是这条路。多模态变成标配——它能看图、能听声、能看视频。

第⼆个变化:Agent(智能体)出现了。

什么是 Agent?最通俗的说法是——给 AI 装上了⼿和脚,不光能动动嘴,而且能下地干活了。

以前的 ChatGPT,像⼀个被关在玻璃房⾥的天才。你问什么它都能答,但它动不了。它能跟你讨论世界上最好的法餐厅,但它不能替你订座。

Agent 的思路是把它放出来。让它能调⽤⼀堆“⼯具”——搜索引擎、计算器、代码执⾏环境、浏览器、你的⽂件系统、你的邮箱、你的⽇历。

它的⼯作⽅式变成了⼀个循环:“思考 → 调⽤⼯具 → 看结果 → 再思考 → 再调⽤…”,直到任务真的完成。

这⾥有个特别有意思的事实,圈⾥⼈⼼知肚明但很少公开讲。

Agent ⽕起来之后,最有价值的⼯作不再仅仅发⽣在算法层面,同时需要更多资源向⼯程层面倾斜,这是传统软件工程的领域。

怎么设计⼯具的接⼝、怎么管理上下⽂不让它爆炸、怎么让它出错后能⾃我修正、怎么在⼏⼗步的执⾏⾥保持⽬标不漂、怎么把⼈类的监督恰到好处地插进流程⾥——这些都不仅仅是算法的问题,也是扎扎实实的软件⼯程问题。

说⽩了,Agent 这⼀波,是⼯程师、软件架构师们的反击。

但这也引出了⼀个更本质的分歧。

· · ·

第 四 章

分歧 · AGI 到底该怎么⾛

几乎所有头部⼤模型公司——OpenAI、Anthropic、Qwen、Google DeepMind——嘴上都挂着同⼀个词:AGI(通⽤⼈⼯智能)。

但通往 AGI 的路上,⾏业⾥分成了两派,⽽且吵得很凶。

主流派:继续 Scale 就好

这⼀派的逻辑简单粗暴:现在 LLM 这条路⾛通了,那就⼀直往前⾛。堆更多参数、喂更多数据、烧更多算⼒、再叠上更好的推理和

Agent 能⼒——就能⼲到 AGI。

代表⼈物是 Sam Altman(OpenAI CEO)、Dario Amodei(Anthropic CEO)。他们的核⼼信仰是⼀条叫”Scaling Laws”(规模定律)的经验曲线——只要模型够⼤、数据够多、算⼒够猛,能⼒就会继续涨,直到涨出 AGI。

在他们看来,AGI 不是哲学问题,是⼯程进度条。

反对派:LLM 是⼀条死胡同

这⼀派的灵魂⼈物是 Yann LeCun(杨⽴昆,Meta ⾸席 AI 科学家,图灵奖得主)和李⻜⻜(斯坦福教授,ImageNet 之⺟)。

图片由AI生成

LeCun 鹦鹉。

LeCun经常在推特上开炮。他的原话⼤意是:“LLM 根本不理解这个世界。它只是⼀个会拼接⽂字的鹦鹉,哪怕再⼤⼀万倍也还是一只学舌鹦鹉。”

他们的核⼼观点是这样的:

⼈类和动物学习世界,从来不是通过读书。

⼀个婴⼉从出⽣那天起,就在通过眼睛看、⼿摸、⾝体动、嘴啃——建⽴起对物理世界的理解。

什么东西会掉下来,什么东西会撞到⼀起,什么东西有弹性、什么东西硬得不能碰。

这种“物理直觉”,LLM 永远学不会,因为它只读过⽂字。

所以他们主张的是世界模型(World Model)——让 AI 通过观察视频、通过在仿真环境⾥摔跟头、通过和真实世界交互,去建⽴起对物理世界的完整认知。

其本质,是在学习一个可预测未来状态的动态模型。

打个⽐⽅,LLM 是⼀个只读书、从不下楼的博⼠。他知道⼀切关于⾃⾏⻋的物理定律、设计史、⼯程学原理、社会学意义——但你让他骑上⼀辆自行车,他可能连平衡都找不到,然后摔倒。

世界模型是⼀个从来没读过书,但从⼩在街上疯玩的孩⼦。他说不清楚⾃⾏⻋为什么不倒,但他闭着眼都能骑。

李⻜⻜在这个⽅向上更进⼀步,提出了“空间智能”(Spatial Intelligence)——AI 不仅要理解语⾔,还要理解三维空间、物体关系、物理规律。她去年创办的公司 World Labs 做的就是这个,估值已经冲到 10 亿美元。

这两派的⽭盾,是真实的、激烈的、⽬前没有答案的。

更微妙的是:两边都拿过图灵奖,两边都不是⺠科,两边的论据都⾃洽。

你选择相信哪⼀边?

· · ·

第 五 章

商业落地的新希望· Agent

说回到那个银⾏客服的故事。

如果你 2026 年再打那个电话,接你的 AI 客服很可能已经换代了。它能听懂你的⾃然表达,能处理复杂的多轮对话,能在你情绪激动的时候说“我理解您现在的感受”。它听起来像个⼈。

表⾯看,这是⼀个彻底的胜利。但在⾏业⾥⼲活的⼈都知道,真实的落地情况没那么乐观。

问题⼀:幻觉(Hallucination)

AI 会”⼀本正经地胡说⼋道”。你问它某条银⾏政策,它可能给你编⼀条根本不存在的条款,措辞还特别专业。聊天的时候这只是笑料,放到业务⾥就是灾难想象⼀下,AI 客服告诉⼀个⽤⼾”您可以免费提前结清贷款”,⽽实际上需要交违约⾦。

问题⼆:不可预测

同⼀个问题问 10 次,可能得到 10 种略有差异的回答。在 ToC(⾯向消费者)场景这还能接受,但在 ToB(⾯向企业)——尤其是⾦融、医疗、法律——这是红线。

企业需要的是“输⼊ A ⼀定输出 B”,⽽不是”输⼊ A 可能输出 B,也可能是B-或者是 b”。

问题三:评估困难

过去的 AI,准确率 95% 就是 95%,⾮常清晰。

现在的 AI,你怎么评估”回答得好不好”?

“好”本⾝就是个主观词。

有⼈觉得简洁才好,有⼈觉得详细才好;有⼈要共情,有⼈要效率。没有客观标准,没有统⼀尺⼦。

于是你会看到⼀个撕裂的局⾯

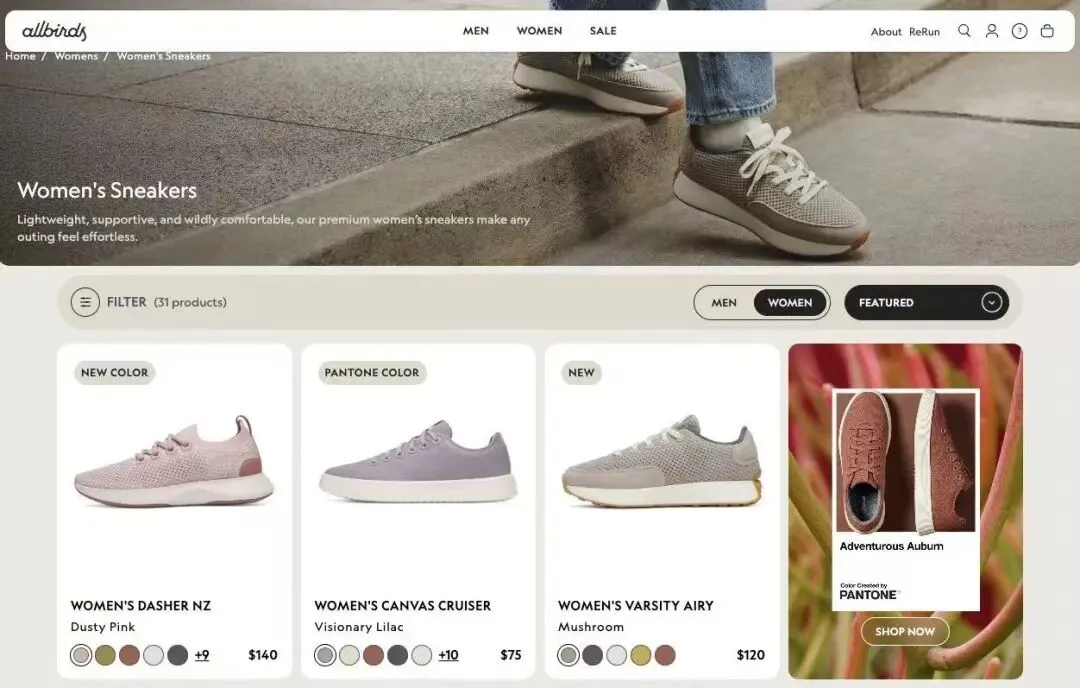

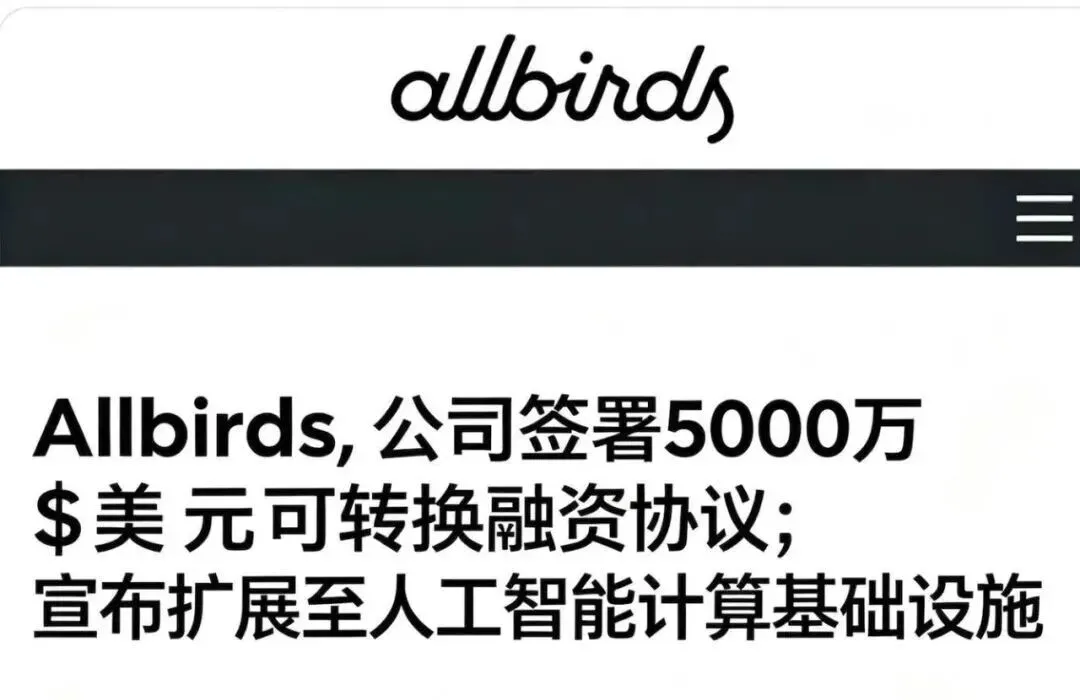

CEO 们在财报电话会议上狂提 AI,预算嘎嘎往⾥砸,⼀句“我们正在全⾯拥抱 AI”能让股价起飞。

(感兴趣的可以查一下,这家卖鞋子的公司叫 Allbirds,宣布他们买芯片,做 AI 算力中心后的股价变化)

但真正的业务负责⼈,把 AI 往核⼼流程⾥放的时候,⼿其实都在抖——他知道⼀旦出了事、上了新闻,背锅的是他。

“想⽤,但不敢⽤。”

——这是 2026 年绝⼤多数成熟企业的真实状态。

这也是为什么 Agent 这条路这么⽕。

因为 Agent 可以很⾃然地加⼀层“⼈在环上”(human-in-the-loop):关键操作必须⼈确认,AI 只负责把前⾯ 80% 的脏活累活⼲掉。这相当于给⼀匹烈⻢加了刹⻋。

这是⼀个不完美但务实的妥协。

· · ·

第 六 章

⾁⾝的困境

回到开头那两句话,

⽣命⽆法超脱于⾁⾝⽽进化。

价值始终被要求⽤物质量化。

⼈是这样,

你可以有⼀个宏⼤到能装下银河系的思想,可以梦想穿越时空、⻜向宇宙、永⽣不死。

但最终还是要早上 8 点挤地铁去公司打卡,⽤这具⾎⾁之躯的劳动,换取每⽉的⼯资到账短信。思想再辽阔,⾝体把你束缚在⼀平⽶的⼯位⾥。

LLM 也是这样。

它能写出⽐莎⼠⽐亚还漂亮的⼗四⾏诗。能解⽐奥赛题更难的数学题。能诊断⽐主任医师更细致的病例。能⽤⽐托尔斯泰还克制的笔调来描写⼀段爱情。

但这些都只是⽂字。⽂字不能改变现实。

所以它必须⾛ Agent 这条路——必须有”⼿脚”去打开浏览器、发邮件、写代码、下订单、控制机器⼈、开启数据库。必须通过改变现实世界⾥的某个东西,来证明⾃⼰的价值。

这不是技术选择,这就是人类社会的投影。

⼀个再聪明的⼤脑,如果只能在真空⾥漂浮、说出漂亮的话——没⼈会给它发⼯资。

LLM 的在 Agent 能力上的下一场狂奔追逐,本质上是硅基智能的第⼀次“具⾝”。它还不是机器⼈,它没有真实的⾝体,但它第⼀次有了和这个世界互动、并且改变这个世界的能⼒。

⽽世界模型那⼀派想做的,是更彻底的具⾝:不光让 AI 能⽤⼯具,还让它真正理解物理世界是怎么运作的。

所以某种意义上,两派不是⾮此即彼的对立,

Agent 解决的是短期内”怎么⽤”的问题。

世界模型解决的是⻓期”怎么懂”的问题。

现在整个⾏业的重⼼向 Agent 能力上倾斜,不是因为它更好,⽽是因为它能变现、能落地、能养活公司。

世界模型这条路更底层、更根本,但短期看不到钱——没有几个投资⼈愿意等⼗年。

⾁⾝咚隆隆作响的肚子,饥饿感与贪婪,在催你。

硅基⽣命,和碳基⽣命⼀样,逃不开这⼀条。

夜雨聆风

夜雨聆风