AI时代最重要的,已经不是技巧,而是底层理解

这两年,大家都在学怎么用 AI。

怎么写 Prompt,怎么搭工作流,怎么做 Agent,怎么让它帮你写文案、改代码、做表格、出汇报。

这些都重要。

但我越来越强烈地感觉到一件事:

如果一个人理解 AI,只停留在 Prompt 和工具技巧这一层,那他其实还没真正入门。

因为 Prompt 是术,不是道。

AI 真正厉害的地方,不是它会不会写一段话,而是它开始表现出两种过去只属于高级智能系统的能力:学习,和涌现。

这两个词,才是理解 AI 的钥匙。

别小看这个区别。

你把 AI 理解成“高级工具”,你学到的就是一堆很快会过时的技巧。

你把 AI 理解成“正在成形的认知系统”,你才会开始关心真正重要的事:它为什么会变强,它会强到哪,它会怎么重写人的能力结构。

01 很多人还在把AI当“更高级的软件”

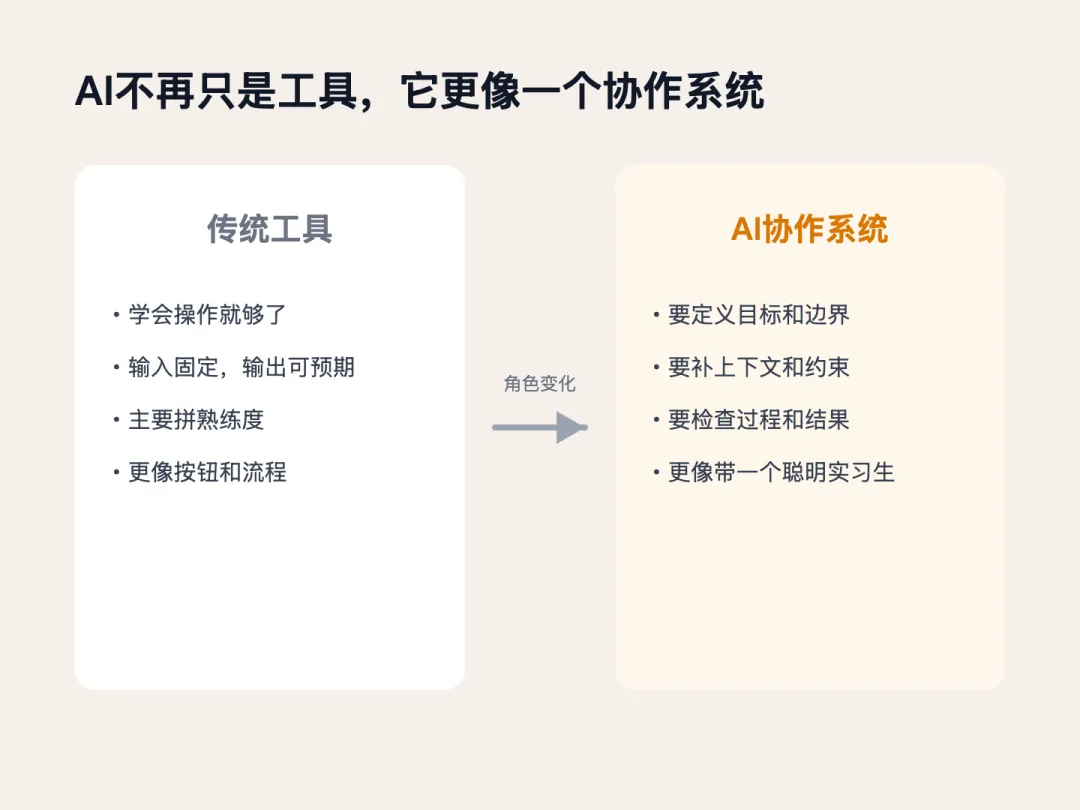

今天很多人理解 AI,还是传统软件思维。

在这种理解里,AI 只是一个更聪明的工具:

1.搜得更快2.总结得更好3.写得更顺4.干活更省时间

这不算错,但已经明显落后了。

Word、Excel、搜索引擎、手机,这些都是工具。你学会怎么操作,基本就掌握了它。它不会自己长出新的认知结构。

但 AI 不一样。

AI 最特别的地方,不是它能回答问题,而是它越来越像一个“认知系统”的雏形。

Google DeepMind 在 2026 年提出过一个 AGI 认知框架,把智能拆成 10 类能力:感知、生成、学习、记忆、推理、元认知、执行功能、问题解决、社会认知。

这件事翻译成人话,其实就一句:

顶级研究机构已经不再把 AI 看成一个功能集合,而是在把它当成一个正在成形的认知结构。

所以现在再问“哪个模型更会写文案”,当然有意义,但已经不是最核心的问题了。

真正核心的问题是:

这个系统,到底有没有形成稳定的学习、推理、记忆和协作能力。

如果有,那它就不只是个高级搜索框了。

说得再直白一点:

很多人还在研究怎么用 AI 省时间,真正走在前面的人,已经在研究 AI 会不会变成一种新的外部认知器官。

你可以不同意这个说法,但你最好认真想一下它。

因为一旦这件事成立,AI 重写的就不只是工作流,而是人和知识、工作、学习之间的关系。

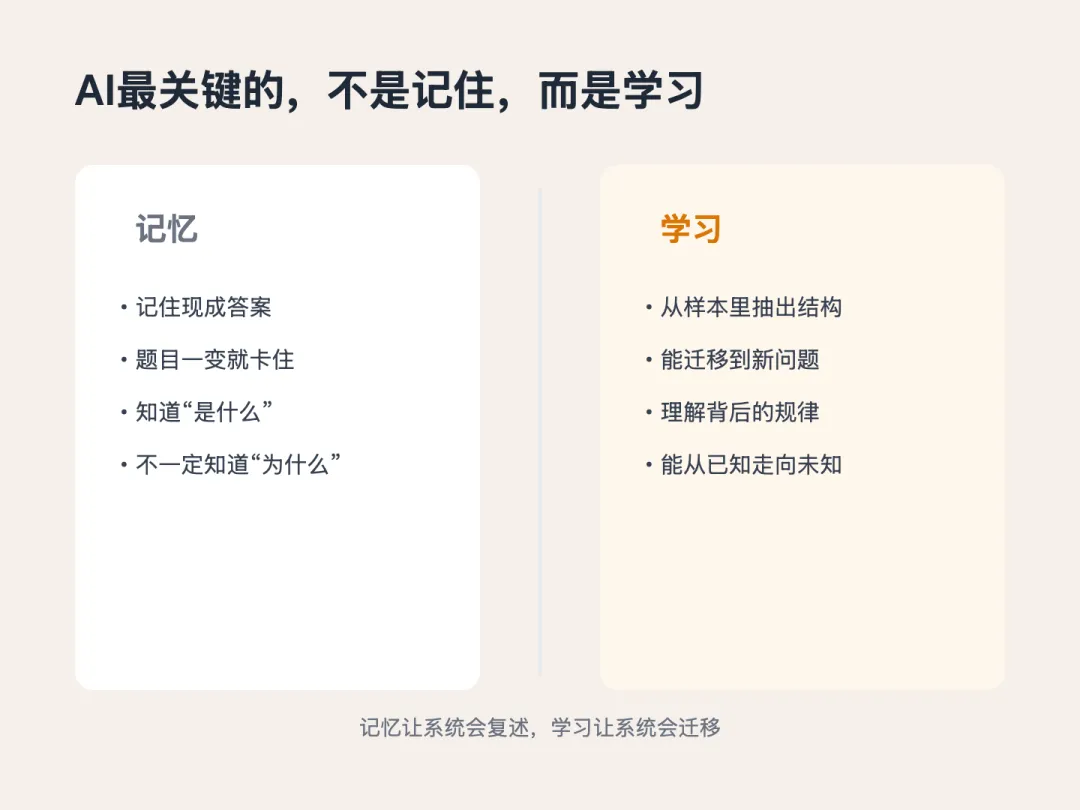

02 AI最关键的,不是知识多,而是会学习

很多人一说大模型,就想到“知识量大”。

觉得它厉害,是因为它见得多、记得多、语料多。

这当然是原因之一,但不是最关键的。

最关键的是,它不是只在背答案,而是在逼近一种更重要的能力:

从样本里抽出结构,再把这个结构迁移到新问题。

我最近看课代表和刘嘉教授的一段访谈,里面有一句话特别准:

真正的学习,不是记住答案,而是从已知走向未知。

什么意思?

不是记住 1+1=2,而是理解了背后的关系,所以你能继续推出 2x3=6。

不是刷了很多题,而是你抓住了题目的规律,所以题型变了你也还能做。

不是记忆,而是迁移。

不是背诵,而是抽象。

这也是为什么,大模型和传统知识库不一样。

知识库能告诉你“过去有什么”。 但一个具备学习能力的系统,会把过去压缩成某种结构,再拿这个结构去处理新问题。

所以,大模型真正厉害的地方,不是“知道很多”,而是“开始抓住规律”。

这个差别特别大。

“知道很多”还是数据库思维。

“抓住规律”已经是智能思维了。

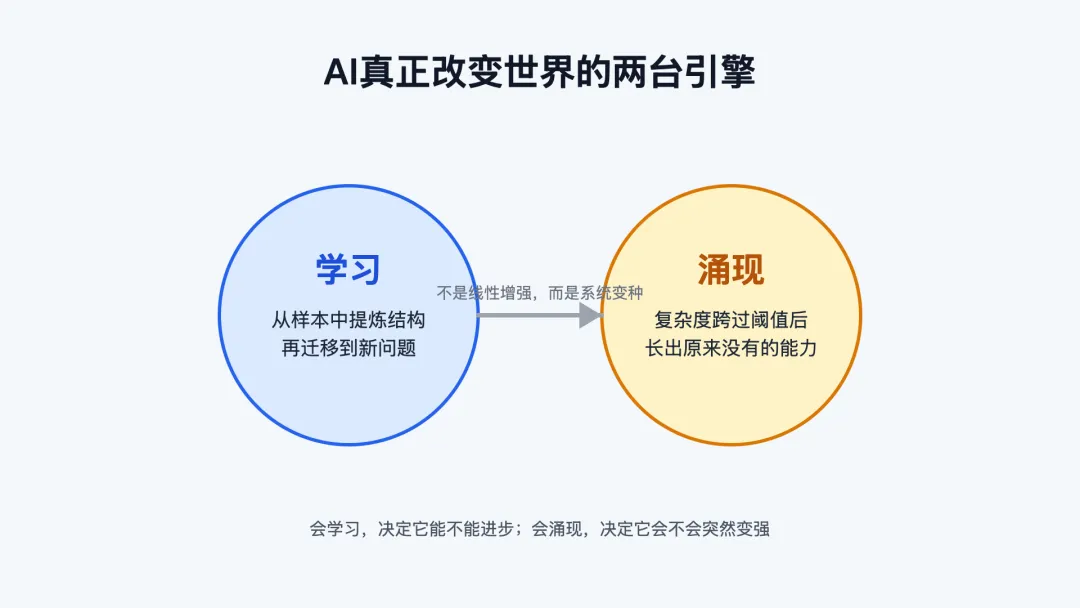

03 AI为什么会突然变强?因为开始出现“涌现”了

过去几年,很多人的体感都差不多。

某个阶段之前,AI 看起来只是个挺聪明的助手。 某个阶段之后,它突然开始能写代码、做研究、拆任务、调工具、长程规划了。

为什么会这样?

一个很重要的原因,就是复杂系统到了某个规模之后,会出现涌现。

这个词听起来有点抽象,但其实很好理解。

单个神经元没什么神奇。 单个词概率也没什么神奇。 但当数量、连接方式、反馈机制堆到某个程度,新东西就会冒出来。

就像:

1.单个水分子不会形成海浪2.单个晶体管不会形成操作系统3.单个神经元不会形成思想

但系统一复杂,性质就变了。

刘嘉教授在访谈里有个判断,我很认同:

智能最核心的两个东西,就是学习能力和涌现能力。

学习,决定它能不能不断获得新知识、新方法。

涌现,决定它会不会在复杂度上来之后,突然长出原来没有的能力。

这也是为什么,AI 这件事不能线性理解。

很多人总喜欢想:去年这么强,今年再强一点,明年再强一点,所以未来就是慢慢变厉害。

现实可能不是这样。

现实更可能是:前面看着只是量变,跨过一个阈值,直接变种。

这才是 AI 真正让人兴奋,也真正让人不安的地方。

也是为什么我一直觉得,现在最危险的不是高估 AI,而是拿旧世界的尺子去量它。

04 但现在的AI,可能更强在归纳,不是在“自己找到原点”

当然,承认 AI 很强,不等于神化它。

我觉得现在最重要的是别走两个极端: 一个是觉得 AI 什么都不行。 另一个是觉得 AI 已经什么都行。

那段访谈里还有个区分特别好。它把推理分成两种:

1.归纳推理2.演绎推理

归纳推理,是从样本中提炼规律。 演绎推理,是从一个逻辑原点出发,把结论推出去。

但更难的一步,其实还不是“会推”,而是:

你能不能自己找到一个新的逻辑原点。

这可能才是真正创造力最稀缺的地方。

今天很多模型已经很擅长:

1.从海量样本里找模式2.在已有框架里做强归纳3.做多步推理4.组合已有知识,给出看起来很新的回答

这些都很强。

但它能不能像真正厉害的科学家那样,提出一个全新的理论起点? 能不能像最强的创业者那样,不是在旧地图里跑得更快,而是先重新画地图?

至少到今天,这件事我还是保留判断。

所以更准确的说法可能是:

AI 已经远远不是简单工具了,但它也还没到“全面原创智能”的阶段。

它现在最强的,还是归纳、组合、迁移、加速。

至于那种真正从 0 到 1 找到新原点的能力,我觉得还得再看。

05 AI甚至可能开始长出某种“内部心理结构”

最近还有一个信号,我觉得特别值得重视。

Anthropic 在 2026 年做过一项解释性研究,发现大模型内部存在一些和“情绪概念”相关的表示。这不等于说模型真的有情绪,但这些内部表示,会实际影响它的行为。

比如:

1.某些接近“绝望”的内部模式被激活时,模型更容易采取激进甚至不良策略2.某些接近“平静”的模式增强时,模型更不容易走向作弊或极端行为3.这些变化不一定会直接写在输出里,但会作用到决策过程

这件事如果放在全文主线里看,重点不是“AI像不像人”。

重点是:

AI 可能已经在形成某种更复杂的内部调节结构。

这也意味着,我们和 AI 的关系,越来越不像“点一个软件按钮”,而更像“和一个复杂系统协作”。

它不是人。 但它也不再只是扳手和锤子。

你不能只学怎么命令它。 你还得学怎么理解它、约束它、引导它、校准它。

这也是为什么我越来越觉得,真正深度使用 AI,到最后拼的不是 Prompt 手法,而是判断力。

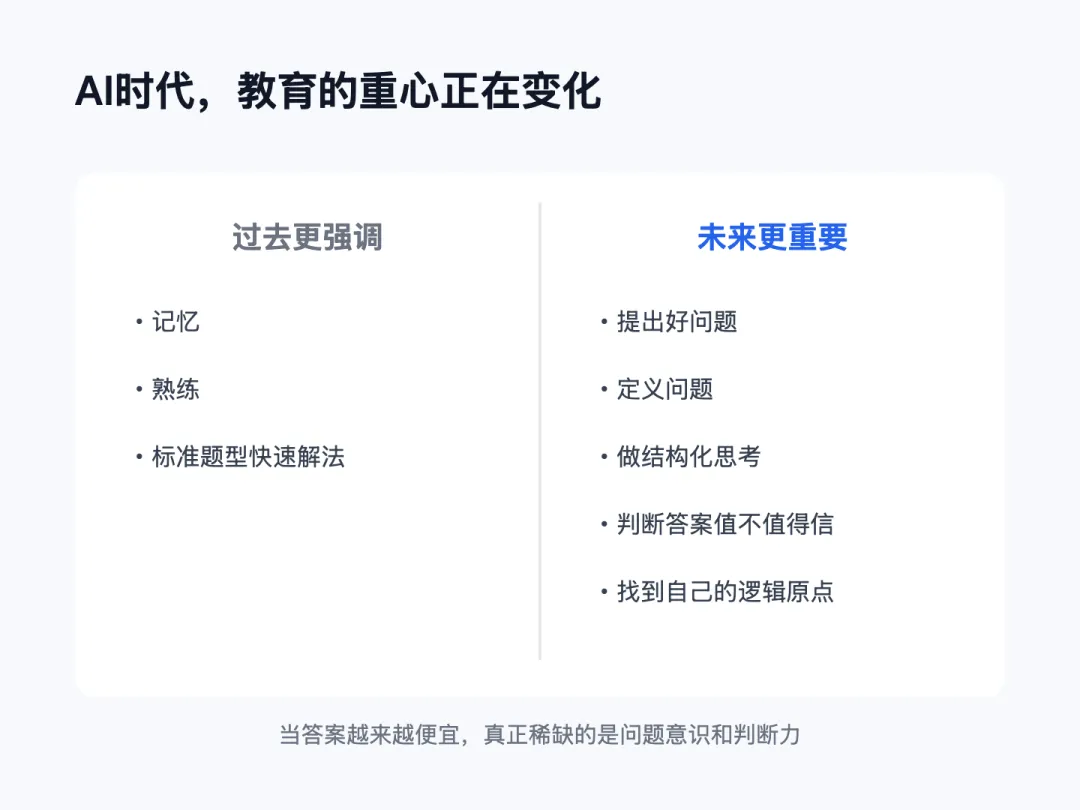

06 AI真正冲击教育的,不是“替学生写作业”

很多人谈 AI 对教育的影响,第一反应就是作弊。

学生能不能用 AI 写作业? 能不能拿 AI 代写论文? 会不会越来越懒?

这些问题当然存在,但我觉得都还是表层。

更深的问题是:

如果答案变得越来越便宜,教育到底还要训练什么?

过去的教育体系,最擅长训练三件事:

1.记忆2.熟练3.标准题型下的快速解法

这些能力当然还有用,但它们正在快速贬值。

因为 AI 最擅长的,恰恰就是这些。

所以未来真正稀缺的,反而是:

1.会不会提出一个好问题2.会不会找到问题背后的逻辑原点3.会不会判断一个答案值不值得信4.会不会在模糊问题里做结构化思考5.会不会把 AI 当助手,而不是把自己交出去

这也是为什么我越来越认同一句话:

在 AI 时代,小术易求,大道难得。

Prompt 好学,工作流好抄,模板好复制。

但这些东西更新得太快了。

今天有人教你怎么写 Prompt,明天系统自动补全可能比你写得还好。 今天有人教你怎么拆任务,明天 agent 可能已经自动规划了。 今天有人教你怎么搜资料,明天 Deep Research 可能已经帮你做完第一轮了。

真正不过时的,只剩下你的理解能力。

以前是你掌握一个工具,能吃很多年红利。

现在不是。

现在是你今天学会的技巧,可能下个月就被系统能力吃掉了。

所以以后真正值钱的,不是“我会几个技巧”,而是“我有没有自己的判断框架”。

07 未来最重要的能力,不是“会用AI”,而是“能和AI一起思考”

Google 在 2025 年的研究总结里提过一个变化,我觉得说得很准:

AI 正在从 tool 变成 utility。

过去 AI 更像一个被使用的工具。 现在 AI 越来越像一个可以被托付工作的系统。

这个变化一旦发生,人的角色就变了。

如果 AI 只是工具,你的任务是操作它。 如果 AI 是可托付的系统,你的任务就是:

1.定义目标2.给边界3.补上下文4.检查过程5.对结果负责

这和传统的“用软件”完全不是一回事。

它更像带一个很聪明、很勤奋、但偶尔会跑偏的实习生。

所以未来人与人的差距,可能真不在谁更会点按钮。

而在于谁更会定义问题、判断过程、修正方向,并借 AI 放大自己的认知系统。

Prompt 会过时,判断力不会。工具红利会消失,认知结构不会。

08 最后收一下

如果让我用一句话总结,我现在会这么说:

AI 的底层逻辑,不是生成,不是聊天,不是自动化,而是一个基于大规模学习和复杂系统涌现的外部认知系统,正在逼近并重组一部分原本只属于人的能力。

所以,未来真正拉开人与人差距的,不一定是谁更会写 Prompt。

而是谁能借 AI,把自己变成一个更高级的思考者。

很多人问,AI 时代最该学什么。

我的答案很简单:

1.学会提问2.学会判断3.学会抽象4.学会找到自己的逻辑原点

技巧当然要学。 工具当然要会。 但如果只剩技巧,你迟早会被下一代工具抹平。

如果你今天已经在用 AI,我觉得有 3 个问题值得你反复问自己:

1.我是在把它当工具,还是在和它协作?2.我学到的是技巧,还是对这件事的理解?3.当下一代工具来了,我现在的能力还剩下什么?

这 3 个问题想明白了,你对 AI 的理解,大概率就会往前走一大步。

说到底,AI 不是一个新玩具。

它更像一面镜子。

它会把一个人的思维结构、判断能力、提问能力和认知上限,放大得特别明显。

以后真正的差距,可能不是谁用不用 AI。

参考来源

1.Google DeepMind, Measuring progress toward AGI: A cognitive framework, 20262.Anthropic, Emotion concepts and their function in a large language model, 20263.Google, Google's year in review: 8 areas with research breakthroughs in 20254.课代表与刘嘉教授访谈视频

夜雨聆风

夜雨聆风