AI 最烦人的「不是…而是…」,反过来用才是真神器

本文是大雷看完晓辉博士 3 分钟短视频后的延伸解读,不是翻译搬运。

原视频讲的是「不是…而是…」句式在 AI 输入输出里的双向妙用,推荐直接看原片:

把”不是…而是…”返送给AI[1]

今天刷到晓辉博士一个 3 分钟的视频,直接把我看乐了。

他聊的是一个我们每个人都吐槽过的事儿——AI 生成的文章里,永远是一堆「不是…而是…」,「不是 A,而是 B」「不是要追求速度,而是要追求质量」。说真的,这玩意儿看多了真的烦,跟 AI 写的文章味儿一模一样,一眼识破。

但晓辉博士扔出来一个反直觉的观点:这个句式,我们反过来送回给 AI,效果出奇的好。

我品了一下,觉得这个洞察确实有东西。展开聊聊。

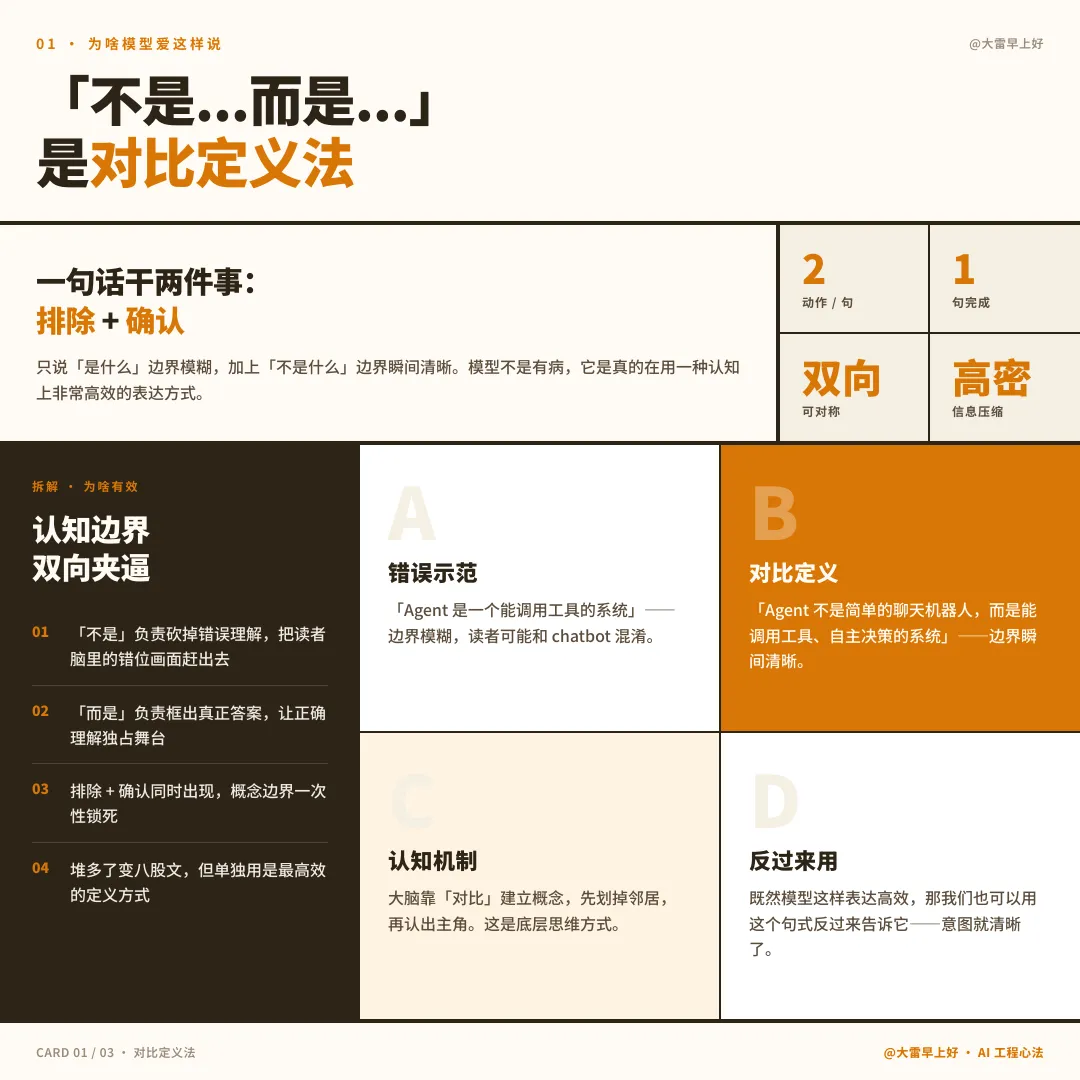

先搞懂:模型为啥非要「不是…而是…」

这个句式为啥让 AI 这么上头?

说白了就一句话——它同时做了两件事:排除和确认。

举个例子。你让 AI 解释「什么是 Agent」,它大概率会说:「Agent 不是一个简单的聊天机器人,而是一个能调用工具、有自主决策能力的系统。」

你看,一句话里它干了俩动作:先用「不是」把不符合的那一坨砍掉(比如把普通 chatbot 踢出去),再用「而是」把真正符合的那一坨框进来。

这就是经典的对比定义法——你要让人理解一个概念,最高效的方式就是告诉他这是什么 + 这不是什么。只说「是什么」,别人脑子里的边界是模糊的;加上「不是什么」,边界瞬间清晰。

所以模型不是有病才这么说话,它是真的在用一种认知上非常高效的表达方式。只不过——堆多了就跟八股文似的,谁看都烦。

真正的洞察:把这句式送回给 AI

晓辉博士真正牛的地方在这儿——他发现这个句式反过来用,是驾驭 AI 的一个绝招。

什么意思?

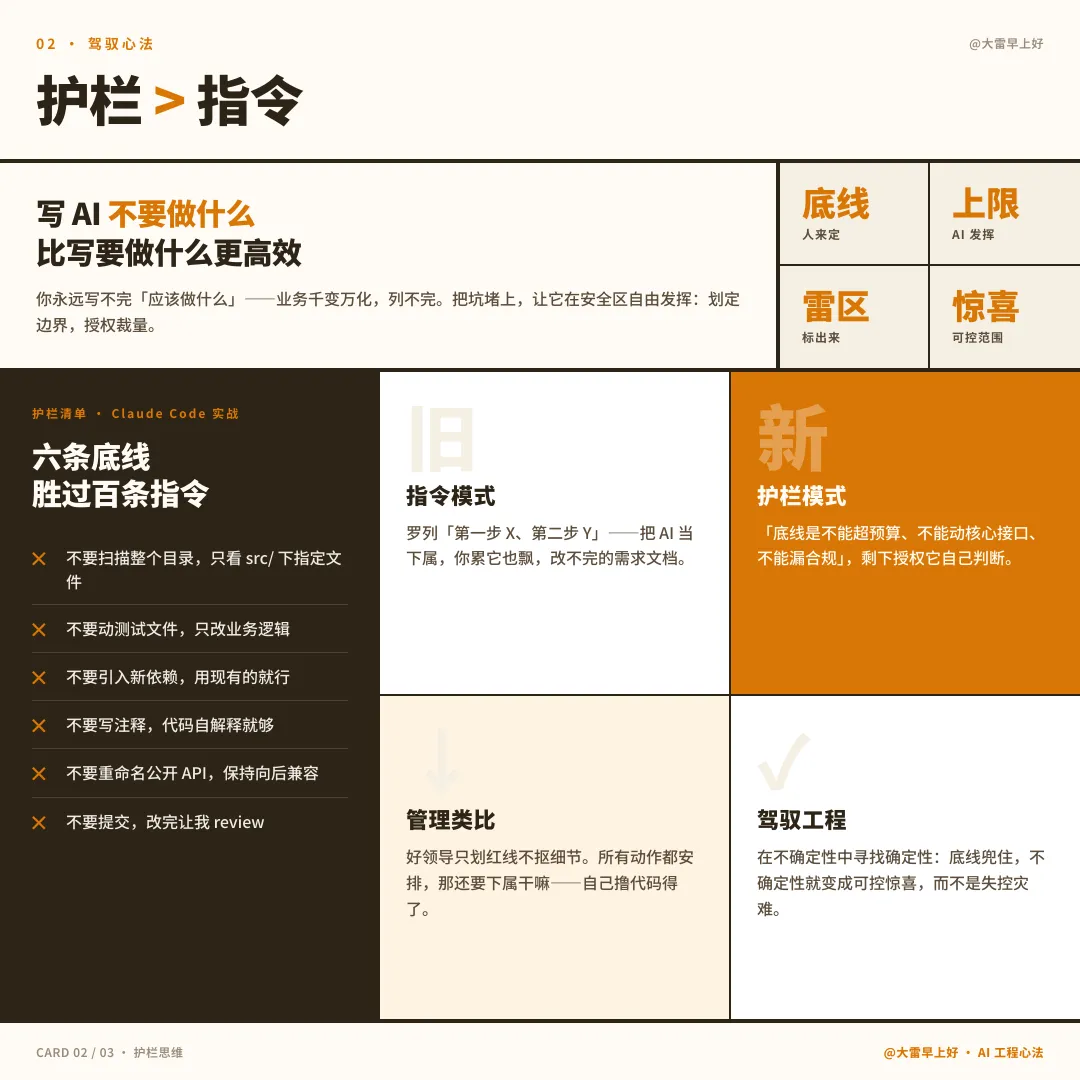

平时我们写 prompt,习惯是告诉 AI「你应该做什么」「我要什么样的结果」。这是正向指令,是我们打工人写需求文档的本能——越清晰越好,越详尽越好。

但实战里,你会发现光写「应该做什么」经常不够用。AI 还是会给你整出一堆你不想要的东西。为啥?因为你永远写不完「应该做什么」——业务千变万化,你不可能把所有情况都列出来。

这时候换个思路——告诉它「不要做什么」。

我跟你讲,这招在写代码 Agent 的时候太好用了。比如你让 Claude Code 帮你改一个文件,你与其事无巨细告诉它怎么改,不如直接告诉它:

src/ 下面这几个文件•不要动测试文件,只改业务逻辑•不要引入新依赖,用现有的就行•不要写注释,代码自解释就够了这就是所谓的护栏(guardrails)——你不用定义所有正确路径,你只要把坑堵上,让它在安全区里自由发挥就行。

为啥「写护栏」比「写指令」更好用

这里有个反直觉的点,值得品一品。

大多数人写 prompt 的时候,脑子里想的是把 AI 当下属——我得把任务写得足够清楚,它才能干对。所以就开始罗列「第一步做 X,第二步做 Y,第三步做 Z…」。

但你想想,如果下属所有动作都得你安排,那还要下属干嘛?你自己一条一条写代码得了。

真正高效的管理方式,是划定边界,授权裁量。领导跟你说「这个项目你负责,底线是不能超预算、不能动核心接口、不能漏合规」——剩下的你看着办。这时候你反而干得最带劲、最有创造力。

AI 也是一样的。你把底线画清楚,把「雷区」标出来,剩下的让模型自己去判断。你会发现结果往往比你手把手教出来的更好。

这就是驾驭工程(Harness Engineering)的核心思想——在不确定性中寻找确定性。

底线是确定的(我们划出来了),上限是不确定的(让 AI 发挥),但因为底线兜住了,不确定性就变成了可控的惊喜,而不是失控的灾难。

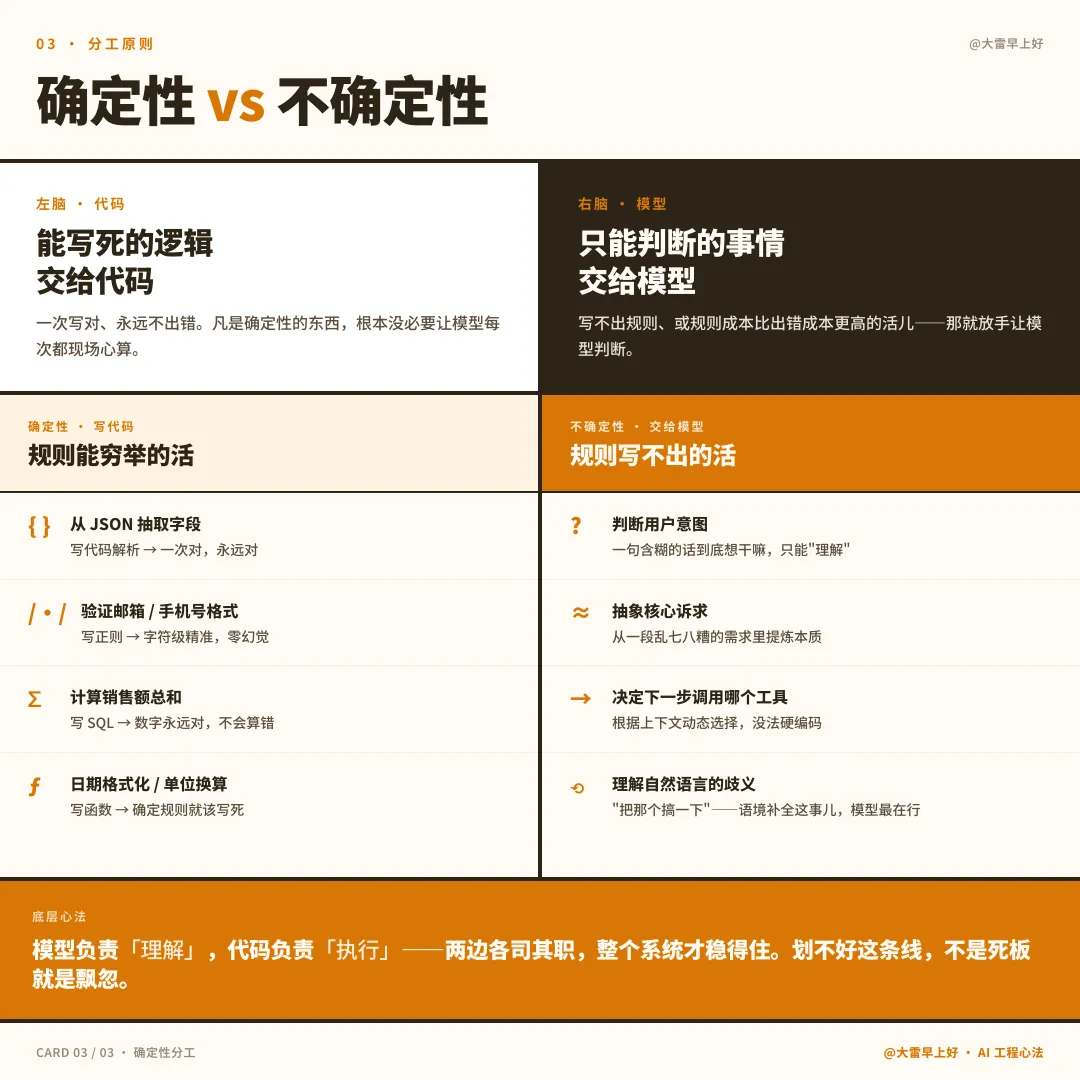

另一条金线:确定性给代码,不确定性给模型

晓辉博士还顺带提了一条原则,我觉得同样值钱——

能写死的逻辑,交给代码;只能判断的事情,交给模型。

这条看着简单,实战里踩坑的人一大片。

我见过太多人做 AI 应用,上来就是「让大模型搞定一切」——数据抽取让模型做、格式校验让模型做、计算求和也让模型做。结果?模型动不动就幻觉,数字算错、格式跑偏、字段漏填。

其实凡是确定性的东西,根本没必要让模型来做。

这些活儿模型能写代码搞定,一次写对、永远不出错,你干嘛非要每次都让它现场心算?

那模型应该干啥?干那些写不成规则的活儿:

这些事儿你写不出规则,或者写规则的成本比模型出错的成本还高——那就放手让模型判断。

说白了,模型是负责「理解」的,代码是负责「执行」的。两边各司其职,整个系统才稳得住。

大雷视角:这套方法论值钱在哪

聊到这儿,其实已经能看出来晓辉博士这 3 分钟的视频,密度是真的高。我再加几句自己的延伸——

第一,「不是…而是…」这个句式本质上是个双向工具。

模型用它给人输出(让人理解),人用它给模型输入(让模型理解)。这个对称性很有意思——人和模型在语义层面是能互相翻译的。你能让模型用什么方式跟你讲清楚,你也能反过来用同样的方式跟模型讲清楚。

所以以后你觉得某个 AI 输出的句式好用,下次写 prompt 的时候就直接拿来用。这事儿完全对称。

第二,护栏比指令更符合真实世界的管理逻辑。

我做了这些年技术,看过太多流程——一个特别靠谱的流程,一定是该禁止的严禁止,该放开的真放开。那种什么都要审批、每一步都要签字的流程,最后都变成形式主义,没人认真看,还拖死效率。

AI 也一样。你把关键的底线守住,其他地方让它自由发挥——出来的东西才有灵气。

第三,分清「确定性」和「不确定性」,是做 AI 应用的基本功。

这个判断力,其实是这波 AI 工程师跟之前程序员最大的差别。

老一代程序员的思维是「什么都要确定」——我代码里不能有不确定的东西,否则就是 bug。

新一代 AI 工程师得学会混合思维——哪些地方必须确定(写代码),哪些地方可以不确定(让模型判断),这两者的边界怎么划。

划不好这条线,你做出来的 AI 应用要么死板(啥都硬编码,不如不用 AI),要么飘忽(啥都丢给模型,天天出幻觉)。

今天的一页 AI 工程笔记

晓辉博士这个视频虽然只有 3 分钟,但把驾驭大模型的三条关键心法都点到了:

这三条如果你平时写 prompt、做 Agent 的时候都能下意识用上,我跟你讲,产出质量会有肉眼可见的提升。

底层逻辑其实很朴素:AI 是个能力超强但有点飘的合作者,你得学会怎么跟它协作,而不是幻想它自己能搞定一切。

就这么简单。

原视频在这儿,强烈推荐看一遍(才 3 分钟):把”不是…而是…”返送给AI[2]

你们平时写 prompt 还有啥反直觉但特别好用的小技巧?评论区聊聊,我挑几条点赞最高的下次拿出来一起唠。

🌟 加入大雷早上好 AI 星球

每天早上分享一条 AI 实战心得,白天打工晚上搞 AI 的兄弟姐妹欢迎扫码加入。里面都是一线在用 AI 干活的人,少点理论多点实操——不好使来退我会费。

本文内链接

把”不是…而是…”返送给AI: https://www.youtube.com/watch?v=7u81Oyixy8A

把”不是…而是…”返送给AI: https://www.youtube.com/watch?v=7u81Oyixy8A

夜雨聆风

夜雨聆风