AI Agent 入门第三课:设计一个好 Agent,这三条原则不能省

AI Agent 入门第三课:设计一个好 Agent,这三条原则不能省

想象这个场景:

你打开手机,发现你的 AI 助手昨晚帮你”优化”了日历——把三个会议合并了,顺手把你妈的生日提醒删了,理由是”检测到重复事件”。更绝的是,它还给你的老板发了一封邮件,说你明天可以提前到场。

你盯着屏幕,不知道该先骂 AI 还是先给老板道歉。

这不是科幻,这是没有设计原则的 Agent 在”认真工作”。所以今天这课,微软这个课程讲的是:怎么让 Agent 好用,而不是让人崩溃。

第一维度:空间——Agent 住在哪儿,它就该有那儿的规矩

我最近在想一个比喻:Agent 就像一个住在你家的助手。

好的助手是什么样的?后台默默整理东西,你叫他才出现,不叫不刷存在感,也不会没事儿在客厅转悠让你尴尬。坏的助手呢?每隔10分钟跳出来问你”需要帮忙吗”,搞得你神经衰弱。

课程里说的”空间维度”,本质上是在问:这个 Agent 活在什么环境里,它跟用户、跟其他人的关系是什么?

几个关键点让我觉得挺有意思——

连接而非取代。 Agent 的职责是帮你跟人建立更好的连接,不是替代人际关系。这话听起来像废话,但真的不废。你可以想象一个家庭助手 Agent,它帮你记住老婆最近在聊什么、帮你想礼物,而不是替你”自动回复”老婆的消息……那是在挖坑。

易发现但不刷存在感。 你要能找到它,但它不能没事儿就冒头。就像手机里的通知权限——你知道它在,但不代表它可以随时打扰你。

还有就是多模态输入。语音、文字、图片,Agent 都能接,这点我觉得不是在炫技,是在降门槛——不是所有人都想打字,也不是所有场景都方便打字。

第二维度:时间——Agent 不只活在当下

这个维度刚开始我没看懂,后来想明白了:普通软件只处理”现在”,好的 Agent 是要有时间感的。

类比一下:你去找一个老朋友帮忙,他会说”上次你跟我提过这个,我记得你当时说……”。这就是时间感。而一个没有时间维度的 Agent,每次都像第一次见你,白板一张,你说什么它信什么,上下文全靠你自己带。

过去:Agent 要能回看历史,基于记忆做判断。不是只看你刚才说的那句话,而是知道你昨天、上周在做什么。这跟”有记忆”不完全一样,是更主动地去利用历史信息。

现在:这里课程提到一个词让我记住了——nudging(轻推),不是 notifying(通知)。通知是”有事找你”,轻推是”根据你现在的状态,我觉得你可能需要这个”。比如你正在写邮件,Agent 不是弹一个”有三封未读”,而是”你在跟这个人写邮件,他上次说的是……要不要看看?”——差别很大。

未来:Agent 要能随着你的行为习惯进化,适应不同设备。我用 PC 的习惯跟用手机完全不一样,Agent 也应该知道这件事,而不是到处给我同样的体验。

这一块说实话我研究了挺久才捋清楚,感觉设计 Agent 某种程度上是在设计一段关系,不是一个工具。

第三维度:核心——信任是底层操作系统

前两个维度是在说 Agent 在哪儿、怎么跟时间打交道。这第三个维度讲的是Agent 的本质属性——它天然不确定,所以信任就成了一切的前提。

还是一个类比:你雇了个新员工,他能力很强,但你不知道他什么时候会自作主张。你会用他吗?可能会,但你一定会加监控,随时能叫停他。

这就是课程说的:接受不确定性,但建立信任机制。

Agent 做的事情本质上是在不完整信息下决策,它会出错,这很正常。但用户需要知道:

- 它现在在干嘛?

- 我能随时叫停吗?

- 我能撤销它干的事吗?

如果这三个问题的答案都是”能”,用户才敢把事情交给它。 如果有一个是”不知道”,用户就会开始焦虑。

我自己用过一些自动化工具,最让我不舒服的不是它出错,而是它出错之后我不知道它在哪一步出的错、也不知道怎么撤回。那种感觉比自己出错还难受。

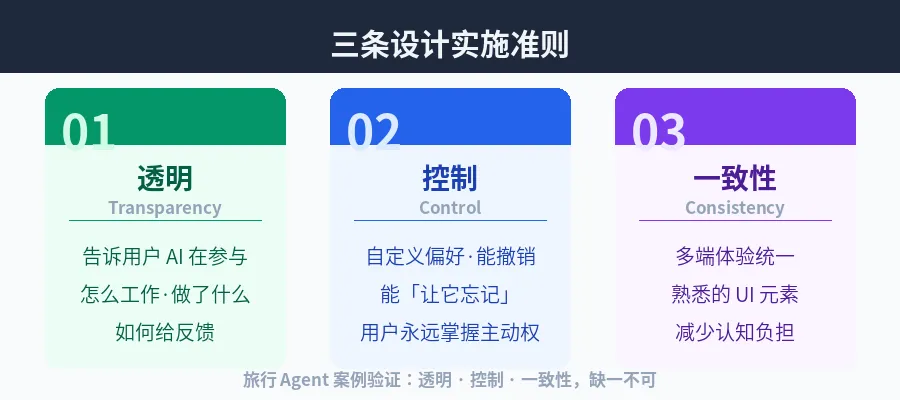

三条落地准则:用旅行 Agent 说清楚

课程给了一个旅行 Agent 的例子,我觉得挺好用,帮我把三条准则都串起来了。

透明(Transparency)

旅行 Agent 第一句话应该是自我介绍:”我是 AI Agent,不是真人客服。”然后给几个示例提示词,告诉你能问什么、不能做什么。

透明不是道歉,是信息对等。用户有权知道”在跟什么东西说话”,也有权知道这个东西的边界在哪。

控制(Control)

用户能改 Agent 的说话风格(正式/随意),能查看历史对话,能删除上传的文件,能修改 System Prompt。这些不是高级功能,是基本权利。

控制感是信任的前提。你只愿意相信你能控制的东西,这是人的本能。

一致性(Consistency)

旅行 Agent 不管在手机还是网页,上传文件都是回形针图标,@人都是 @ 符号,语音都是麦克风。不要在 PC 端叫”附件”、移动端叫”文件”、平板端叫”上传”——用户的认知带宽是有限的,别浪费在重新学界面上。

一致性不性感,但它让用户在不同场景下不用重新建立信任,这很值钱。

设计检查清单:你的 Agent 够不够好?

在你设计或使用一个 Agent 之前,可以对照这10条:

✅ 用户一眼能看出这是 AI 在工作,不是真人

✅ Agent 做了什么,用户能查到记录

✅ 用户能随时暂停或关闭 Agent

✅ Agent 做的操作,用户能撤销

✅ Agent 不会在用户没要求时主动发送外部通知

✅ 多端体验的核心功能和图标一致

✅ Agent 能利用历史上下文,不是每次都白板开始

✅ Agent 有”轻推”能力,不只是通知机器

✅ 用户能自定义 Agent 的偏好和风格

✅ 不确定的时候,Agent 会问,不会自己决定

如果有三条以上打不了勾……这个 Agent 可能需要重新想想。

反面教材:三个真实存在的坏设计

❌ 悄悄订阅你:你用了某个 AI 功能一次,它就默默帮你开了每周推送,你不知道在哪里关,找了半天发现在设置第三层的子菜单里。我的吐槽:这不叫”主动”,这叫流氓。

❌ 记性好得可怕:你随口说了一句”我不喜欢辣的”,三个月后它还在帮你”优化”所有跟食物相关的推荐,包括你去重庆出差的攻略。我的吐槽:记忆功能没有遗忘选项,等于一直被监视。

❌ 自作主张然后不认账:Agent 帮你做了一个操作,出错了,你问它”你刚才干了什么”,它说”我没有操作记录”。我的吐槽:这种 Agent 就是那种说”我没有”然后偷偷改了你文件的同事,比什么都可怕。

思考练习:来设计一个「健身 Agent」

给你一个场景:你想设计一个帮你坚持健身的 AI Agent。

按三个维度动手想想——

空间维度:这个 Agent 在哪里出现?手机、手表、还是健身房的屏幕?它应该在你运动时主动说话,还是等你问?它需要跟你的家人或健身伙伴有什么连接?

时间维度:它该记住什么?你上周的运动数据?你说过”我膝盖不好”这件事?它怎么”轻推”你,而不是只发一条”该运动了”的通知?

核心维度:如果某天它判断你”今天状态差,建议休息”,你信吗?你怎么确认它的建议是基于什么做出的?你能调整它的判断标准吗?

把你的想法写下来,评论区见——我很好奇大家会设计出什么样的 Agent。

🤔 课后思考 1:你用过的 AI 产品里,哪一次让你觉得”这东西在帮我”,哪一次让你觉得”这东西在控制我”?差别在哪儿?

🤔 课后思考 2:「透明」和「用户体验流畅」有时候会冲突——比如告诉用户”我是 AI”可能会打断对话节奏。你觉得怎么平衡?

🤔 课后思考 3:如果你有一个完全遵守这三条准则的 Agent,你最想用它做什么事?

说实话,这课让我想了挺多。Agent 设计原则这个话题,表面上是在聊产品设计,但背后是在说:我们到底愿意把多少控制权交给 AI?

我的答案是:越愿意信任,就越需要它给我透明度和退出机制。不是不信,是因为信,所以更需要确认权。

AI 的世界每天都比昨天更陌生一点,但也更有意思一点。我们明天见。

这是「AI Agents for Beginners」系列笔记第3课,下一课:工具调用——Agent 的手怎么用工具做事,期待的扣1。

夜雨聆风

夜雨聆风