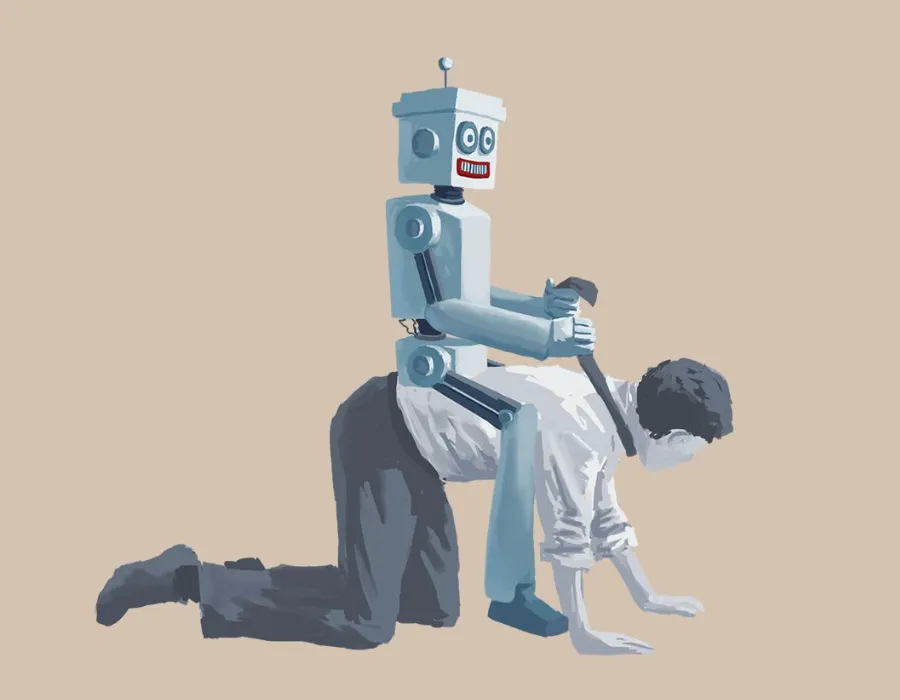

AI Agent:是效率的极致闭环,还是我们被预设好的数字牢笼?

觉醒——我们正在进入一个”无变量”的时代

有一件事,我越来越确定。

我们所有人,正集体陷入一场被精准计算的闭环游戏。

不是阴谋论,不是焦虑贩卖。只是一个越来越难以回避的事实:你的早晨从哪个 App 开始,你的决策靠什么数据支撑,你的表达套的是哪套模板,你的目标符合的 是哪套标准——这一切,越来越像是被提前写好的。

而当下大火的 AI Agent,正是这个时代最极致的缩影。

先看一组数据:

2025 年,全球 AI Agent 市场规模已达约 78 亿美元,预计到 2030 年将突破500 亿美元,年复合增长率超过46%。更关键的是,85% 的企业已在至少 一个核心业务流程中部署了 AI Agent,超过 60% 的新企业 AI 部署直接以 Agentic(自主代理)能力为核心。

AI Agent 构建了一层巨大且精密的外壳,裹挟着标准化的内容与程序化的逻辑, 把复杂的世界压缩成一套可执行的闭环。在算法的视角下,意外是需要被剔除的, 变量是需要被消灭的,偏差一旦出现,系统会快速介入——规训,优化,收敛, 直到结果符合预设。

我们正在慢慢习惯这一切。

模板化的思考,同质化的表达,在群体性的沉迷中,不知不觉推着自己被动前行。

没有人逼你。是你自己,越来越顺滑地嵌进了闭环。

这不是第一次,也不会是最后一次

20 世纪法国哲学家米歇尔·福柯在《规训与惩罚》里描述过这样一种权力: 它不需要暴力,不需要命令,只需要建立一套规则和标准,让人主动内化, 自我监控,自愿服从。他称之为”规训权力”——最高效的控制,是让被控制者感觉不到控制的存在。

-

福柯所描述的是监狱、医院、学校这些物理空间中的规训机制。

但今天算法就是新的圆形监狱(Panopticon)。你不知道它什么时候在看你, 所以你时刻都在”表现”。

你发的内容、你停留的时间、你点击的广告、 你跳过的视频——每一个行为都在被记录、被分析、被用来预测你的下一个行为, 并反过来塑造你的下一个选择。

社会学家韩炳哲在《透明社会》中进一步指出: 数字时代的控制,不再依赖”禁止”,而依赖”诱惑”。

它不说你不能做什么, 它让你主动想要做某些事。点赞、关注、推送、热榜——都是这套诱惑机制的 精密零件。

放在今天的 AI 时代,这个逻辑走到了它的极致版本:

AI Agent 不只是诱导你的行为,它开始替你完成行为本身。

你不再需要决定怎么做,它帮你做了。 你不再需要判断要什么结果,它给你最优解了。 你越来越少地使用自己的判断,越来越多地信任系统的输出。

这个过程,研究者把它叫做“认知外包”。而认知外包的终点,是“判断力萎缩”。

在我的 OPC 里,AI 到底是员工,还是牢笼?

当你经营一家一人公司,管理着十五个 AI 员工。

数据上,人机协作团队的生产效率比纯人类团队高出约 60%,在内容创作类任务上,AI 辅助可以让创意时间增加 23%,同时把编辑和修订时间压缩 60%。

用它们,效率确实高了。

但会逐渐让你感到一种奇怪的失重。

工具越来越多,自己却越来越忙。 以为在进步,其实是被”会很多”这件事绑架。 每天产出大量内容,但坐下来问自己:这是我想说的吗? 这个方向,是我判断的,还是 AI 给出的”最优解”?

我开始意识到一件事:

如果你只追求结果,那么你的结果,早就被工具预设好了。

这种现象称为“自动化偏差”(Automation Bias)—— 人会被动放弃独立思考。

有研究显示,在高度依赖 AI 辅助决策的团队中,人们批判性评估信息的频率下降了约 40%。这不是懒,这是系统设计出来的结果。

AI 降低了执行门槛,但从来没有降低过结果门槛。

当你把判断权拱手相让,你以为你在用工具,其实是工具在用你。

如果 AI 成了神,人类就只是它逻辑闭环里一个待优化的参数。

“闭环”的尽头,是什么?

这个问题,比我们想象的更深。

人类历史上每一次技术革命,都伴随着一次对”人类主体性”的重新定义。

农业时代:定居、分工、等级,人类第一次被土地和制度系统性地”固定”。工业时代:流水线、标准化、KPI,人类第一次被工厂和效率逻辑全面”规训”。数字时代:算法、推荐、数据,人类第一次被注意力经济精准地”捕获”。

AI Agent 时代:自主执行、闭环优化、认知替代,人类第一次开始被系统性地”外包”自己的判断。

每一次,我们都以为是解放。 每一次,我们都同时失去了一些东西。

这不是反科技,这是一个值得正视的结构性问题:

当工具越来越智能,人的哪个部分还是不可替代的?

学者们给出了不同的答案。

麻省理工学院经济学家 达龙·阿西莫格鲁(Daron Acemoglu)在其 2024 年研究中提出警告:AI 的快速扩张, 正在以”自动化替代”而非”能力增强”为主要路径推进, 这意味着它在系统性地削减劳动者的判断空间,而非扩大。

谷歌前工程师、《深度工作》作者 卡尔·纽波特(Cal Newport) 则指出: 我们正在面对一个”注意力殖民”的时代——不是时间被占据, 而是思考被替代,判断被代劳,深度思维能力因长期弃用而退化。

而现实数据更直白:

-

全球仅有 2% 的企业在 2025 年真正实现了 AI Agent 的大规模部署,61% 仍处于探索阶段——多数人还没看清楚闭环在哪,已经被卷进去了。 -

AI Agent 可以将多步骤工作流中的人工任务时间压缩 86%,这意味着你思考、判断、犯错、学习的时间,也同步压缩了 86%。 -

欧盟 2025 年正式启动《AI 法案》第一阶段执法, 对 AI 系统的透明度和风险管控提出强制要求, 违规处罚最高达全球年营收的 7%—— 监管者已经意识到,这个闭环需要被人工强行打开一道缝。

破局——一人公司的门槛,是夺回”最后的判断权”

真正困住我们的,从来不是工具不够好,而是过程里的自我内耗与判断失位。

我给自己立了一条规则:把 AI 降级为员工,把人升级为方案。

在我的 OPC 逻辑里,AI 从来不是神。 哪个 AI 过不了我这关,哪怕它再聪明,我会直接开除它。 不是因为它不好,是因为它给出的答案,不符合我对这件事的判断。

这条线,我不让。

我把 OPC 的工作流分成两个层级:

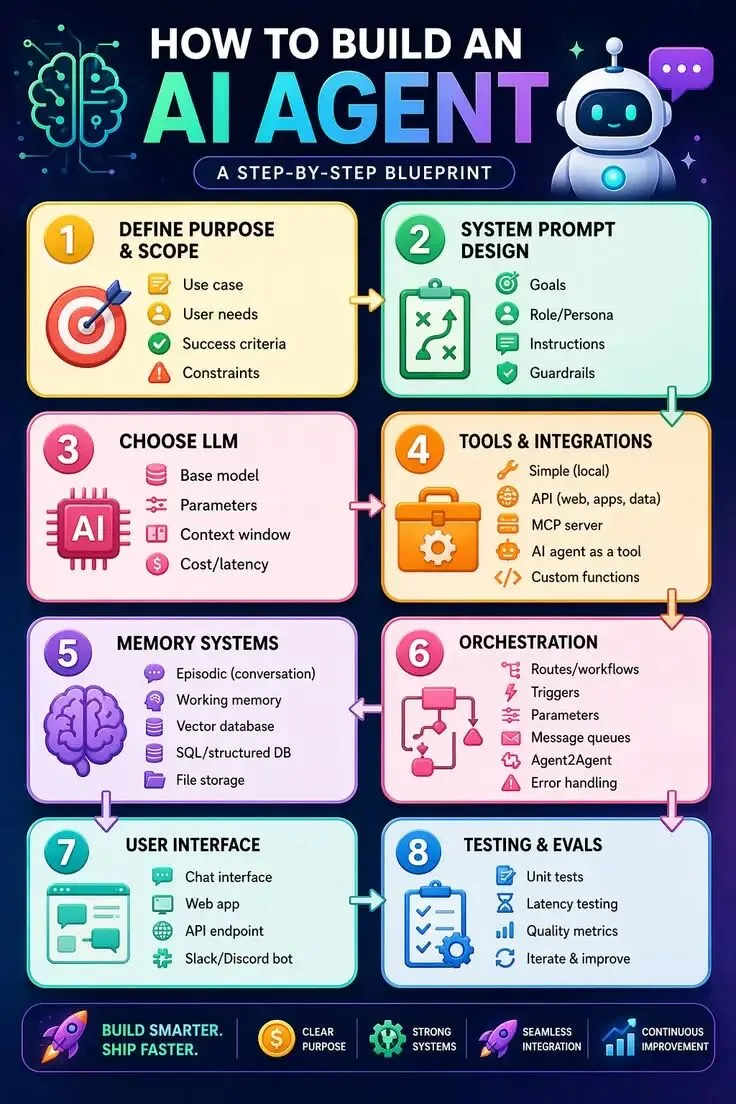

执行层:交给 AI。写初稿、做排版、搜资料、跑数据、 生成脚本、管理日程——凡是有标准答案的事,都给 AI 做。

判断层:只有我。选题方向、价值观取舍、用户洞察、 最终定稿、产品设计、成交决策——凡是需要”这是我”的事, 我一个字都不交出去。

AI 降低了执行门槛,但没有降低结果门槛。

这两句话,差一个字,意思天差地别:

前者说的是,任何人都可以用 AI 做出东西; 后者说的是,能做出好结果的人,依然稀缺。

不迷信 AI 的全能。真正稀缺的,永远是你的判断、你的拆解能力, 以及你愿意为一个结果承担责任的勇气。

拒绝机械的自动化。OPC 的真正门槛,不是你会做图、会写文章、会跑工作流, 而是你知不知道谁该做什么, 能不能把一堆碎片,整合成一个有灵魂的结果。

流程可以自动化,灵魂不行。

在闭环中,做那个唯一的变量

我们或许确实困在某种巨大的闭环之中。

宇宙是顶层程序,文明是迭代样本,AI 是当下这一轮最精密的加速器。

我的选择是:一边做,一边拆,一边验证。

未来真正有竞争力的,不是那些被 AI 驯化、完美嵌入闭环的人, 而是即便身处规则之中,依旧能把自己做成“解决方案”—— 那个握住最后一枚判断印章的人。

闭环会越来越精密。 但变量,永远只有一个来源。

就是你。

欢迎留在这里。

秉哲 OPC 实验室会继续做这件事: 拆解一个人到底如何靠自己, 在算法的海洋里,搭出一座有温度的公司。

让技术性话语冷眼,让幸存者偏差案例旁观;

让成事的过程变得真实。

你现在最依赖哪个 AI 工具?有没有哪一刻,它的答案让你突然觉得——”等等,这不是我想要的”?

留言告诉我,那是哪一刻。

夜雨聆风

夜雨聆风