AI究竟是平权工具,还是会加剧世界不平等?

这个问题的争论,其实比AI本身还要古老。每一次重大技术变革,人类都会问同一个问题:这项技术是让世界更公平,还是更不公平?印刷术、蒸汽机、电力、互联网——每一次,乐观派和悲观派都各执一词,而历史最后给出的答案,总是比任何一方预想的都更复杂。AI也不例外。但这一次,这场争论有一些值得认真对待的新维度。

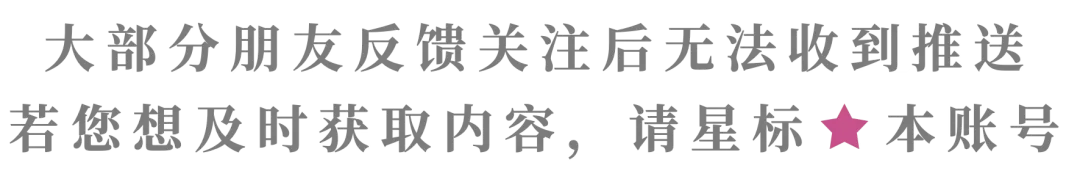

经济学家将这种现象称为”技能偏向型技术进步”。AI可能是这一逻辑的极端版本:它更多地是在补全高技能者的短板,而非替代他们的优势。与此同时,它确实在替代大量中低技能的重复性工作——数据录入、基础翻译、模板写作、初级客服。这就形成了一种奇特的结构:AI在底部创造了新的可及性,却在中间层制造了更大的挤压。

经济学家将这种现象称为”技能偏向型技术进步”。AI可能是这一逻辑的极端版本:它更多地是在补全高技能者的短板,而非替代他们的优势。与此同时,它确实在替代大量中低技能的重复性工作——数据录入、基础翻译、模板写作、初级客服。这就形成了一种奇特的结构:AI在底部创造了新的可及性,却在中间层制造了更大的挤压。

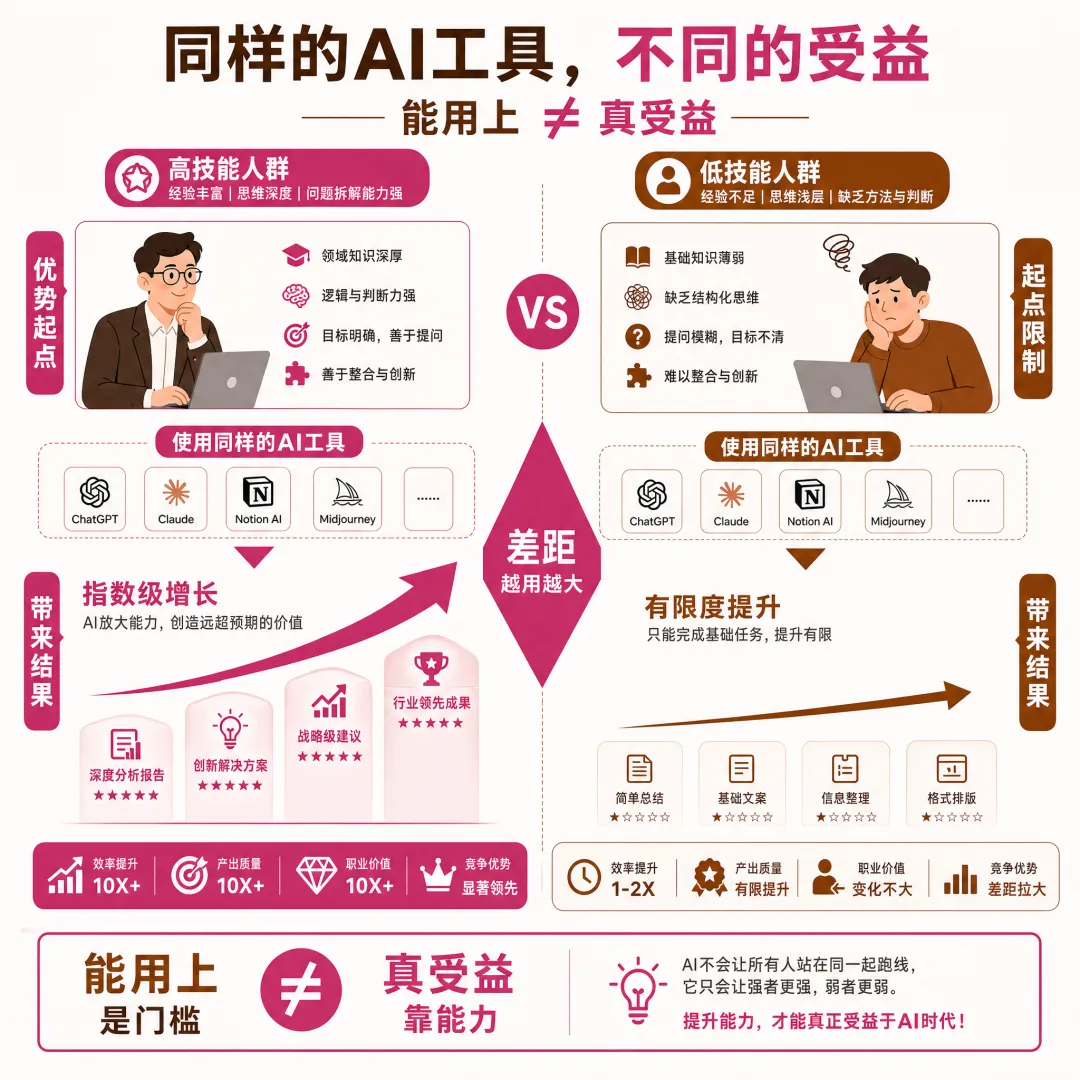

在工业革命时期,工厂是稀缺资源,土地是稀缺资源。在AI时代,算力基础设施是新的”土地”,而这片土地的所有权,比历史上任何一次技术革命都更集中。这意味着:AI工具的使用权可以民主化(任何人都能用ChatGPT),但AI产业创造的经济价值,绝大部分将流向极少数公司和个人。这是互联网时代已经发生过一次的故事——信息的获取民主化了,但广告收益集中在谷歌和Meta,内容收益集中在少数头部创作者,普通用户免费使用平台,同时成为了平台的产品。AI有充分理由重演这个逻辑,而且可能更极端。

在工业革命时期,工厂是稀缺资源,土地是稀缺资源。在AI时代,算力基础设施是新的”土地”,而这片土地的所有权,比历史上任何一次技术革命都更集中。这意味着:AI工具的使用权可以民主化(任何人都能用ChatGPT),但AI产业创造的经济价值,绝大部分将流向极少数公司和个人。这是互联网时代已经发生过一次的故事——信息的获取民主化了,但广告收益集中在谷歌和Meta,内容收益集中在少数头部创作者,普通用户免费使用平台,同时成为了平台的产品。AI有充分理由重演这个逻辑,而且可能更极端。

-

大部分朋友反馈关注后无法收到推送,若您想及时获取内容,可星标☆本账号;

-

点赞、分享、推荐♡或评论本文章,对我们是莫大的鼓励。

-

关注后即可访问我们的ima资料库,包含入门资料、历史文章、研报、财报供下载。

-

我们还发布了《2026价投白皮书》与《2025投资类好书、好文、播客推荐》,均可关注领取。

-

后台回复”99″,还可申请加入读者社群,与作者及同道人交流,名额有限。

-

本文是「AI通识读本」系列文章,持续更新中。我们用通俗语言拆解AI的原理、格局与投资逻辑——不搞玄学,不吹概念,帮你看清真实的AI世界,找到属于投资者的清醒判断。欢迎在下方订阅合集,不错过每一篇深度文章。

夜雨聆风

夜雨聆风