AI 存储技术栈全解 — NVIDIA Storage-Next、KV Cache、QLC SSD 与 HDD 五线重估

目 录

-

1、核心判断:AI 存储从容量周期进入数据执行栈 -

2、NVIDIA Storage-Next:512B random read 把 SSD 推到 GPU 近端 -

3、KV Cache 与 ICMS:推理时代真正吞吐的是上下文状态 -

4、QLC 与企业 SSD:SanDisk NBM、KIOXIA LC、RAG 数据池的同一条线 -

5、HDD 双寡头:Seagate HAMR 与 Western Digital LTA 为什么没有被 SSD 取代 -

6、HBM、DRAM、NAND、HDD:谁拿确定性,谁拿弹性,谁拿现金流 -

7、技术指标重估:IOPS、尾延迟、DWPD、队列深度、液冷、PCIe 光互连 -

8、投资框架:从“买涨价”转向“买性能瓶颈与合同硬度” -

9、风险与反证:压缩、供给反应、NAND 纪律、HAMR 良率、AI 资本开支 -

10、未来六个季度跟踪清单:Storage-Next 样品、NBM 合同、每 EB 价格、HBM4 认证 -

数据口径与来源

AI 存储技术栈全解 — NVIDIA Storage-Next、KV Cache、QLC SSD 与 HDD 五线重估

这篇报告把 KIOXIA 的 NVIDIA Storage-Next、512B random read、XL-FLASH GP Series、SanDisk NBM、Western Digital 与 Seagate nearline HDD、三星和 SK 海力士 HBM4 放进同一张 AI 数据栈里:AI 存储真正的变化不是容量变大,而是 HBM、DRAM、SSD、QLC、HDD 从“分层介质”变成推理系统的性能、成本和供给约束。

1、核心判断:AI 存储从容量周期进入数据执行栈

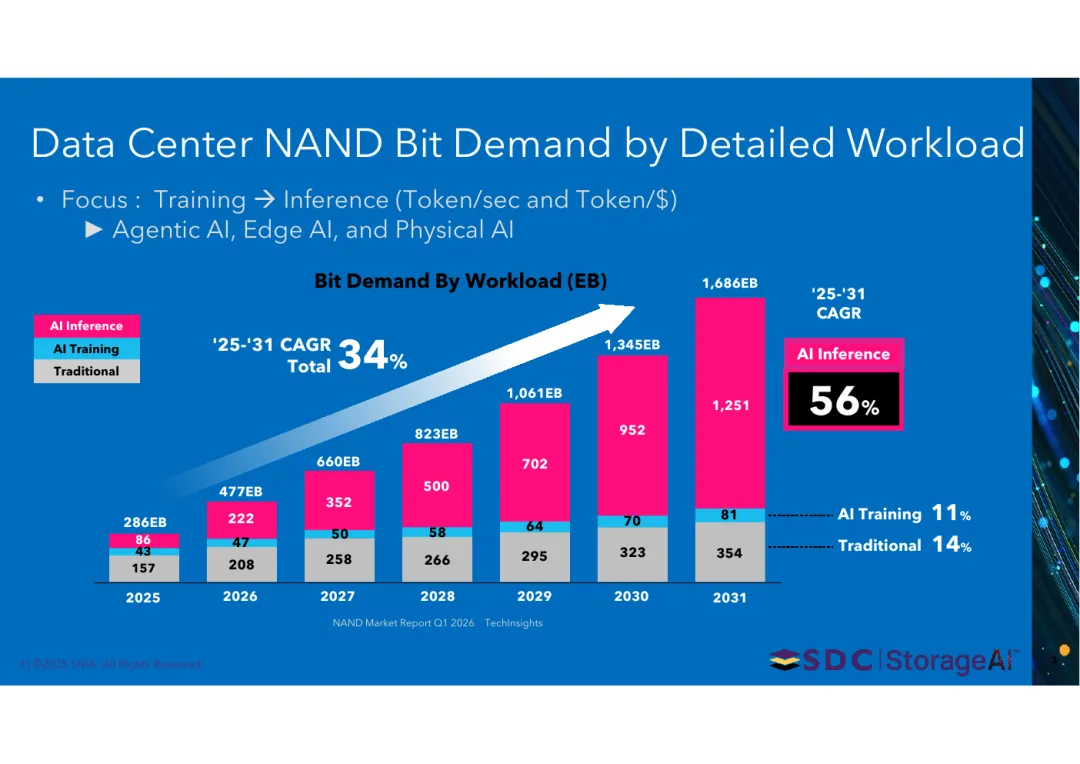

过去几篇存储报告解决的是“为什么这一轮不是普通涨价周期”:HBM 和 DRAM 被训练与推理抢占,NAND 被企业 SSD 与长协议重新定价,HDD 被云端数据留存和 nearline 供给纪律推成现金流资产。那套框架仍然成立,但它还缺一块技术底座:AI 应用到底在系统架构里怎样消耗存储,为什么这些需求会同时落到 HBM、DRAM、SSD、QLC 和 HDD,而不是只落到某一种介质。

这次 KIOXIA 的《AI Impact On Storage》把缺口补上了。它不是一份普通 NAND 需求展示,而是在讲一个更底层的变化:推理系统正在把一部分存储从“后台容量层”推到“GPU 附近的数据执行层”。一旦 SSD 需要参与 GPU 发起的细粒度 I/O、KV cache 复用、上下文状态调度和近端缓存,市场真正定价的就不再只是每 TB 成本,而是 512B 随机读、IOPS、尾延迟、DWPD、队列深度、PCIe 拓扑、液冷、多发起方访问,以及和 NVIDIA 软件栈的耦合程度。

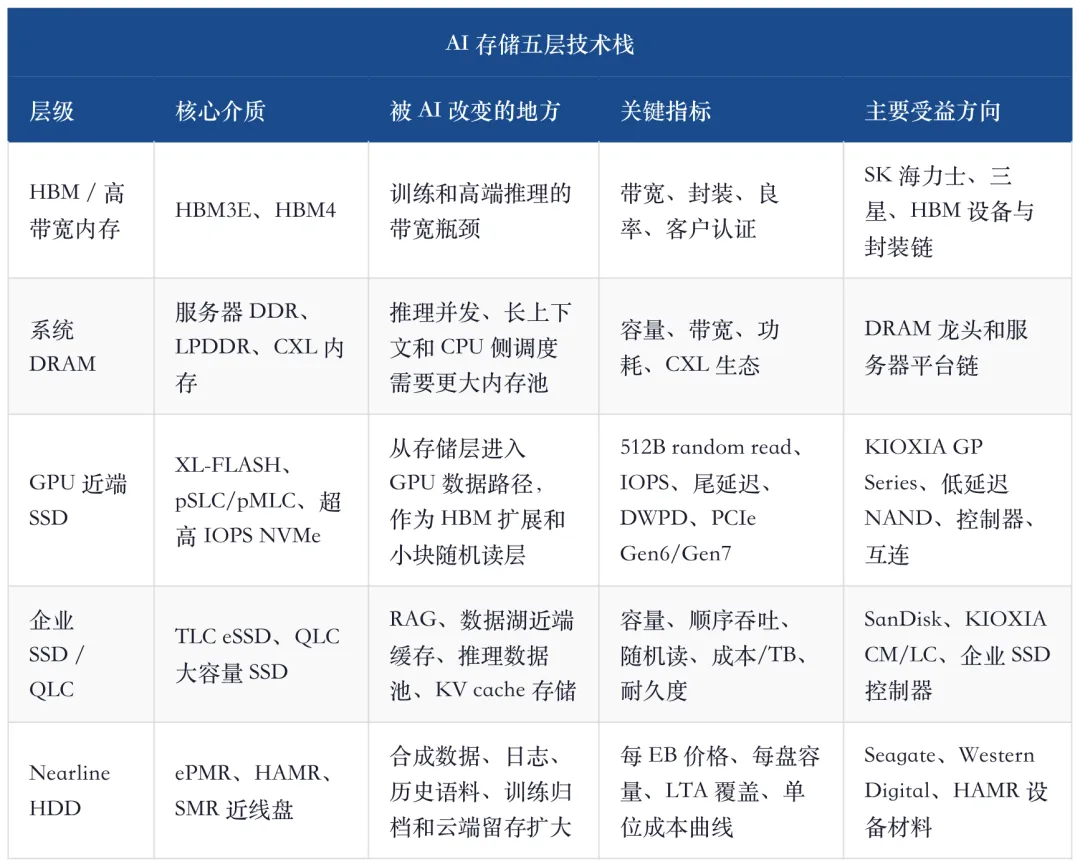

这也是本篇报告相对旧报告的新增判断:旧稿主要从财报、合约、卖方目标价和估值倍数证明存储进入超级周期;这篇要把“超级周期”拆成技术层级。我的结论是,AI 存储现在至少有五个彼此耦合的定价层:

这张表的关键不在“谁替代谁”,而在“谁处在什么延迟和成本半径里”。HBM 解决纳秒级带宽,DRAM 承接系统内存,超高 IOPS SSD 承接微秒级小块数据,企业 SSD/QLC 承接热/温数据池,HDD 承接低成本长期留存。AI 推理一旦从单轮问答走向 Agentic AI、长上下文、多模态和物理 AI,这五层不是各自涨价,而是在同一个数据路径里同时被拉紧。

AI 推动存储全行业重估:DRAM、NAND、SSD 与 HDD 谁最有定价权,三星、海力士、闪迪、西数、希捷财报互相印证

旧报告里我把存储分成确定性、弹性和现金流三类资产:DRAM/HBM 龙头拿确定性,SanDisk/NAND 拿高弹性,HDD 双寡头拿现金流可见度。现在要补一句:技术上真正的增量在“中间两层”,也就是 GPU 近端 SSD 和企业 SSD/QLC。它们解释了为什么 NAND 这轮不只是跟随 DRAM 涨价,而是可能出现自身的 AI 系统级定位。

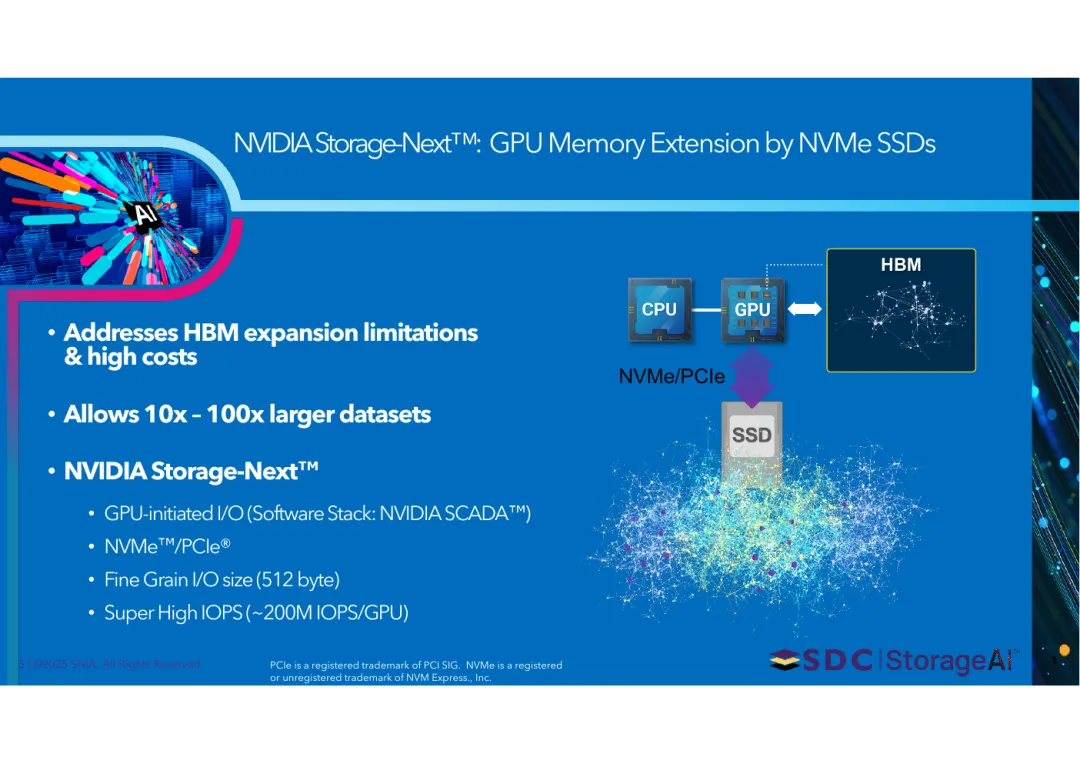

2、NVIDIA Storage-Next:512B random read 把 SSD 推到 GPU 近端

KIOXIA 材料里最重要的一页,是 NVIDIA Storage-Next 被定义为“用 NVMe SSD 扩展 GPU memory”。这句话如果只按营销语言看,很容易被低估;如果按系统架构理解,它意味着 GPU 和 SSD 的关系不再只是“GPU 等 CPU 从盘里读数据”,而是开始走向 GPU 发起 I/O、NVIDIA SCADA 软件栈、NVMe/PCIe、512 byte fine grain I/O,以及每 GPU 约 200M IOPS 的极高小块访问目标。

这跟传统 eSSD 是两种产品哲学。传统企业 SSD 的核心指标是顺序吞吐、4K 随机读写、容量、功耗和成本;Storage-Next 关心的是极小粒度、极高并发、极低尾延迟和 GPU 侧调度。KIOXIA 用 512B random read 而不是 4K random read 作为重点,说明它瞄准的不是数据库或通用服务器,而是模型推理中大量小块状态、索引、KV cache 和特征片段的读取。

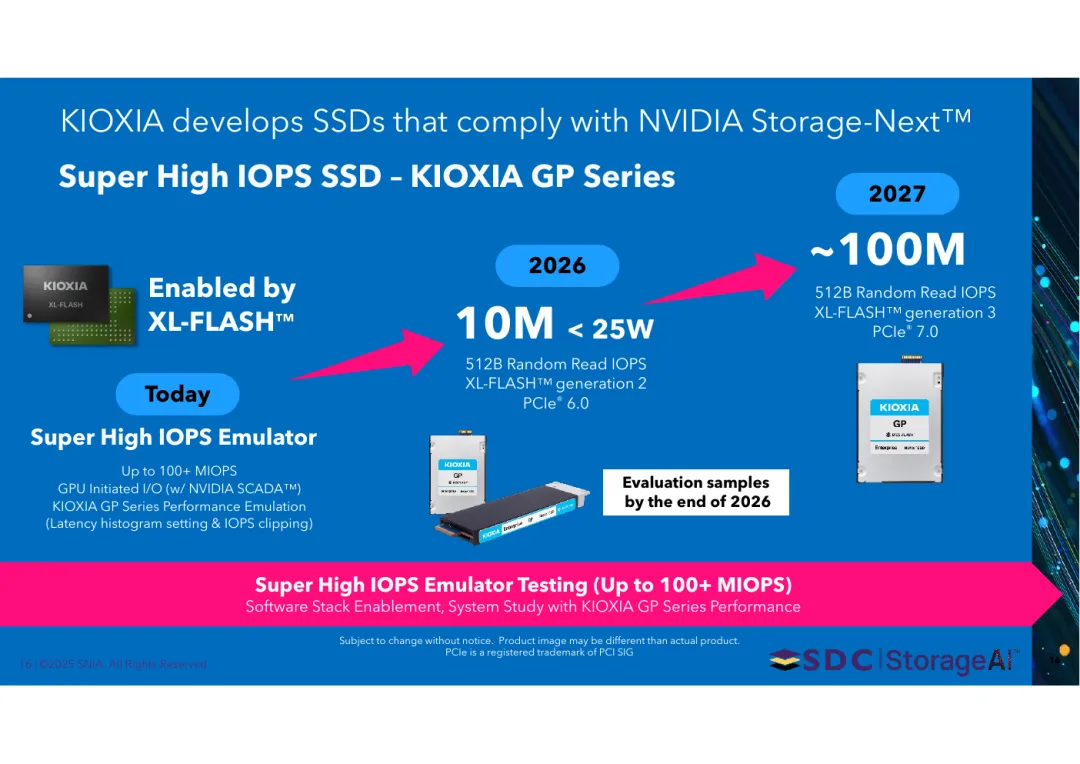

KIOXIA 给出的技术路线很激进:2026 年 GP Series 目标是 10M 级 512B random read IOPS、功耗小于 25W、XL-FLASH generation 2、PCIe 6.0,并计划在 2026 年底提供评估样品;2027 年目标进一步到约 100M 级 512B random read IOPS、XL-FLASH generation 3 和 PCIe 7.0。它还展示了高 IOPS emulator:在 GH200 上单实例可接近 140M IOPS,带延迟模型后约 97M IOPS,并强调 x86 GPU 系统受 GPU-CPU 带宽限制,无法生成 100M IOPS 级压力。

我认为这条线最重要的投资含义不是“马上买 KIOXIA”,而是重新定义 NAND 高端产品的估值锚。过去 NAND 厂商的高端溢价主要来自制程、层数、QLC 成本和企业 SSD 客户;现在可能新增一条“能不能进入 GPU 近端数据路径”的溢价。只要 NVIDIA Storage-Next 真实落地,NAND 的一部分产品就会从 commodity storage 转向 near-memory storage,这个变化会显著改变市场对 NAND 周期性的折价。

当然,技术路线还没完全验证。100M IOPS 级别的 emulator 不等于商业 SSD;512B 随机读如果要大规模服务推理,需要控制器、NAND die 并行、ECC 布局、队列管理、驱动栈、GPU 发起 I/O 和应用侧数据结构一起优化。KIOXIA 自己也把要求列得很清楚:512B random read optimization、increased endurance、high queue depths、liquid cooling、multi-initiator access、larger capacities。这不是单一 NAND 芯片升级,而是从介质到系统软件的共同设计。

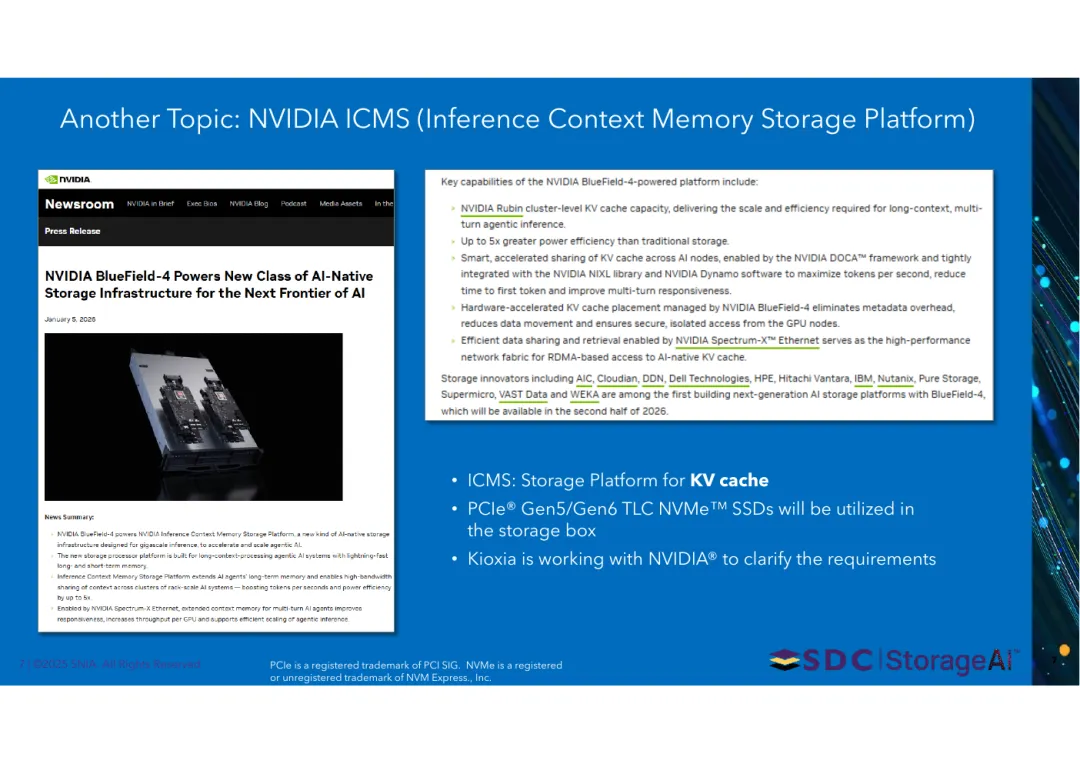

3、KV Cache 与 ICMS:推理时代真正吞吐的是上下文状态

为什么 Storage-Next 会和 KV cache 放在同一组材料里?因为推理时代最稀缺的不是“把模型权重读进来一次”,而是“反复服务海量用户上下文”。训练是大批量、长时间、高带宽;推理是高并发、低延迟、上下文不断增删改查。模型越长、Agent 越多轮、RAG 越常态化,系统越像一个状态机器,而 KV cache 就是这个状态机器的热数据。

KIOXIA 提到的 NVIDIA ICMS,即 Inference Context Memory Storage Platform,把 KV cache 单独作为 storage platform 讨论,并指向 BlueField-4、PCIe Gen5/Gen6 TLC NVMe SSD in storage box。这个方向很重要:如果 KV cache 只在 HBM 或 DRAM 里,成本会非常高,扩展性也受限;如果完全下沉到远端存储,延迟又无法接受。所以合理路径是分层:极热 KV cache 留在 HBM/DRAM,温热上下文进入近端 SSD 或专用存储盒,冷上下文和历史数据进入 QLC/HDD。

这解释了为什么旧报告里提到 TurboQuant、KV cache 压缩时,我没有把它视作存储需求的线性利空。压缩一定会降低单位 token 的存储占用,但它也降低了推理成本,反过来提高上下文长度、用户并发和应用频次。技术扩散常常触发 Jevons 悖论:单次更省,整体更多。真正需要观察的是压缩带来的“每请求存储消耗下降”能否超过“请求数、上下文长度、保留时间和多模态状态扩张”的乘数效应。现在看,后者至少在 2026-2027 年更强。

KV cache 还会改变企业 SSD 的产品结构。普通数据湖看重容量和吞吐,KV cache 看重小块随机读、尾延迟、写入耐久和多租户隔离;RAG 索引看重向量检索的近端性和读放大;Agent 状态看重持久化和快速恢复。这些需求共同指向一个结论:AI 推理不是简单“消耗更多 SSD 容量”,而是把 SSD 拆成不同角色。超高 IOPS SSD 服务 GPU 近端,TLC eSSD 服务高性能缓存与索引,QLC SSD 服务更大规模 RAG 和 warm data,HDD 服务长期留存。

因此,AI 存储的核心问题不再是“SSD 会不会替代 HDD”,而是“数据在不同温度、不同延迟半径、不同复用频次下怎样重新分层”。这个框架比单纯比较每 TB 成本更有解释力,也更符合各家公司财报里出现的分化:SanDisk 数据中心 NAND 暴涨,WD 和 STX 的 nearline HDD 同时强,HBM/DRAM 龙头又保持最强确定性。

4、QLC 与企业 SSD:SanDisk NBM、KIOXIA LC、RAG 数据池的同一条线

如果说 KIOXIA GP Series 是“存储靠近 GPU”,那么 SanDisk 这一季就是“NAND 需求已经进入合约化验证”。SanDisk Q3 FY26 的数据非常极端:收入 59.5 亿美元,环比增长 97%,同比增长 251%;非通用会计毛利率 78.4%;每股收益 23.41 美元;调整后自由现金流 29.55 亿美元。更关键的是结构:数据中心收入达到约 15 亿美元,环比增长 233%,Q3 增量来自 TLC-based enterprise SSD,Q4 将开始 QLC Stargate solutions 的收入出货。

这组数字要和 KIOXIA 的产品方向一起看。KIOXIA 在四类 SSD 方向里把 High Capacity 放到 Ingestion / RAG,对应 QLC 122TB/245TB+;把 HDD replacement 放到 NL SSD / Archive,对应 low cost QLC 256TB+。这说明 NAND 厂商内部也在把 AI 负载拆层:GP Series 追求 Storage-Next 的超高 IOPS,CM Series 追求高性能高容量,LC Series 追求 RAG 和 ingestion,NL SSD 追求 HDD 替代。SanDisk 的 QLC Stargate 收入出货,正好是这条线的公司财报验证。

闪迪与西部数据 2026 财年三季度财报深度解读 — NAND 暴利、HDD 现金流与 AI 存储周期验证

SanDisk 还有一个比短期 EPS 更重要的信号:NBM。公司披露已有 3 个 New Business Model partnership backed by firm financial guarantees,当前第四财季又新增 2 个。旧 NAND 周期的典型问题是价格涨跌快、客户承诺弱、资本开支容易失控;NBM 的意义是让客户用财务承诺换供应可见度,把一部分现货周期变成合同周期。即使不能把 NBM 直接等同于完整长期包销,它也说明云客户对 NAND 供给的紧迫性已经强到愿意提前锁定。

这也是我对 SanDisk 的判断:它不是最确定的存储资产,但它是当前存储链里盈利 beta 最大、争议也最大的资产。确定性不如 HBM 龙头,因为 NAND 供给格局更分散,历史纪律更差;现金流可见度不如 HDD 双寡头,因为 HDD 行业结构更集中、nearline 供给扩张更慢。但只要数据中心 TLC/QLC 和 NBM 持续兑现,SanDisk 的 EPS 斜率会比 HDD 更陡,也比传统 NAND 周期更像“AI 基建供应合约”。

需要强调的是,QLC 不等于“低端”。在 AI 数据栈里,QLC 的价值在于成本/TB、容量密度和大规模 warm data 承载。RAG 文档库、多模态素材、向量索引、日志、压缩后的上下文状态、微调样本和合成数据中间态,都不一定需要 HBM 或高端 TLC,但需要比 HDD 更近、更快、更易随机访问。QLC SSD 在这里不是替代所有 HDD,而是在 HDD 之上形成一层更热的数据池。

5、HDD 双寡头:Seagate HAMR 与 Western Digital LTA 为什么没有被 SSD 取代

如果只读 KIOXIA 这份技术材料,很容易得出一个过度推论:SSD 越来越靠近 GPU,HDD 会被边缘化。但结合 WD 和 STX 财报,答案恰好相反。AI 把一部分数据推向低延迟 SSD,也把更多数据推向长期留存 HDD。原因很简单:推理系统会产生日志、反馈、合成样本、多模态素材、训练回放、历史语料和合规数据,这些数据不可能全放在 SSD 上。

Western Digital Q3 FY26 的 deck 给了很直观的证据:收入 33.37 亿美元,同比增长 45%;非通用会计毛利率 50.5%;自由现金流 9.78 亿美元;云端收入占比约 89%;nearline exabytes 从去年同期约 145EB 增至 199EB,总 exabytes 222EB;最新一代 ePMR 出货 410 万块。WD 不是因为消费硬盘恢复而强,而是因为云客户把 nearline 作为 AI 数据留存底座。

Seagate 的逻辑更像“技术升级叠加供应纪律”。Bernstein 对 STX 的报告把核心说得很直接:FQ3 FY26 收入 31.1 亿美元,同比增长 44.1%;非通用会计毛利率 47.0%;自由现金流 9.53 亿美元;每 EB 价格环比上升约 6%,这是十多年来最大的需求驱动型硬盘每 EB 涨幅之一。更重要的是 HAMR:Mozaic 4 已有两家全球最大 CSP 完成资格验证,Mozaic 3/4 预计在 2026 年成为大部分 exabytes 来源,Mozaic 5 目标 50TB 并计划在 2027 年底进入资格验证。

HDD 非周期化大辩论:四家大行接力喊多对撞 UBS 估值中立票

HDD 的关键不在“绝对性能”,而在“单位成本和供应可见度”。BofA 的情景分析把这件事量化了:STX 在 2028 年 nearline shipments 约 1.1ZB 的框架下,如果 nearline $/TB 到 2028 年达到 20 美元、经营利润率 55%,C28 EPS 有机会接近 45 美元;WDC 在 2028 年 nearline shipments 约 1.4ZB 的框架下,如果 $/TB 达到 20 美元、经营利润率 55%,C28 EPS 有机会接近 33 美元。这个分析不一定会完全兑现,但它说明市场现在交易的是每 TB 价格、单位成本和利润率的共同上移,而不是单一出货量。

所以,HDD 不会因为 SSD 进入 GPU 近端而失去价值。相反,越多数据在热层被高频使用,就越需要冷/温层保存历史、回放、合成和再训练数据。HDD 的位置不是推理实时路径,而是 AI 数据飞轮的地基。它不决定每个 token 的瞬时延迟,但决定数据资产能否以可承受成本长期积累。这个位置让 WD/STX 比消费电子周期更稳,但也意味着风险来自 AI 资本开支、云客户订单节奏和 HAMR 良率,而不是来自单纯 PC/手机补库。

6、HBM、DRAM、NAND、HDD:谁拿确定性,谁拿弹性,谁拿现金流

把技术栈和财报合在一起后,存储投资排序会更清楚。

第一层,HBM/高端 DRAM 仍是确定性最高的资产。原因不是它涨幅最大,而是进入壁垒最高、认证周期最长、客户锁定最强。三星和 SK 海力士的财报已经证明,HBM4、服务器 DRAM 和高端 NAND 都在被 AI 拉动。即便未来某些推理架构降低 HBM 单位需求,训练、旗舰模型、视频生成、多模态和高端推理仍会长期消耗高带宽内存。这里买的是技术壁垒和客户结构。

第二层,NAND/企业 SSD 是弹性最大、争议也最大的资产。SanDisk 的 78.4% 毛利率和 23.41 美元 EPS 很夸张,但它背后既有真实短缺,也有周期高点风险。市场真正要判断的是:NBM 是否能持续扩张,QLC Stargate 是否能顺利放量,数据中心收入是否继续高占比,NAND 供给是否保持纪律。KIOXIA Storage-Next 又给 NAND 增加一个技术上行期权:如果 GP Series 或同类低延迟 SSD 进入 NVIDIA 生态,NAND 龙头的高端产品会获得新的估值语言。

第三层,HDD 是现金流可见度最强的层。WD 和 STX 的云收入、nearline EB、LTA、HAMR/ePMR 路线、资本开支纪律,让它们更像“AI 数据留存基础设施”而非传统硬件周期股。它们的缺点是估值已经快速重估,特别是 STX 在多家大行目标价连续上修后,市场已经提前计入了 HAMR 和长期利润率改善。这里买的是长期供需缺口和资本回报,不能再用普通周期底部估值框架。

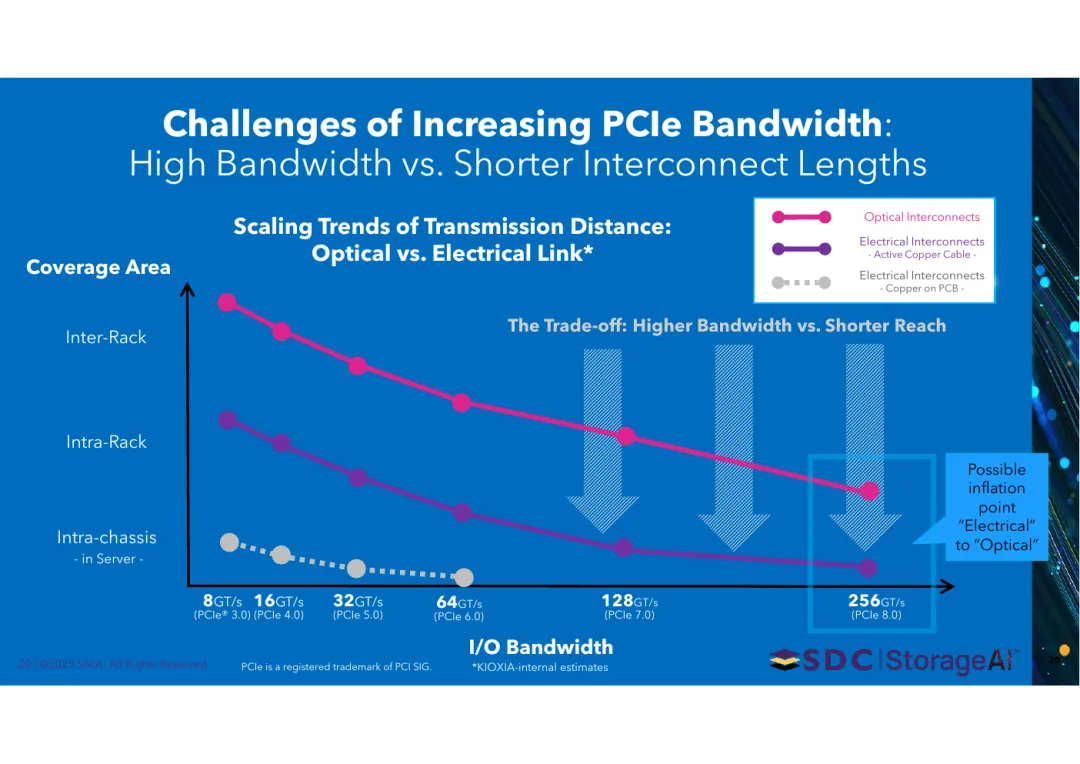

第四层,控制器、互连、液冷和封装链会获得二阶收益。Storage-Next 暗示 SSD 不只是容量设备,而是高 IOPS、低延迟、GPU 可访问的数据节点。这会把价值从 NAND die 扩散到控制器、固件、PCIe/CXL/Retimer、服务器背板、液冷和系统集成。尤其是 KIOXIA 提到 PCIe 带宽提升带来电信号 reach 缩短、PCIe 8.0 附近可能转向 optical interconnect,这条线值得和 AI 网络、CPO、板级光互连一起跟踪。

我的组合偏好因此不是“只买最涨价的”,而是按风险收益拆层:核心仓位应放在 HBM/DRAM 和 HDD 双寡头这类证据更硬的方向;弹性仓位放在 SanDisk/NAND 和低延迟 SSD 技术期权;交易性仓位关注控制器、互连和液冷的催化。最忌讳的是把所有存储都当成同一个周期资产,因为 AI 数据栈已经把它们拆成不同的技术角色。

7、技术指标重估:IOPS、尾延迟、DWPD、队列深度、液冷、PCIe 光互连

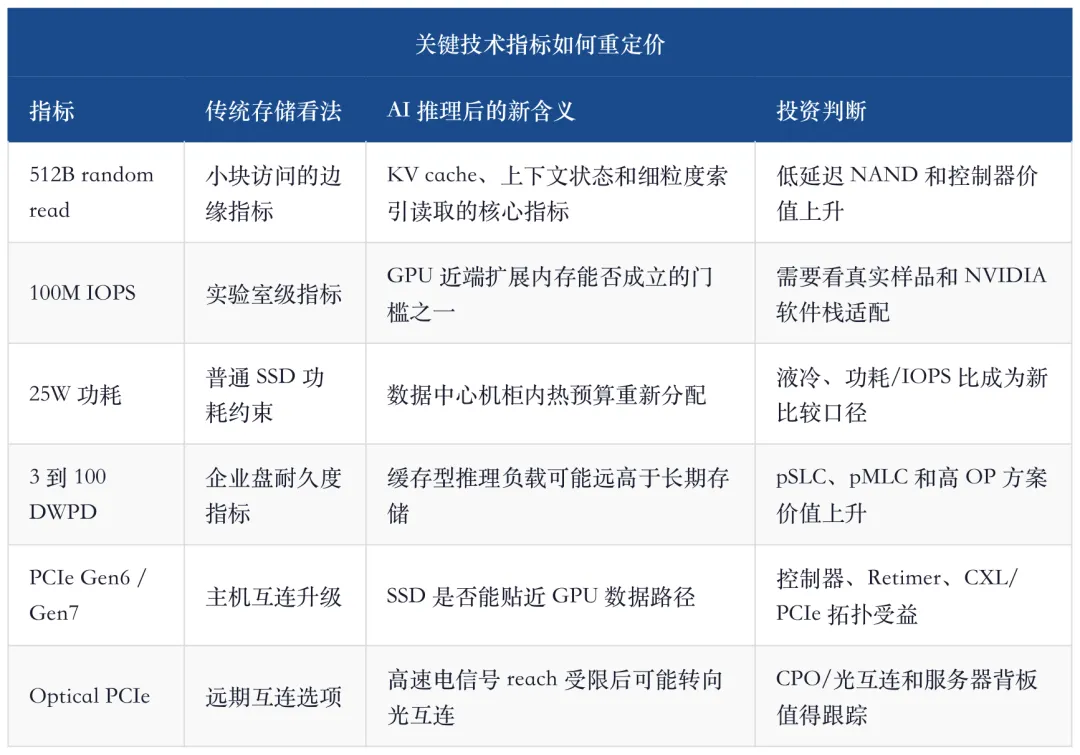

这轮存储重估最容易被忽略的是指标体系变化。以前市场看 NAND,最常问的是 ASP、bit growth、库存、层数、capital intensity;看 HDD,最常问的是 EB 出货、ASP/EB、毛利率、HAMR 良率。未来还要加一组系统指标。

第一,IOPS 要从 4K 走向 512B。传统企业 SSD 的 4K random read 对很多服务器负载足够,但 AI 推理中的上下文片段、KV cache block、embedding index 和小对象访问更细。KIOXIA 用 512B 作为 Storage-Next 的 fine grain I/O size,意味着控制器和 NAND ECC 布局都要为更小粒度优化。25M IOPS 对应每 40ns 一个 I/O completion,如果 tRead 是 45us,就必须重叠约 1125 个并行 I/O;如果 tRead 是 25us,也要约 625 个并行 I/O。这不是“SSD 更快一点”,而是并行架构完全不同。

第二,耐久度从长期写入寿命变成缓存经济性。KIOXIA 把 3 DWPD 到 100 DWPD 放进 increased endurance 讨论,说明 AI 缓存和长期存储的写入模式差异很大。如果 SSD 被用作推理缓存、KV cache 复用层或近端数据池,它可能承受远高于普通读密集型企业盘的擦写压力。pSLC、pMLC、overprovisioning 和控制器写放大优化会重新变得重要。

第三,队列深度和多发起方访问变成系统能力。GPU-initiated I/O、多 GPU 共享 SSD、DPU/BlueField 介入、storage box 承载 KV cache,都要求 SSD 不再只是一个 host-attached block device,而要处理复杂并发和 lease。传统 SSD 的指标页可能看不出差异,真实差异会体现在高 QD、尾延迟、隔离和软件栈稳定性。

第四,散热和互连开始进入存储投资框架。KIOXIA GP Series 2026 年目标是 10M 级 IOPS 且小于 25W;但如果机柜里布满高 IOPS SSD,热密度和供电仍会是约束。PCIe 从 Gen6 到 Gen7 再到 Gen8,电信号 reach 下降,可能推动 optical interconnect 进入机箱/机柜内链路。存储因此和 AI 网络、板级光、电源、液冷不再是平行赛道,而是同一个系统预算。

因此,后续研究存储不能只看公司财报里的 ASP 和毛利率,还要看技术路线是否拿到系统级位置。能进入 GPU 近端、推理缓存、RAG 数据池、云端 nearline 长协的产品,应该拿更高估值;只能卖通用 bit 的产品,仍然会被周期折价压住。

8、投资框架:从“买涨价”转向“买性能瓶颈与合同硬度”

如果只用“涨价”解释这轮存储,很容易在价格高位犯错。更好的框架是两条轴:一条是性能瓶颈,一条是合同硬度。

性能瓶颈决定技术溢价。HBM 的瓶颈是带宽和封装,超高 IOPS SSD 的瓶颈是 512B random read 和 GPU 侧 I/O,企业 SSD/QLC 的瓶颈是容量、成本和耐久,HDD 的瓶颈是每盘容量和单位成本。越靠近推理实时路径,性能指标越重要;越靠近冷/温数据池,成本和供应可见度越重要。

合同硬度决定周期折价。SanDisk 的 NBM、WD/STX 的 LTA、HBM 的客户认证和产能预订,本质上都在削弱传统现货周期。只是硬度不同:HBM 客户锁定和认证最硬;HDD LTA 的量可见度强,但远期价格仍滚动;SanDisk NBM 的财务担保增强可见度,但 NAND 行业纪律仍需验证;通用 NAND 和消费存储最弱。

按这套框架,当前排序大致是:

这也回答了“现在还能不能买”的问题:不能简单因为涨得多就看空,也不能因为涨价还在继续就无脑追。HBM 看客户认证和先进封装,NAND 看 NBM 与 QLC 是否从抢货变成长期订单,HDD 看每 EB 价格是否继续上行且 HAMR 成本下降能否兑现。真正有问题的,是那些既没有系统瓶颈、也没有合同硬度、只是跟着存储 beta 上涨的二线资产。

9、风险与反证:压缩、供给反应、NAND 纪律、HAMR 良率、AI 资本开支

这篇报告虽然偏多,但必须把反证路径摆清楚。存储这轮已经不是早期无人关注阶段,风险也从“市场不信”变成“市场过度线性外推”。

第一,压缩和架构优化可能降低单位需求。KV cache compression、量化、稀疏化、上下文管理、模型路由和更高效推理引擎,都会降低每 token 的存储和内存占用。我的基准判断是 Jevons 悖论仍占上风,但如果未来 2-3 个季度看到上下文长度、RAG 数据量和推理并发没有继续扩张,而单位优化持续加速,就要下调企业 SSD 和高端 DRAM 需求斜率。

第二,NAND 供给纪律仍是最大不确定性。SanDisk 的 Q3 数据非常强,但 NAND 历史上最容易在高毛利阶段刺激供给反应。即便短期资本开支看起来克制,也要盯 BiCS8、QLC、各家 wafer allocation、库存和客户长约条款。如果 NBM 没有继续扩张,或者数据中心收入占比回落,SanDisk 的估值会从 AI 合约资产重新变成高 beta 周期股。

第三,HAMR 良率和客户验证不能只看目标。Seagate 的 Mozaic 4 进展非常关键,但 HAMR 从资格验证到大规模高良率出货仍有执行风险。Mozaic 5 50TB 计划到 2027 年底资格验证,时间并不近。如果良率低于预期、成本下降不如模型,STX 的 FY28 EPS 和高倍数都会受压。WD 的 ePMR/未来 HAMR 路线同样需要跟踪,尤其是它能否缩小与 STX 的技术差距。

第四,AI 资本开支如果放缓,存储未必第一个受伤,但一定会被重估。GPU、网络、电力、存储是同一个 AI capex 预算。短期看,存储占总 capex 比重低、交付紧张,可能比 GPU 更晚感受到压力;但如果云厂商订单、模型收入或融资环境出现系统性收缩,HDD LTA、SSD NBM 和 HBM 预订都会被市场重新折现。

第五,估值已经前置。STX、WDC、SanDisk 都经历了快速目标价上修。多头报告中的 2028 EPS、20-29 倍 PE、1,000 美元目标价等假设,本质上是把供给纪律、价格上行和技术执行同时打满。实际投资要用“催化兑现表”管理,而不是只看远期蓝天。

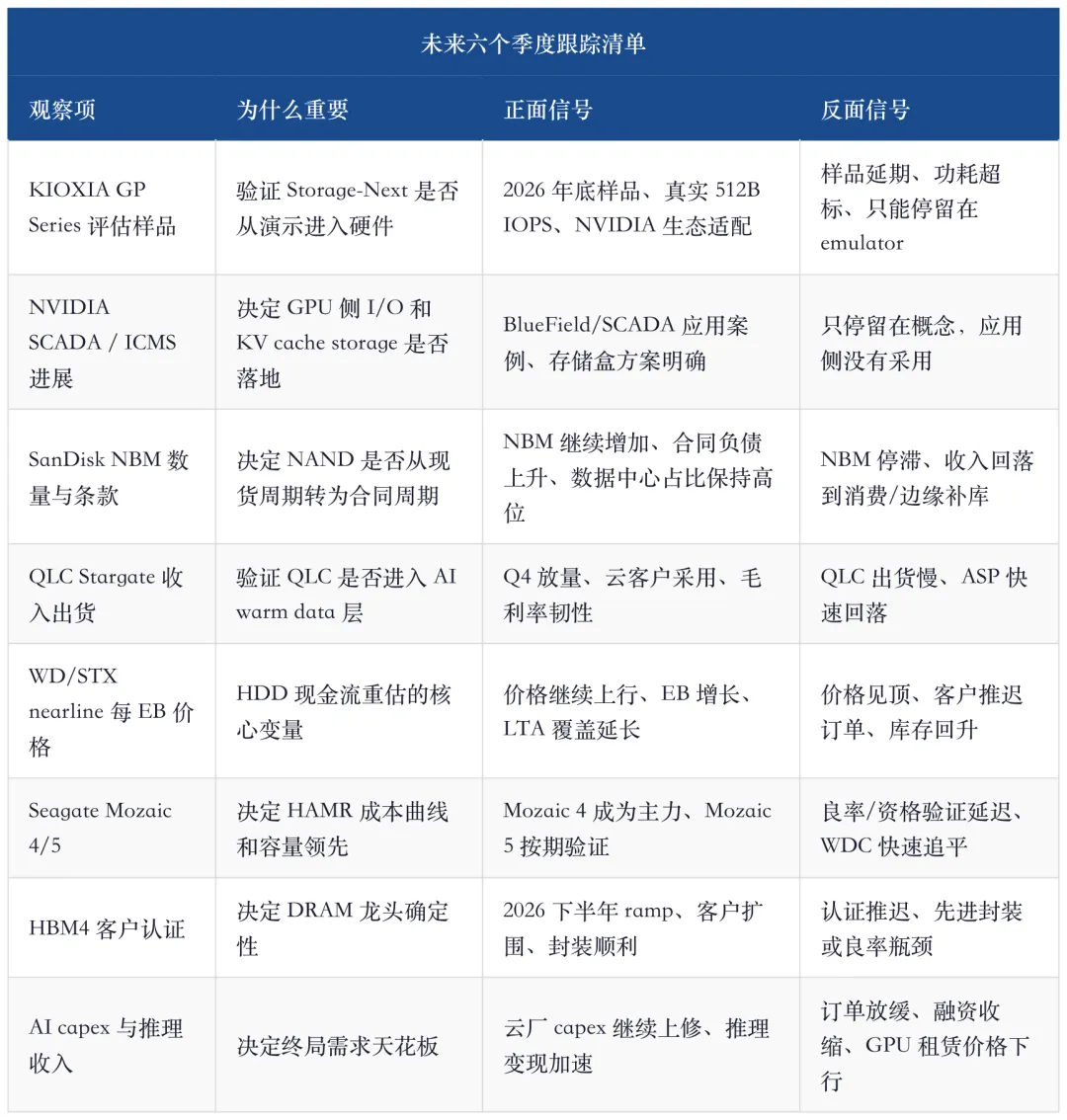

10、未来六个季度跟踪清单:Storage-Next 样品、NBM 合同、每 EB 价格、HBM4 认证

接下来六个季度,我会用下面这张清单判断存储技术栈重估是继续深化,还是进入估值兑现后的震荡。

这张清单的意义,是把存储从“涨价叙事”重新拉回“系统验证”。如果 Storage-Next 样品真实、NBM 扩张、QLC 放量、nearline 每 EB 价格继续上行、HAMR 成本下降、HBM4 顺利认证,那么 AI 存储重估还会从估值扩张走向盈利兑现。反过来,如果这些指标只剩 ASP 上涨,而没有技术和合同证据跟进,就要把仓位从结构性重估降回周期交易。

数据口径与来源

本文主要依据 KIOXIA《AI Impact On Storage》、SanDisk FY26 Q3 earnings deck、Western Digital FY26 Q3 results and earnings deck、Bernstein 关于 Seagate FQ3 FY26 的研究、BofA 关于 HDD 情景分析的研究,以及此前已发布的 AI 存储全行业重估、HDD 非周期化、SanDisk/Western Digital 财报深度解读等专题报告。

财务数据以公司披露口径和卖方研报口径为主;技术指标以 KIOXIA 演示材料中的 Storage-Next、GP Series、XL-FLASH、ICMS、PCIe 和高 IOPS emulator 信息为主。文中关于投资排序、技术分层和风险路径的判断,是在这些资料基础上的综合推演,不等同于任何单一机构观点。

夜雨聆风

夜雨聆风