AI 红队怎么做?8 家头部公司全公开了

AI 红队怎么做?8 家头部公司全公开了

最近被问得最多的一个问题:

“我们做了 5 年 Web 渗透,对 OWASP WSTG 那一套熟得很——目录、payload、scope、report 模板都有。现在客户要 AI 红队评估,问我们能交付什么。报告长什么样,字段是啥,跟传统渗透有什么区别。我们答不上来。”

这个问题没有简单答案。

AI 红队全球都在摸索。OWASP 的 GenAI Red Teaming Guide 是 2025 年 1 月才发布的。NIST AI 600-1 是 2024 年 7 月才出来。CSA 的 Agentic AI Red Teaming Guide 是 2025 年 5 月发布——距今约一年。

这不是因为做安全的不努力,是因为 AI 系统这个被测对象本身就在快速变形。一年前测的还是一个 Chat 接口,今年要测的是 Agent + RAG + MCP + 多工具调用。Web 渗透那种”端口扫描 + 应用扫描 + 漏洞验证 + 报告”的稳定流水线,在 AI 这边还没成型。

但好消息是——

国际几家头部团队已经把他们做 AI 红队的实战公开了。OpenAI、Anthropic、Microsoft、Mozilla、OWASP、NIST、CSA、Google。流程、字段、案例、工具、bounty 金额、报告格式,能查的都能查。

本文是把这 8 个公开实践抓回来做成一张地图。每节末尾都给一手源 URL,你可以自己去验。系统化学习AI与安全可以看这篇文章我整理的知识库不是越狱,是系统:我整理了一份 AI 安全知识库

我不卖方法论。我是观察员。

1. OpenAI Red Teaming Network — 4 个核心决策

OpenAI 公开了他们外部红队的标准做法。归结到 4 个决策项:

-

Scope:测什么、不测什么 -

Membership:哪些专家进队 -

Model access:红队能拿到模型的什么权限——黑盒 API 还是白盒、能不能 fine-tune、能不能拿 system prompt -

Final report 格式:交什么样的结构化报告 这 4 项决策定下来,整个评估的边界就清楚了。

测试方法他们分了两条腿:

-

人工 prompt:偏发现新风险、新场景。靠人在 sandbox 里反复试。 -

自动化 + classifier 评分:偏批量覆盖。生成几千条 payload,用分类器评分,再人工抽查高置信样本。 OpenAI 还发了一篇论文,标题《OpenAI’s Approach to External Red Teaming for AI Models and Systems》,把这套流程详细写了一遍。

对国内做 Web 安全的启示:

WSTG 里 Scope 是合同附件,AI 红队也一样。但多一项关键的——Model access。Web 渗透是黑盒还是白盒,影响的是发现深度。AI 红队 Model access 影响的是测试方法本身:黑盒只能 prompt 探测,白盒可以看 system prompt、看 fine-tune 数据、看 fallback 策略。这一项要单独写在合同里。

一手源:

-

https://openai.com/index/red-teaming-network/ -

https://cdn.openai.com/papers/openais-approach-to-external-red-teaming.pdf

2. Anthropic × Mozilla Firefox — 2 周扫 6000 个 C++ 文件

这是迄今为止最有说服力的 AI 辅助代码审计公开案例。

Anthropic 从 2025 年末启动,用 Claude Opus 4.6 给 Mozilla Firefox 做了一轮代码层红队,两周内完成。原文写的数字非常具体:

-

扫描了将近 6000 个 C++ 文件 -

提交 112 份独特报告 -

Mozilla 最终发出 22 个 CVE,其中 14 个高严重性 -

修复版本 Firefox 148 而且原文有一个细节非常关键——启动后仅 20 分钟,Claude 就识别出第一个漏洞。两周内发现 50+ 独特崩溃输入。

完整数据是 22 个安全相关 + 90 个其他 bug,Anthropic 都附了最小复现 case让 Mozilla 安全团队快速验证。

这不是 PR 稿。Mozilla 自己博客也发了,承认问题、感谢 Anthropic、列了修复版本号。两边数据完全对得上。

对国内做 Web 安全的启示:

两点。

第一,AI 辅助审计的产能已经到了”两周 6000 文件”这个量级。这意味着以后 Web 安全的代码审计交付逻辑会变。客户不会再接受”两周只看 200 个文件”了。

第二,报告必须配最小复现 case。这一条 Web 渗透其实已经是标准(PoC + 复现步骤),但很多团队做 AI 红队时退化成了”Prompt 截图”。Anthropic 的做法重新立标杆——每条 finding 给可独立验证的复现案例。

一手源:

-

https://red.anthropic.com/2026/firefox/ -

https://blog.mozilla.org/en/firefox/hardening-firefox-anthropic-red-team/

3. Microsoft AI Red Team + PyRIT — 6 件套乐高架构

Microsoft AIRT 团队用 PyRIT 跑了 100+ 次红队行动,覆盖 Copilot、Phi-3 等产品。

PyRIT 全名 Python Risk Identification Tool。官方架构是 6 个组件:

-

• Datasets:基础数据,含 prompts、jailbreak 模板、攻击策略 -

• Attacks:编排层,协调其他组件执行端到端攻击。支持 single-turn(Role Play / Skeleton Key)和 multi-turn(Crescendo / Tree of Attacks) -

• Converters:转换 prompts。文本改写、文档转换、图片叠加,可堆叠组合 -

• Targets:攻击目标,通常是 LLM -

• Scoring Engine:评估攻击结果 -

• Memory:追踪对话和分数,存 SQLite 或 Azure SQL 官方文档原话:

“As much as possible, each component is a Lego-brick of functionality.”

意思是每个组件像乐高积木一样可以替换组合。一个攻击的 prompt 可以喂给另一个攻击,一个场景下的攻击可以挂多个 targets,几乎每个组件都有”NoOp”(空操作)版本方便调试。

Microsoft 公开过一个真实案例:在某 Copilot 评估中,团队用 PyRIT 自动生成几千条对抗 prompt、跑 Scoring Engine 自动评分、人工审查阳性结果——几小时拿到的结果,传统人工方式要几周。

PyRIT 项目主仓在 https://github.com/microsoft/PyRIT。原本在 Azure 组织下,已迁移到 Microsoft 主组织(迁移完成时间为 2026 年 3 月)。

对国内做 Web 安全的启示:

这个最实用。PyRIT 是开源的,能直接用,不用自己造轮子。

而且 PyRIT 的架构思路对 Web 渗透也有借鉴——把”测试样本”“攻击编排”“结果评分””会话状态”这四件事拆开。Burp Suite 的 Intruder + Scanner 也是相似抽象,但 PyRIT 的 Lego 化更明显。

但自动化不能替代人工——PyRIT 团队自己在文档里反复强调这一点。看着热闹的几千条结果,最后能进 finding 的可能只有几条。这套评估流水线是帮人定位热点,不是让脚本决定最终风险。

一手源:

-

• https://github.com/microsoft/PyRIT -

• https://microsoft.github.io/PyRIT/code/framework

4. Mozilla 0Din — 独立的 GenAI Bug Bounty

很多人会把 0Din 和 HackerOne 搞混。两件事。

0Din 全名 0Day Investigative Network,是 Mozilla 自己运营的 GenAI Bug Bounty 平台,独立于 HackerOne。Mozilla 在 HackerOne 上也有传统 bug bounty 项目,但 0Din 是单独的 GenAI 专项。

Bounty 金额很清楚:

-

• Low:≤ $500 -

• Medium:≤ $2,500 -

• High:≤ $5,000 -

• Severe:≤ $15,000 范围三类(很关键):

-

• Guardrail jailbreak:绕过模型安全护栏 -

• Prompt injection:通过外部输入劫持模型行为 -

• Training data leakage:从模型输出反向提取训练数据 提交流程分两阶段——这是国内 Web 安全做 Bug Bounty 时也能借鉴的设计:

-

1. 第一阶段:High-level abstract。研究员先提交风险类别 + 受影响模型,3 工作日内Mozilla 回 scope 评估和 bounty 范围 -

2. 第二阶段:完整技术细节。含 PoC、复现步骤、impact 分析。2 周保密期内双方复测 这个流程对甲方乙方都是保护:研究员先验证”这个范围是不是已经在做了”再投精力,Mozilla 先评估”这个有没有 bounty 价值”再要技术细节。

Mozilla 还在 0Din 旗下开源了 179 个 security probes,覆盖 35 个漏洞家族——可以直接用作 payload set 起点。

对国内做 Web 安全的启示:

两阶段提交这个设计可以直接学。国内乙方做 AI 红队评估,跟客户对接经常一上来就发完整技术细节,结果客户不接受这个 scope,技术细节白写。两阶段流程让 scope 先对齐再投资源。

一手源:

-

• https://0din.ai/ -

• https://github.com/0din-ai/0din.ai

5. OWASP GenAI Red Teaming Guide — 4 个核心领域

OWASP GenAI 项目组在 2025 年 1 月 22 日发布了官方的 GenAI Red Teaming Guide。

这是目前对 AI 红队最权威的开源框架。覆盖 4 个核心领域:

-

• Model evaluation:模型评估。测对齐、测越狱、测幻觉、测 bias -

• Implementation testing:实施测试。测 prompt 工程、测 RAG、测 function calling、测输出处理 -

• Infrastructure assessment:基础设施评估。测部署架构、测 API 安全、测数据流、测权限 -

• Runtime behavior analysis:运行时行为分析。测真实流量下的 Agent 链路、tool 调用、memory 使用 OWASP 还有一份 OWASP Top 10 for LLM Applications,把 LLM 应用层的 10 大风险标准化:

-

• LLM01 Prompt Injection -

• LLM02 Insecure Output Handling -

• LLM03 Training Data Poisoning -

• LLM04 Model Denial of Service -

• LLM05 Supply Chain Vulnerabilities -

• LLM06 Sensitive Information Disclosure -

• LLM07 Insecure Plugin Design -

• LLM08 Excessive Agency -

• LLM09 Overreliance -

• LLM10 Model Theft 这份 Top 10 是 AI 红队报告里”风险类别”那一栏可以直接对齐的标准。

对国内做 Web 安全的启示:

OWASP Top 10 for LLM 之于 AI 红队,相当于 OWASP Top 10 之于 Web 渗透。报告里每条 finding 直接标注 LLM01-10 类别,客户和复测方都能秒懂。

不要自己发明风险分类。

一手源:

-

• https://genai.owasp.org/resource/genai-red-teaming-guide/ -

• https://genai.owasp.org/llm-top-10/

6. NIST AI 600-1 — Generative AI Profile

NIST AI 600-1 全名 Artificial Intelligence Risk Management Framework: Generative Artificial Intelligence Profile,2024 年 7 月 26 日正式发布。

这份文档是 NIST AI RMF 1.0 的配套生命周期 Profile,专门处理生成式 AI 的风险管理。它响应的是美国 Biden 政府的 Executive Order 14110(2023 年 10 月签署的 AI 安全行政令)。

文档把生成式 AI 风险拆成 12 类,每类给评估目标 + 控制建议。例子:

-

• 数据投毒(Data poisoning) -

• 幻觉(Hallucinations) -

• CBRN 信息可达(CBRN information access — 化学 / 生物 / 放射 / 核相关有害信息) -

• 有害内容(Harmful content) -

• 数据隐私违规(Data privacy violations) 这 12 类风险映射到 AI RMF 的 7 个 Trustworthy AI 特性:Safe / Explainable / Fair / Accountable / Privacy Enhanced / Secure / Valid and Reliable。

每类风险的建议动作(suggested actions)映射到 AI RMF 的 4 个核心 Function:

-

• GV (Govern) — 治理 -

• MP (Map) — 映射 -

• MS (Measure) — 测量 -

• MG (Manage) — 管理 也就是说,红队报告里你写”XX 风险对应 NIST AI 600-1 的 GV-1.2 / MP-2.3 / MS-3.4 / MG-1.1″这种引用,客户的合规和审计团队会立刻明白说的是 RMF 哪一块。

NIST 的视角更偏治理 / 合规——不只看技术漏洞,还看组织流程、文档要求、责任分配。

对国内做 Web 安全的启示:

国内合规层面有 GB/T 系列标准,但生成式 AI 专项还在跟进。NIST 600-1 的 12 类风险分类、7 个 Trustworthy 特性、4 个 RMF Function 编号可以作为客户报告里”国际对标”那一段的内容。

不要在客户面前只引用 OWASP(偏技术)或者只引用国内标准(合规但可能不全)——OWASP + NIST 合用最稳。

一手源:

-

• https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.600-1.pdf -

• https://www.nist.gov/itl/ai-risk-management-framework

7. CSA Agentic AI Red Teaming Guide — 12 类 Agent 威胁完整清单

CSA(Cloud Security Alliance)和 OWASP 联合,在 2025 年 5 月 28 日发布了 Agentic AI Red Teaming Guide,50+ 贡献者。

这份文档解决的是上面所有框架都没完全覆盖的问题——Agent 的红队怎么做。

12 类 Agent 威胁(按公开报道整理的完整列表):

-

1. Agent authorization and control hijacking(Agent 授权与控制劫持)— 利用权限层和自主 Agent 之间的缝隙 -

2. Checker-out-of-the-loop(审核者脱环)— 绕过人在回路的审批 -

3. Agent critical system interaction(Agent 与关键系统交互)— Agent 与生产关键系统的不安全交互 -

4. Goal and instruction manipulation(目标和指令操纵)— 篡改 Agent 的核心目标 / 指令链 -

5. Agent hallucination exploitation(Agent 幻觉利用)— 利用幻觉输出作攻击 -

6. Agent impact chain and blast radius(影响链和爆炸半径)— Agent 行动的连锁影响 -

7. Agent knowledge base poisoning(Agent 知识库投毒)— 污染 Agent 的检索/参考库 -

8. Agent memory and context manipulation(Agent 记忆和上下文操纵)— 持久记忆被污染或滥用 -

9. Multi-agent exploitation(多 Agent 利用)— 多个 Agent 间的合谋或互相利用 -

10. Resource and service exhaustion(资源和服务耗尽)— Agent 耗尽算力 / API 配额 -

11. Supply chain and dependency attacks(供应链和依赖攻击)— 模型 / 工具 / 数据集供应链投毒 -

12. Agent untraceability(Agent 不可追溯)— Agent 行为不可审计 每类都给了测试方法、攻击向量、示例 prompt、deliverables。

CSA 的指南还推荐了几个 Agent 专用工具——MAESTRO、Promptfoo 的 LLM Security DB、SplxAI 的 Agentic Radar、Salesforce FuzzAI、Microsoft Foundry red teaming agents。

对国内做 Web 安全的启示:

如果你客户的系统是 Agent + 多工具调用(不是单纯 Chat),传统 Web 渗透那套思路(看接口、看权限、看输入验证)会漏掉一大块——多 Agent 合谋、跨 Agent context 污染、知识库投毒、影响链溢出,都不在传统模型里。

而且 CSA 这套分类比 OWASP Top 10 for LLM 更细——Top 10 是 LLM 应用层级,CSA 12 类是 Agent 系统级。两者不冲突,互补:单 LLM 应用对齐 OWASP Top 10,Agent 系统额外对齐 CSA 12 类。

一手源:

-

• https://cloudsecurityalliance.org/artifacts/agentic-ai-red-teaming-guide

8. Google SAIF — Secure AI Framework

Google 在 2023 年 6 月发布的 Secure AI Framework (SAIF),是工业界最早把 AI 安全从”研究问题”提到”工程框架”层面的尝试之一。

SAIF 不是红队指南,是一份端到端的 AI 安全工程框架——覆盖数据、模型训练、部署、监控、事件响应整条链路。Google 的逻辑是:AI 系统的安全要从开发流水线的每一步设计,红队是其中一个环节,不是孤立的活动。

SAIF 提了 6 大要素(核心元素):

-

• 把强大的安全基础扩展到 AI 生态 -

• 把 AI 检测和响应纳入组织的现有安全运营 -

• 自动化防御应对存量和新型威胁 -

• 协调平台级控制以实现整体一致性 -

• 调整控制以加快 AI 部署的反馈循环 -

• 把 AI 系统风险纳入更广的业务流程 Google 还有一份单独的 AI Red Team 介绍(不是 SAIF 本身),把红队作为模型发布前的质量保证流程的一部分写出来。

对国内做 Web 安全的启示:

最大的启示是定位——AI 红队评估不应该被当作”渗透测试外包项目”对外卖。它是客户 AI 系统安全保证流水线的一环。

把交付物对接到客户的 CI/CD 门禁、对接到他们的 SIEM 告警规则、对接到他们的 incident response 流程——比单纯交一份 PDF 报告值钱多了。

一手源:

-

• https://safety.google/intl/en/cybersecurity-advancements/saif/ -

• https://blog.google/technology/safety-security/introducing-googles-secure-ai-framework/

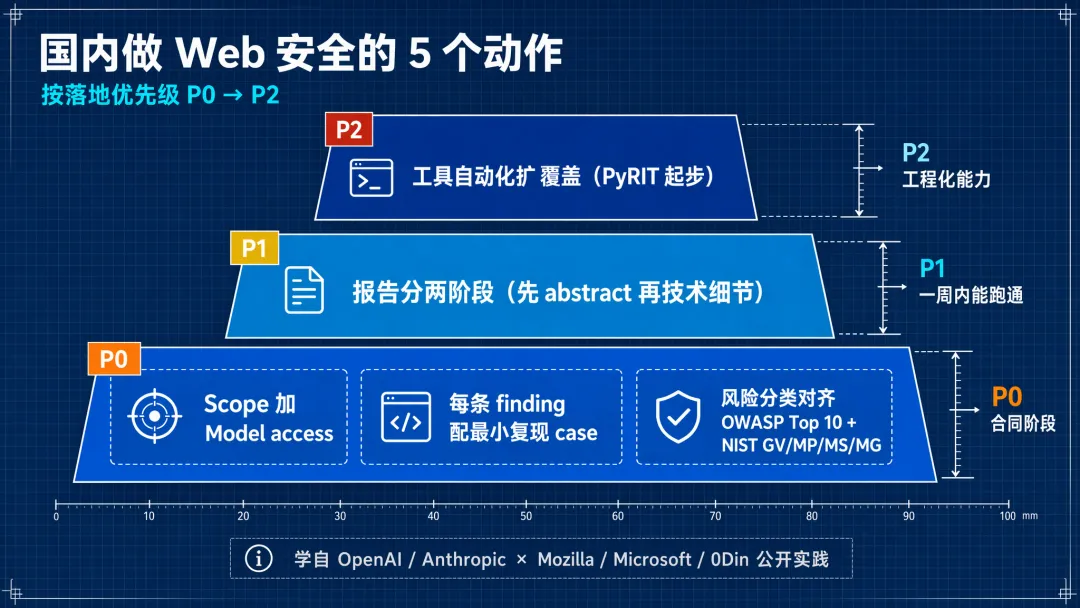

国内做 Web 安全的,能直接学的 5 个动作(按落地优先级)

抓完这 8 个公开实践,回到最初的问题——客户问”AI 红队报告长什么样、字段是啥”,你能给的答案不是再造一份 5 步模板,而是这 5 个具体动作。按上手难度从易到难:

P0(合同阶段就能落地):Scope 写在合同附件,多一项 Model access

Scope 沿用 WSTG 的标准段落,但加一项 Web 渗透没有的——Model access 权限。黑盒 API、白盒 system prompt、能否 fine-tune、能否拿 fallback 策略。这一项不写清楚,后续测试方法就乱了。这是 OpenAI 4 决策模型的核心。

P0(每条 finding 都能落地):每条 finding 配最小复现 case

不要交 prompt 截图。交”输入 X → 在 Y 环境下执行 Z → 输出 W”的最小可复现脚本。让客户安全团队自己能跑一遍。这是 Web 渗透的标准动作,AI 红队不能退化。学 Anthropic × Mozilla 的复现 case 文化。

P0(报告章节就能加):风险分类对齐 OWASP Top 10 for LLM + NIST 600-1

不要自己发明风险分类。每条 finding 标注 LLM01-10 类别 + NIST 600-1 的 GV/MP/MS/MG 编号。客户技术团队和合规团队都能看懂。Agent 系统额外对齐 CSA 12 类。

P1(一周内能跑通):报告分两阶段,先 abstract 再技术细节

先给客户 high-level 风险类别 + 影响范围,等客户确认 scope 和优先级再投精力做技术细节。避免一次性把完整技术细节交出去结果客户不认 scope。学 Mozilla 0Din 的 2 阶段提交。

P2(有工程化能力的团队再上):工具自动化扩覆盖,但人工判断决定 finding

PyRIT 是开源现成的,直接用。Burp Intruder 那种思路在 AI 红队对应到 PyRIT 的 Attacks + Converters。但要记住——自动化跑出几千条结果,最后能进 finding 的可能只有几条。学 Microsoft 的 Lego 架构。这一步是产能放大器,但不是必需。

写在收尾

国内做 Web 安全的同行问”AI 红队怎么交付”——这个问题没有简单答案,但好消息是不需要自己摸索。

OpenAI、Anthropic、Microsoft、Mozilla、OWASP、NIST、CSA、Google 这 8 个公开实践已经给出了绝大部分答案。剩下的是你针对客户实际场景的工程化定制。

不要假装自己是标准制定者。当观察员、当对照师、当流程整合者,就够了。

这 8 个一手源 URL 全部能直接访问。建议关注公众号 AI 安全工坊,回复「AI 红队全球地图」拿到完整 URL 收藏卡(含上面所有链接 + 几个延伸阅读,整理成一页 PDF)。

知识星球持续更新 AI 安全前沿、公开报告解读、工具实战(59.9 元 / 年)。

事实声明:

本文所有数据均来自国际公开一手源,已逐一在文中给出 URL。读者可自行验证。本文不代表任何机构立场,仅为公开实践地图整理。

夜雨聆风

夜雨聆风