Ollama:开启本地AI新纪元

今天我们来探讨一个正在悄然改变我们与AI交互方式的强大工具——Ollama(发音:/əʊˈlɑːmə/(近似 “哦 – 拉 – 马”) 原意:是Llama(羊驼,Meta 开源模型)的变体,把首字母 L 改成 O,寓意 “Open + Llama”,主打开源、本地运行。 图标:一只卡通羊驼)。在云计算和大型中心化AI模型主导的今天,一个新的趋势正在兴起:将强大的AI能力带回我们自己的设备。Ollama正是这一趋势的引领者,它让在个人电脑上一键运行大语言模型成为现实。本次分享将深入解析Ollama是什么,它如何工作,以及它将为我们的工作和生活带来怎样的变革。

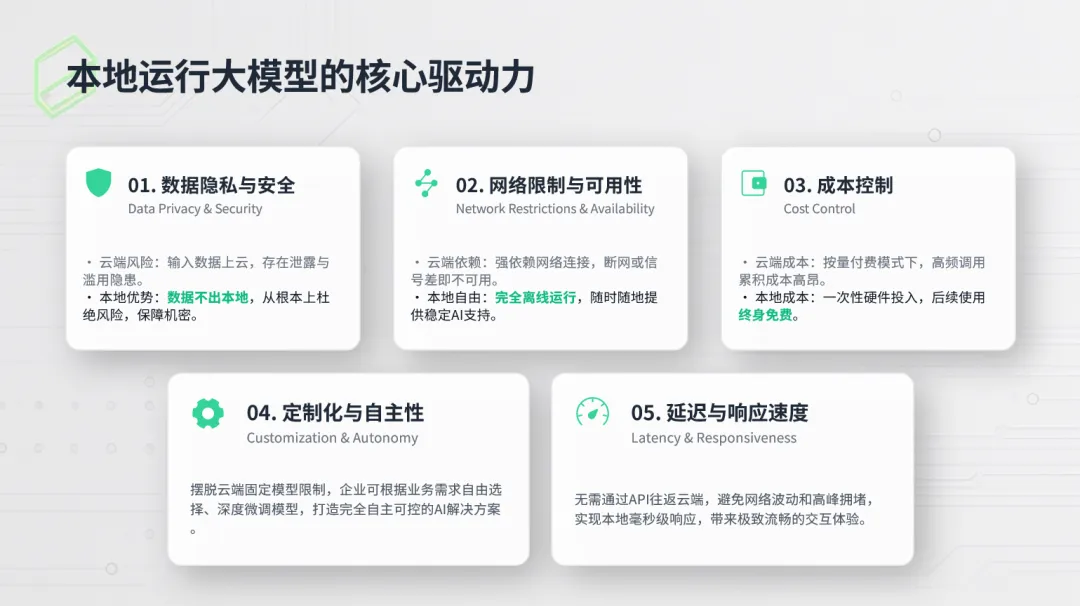

在深入了解Ollama之前,我们首先需要回答一个问题:为什么我们要舍近求远,放弃方便快捷的云端AI服务,转而在本地运行大模型?这背后其实是由一系列核心痛点驱动的。

本地运行大模型主要有五大驱动力。首先是数据隐私与安全,所有数据都保留在本地,彻底杜绝云端泄露风险。其次是摆脱网络限制,实现离线自由。第三是成本控制,一次性硬件投入后即可免费使用。第四是高度的定制化与自主性,用户可以完全掌控模型。最后是极低的延迟,带来流畅的交互体验。

那么,究竟什么是Ollama?它又是如何解决本地部署大模型的痛点的呢?接下来,我们将深入了解这个被誉为“LLM界的Docker”的强大工具。

Ollama是一个开源的本地大模型运行和管理工具。你可以把它理解为大模型领域的Docker,它将复杂的模型和环境打包,让用户可以通过简单的命令轻松管理。它的名字来源于羊驼模型Llama,寓意开源和本地。在Ollama出现之前,本地部署模型非常困难,而Ollama通过一键安装、自动管理模型、极简命令行等方式,彻底解决了这些痛点。

Ollama的工作原理非常清晰,其设计哲学深受Docker的启发,极大地降低了大模型的使用门槛。

整个过程分为四个核心步骤:

-

1. 模型打包与分发:开发者通过Modelfile像写Dockerfile一样定义模型,构建后发布到OllamaHub,方便共享。

-

2. 模型拉取与加载:用户只需要一条pull命令,就能把模型像Docker镜像一样拉取到本地。

-

3. 推理服务启动:一条run命令,后台自动启动服务并加载模型,屏蔽了复杂的底层硬件适配。

-

4. 交互与推理:最后,无论是通过命令行快速测试,还是通过API深度集成到业务系统,都非常简单。右侧的架构图直观地展示了这一整套流程的逻辑闭环。

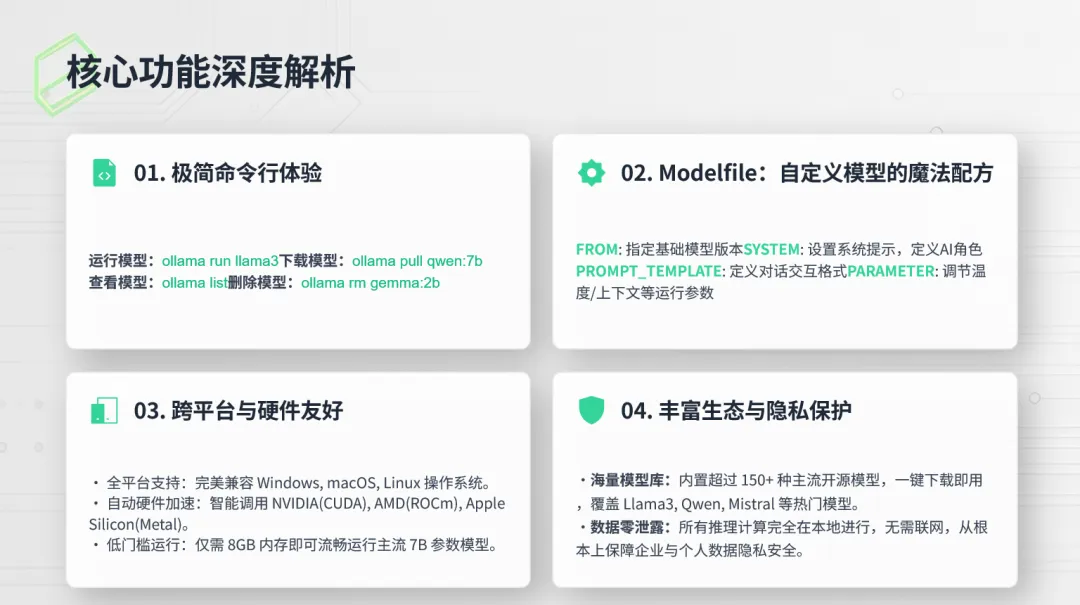

了解了Ollama的基本概念后,我们来深入看看它的核心功能。正是这些功能,让Ollama变得如此强大和易用。

Ollama的核心功能非常强大。

首先是极简的命令行,让模型的运行、下载、管理变得轻而易举。

其次是Modelfile,它像一个魔法配方,允许用户深度定制模型的行为。此外,Ollama跨平台且对硬件友好,能自动利用GPU加速,并且对硬件要求不高。

最后,它拥有丰富的模型生态和完全的隐私保护,让用户可以放心使用。

Ollama的强大之处在于其对丰富模型生态的支持。接下来,我们将介绍几个在Ollama上可以轻松运行的热门开源模型。

Ollama支持超过150种模型,这里列举几个热门的。比如Meta的Llama 3,是综合性能的标杆;阿里巴巴的通义千问,中文能力非常出色;Google的Gemma,安全可靠;还有能理解图片的LLaVA,专业的代码生成模型DeepSeek Coder,以及小而强大的微软Phi-3。无论你的需求是什么,几乎都能找到合适的模型。

强大的工具需要有丰富的应用场景。Ollama的灵活性使其适用于广泛的用户群体,从开发者到普通用户,都能从中获益。无论是在智能制造领域优化产线流程、在金融领域提升风控能力,还是在医疗和零售行业改善服务体验,Ollama都能作为底层的AI引擎,赋能各行各业,帮助企业和个人重塑业务价值,释放更多潜能。接下来,让我们看看具体的应用场景。

对于开发者来说,Ollama是本地开发调试和私有化部署的利器。设计师可以用它来激发创意、生成文案。研究人员可以利用它来辅助文献综述和论文写作,同时保护数据隐私。对于普通用户,Ollama可以成为一个私人知识库、写作伴侣或学习助手。它的应用场景非常广泛。

那么,Ollama这种本地部署方案,和我们常用的云API服务相比,究竟有哪些优劣呢?接下来我们进行一个详细的对比分析。

这张页面详细对比了Ollama和云 API 服务的核心差异,旨在帮助大家根据实际场景做出选择。

左边是Ollama的本地部署方案,它最大的亮点在于“掌控力”。数据完全在本地闭环处理,解决了企业最担心的隐私合规问题。同时,一次性投入硬件成本后,即可免费无限次使用,且完全不需要网络,适合对延迟敏感或网络环境受限的场景。此外,它支持丰富的开源模型和深度定制,适合技术团队进行二次开发。

右边是OpenAI等厂商提供的云 API 服务,它的关键词是“省心”和“极致”。依托于云端庞大的 GPU 集群,它能提供Ollama无法比拟的推理速度和并发处理能力,且无需维护底层硬件,开箱即用。但代价是,数据需要上传云端,且长期使用成本不可控。

总结来说,如果您把数据安全和长期成本放在首位,Ollama是更好的选择;如果您追求极致的性能和极低的运维门槛,云 API 服务则更合适。

最后,让我们一起展望Ollama所代表的未来。它不仅仅是一个工具,更预示着AI发展的一个重要方向——去中心化。

Ollama的出现,推动了AI的民主化,让每个人都能掌握强大的AI能力。围绕它的生态系统正在繁荣,包括更多的前端界面和应用集成。它还将推动边缘计算的发展,并重塑未来AI应用的开发模式,形成“本地+云端”的混合架构。我们正站在一个更加开放、隐私和自主的AI未来的黎明。

记得给我点个赞+在看

记得给我点个赞+在看

也欢迎把这篇文章分享给你的朋友们

也欢迎把这篇文章分享给你的朋友们

夜雨聆风

夜雨聆风