欧盟AI法案将AI系统的风险根据风险等级分成了四类(不可接受风险、高风险、有限风险、最小风险),上一篇我们分析了禁止类的AI类别,本文主要聚焦高风险AI。再温习下四种类别,见下表:

类别 | 风险等级 | 监管态度 | 核心义务 | 典型例子 |

不可接受风险 | 最高 | 禁止 | 完全禁止 | 社会评分、操控、公共场所实时人脸识别 |

高风险 | 高 | 严格合规 | 7 大强制义务 | 医疗AI、招聘AI、信贷AI、教育AI |

有限风险 | 中 | 透明标注 | 告知是AI、标注生成内容 | 聊天机器人、AI 画图 |

最小风险 | 最低 | 自由+ 自律 | 无强制义务 | 游戏 AI、垃圾邮件过滤、娱乐推荐 |

问题33:什么是高风险AI系统?

1、法律依据:Article 6;Recitals 46–53;Annex I(产品类)、Annex III(独立类)

2、法律分析

满足任一即为高风险AI:

(1)产品类:属于欧盟协调法产品(Annex I),且AI 是产品本身/安全组件,需第三方合格评定。

(2)独立类:属于Annex III 8大关键场景的standalone AI系统。

【思考延伸】为什么要分成两类来监管?

因为欧盟AI 法案继承了产品安全法逻辑,同时要覆盖纯软件、纯服务类AI,所以必须分成两类,监管逻辑、责任主体完全不同。

(1)产品类(Annex I):管“带AI 的硬件设备”

来源:欧盟传统产品安全法(机械、医疗、电梯、玩具等)

逻辑:设备本来就要强制安全认证,AI是设备的安全组件

目的:防止AI 故障伤到人、危及健康安全

(2)独立关键场景类(Annex III):管“纯AI 软件/服务”

来源:AI法案新增

逻辑:没有实体产品,但AI 直接决定人生大事、基本权利

目的:防止AI 侵犯公平、隐私、尊严、机会(就业、教育、信贷、司法等)

3、典型场景

(1)医疗设备里的AI 诊断、AI 电梯控制、AI 玩具安全监测(产品类)

(2)AI招聘筛选、AI 信贷评分、AI 人脸识别、AI 司法辅助(独立类)

4、实务合规指南

(1)先做高风险分类判定,再启动合规开发;

(2)境外企业向欧盟提供同样认定为高风险;

(3)禁止类AI不属于高风险,而是直接禁止。

问题34:哪些产品属于高风险AI?

1、法律依据:Article 6(1)、Annex I;New Legislative Framework(NLF)

2、法律分析

产品满足两个条件即高风险:

(1)属于Annex I 欧盟协调法产品清单

(2)AI是产品本身或安全组件,且需第三方合格评定

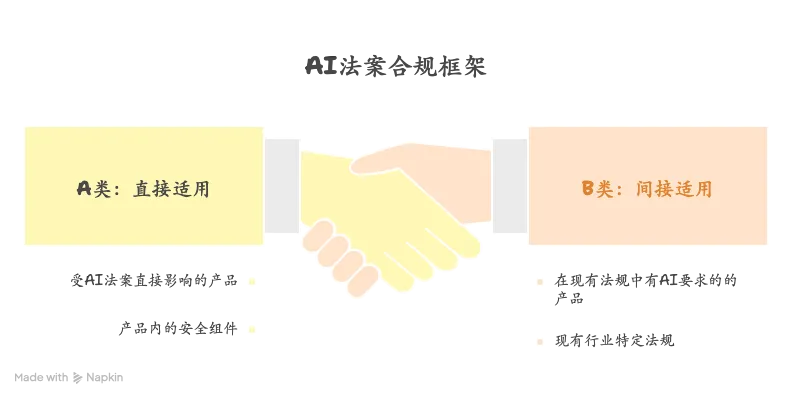

分为A 类(直接适用AI 法案) 和B 类(间接适用):

A类:机械、玩具、电梯、医疗设备、压力容器、个人防护装备等;

B类:汽车、飞机、铁路、船舶、农用机械等。

【思考延伸】A类、B类的法律适用区别

3、典型场景

带AI 安全控制的电梯、带AI 诊断的CT 设备、带AI 辅助驾驶的汽车;其前两者是属于A类,由AI法案直接管,最后一个是属于B类,走行业法间接管。

4、实务合规指南

(1)产品制造商直接视为AI 提供者,承担全部合规义务;

(2)即使采用协调标准自我声明,仍属于高风险;

(3)安全组件故障会危及人身安全→ 一律高风险。

问题35:独立高风险AI场景有哪些(8大类)?

(一)类别1:生物识别类AI

1、法律依据:Annex III No.1、Article 3(34)(35)(36)(41)

2、法律分析

三类高风险:

(1)远程生物识别(1:N)

(2)生物特征归类(推断敏感属性)

(3)情绪识别

注:1:1验证(如手机解锁)不属于高风险

3、典型场景

公共场所远距离人脸识别、AI通过面部推断情绪/种族。

4、实务合规指南

(1)1:1验证可排除高风险;

(2)生物识别数据按GDPR 特殊类别数据保护;

(3)禁止类生物识别不得按高风险合规,必须直接禁用。

(二)类别2:关键基础设施类AI

1、法律依据:Annex III No.2、CER Directive

2、法律分析

用于水、电、气、热、交通、关键数字设施的安全组件AI

3、典型场景

AI电网调度、AI 燃气管道监控、AI 交通信号控制→ 高风险

4、实务合规指南

(1)必须保障物理安全、人身安全;

(2)高冗余、高可用、强制人工干预。

(三)类别3:教育与职业教育AI

1、法律依据:Annex III No.3

2、法律分析

用于:

(1)入学/录取/分班;

(2)学习成果评估、考试监测;

(3)教育水平判定。

3、典型场景

AI阅卷、AI 面试招生、AI 考试防作弊

4、实务合规指南

(1)禁止完全自动化决策,必须人工复核;

(2)算法透明、无歧视、可解释。

(四)类别4:就业与人力资源管理AI

1、法律依据:Annex III No.4

2、法律分析

用于:

(1)招聘、筛选、简历过滤;

(2)晋升、解雇、任务分配;

(3)员工监控、绩效评估。

3、典型场景

AI简历筛选、AI 面试、AI 员工监控

4、实务合规指南

(1)禁止暗模式、心理操控、歧视;

(2)员工有权获知AI 评估依据。

(五)类别五:基本服务获取AI

1、法律依据:Annex III No.5

2、法律分析

用于:

(1)社会福利、医保资格判定;

(2)个人信用评分、保险定价;

(3)紧急呼叫、急救派遣、分诊。

3、典型场景

AI信贷评分、AI 医保审核、AI 急救调度

4、实务合规指南

(1)信用评分仅限风险相关数据

(2)禁止使用无关特征(居住地、姓名等)

(六)类别6:执法AI

1、法律依据:Annex III No.6、Article 3(45)(46)

2、法律分析

用于:

(1)受害人风险评估、测谎类工具;

(2)证据可靠性评估、再犯风险评估;

(3)犯罪画像(非纯画像)。

3、典型场景

AI辅助刑侦、AI 证据分析、AI 再犯评估→ 高风险

4、实务合规指南

(1)纯画像预测犯罪属于禁止,仅允许基于事实的AI 辅助;

(2)必须人工复核、程序正当。

(七)类别7:移民、庇护、边境管理AI

1、法律依据:Annex III No.7

2、法律分析

用于:

(1)测谎类工具;

(2)入境风险评估;

(3)签证/庇护申请审核;

(4)身份识别。

3、典型场景

AI庇护申请评估、AI 边境安检

4、实务合规指南

(1)保护弱势群体,保障基本权利;

(2)决策可解释、可申诉。

(八)类型8:司法与民主程序AI

1、法律依据:Annex III No.8

2、法律分析

用于:

(1)司法辅助、事实认定、法律适用;

(2)选举/公投行为干预、精准竞选推送;

(3)纯行政辅助、数据整理不属于高风险。

3、典型场景

AI判决辅助、AI 选举精准推送。

4、实务合规指南

(1)不得损害司法独立、选举公正;

(2)禁止操纵投票行为。

问题36:关键场景是否可被修订?

1、法律依据:Article 7

2、法律分析

欧盟可新增/ 删除Annex III 场景,标准为:

(1)对健康、安全、基本权利的风险程度;

(2)数据敏感性、自主性、权力不平衡性、可逆性。

3、典型场景

未来新增深度伪造治理、大模型风险等场景

4、实务合规指南

(1)持续关注欧盟指南更新;

(2)产品设计预留适配空间。

问题37:哪些关键场景AI不属于高风险?

1、法律依据:Article 6(3)、Recital 53

2、法律分析

满足任一即排除高风险:

(1)仅执行狭窄程序任务(归档、去重、格式转换);

(2)仅优化人类既有成果(润色、格式调整);

(3)仅检测偏差,不替代决策;

(4)仅做评估前准备工作(卷宗整理、翻译、检索)。

核心:不实质性影响最终决策

3、典型场景

AI整理法院文书、AI 翻译法律文本、AI 校对分数

4、实务合规指南

(1)保留人工决策主导,AI仅辅助;

(2)产品设计上清晰隔离“辅助”与“决策”。

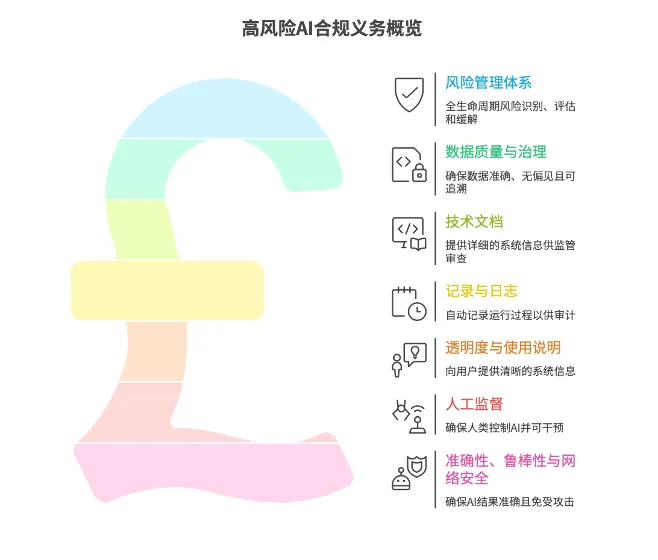

问题38:高风险AI系统必须满足的7大合规义务?

(一)合规义务1:建立风险管理体系(最核心)

1、法律依据:Article 9、Recital 65

2、法律分析

(1)全生命周期持续运行;

(2)覆盖预定用途+ 合理可预见误用;

(3)识别→评估→缓解→接受残余风险;

(4)形成文档、纳入质量管理体系;

3、典型场景

AI招聘系统需评估:歧视风险、错误筛选风险、隐私风险。

4、实务合规指南

(1)上线前风险测试;

(2)上市后持续监控、更新风险措施;

(3)留存全生命周期记录。

(二)合规义务2:数据质量与数据治理

1、法律依据:Article 10、Recital 67–69

2、法律分析

训练/ 验证/ 测试数据必须:

(1)相关、完整、代表性、低错误;

(2)无歧视、无偏见;

(3)来源可追溯、处理可审计;

(4)符合GDPR。

3、典型场景

训练数据性别失衡→ AI 招聘歧视→ 不合规

4、实务合规指南

(1)做数据偏见审计;

(2)建立数据溯源台账;

(3)防止数据投毒、数据漂移。

(三)合规义务3:技术文档

1、法律依据:Article 11

2、法律分析

(1)上市前完成;

(2)监管可随时调取;

(3)保留10年;

(4)覆盖架构、数据、风险、测试、合规。

3、典型场景

高风险AI 必须提供:算法说明、数据清单、风险评估、测试报告。

4、实务合规指南

(1)技术文档随产品迭代更新;

(2)按欧盟监管模板编制。

(四)合规义务4:记录与日志(自动日志)

1、法律依据:Article 12

2、法律分析

(1)自动记录运行过程

(2)可追溯、可审计

(3)用于事故调查、合规证明

3、典型场景

AI信贷审批每一次调用、输入、输出、结果均留痕。

4、实务合规指南

(1)日志不可篡改;

(2)保存期限满足监管要求。

(五)合规义务5:透明度与使用说明

1、法律依据:Article 13、Recital 72

2、法律分析

向部署者提供:

(1)用途、限制、风险;

(2)使用方法、注意事项;

(3)透明度信息(AI特性、偏差风险)。

3、典型场景

AI简历筛选需告知用户:AI 仅辅助、不可单独决策。

4、实务合规指南

(1)使用说明通俗、清晰、无歧义;

(2)显著提示AI 能力边界。

(六)合规义务6:人工监督

1、法律依据

Article 14、Recital 73

2、法律分析

(1)确保人控制AI,不是AI 控制人;

(2)可打断、可覆盖、可干预;

(3)监督人员具备资质与培训。

3、典型场景

AI初审贷款→ 人工终审、可推翻AI 结果

4、实务合规指南

(1)设计一键停止、人工override机制;

(2)禁止无人监督全自动决策。

(七)合规义务7:准确性、鲁棒性、网络安全

1、法律依据:Article 15、Recital 74–78

2、法律分析

(1)结果准确、一致;

(2)抗攻击、抗干扰、抗操纵;

(3)满足网络安全标准(Cyber Resilience Act)。

3、典型场景

对抗样本攻击导致AI 误识别→ 不合规

4、实务合规指南

(1)做对抗性测试、压力测试;

(2)实施安全开发、漏洞管理。

总结

1、高风险AI 分两类:产品类(Annex I)+ 独立关键场景类(Annex III 8 大领域)。

2、辅助性AI不认定高风险,仅实质性影响决策的AI 才纳入。

3、高风险AI 必须满足7 项强制义务:风险管理、数据治理、技术文档、日志、透明度、人工监督、安全鲁棒性。

4、全生命周期合规:设计→开发→上线→上市后监控→退市。

5、境外企业向欧盟提供高风险AI,完全适用本文规定,无豁免。

夜雨聆风

夜雨聆风