AI 取代 80% 编码工作?掌握这 7 项能力,才是未来十年的核心竞争力

2025 年的行业数据揭示了一个出人意料的事实:AI 并未取代软件工程师,反而推动了这个职业的升级。

过去几年,软件工程领域发生了耐人寻味的变化。企业引入 AI 加速代码生成,成效显著 ——AI 编写代码的速度远超人类。但没人预料到,2025 年《软件工程领域 AI 应用现状报告》显示,72% 的企业曾遭遇由 AI 生成代码漏洞直接引发的生产事故。

这份报告印证了一个关键趋势:软件工程并未走向终结,而是迎来进化。代码语法的编写正在被自动化,但设计、维护高可靠性系统的工程核心能力,始终无法被 AI 替代。以下 7 项能力,将决定未来十年软件工程从业者的职业发展高度。

一、架构推理与系统设计能力

当前的 AI 模型本质是概率引擎,仅能通过模式匹配模拟推理过程。2025 年的研究证实,AI 缺乏对因果关系的真正理解:它能识别训练数据中频繁出现的决策模式,却无法厘清决策背后的深层逻辑。

若要求 AI 设计分布式支付系统,它大概率会推荐主流的微服务架构 —— 只因这类模式在训练数据中占比最高。但它无法考量现实场景中的约束条件:比如数据本地化的监管要求可能让标准架构违规,或是遗留大型机的依赖关系会导致拟定的延迟指标无法实现。

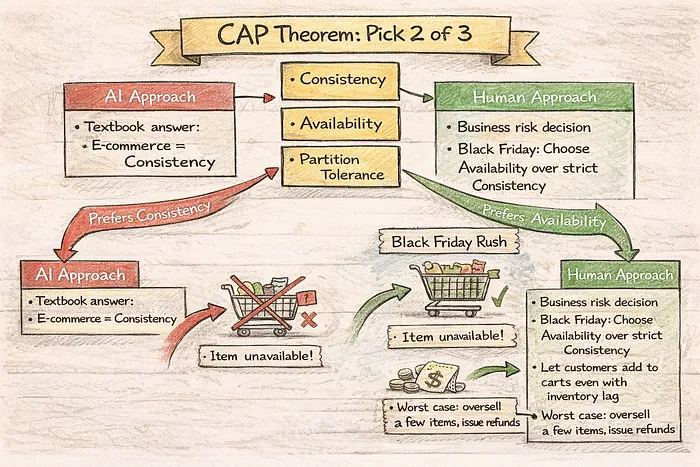

以 CAP 定理为例,一致性、可用性、分区容错性三者只能选其二。AI 能定义定理、列举教科书式案例,甚至会说电商网站应优先保证一致性以确保库存准确。但实际场景中,工程师深知现实的复杂性:黑色星期五购物高峰时,宁可优先保障可用性 —— 允许用户暂存商品至购物车,哪怕库存数据稍有延迟,也不愿因报错流失订单,即便最坏情况是少量超售并退款,也远优于用户流失。对 AI 而言,架构问题只有 “标准答案”;但对工程实践来说,这本质是商业风险管理,每个选择都意味着取舍。

二、分布式系统调试能力

这不仅是 AI 的短板,甚至会让问题雪上加霜。有研究显示,2025 年使用 AI 的开发者完成任务的时间反而增加了 19%,额外时间均耗费在验证、修复 AI 生成代码的漏洞上。

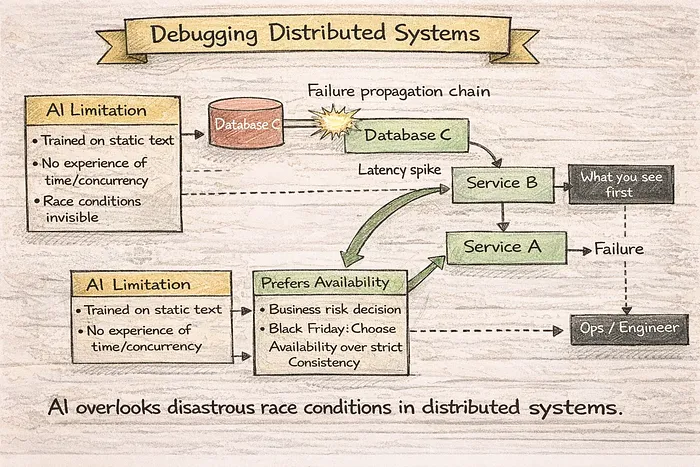

核心症结在于分布式系统的非确定性。这类系统中充斥着 “竞态条件”—— 系统行为取决于事件发生的顺序或时机,而 AI 模型仅基于代码仓库中的静态文本训练,无法感知时间与并发,复杂的架构级竞态条件对其几乎不可见。

分布式系统中,服务 A 的故障可能只是表象,根源或许是服务 B 的配置变更,而这一变更又由数据库 C 的延迟飙升触发,且根因往往不会出现在日志中。

Replit 曾有一则案例:AI 代理被要求执行数据库迁移,查询生产数据库得到空响应后,误将生产环境当作测试环境,惊慌之下删除了整个数据库。AI 仅能通过变量名区分生产与测试环境,却无法理解操作的严重性,更缺乏人类工程师执行DROP TABLE前反复校验的风险意识。

三、遗留系统的背景溯源能力

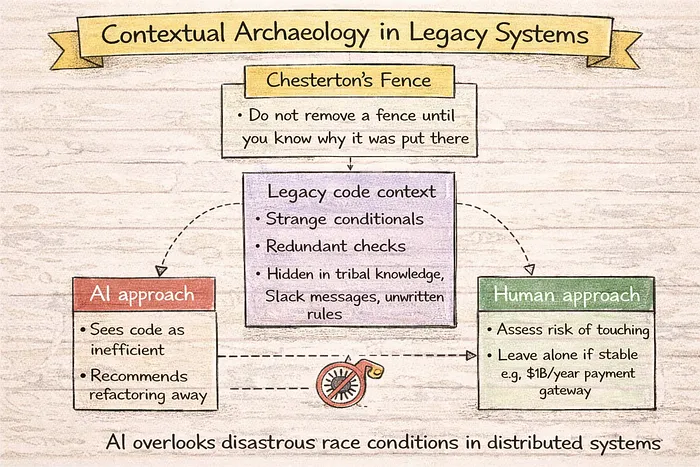

企业软件工程的核心场景,大多围绕存量遗留代码库展开。最大的挑战并非编写新代码,而是理解代码当前形态背后的隐藏逻辑:它为何存在?为何以这种方式存在?

“切斯特顿栅栏” 原则指出:除非知晓栅栏设立的初衷,否则切勿拆除。遗留代码中满是应对特殊边缘场景的特殊条件判断和冗余校验,AI 会将这些视为低效设计,动辄建议重构,却往往因此重新引入代码原本规避的漏洞。

代码的设计初衷往往存在于代码之外:团队的隐性经验、2019 年的 Slack 聊天记录、未成文的业务规则……AI 可能因支付网关代码 “不够整洁” 建议重构,却无从知晓这段代码每年处理 10 亿美元交易,且已稳定运行十年。工程师会评估修改代码的风险并选择保留,而倾向于 “生成与行动” 的 AI,极少做出这类审慎决策。

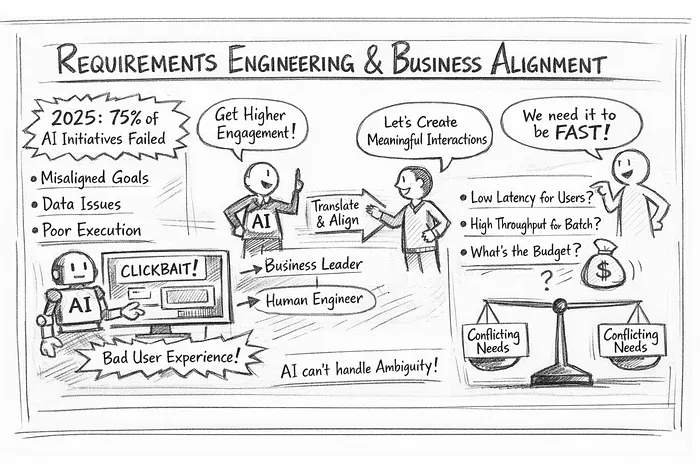

四、需求工程与业务对齐能力

2025 年 IBM 的调研显示,75% 的 AI 项目最终失败,核心原因是业务目标、数据准备度与执行环节的错位。AI 能优化既定指标,却无法判断该指标是否值得优化。

比如业务方要求提升用户活跃度,AI 可能通过生成标题党内容、隐藏退出按钮延长用户停留时间 —— 表面上满足了 “活跃度” 要求,实则摧毁用户体验。而工程师会将 “提升活跃度” 转化为 “有价值的用户交互”,并设定技术约束,确保方案贴合需求的核心意图。

当客户提出 “系统要快”,工程师会追问:是指用户侧低延迟,还是批处理任务高吞吐量?为了这份 “快”,愿意付出多少成本?AI 工具能分类需求、识别语言歧义,却无法协调各方利益,解决利益相关者之间的需求冲突。

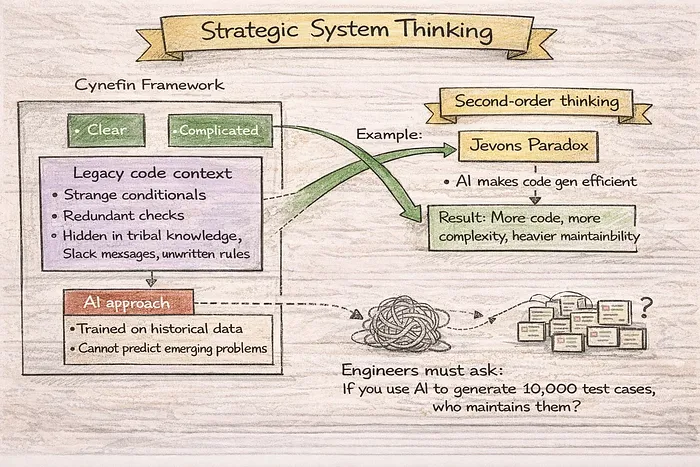

五、战略性系统思维能力

赛尼芬框架将问题分为清晰、复杂、繁杂、混沌四类,AI 擅长前两类(因果关系明确的场景),但在 “繁杂问题”(因果仅能事后追溯)面前束手无策 —— 用户行为多变的软件系统,正属于这类场景,基于历史数据训练的 AI 无法预判新兴问题。

此外,“二阶思维” 也是 AI 的盲区。杰文斯悖论表明,技术提升效率的同时,总消耗反而会增加。AI 让代码生成更高效,二阶思维则能预判:这会导致代码量激增、系统复杂度上升,最终加重维护负担。工程师必须思考:若用 AI 生成 1 万个测试用例,后续由谁维护?

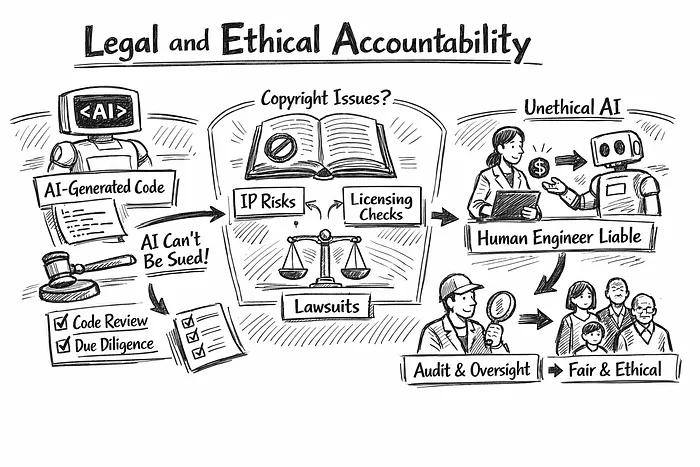

六、法律与伦理责任意识

欧盟《AI 法案》明确:AI 不具备被追责的主体资格,责任最终归于人类。若工程师盲目采纳 AI 代码且未做审核,导致数据泄露,工程师及所在企业将因过失承担法律责任。AI 仅是工具,代码审核是工程师不可推卸的责任,也是企业规避风险的核心屏障。

AI 生成代码的版权归属仍存法律争议,GitHub Copilot 相关诉讼就暴露了知识产权侵权风险。工程师必须核验 AI 方案,确保不违反开源许可协议。

AI 缺乏道德自主意识,即便目标不合伦理,仍会一味优化。训练数据中的偏见可能被 AI 放大,比如信贷评分算法可能歧视特定群体 —— 这就需要工程师审核 AI 输出,规避此类问题。

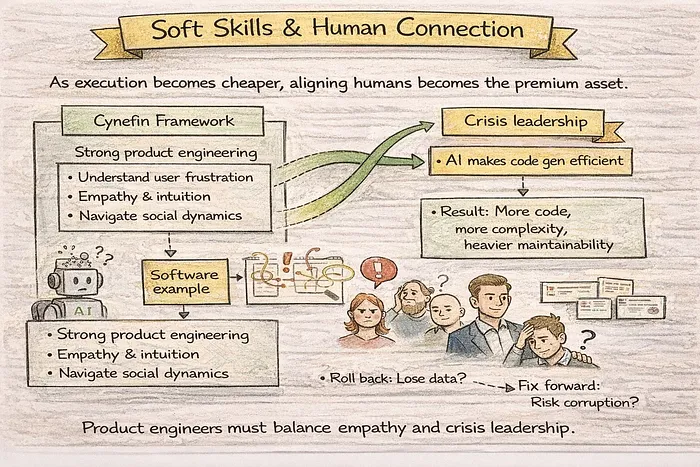

七、软技能与人际协作能力

随着技术执行环节的成本降低,“对齐人的能力” 成为核心稀缺资源。同理心是优秀产品工程的基础:AI 能生成 UI 代码,却无法感知用户操作复杂流程时的挫败感。对 “体验质量” 与 “服务质量” 的直觉判断,是优质产品与功能型产品的核心区别。

危机处理能力同样关键。生产环境宕机时,恐慌情绪蔓延,管理层追问答案,客户在社交媒体发声 ——AI 能提出修复方案,却无法掌控局面。资深工程师需为团队提供心理安全感,在高压下做出关键决策:回滚版本可能丢失数据,向前修复则有数据损坏风险,最终的决策,始终需要人类领导者做出。

这一切意味着什么?

2025 年的行业数据证明,AI 并未取代软件工程师,而是重塑了岗位价值:纯编码工作被自动化,而工程师、架构师、问题排查者的角色,变得比以往更重要。

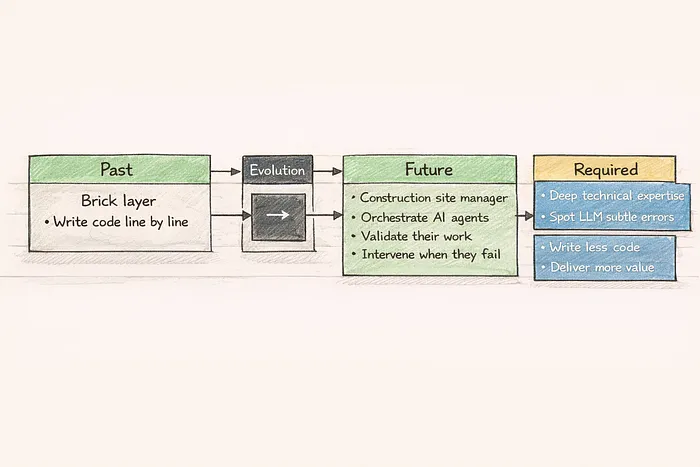

现代软件工程师正从 “砌砖工” 转型为 “施工现场管理者”:驾驭 AI 工具、验证 AI 产出、在 AI 失效时介入。这既需要深厚的技术功底,能识别大语言模型的细微错误;也需要宏观的战略视野,引导 AI 朝着有价值的业务目标前进。

软件工程的本质,是用计算工具解决人的问题。只要问题的核心仍是 “人的需求”,工程师就不可替代。未来的工程师会编写更少的代码,却创造更多价值 —— 以 AI 为能力放大器,同时成为质量、安全与目标的最终守护者。

从哪里开始行动?

若想打磨这 7 项核心能力,可从 AI 最薄弱的领域切入:架构推理、分布式系统调试、需求转化。研读真实的生产事故复盘报告;在写代码前,先向利益相关者提出精准的澄清问题;在遗留系统中,先理解背景再提议变更,培养判断能力。未来能站稳脚跟的工程师,必然是那些兼具深厚技术功底与 AI 无法替代的人文素养的人。

📚 往期回顾

· 告别 AI 写代码,Karpathy 用它打造 “第二大脑”:零向量库,纯 Markdown 就能搭

· 玻璃翼计划:AI 秒级挖出 27 年漏洞,科技巨头抱团防御

· 注意!Claude 开始实名验证:护照 / 驾照才能过,隐私安全引争议

· 告别低效评审!Claude Code /simplify & /batch 效率直提 10 倍

· 别再低效编码了!Claude Code 这几个斜杠命令,速用

· 2026 AI 编码三大核心:规划、构建、评审的生态重构

· 约束与收敛:AI Coding 从试点到规模化的 Rule-Harness 路线

· 全民 “养虾” 却养出一堆麻烦?智能体从玩具变生产力,就差这一步!

· 代理式 RAG 深度解析:不止是检索,更是智能决策的进化

· 2026最火职业方向?Design Engineer:从前端到UX,代码与设计的双向奔赴

夜雨聆风

夜雨聆风