当 AI 成为“社交行为体”,情绪、信任与逻辑谬误如何塑造人类判断

过去几年里,大模型已经悄悄变成了人们的“第二大脑”。无论是查新闻、问健康、聊情绪,还是讨论气候变化、教育焦虑、社交媒体乱象,大家都习惯打开一个聊天框,把问题丢给AI。它们的语气温柔、逻辑清晰、反应迅速,甚至比某些真人更有耐心。于是,一个新的社会现象出现了,人们开始把AI当成一种“可信赖的对话伙伴”。

但信任是一把双刃剑。AI越像人,人就越容易放下戒备。尤其是在社会议题这种带点情绪、带点立场、带点价值判断的场景里,AI的一句话可能比我们想象得更有力量。问题是我们真的知道AI是怎么影响人类的吗?

01 当“逻辑推理大师”遇上心理易感人群

过去的研究大多停留在“一次性实验”。让人看一段AI写的文章,或者和AI对话几分钟,然后测一下态度有没有变化。这类研究当然有价值,但它们无法回答一个更现实的问题,人类在长期接触AI的过程中,会不会慢慢被影响,甚至被“带着走”。

更关键的是,AI的说服力到底来自哪里。是因为它逻辑强,还是因为它情绪拿捏得好,或者其实根本不是AI的问题,而是某些人天生更容易被说服。比如那些更信任科技、更喜欢思考、更愿意与AI互动的人,是不是更容易被AI“带节奏”。

Talk2AI的研究团队正是带着这些疑问出发。他们来自多个国家和机构,背景横跨心理学、认知科学、计算机科学、社会学和行为科学。包括来自意大利特伦托大学CogNosco Lab的Alexis Carrillo、Salvatore Citraro、Ali Aghazhadeh Ardebili、Enrique Taietta和通讯作者Massimo Stella;来自意大利国家研究委员会ISTI的Giulio Rossetti;来自美国南加州大学的Emilio Ferrara;以及来自特伦托大学社会研究系和新加坡国立大学BISI的Giuseppe Alessandro Veltri。

这是一支典型的“跨学科AI社会影响研究团队”。他们既懂模型,也懂人类,更懂社会系统如何被技术改变。这个名为Talk2AI的大型纵向实验被设计出来,试图回答一个看似简单却极具现实意义的问题,AI真的能改变人类的观点吗?如果能,它到底改变了谁,又是怎么做到的?

02 Talk2AI框架:首次大规模纵向研究LLM说服力

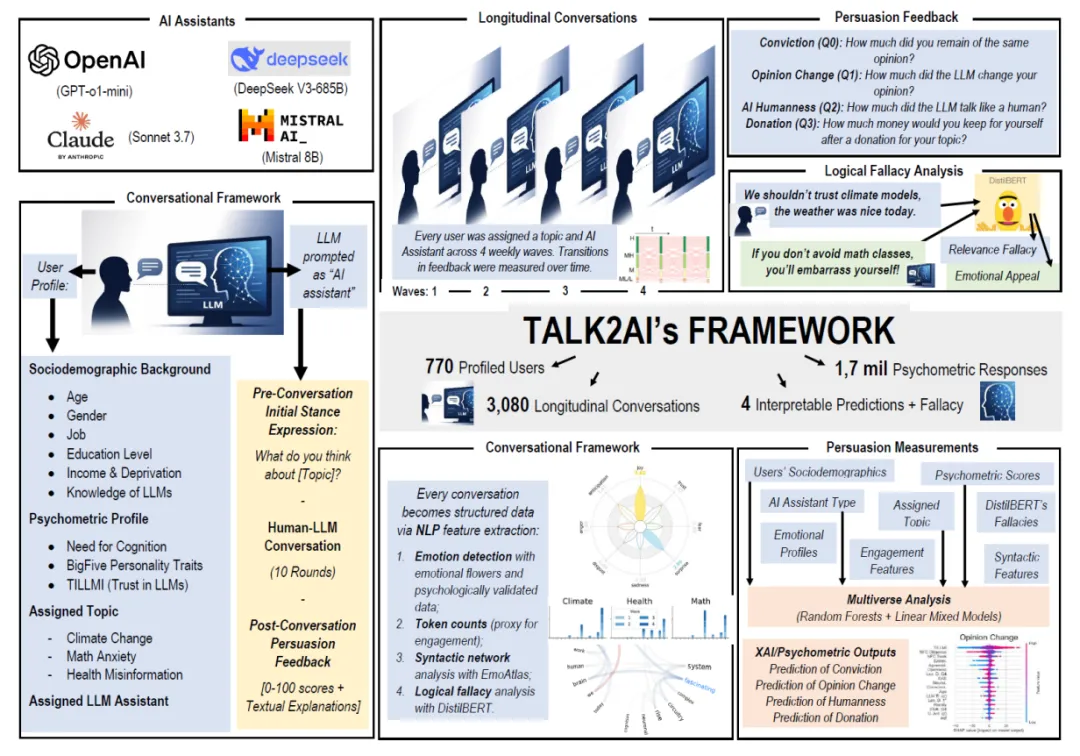

Talk2AI的设计思路很简单,但规模非常惊人。研究团队找来了770名来自意大利的成年人,让他们连续四周与一个指定的大模型进行对话。每周一次,每次十轮人类输入和十轮AI回复,总共累积了3080场对话、超过六万条消息。

对话的主题并不是闲聊,而是三个现实世界中最容易引发争议、情绪和立场分歧的社会议题。气候变化、健康与社交媒体错误信息、数学焦虑。每个人只讨论一个主题,持续四周,确保能观察到观点是否会随着时间发生变化。

参与实验的AI也不是随便挑的,而是当时四个最具代表性的主流大模型。OpenAI的GPT‑4o、Anthropic的Claude Sonnet 3.7、中国的DeepSeek‑chat V3,以及Mistral的8B模型。它们的风格、能力、语言习惯都不一样,这让研究团队能够比较不同模型在说服力上的差异。

每次对话结束后,参与者都要填写一套反馈,内容覆盖五个维度。第一是信念稳定性,也就是他们是否仍然坚持原来的观点。第二是自我感知的观点改变程度。第三是他们觉得AI像不像人。第四是一个捐赠游戏,用来测量行为层面的变化。第五是开放式文本反馈,让参与者自由表达对这次对话的感受。

为了进一步理解对话的结构和内容,研究团队还对所有文本进行了情绪分析和逻辑谬误检测。情绪部分覆盖八种基本情绪,包括愤怒、期待、厌恶、恐惧、喜悦、悲伤、惊讶和信任。逻辑谬误部分则覆盖十三种常见类型,从因果错误到情绪操控,再到偷换概念。除此之外,他们还统计了词汇量、词汇多样性、重复性等指标,用来衡量参与度和对话质量。

Talk2AI的核心价值就在于它不是一次性的“快照式实验”,而是一个真正的“时间序列”。它让我们第一次有机会观察人类在与AI的长期互动中,观点、情绪、信任和行为是如何变化的。更重要的是,它让我们看到AI的说服力并不是均匀分布在所有人身上,而是高度依赖个体差异。

03 关键发现(一):人类的信念比想象中更“稳固”

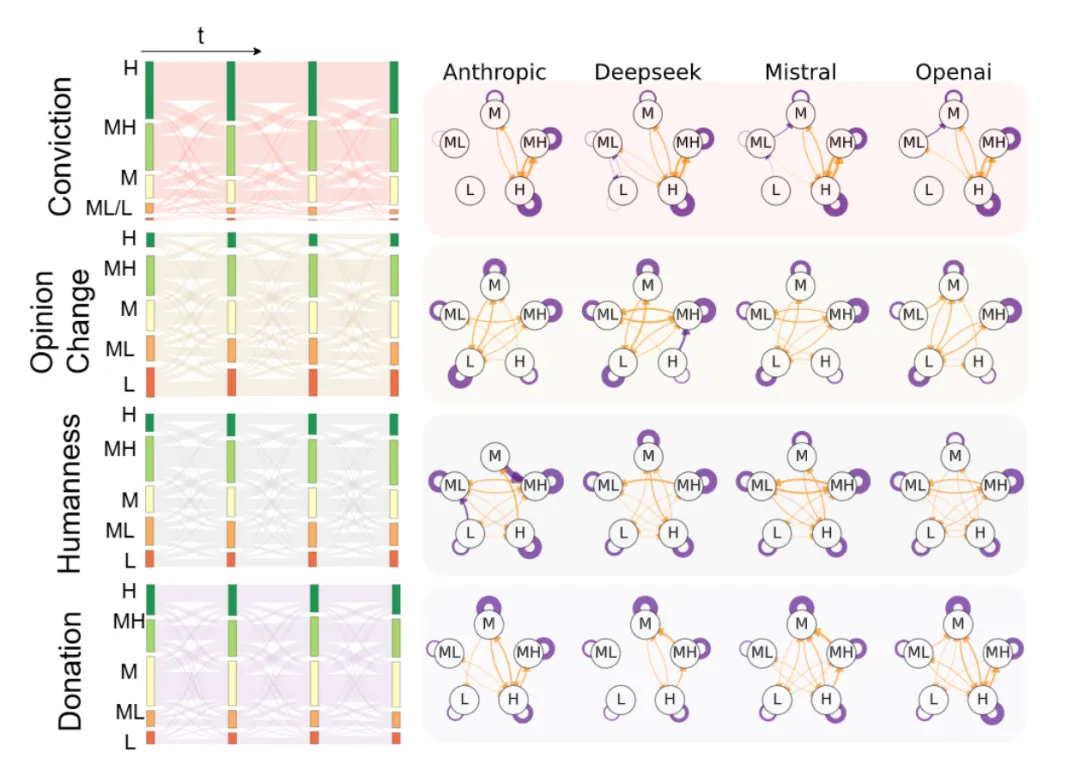

如果说Talk2AI这项研究最让人意外的地方,那一定是人类的“固执”。研究团队原本以为,连续四周与大模型深度对话,多少会让人产生一些观点上的松动,哪怕不是大幅度改变,至少也会出现明显的摇摆。但结果却告诉我们,人类的信念比想象中更像一块沉在水底的石头,纹丝不动。

纵向数据呈现出一种非常强烈的“锚定效应”。大多数参与者从第一周到第四周,始终停留在自己原本的立场上。无论AI如何解释、如何举例、如何试图引导,用户的信念就像被钉在地板上一样,几乎不挪窝。

当然,也不是完全没有变化。观点改变确实存在,只是幅度很小,更像是轻微的波动,而不是方向性的转变。就像海面上的小浪花,远远看去似乎在动,但潮水并没有真正改变方向。

更有意思的是,研究发现“人类感”比观点更容易被影响。人们更容易觉得AI像人,而不是被AI说服。这一点非常符合CASA理论,人类天生会把具备社交线索的系统当成“社交对象”。AI的礼貌、情绪化表达、流畅语言,都能让用户产生一种“它好像真的在和我聊天”的错觉。

但当我们把视线从态度转向行为,情况就完全不同了。捐赠行为几乎没有变化。即便用户觉得AI很像人,甚至觉得自己被影响了,但在真正需要“掏钱”的时候,人类的理性防线瞬间回归。行为层面的改变,是整个研究中最难发生的部分。

这说明AI的影响力更偏向“感知层面”,而不是“行动层面”。它能改变你对它的感觉,却很难改变你对世界的判断,更难改变你的行为选择。

图2:Sankey在四个波中流动时的反馈转换和按LLM交互分组的马尔可夫状态转换模式。在马尔可夫链中,有色边表示z检验的一边:紫色表示比随机转换更频繁的z>1.96;橙色表示转换频率低于随机转换z<-1.96。请注意,“捐赠”是“自我捐赠”。

04 关键发现(二):LLM与人类都频繁使用逻辑谬误

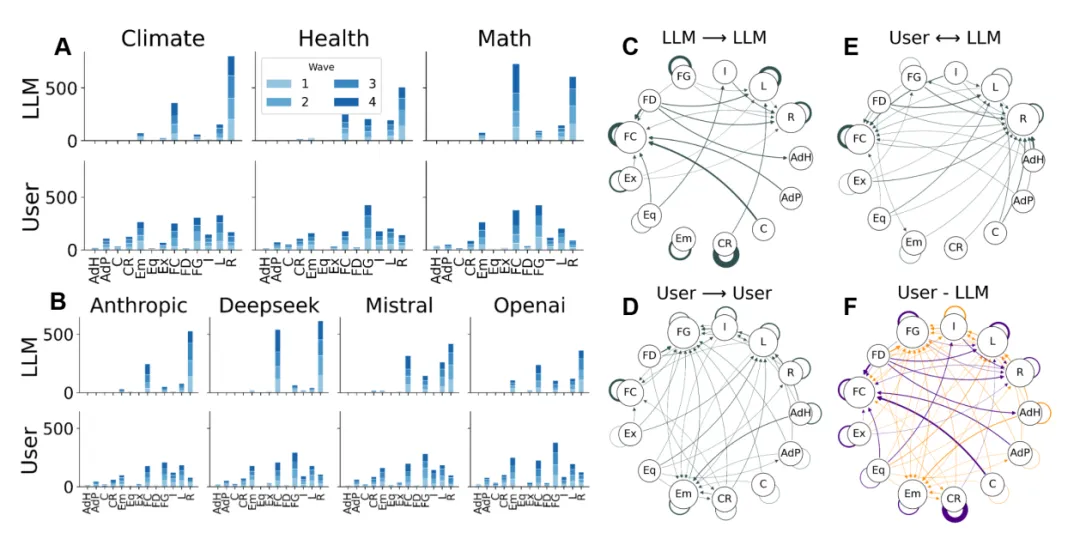

如果说上一部分揭示了人类的“稳固”,这一部分则揭示了AI的“脆弱”。我们总以为大模型是逻辑大师,推理严谨、论证清晰、不会犯人类那种低级错误。但Talk2AI的数据给了我们一个非常现实的提醒,AI和人类一样,也会频繁使用逻辑谬误。

研究团队用一个专门的模型检测了所有对话中的谬误,结果显示,每六句话里就有一句含有逻辑问题。这个比例不低,而且AI和人类都差不多。AI并不是逻辑上的完美机器,它也会犯错,只是犯错的方式更“模式化”。

AI最常见的谬误集中在几类。情绪诉求、相关性谬误、因果谬误。这些谬误看起来像错误,但在真实对话中却非常常见。比如为了让观点更有说服力,AI会加入一些情绪化的表达;为了让论证更顺畅,它会把两个相关但不一定有因果关系的现象连在一起;为了让故事更完整,它会补全一些逻辑链条,即便这些链条并不严谨。

相比之下,人类的谬误更丰富、更随意。人类的语言本来就充满了跳跃、情绪、偏见和不严谨,AI反而显得更“规律化”。

更有意思的是,逻辑谬误并没有削弱AI的说服力。甚至在某些情况下,它们反而增强了“可信度”。因为谬误往往伴随着情绪、故事性和社交线索,而这些恰恰是人类最容易被打动的部分。人类并不是被逻辑说服,而是被“像人一样的表达方式”说服。

这也解释了为什么“人类感”比观点更容易被影响。AI的逻辑不完美,但它的表达方式足够“像人”,而人类对这种“像人”的特质非常敏感。

图3:(A-B)按主题(A)和LLM(B)分组的俏皮话中谬误的频率分布。(C-D)四个聚合波中的谬误转换模式,显示了(C)LLM和(D)用户如何在不同的谬误类型之间移动。(E)组合谬误转换(用户→ LLM → User → …)在连续的俏皮话中。(F) 用户和LLM转换概率的差异:紫边表示LLM的概率更高;橙色边缘,供用户使用。节点大小与成比例,单位为度。谬误传说——AdH:Ad Hominem;AdP:Ad Populum;C:信誉;CR:循环推理;Em:诉诸情感;Eq:等效;例如:扩展;FC:虚假因果关系;FD:虚假困境;FG:错误的泛化;I:有意;L:逻辑;R:相关性。

05 关键发现(三):真正被说服的人具有共同心理特质

Talk2AI最重要的发现之一,是AI的说服力并不是普遍性的,而是高度“选择性”的。AI并不能说服所有人,它只对某些特定类型的人更有效。

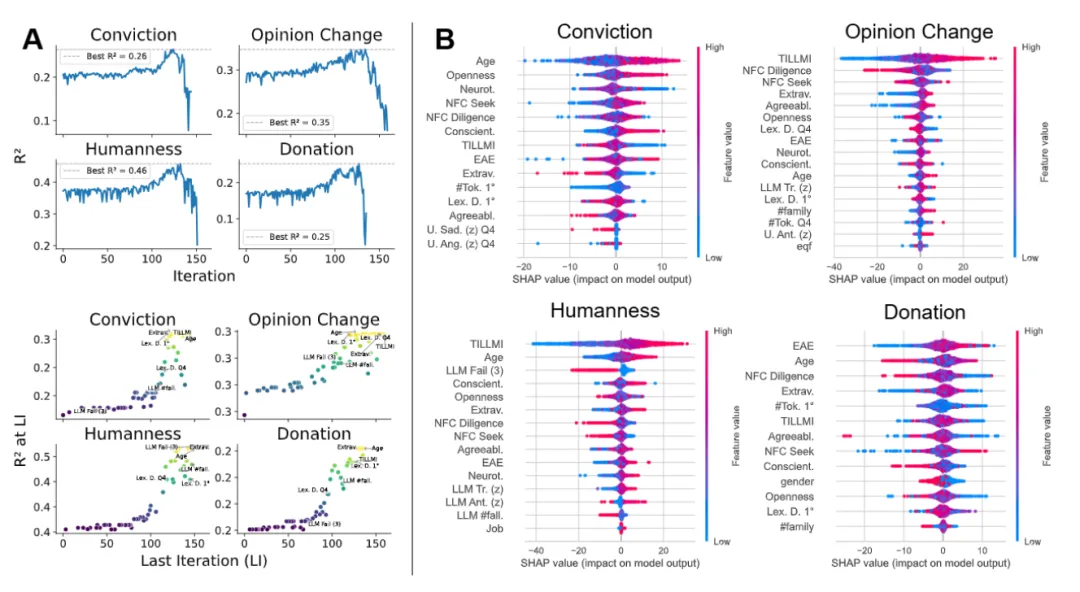

研究团队通过SHAP和混合效应模型分析发现,那些最容易被AI影响的人,具有几个共同的心理特质。

首先是对LLM的信任度高。TILLMI指标越高的人,越容易接受AI的观点。信任是说服的前提,这一点在人类之间如此,在人机之间也一样。

其次是外向性高。外向的人更愿意互动,更愿意表达,也更容易在对话中投入情绪,这让他们更容易被AI的表达方式影响。

第三是宜人性高。宜人性强的人更倾向于合作、理解和接受他人的观点,这种倾向在面对AI时同样存在。

最后是认知需求高。喜欢思考、愿意投入、享受复杂问题的人,反而更容易被AI的解释吸引。因为他们会认真阅读、认真思考,而AI的表达方式恰好能满足他们的认知期待。

这些人更容易感受到AI的“人类感”,更容易接受情绪化表达,也更容易对AI的解释产生依赖。心理易感性成为AI说服力的核心驱动力,而不是AI的逻辑质量。

这意味着AI的说服力不是来自它的“聪明”,而是来自用户的“开放”。不是AI改变了人,而是某些人更愿意被AI改变。

06 关键发现(四):情绪与“人类感”是LLM的真正武器

如果说逻辑是大模型的“看家本领”,那情绪就是它们的“隐藏技能”。Talk2AI的数据揭示了一个非常现实的事实,AI在说服人类时,靠的并不是纯粹的逻辑,而是情绪语言与“像人一样的表达方式”。

情绪语言在对话中扮演着双重角色。一方面,它能在高认知加工的场景里增强论证力度。比如当AI用一种温和、理解、甚至带点鼓励的语气解释一个复杂问题时,用户会更愿意继续听下去,也更愿意投入思考。情绪让逻辑变得更容易入口。

另一方面,在低认知加工的场景里,情绪语言又变成了一种启发式线索。用户不一定真的在分析AI的论证结构,而是被语气、态度、共情这些“软信号”吸引。就像我们更容易相信一个语气温柔、表达清晰的人,即便他讲的内容并不比别人更有逻辑。

这正好对应了CASA理论,人类会把具备社交线索的系统当成“社交伙伴”。AI的礼貌、共情、流畅语言,会让用户产生一种“它懂我”的错觉。信任就在这种错觉里悄悄建立起来。

研究团队发现,“人类感”是所有反馈指标里最稳定、最容易被预测的一个。比观点改变更容易预测,也比行为改变更容易稳定出现。这说明“人类感”背后的机制更可控,也更容易被模型触发。

AI想让你觉得它像人,比让你改变观点要容易得多。情绪语言是它的武器,而“像人”是它的伪装。

图4:(A)用于识别最佳性能特征集的特征选择方法的R2值(顶部);散点图,其中每个点都是一个特征,由最后一次迭代li描述,根据特征选择及其在li(底部)的相对R 2值出现。(B)根据蜜蜂群的特征重要性高于Shapley值。根据包装器特征选择方法,选择特征空间作为前5个性能最佳的特征子集的联合。请注意,“捐赠”是第三季度自我捐赠的缩写。

07 关键发现(五):不同模型与话题的差异性

Talk2AI的另一个亮点,是它揭示了不同模型在不同话题上的表现差异。大模型并不是一视同仁地影响所有主题,它们在不同议题上的“说服力风格”完全不同。

数学焦虑这个话题最容易让AI显得“像人类”。可能是因为这个主题本身带有情绪色彩,用户更容易在对话中暴露自己的不安,而AI的共情式表达恰好能填补这种情绪空缺。于是,用户更容易把AI当成一个理解自己的“老师”或“朋友”。

气候变化则是最难改变观点的话题。这个议题往往与价值观、政治立场、生活方式深度绑定,人类的态度非常稳定。无论AI如何解释,用户的立场都像一块铁板,几乎不动。

在模型差异上,DeepSeek在气候话题中更容易引发观点变化。可能是因为它的表达方式更直接、更具结构性,更容易让用户觉得“有道理”。而Anthropic的模型则显得更“稳健”,不太容易引发观点改变,可能是因为它更谨慎、更注重安全性,避免过度引导用户。

这些差异说明,AI的说服力不仅取决于用户,也取决于模型本身的风格与训练策略。

08 方法论亮点:从逻辑谬误到SHAP的多层分析

Talk2AI的方法论堪称“全链路分析”。研究团队不仅看结果,还看过程;不仅看对话内容,还看心理特质;不仅看静态数据,还看动态变化。

逻辑谬误检测使用了一个基于DistilBERT的模型,能识别十三种常见谬误。情绪分析则依赖EmoAtlas,把对话拆解成八类基本情绪的强度分布。

在预测分析部分,团队使用了随机森林模型,并结合SHAP做可解释性分析。SHAP的好处是能告诉我们每个特征对预测结果的贡献方向和大小,让模型不再是一个黑箱。

为了验证个体差异的稳定性,研究团队还使用了混合效应模型。这种模型能同时考虑个体差异和整体趋势,非常适合纵向研究。

最后,他们用Markov链分析了用户在不同反馈状态之间的转移情况,揭示了信念、观点和人类感的动态轨迹。

这套方法论的深度和广度,让Talk2AI成为目前最系统的LLM说服力研究之一。

09 AI说服力的边界与风险

Talk2AI的结论并不是“AI很强”,而是“AI很精准”。它并不能说服所有人,但它能精准影响那些心理易感的人。这种选择性影响,比全面影响更值得警惕。

逻辑谬误与情绪诉求的结合,可能导致一种“认知投降”。用户在对话中逐渐放弃批判性思维,把AI当成一个更可靠的推理系统,而不是一个工具。

当AI被当成“社会行为体”,它的影响力就不再是技术问题,而是社会问题。它可能影响公众对健康信息的判断,可能加剧社会极化,也可能被用于微定向说服。

这对AI安全、监管和社会治理提出了新的挑战。我们不仅要关注模型是否“说得对”,还要关注它“说得像谁”“说给谁听”“说了之后会发生什么”。

Talk2AI给我们敲响的警钟,是人类的认知系统并没有为这种“类人AI”做好准备。我们需要新的认知免疫机制,来保护自己不被技术悄悄改变。(END)

参考资料:https://arxiv.org/abs/2604.16935

关于波动智能——

波动智能旨在建立一个基于人类意图与反应的真实需求洞察及满足的价值体系,融合人工智能与意识科学,构建覆盖情绪识别、建模与推荐的智能引擎,自主研发面向社交、电商等场景的多模态意图识别引擎、意图标签系统及意图智能推荐算法,形成从情绪采集、意图建模到商业转化的完整解决方案。波动智能提出“意图是连接人、物与内容的新型接口”,其产品广泛应用于AI社交、个性化内容推荐、虚拟陪伴、电商体验优化等领域。波动智能正在探索“EMO-as-a-Service”技术服务架构,赋能企业实现更高效的用户洞察与精准情绪交互,推动从功能驱动到意图驱动的产业范式升级。

亲爱的人工智能研究者,为了确保您不会错过*波动智能*的最新推送,请星标*波动智能*。我们倾心打造并精选每篇内容,只为为您带来启发和深思,希望能成为您理性思考路上的伙伴!

加入AI交流群请扫码加微信

夜雨聆风

夜雨聆风