每日AI知识点:Token(词元)

在很长一段时间里,Token没有一个统一的中文翻译——搞区块链的人叫它“代币”,做网络安全的人叫它“令牌”,编译器开发者叫它“标记”,同一个英文词在不同的圈子里各叫各的。

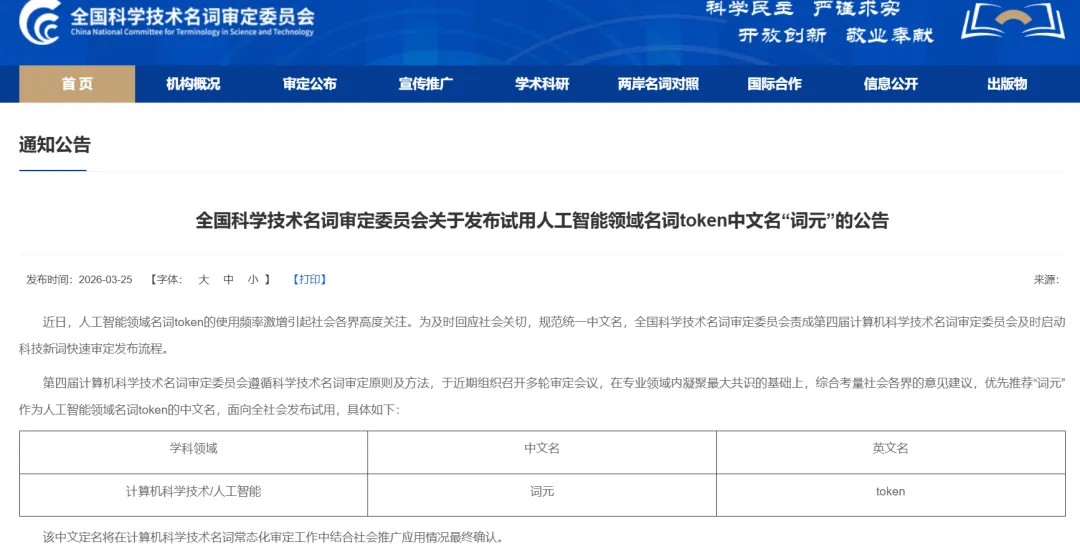

2026年3月,国家数据局局长刘烈宏在中国发展高层论坛2026年年会上正式宣布,大模型处理信息的最小可计量单元(Token)的中文标准译名确定为“词元”。

全国科学技术名词审定委员会随后发布公告,面向全社会发布试用。

用通俗语言解释BPE的原理,你有一本超级词典,编词典的过程是这样的:

第一步:初始化把文本拆成最小的单元——单个字符。比如”苹果”变成 ["苹", "果"]。

第二步:找高频组合统计所有文本中,哪两个字符经常粘在一起出现。发现”苹果”这个词出现了 100 万次,那就把”苹果”合并成一个新 Token。

第三步:不断合并反复执行:找出现频率最高的相邻组合 → 合并成新Token。

为什么这样设计?

-

高频词直接整存:”苹果”、”人工智能”、”中国”这种常见组合,可能就是一个Token,节省空间

-

生僻词拆开存:”饕餮”这种罕见词,可能拆成

["饕", "餮"]两个Token -

英文优势:英文常用词如 “the”、”and” 通常各是一个Token,所以英文更”省Token”

很多平台现在提供了Token可视化工具,你可以直观看到一句话被切成几块。

举个例子,输入:“AI正在改变世界”,不同模型的切法可能不同:

GPT-4 的视角:["AI", "正在", "改变", "世界"]Llama 3的视角:["A", "I", "正在", "改变", "世界"]DeepSeek-V3 的视角:["AI", "正在", "改变", "世界"]

-

海外大模型(如Gemini、GPT系列):平均1个汉字约消耗1.4~1.6个Token。 -

国产大模型(如DeepSeek、GLM、通义千问等):平均1个汉字约消耗0.55~0.6个Token(国产大模型对中文进行了深度”整词压缩”)。

为什么 AI 聊天有”字数限制”,为什么长对话会越用越贵?

因为 AI 的计费核心就是Token数 × 单价。

计费公式:

总费用=(输入token数 + 输出token数) × 每token单价|

|

|

|

|

|

|

|---|---|---|---|---|---|

| 海外模型 | |||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 国内模型 | |||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

既然Token=钱,那怎么在日常使用大模型中省Token?

技巧一:精简提示词(Prompt)

-

删掉废话和客套话

-

用英文写技术类提示词(通常更省Token)

-

避免重复描述

技巧二:控制上下文长度

-

长对话定期”新开窗口”或总结历史

-

不要把整本书直接贴进去,先分段处理

技巧三:利用系统提示(System Prompt)

-

把固定要求写在系统提示里,不需要每次重复

-

系统提示只算一次 token,不会随对话累积

技巧四:选择合适的模型

-

简单任务用小模型(省Token且更快)

-

复杂任务再用大模型

夜雨聆风

夜雨聆风