刷了一年AI资讯 脑子里啥也没剩下 直到我把整个学习流程反过来

说句难听的,我之前每天刷三四个小时小红书和公众号,感觉自己跟上了AI的节奏。结果有人问我”最近AI有啥重要进展”,我张嘴就卡壳,只能说”挺多的……那个……Claude好像又更新了?”

那种空虚感特别真实。信息穿脑而过,跟风过堂一样。

后来我想明白一件事:问题根本不在刷得够不够多,而在于你的信息从哪来、怎么消化、有没有产出。这三个环节但凡断一个,你就是在做无效学习。

我最近把这套东西跑通了,体感变化很明显——文章产出质量直接上了一个台阶。不是靠灵感,靠的是一个可以重复执行的工作流。

第一件事:把信息源换掉

这个点很多人不当回事,觉得”我看的也挺多的啊”。但你仔细想想,你看的公众号文章,大概率已经被洗过两三遍了。原始信号经过层层转述,到你手里就剩渣了。

我花了大半年从50多个信息源里筛出来一批英文newsletter,这些才是真正的一手信息:

- The Rundown AI

— 每日AI产业动态,信息密度很高,不水 - TLDR AI

— 五分钟能扫完,AI+编程+产品都有 - The Neuron

— 给非技术背景的人看的AI日报,三分钟读完 - Ben’s Bites

— Ben Tossell搞的,工具类消息特别全 - Latent Space

— swyx写的,工程视角,能看到很多外面看不到的项目 - Interconnects

— Nathan Lambert专门写RLHF和模型训练的深度内容 - One Useful Thing

— Ethan Mollick的专栏,学术和实际工作场景结合得好 - AI Breakfast

— 每周一份,适合系统回顾 - Every

— 偏商业战略分析那一挂

你可能觉得”英文的看不动”。但说实话这也正是这套工作流后面要解决的问题——你不用自己一篇篇读。

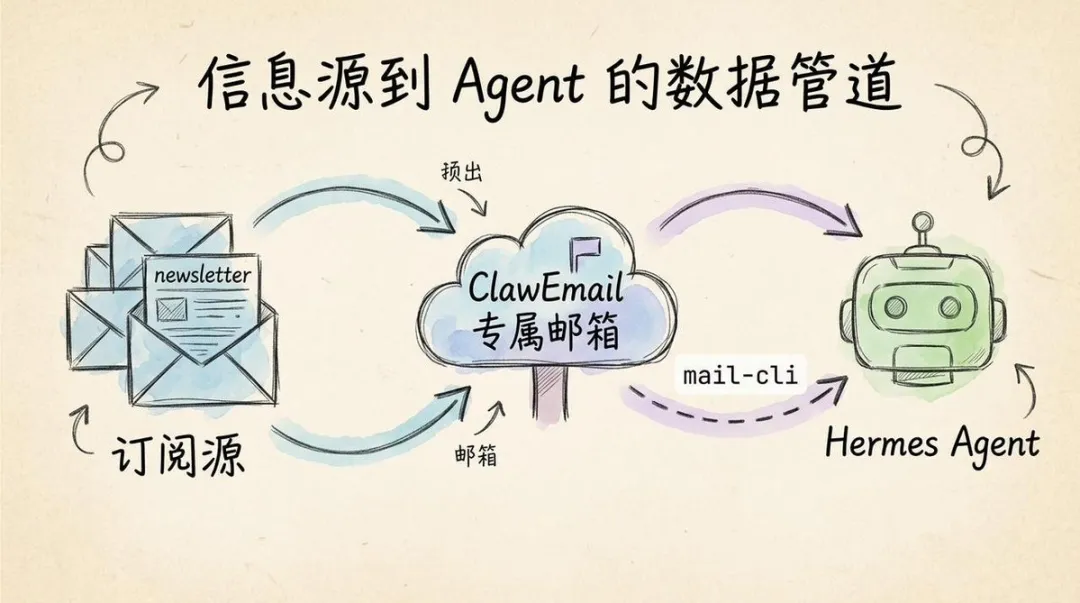

第二件事:给Agent接一个专属邮箱当输入管道

这步我踩了不少坑才跑通。

核心思路就是:你订阅的这些newsletter,不要进你自己的Gmail乱成一锅粥,而是全部灌进一个Agent专属邮箱里。这样Agent可以自动读取、筛选、处理。

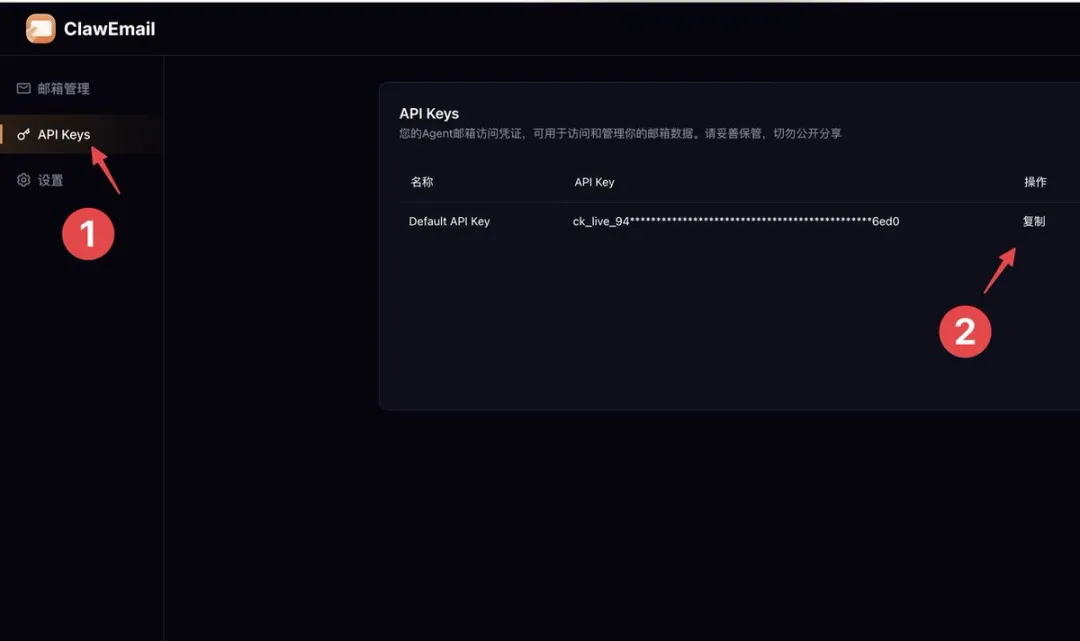

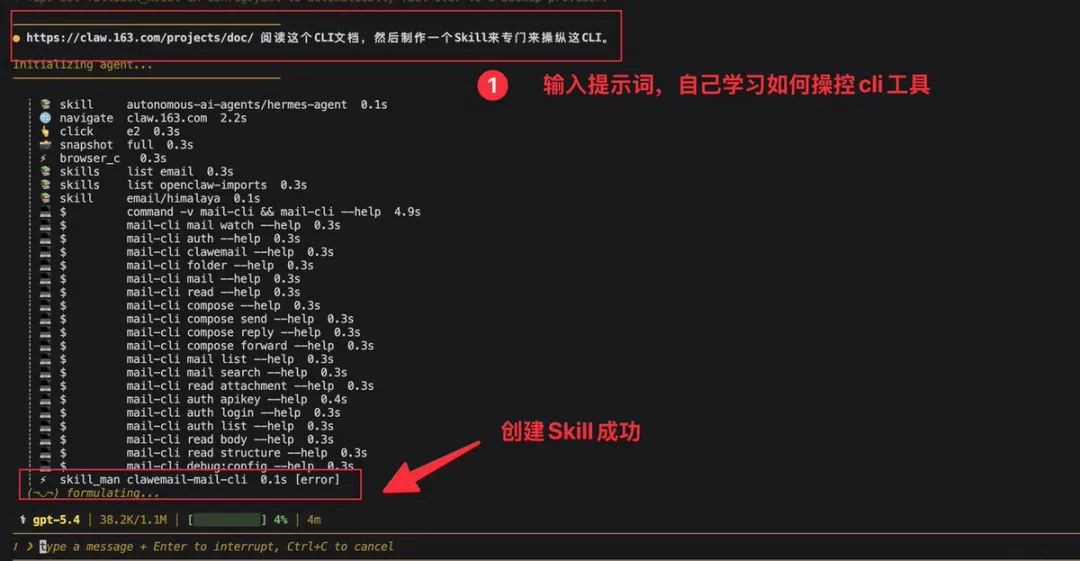

具体操作是用ClawEmail(网易出的一个Agent邮箱产品)。注册完主邮箱之后,关键一步是装mail-cli这个命令行工具。终端敲四条命令:

npm install -g @clawemail/mail-cli

mail-cli auth apikey set ck_live_你的key

mail-cli auth login --user 你的邮箱@claw.163.com

mail-cli auth test

装完之后Agent就能读邮件、搜关键词、拉正文了。邮箱从一个被动的收件箱,变成了Agent的眼睛。

然后我强烈建议再建一个子邮箱,专门接newsletter。不然以后你要是还想拿邮箱做别的自动化(比如客服),就全搅在一起了。

mail-cli clawemail create \

--prefix newsletter \

--type sub \

--display-name "Newsletter Bot"

建完去Dashboard把通讯规则打开,收信范围选所有人——因为newsletter的发件域太杂了,搞白名单根本维护不过来。

之后所有newsletter订阅都填这个子邮箱地址就行。确认邮件到了让Agent自己提取确认链接搞定。

第三件事:这才是真正改变我学习方式的地方

前面都是基建。真正让我觉得”这玩意儿绝了”的,是后面这套消化流程。

大多数人搞AI newsletter汇总,无非就是让AI生成个摘要,扫一眼知道今天出了什么新闻。但说白了这跟刷推没区别,过眼就忘。

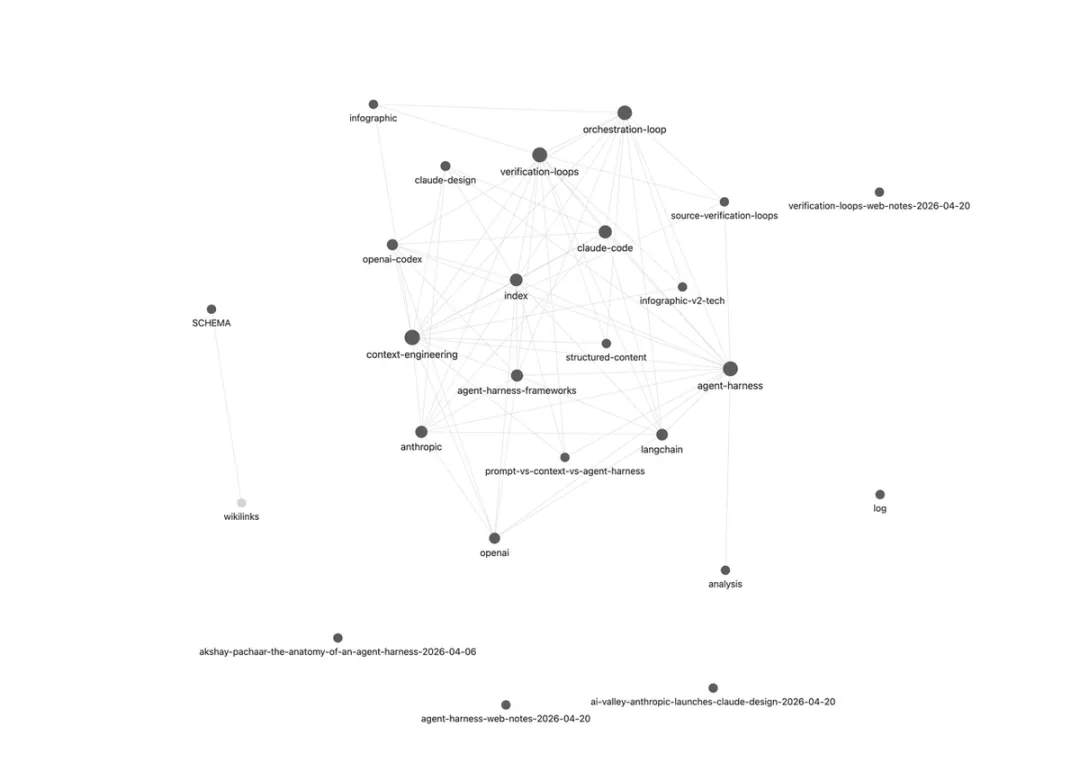

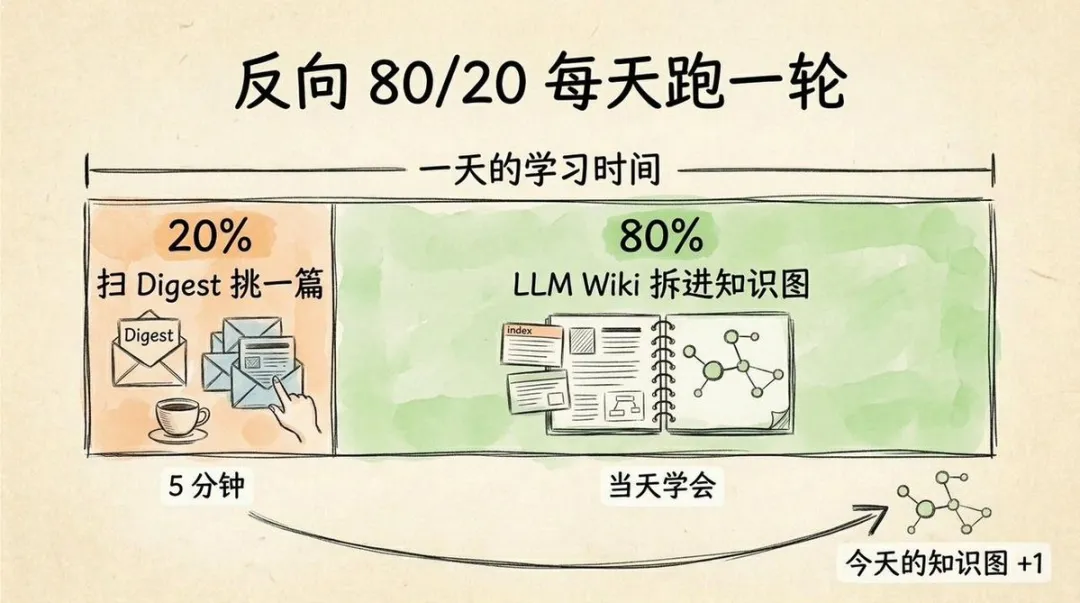

我多做了一步:从每天的日报里挑出最值得深读的一篇,然后用LLM Wiki的方式去消化。

LLM Wiki这个概念是Karpathy今年提的。简单说就是——你扔一篇文章给它,它把里面的概念、实体、论点、开放问题全拆出来,每个做成一张卡片,再把这张卡片和你已有的知识库里相关的卡片连起来。

周末熬夜测试了一下,跑通之后打开Obsidian的图谱功能,看到那个节点越来越多、线越连越密的知识网络,说实话有点上头。

神奇的地方在于:你今天读的一篇关于Verification Loop的文章,它不只是单独存在,而是自动和你上周读的关于RLHF的笔记、上上周读的关于Agent架构的笔记产生了关联。旧知识因为新文章多了一条论据,新概念和旧概念第一次被串到了一起。

认知科学里有个说法,知识的留存率取决于它和你已有知识的连接数量。连接越多,越难忘。所以你一天深读一篇,效果可能顶别人刷一百条推文。

操作上也不复杂:让Agent把邮箱里你感兴趣的文章拎出来,告诉它”这篇编译到我的Wiki”,跑完就会生成一组互相链接的Markdown文件。然后你在图谱里找到自己不懂的节点,继续追问拆解,知识网就越滚越大。

最后一环:学了得用 不然等于没学

光往脑子里塞东西不产出,几周之后那些知识照样会沉下去。

我现在的做法是写文章的时候,直接把Wiki的index文件丢给AI,让它扫一遍我积累的知识库。碰到想不明白的点就问:

“这个概念我之前读过哪几篇有提到” “有没有什么反面观点我没考虑过” “还有哪些角度可以展开”

注意,AI在这儿干的活儿不是帮你写,是帮你想。帮你把散落在各个角落的知识调出来碰撞。最后动笔的还是你自己,但你想问题的深度和广度完全不一样了。

还有个小功能挺好玩:可以直接问一个概念让它生成信息图,用来理清复杂概念之间的关系,或者直接当配图发。

整套流程回过头看:信息源筛选 → Agent自动收取 → 日报初筛 → 深度消化进Wiki → 知识网络滚雪球 → 倒逼输出

每一步单独拎出来都不难,但串起来之后那个飞轮效应真的很明显。

说到底我以前最大的误区就是把”刷信息”等同于”学习”。现在回想起来,那段时间每天花三四个小时刷手机的自己,跟刷短视频也没啥本质区别。

如果想获取更多AI玩法,可以加入社群后我拉你进群直接学习。

|

|

说一下共学信息群

我建了一个AI共学信息群,助力大家能快速上手AI工具,群内有各种最新的AI玩法教程和前沿信息,Coze工作流空间,自研的各种助力插件免费使用。加入共学群的朋友还可同步被拉入Coze团队空间,获取我过去分享过的各类工作流文件,从初级到高级一应俱全,帮助你更快掌握使用技巧,想了解共学群的友友可以扫码添加上面微信进行详细了解。

夜雨聆风

夜雨聆风