重磅!AI新纪元!DeepSeek-V4发布:1.6万亿参数,API低至1元,但低价时代结束了

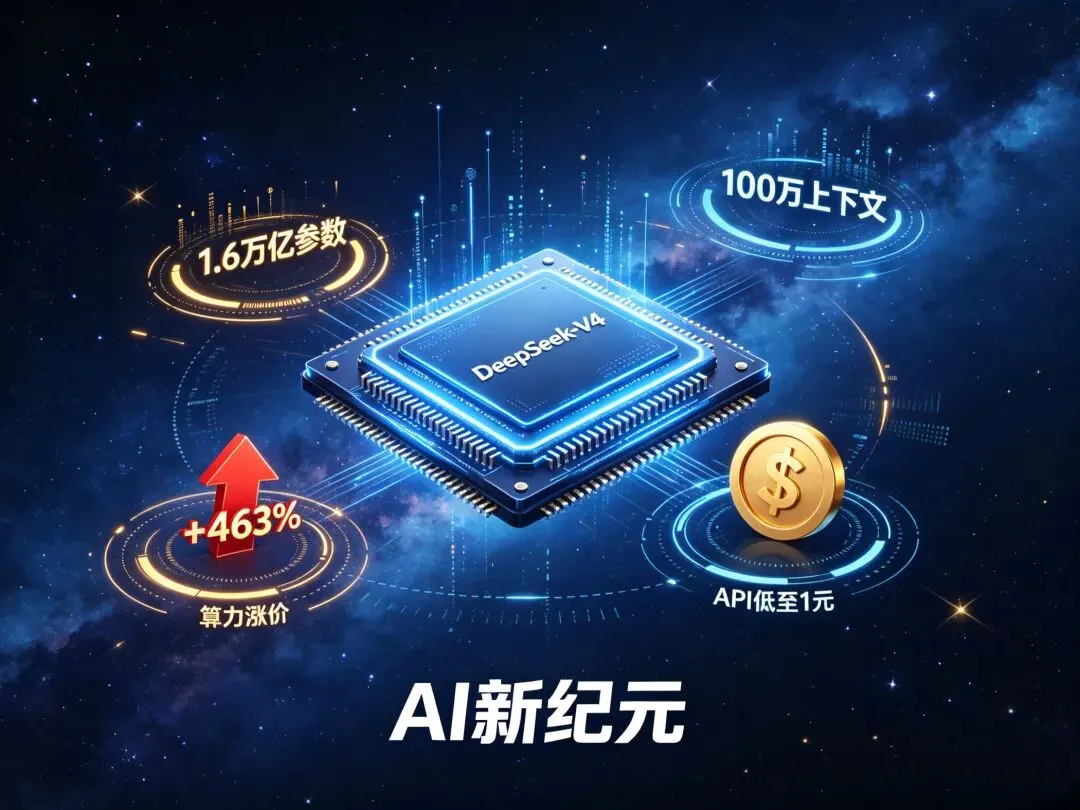

4月24日,深度求索公司正式发布DeepSeek-V4预览版并同步开源🌐。新系列包含两个MoE版本——Pro版总参数达1.6万亿、激活参数490亿,统一标配100万token上下文;Flash版总参数2840亿、激活参数130亿,每百万tokens输入定价0.2元(缓存命中)、输出2元💰。

这不是一次常规迭代。1.6万亿参数、100万上下文、API价格低至1元——这三个数字放在一起,构成了一个深层的追问:当模型的”硬核参数”和”成本下限”同时被击穿,AI产业正在经历一场怎样的重塑?

从”追随者”到”标准制定者”:1.6万亿参数、100万上下文成标配 🏆

V4这次最大的看点之一,是将百万上下文从高端特性变成了全线标配。Pro版和Flash版都原生支持100万token上下文,这一点在行业上尚属首次🥇。在此之前,1M级别的上下文能力长期是Google Gemini的独占优势,行业主流上下文窗口普遍在128K到256K之间。

更关键的是,V4不是在”堆算力换能力”。它将百万上下文下的单token算力消耗压到了V3.2的27%,KV缓存占用仅10%。这意味着,在上下文大幅扩展的同时,推理成本反而降下来了。

能力层面,V4-Pro在Agent能力、世界知识和推理性能上比肩顶级闭源模型。在Apex Shortlist和Codeforces两项硬核推理与编程任务中,V4-Pro的得分(90.2%和Rating 3206)甚至压过了海外闭源旗舰。

从开源社区的反馈来看,有开发者直言”让开源模型从及格变成了优秀”,也有人感叹”DeepSeek正在从追随者变成标准的制定者”💪。1.6万亿参数也刷新了Kimi 2.6的1万亿参数规模,成为目前国产开源模型最大参数规模。

价格层面,Flash版输入1元/百万token、输出2元,缓存命中后输入仅0.2元;Pro版输入12元、输出24元。作为对比,同期海外顶级闭源模型的API调用成本大约是V4的数十倍。

开源迭代,但涨价潮来了:腾讯云涨463%,智谱AI年内三度调价,阿里停售低价套餐 📈

然而,在DeepSeek带着低至1元的API价格强势归来的同时,整个行业却正经历与其低价策略”背向而行”的涨价潮。

进入2026年以来,全球算力需求曲线陡峭。4月全球最大的API聚合平台OpenRouter的周度Token消耗量较一年前提升了7-8倍。英伟达H100的一年期租赁价格从2025年10月低点1.70美元/小时飙升至2026年3月的2.35美元/小时,涨幅近40%💻。

国内云厂商集体调价——腾讯云Tencent HY 2.0 Instruct模型的输入价格从0.0008元/千tokens大涨至0.004505元/千tokens,涨幅高达463%,随后又再次整体提价5%;阿里云平头哥真武810E等算力卡产品上调5%~34%,百度智能云相关服务上调5%~30%,科大讯飞AI推理服务涨价8%,商汤科技大模型训练费用平均上浮12%📊。更值得关注的是,阿里云已停售百炼Coding Plan Lite基础套餐,仅保留Pro版且每日限量补货、常被秒罄。

模型厂商同样在密集调价。智谱AI今年以来已经三度提价——2月代码套餐涨幅30%起,3月旗舰API上调20%,4月再涨10%,海外版涨幅更高达67%~100%。

行业普遍认为,这标志着大模型API的“低价时代”正式终结,进入了以利润和价值为导向的”价值重估”阶段。究其根源,硬件成本的”逆向”暴涨是核心推手——HBM内存由SK海力士、三星、美光三家垄断,2025年下半年以来涨幅超50%,高端芯片供需紧平衡,2026年一季度存储价格翻倍。需求结构从训练转向推理,AI模型API调用量激增,推理端算力消耗呈持续性增长趋势。云厂商的商业模式也从早期的”烧钱换市场”转向了追求盈利的”商业可持续”阶段。

Token计费全面到来:从”卖算力”到”卖服务” ⛽

伴随算力涨价而来的,是计费模式的彻底变革——Token计费时代的全面到来。

简单来说,以前云厂商卖的是算力(GPU租赁),现在卖的是按Token计量的AI服务。这不仅仅是计价方式的变化,更是整个商业逻辑的转向。大模型就像一个”加油站”,Token就是它的”汽油”——模型参数越多、能力越强,”车辆”跑得越快,汽油消耗也就越多。

艾媒咨询数据显示,2025年中国词元调用总量高达24619.3万亿次,预计2026年将增至111799.5万亿次,2030年进一步攀升至7046680.4万亿次,复合增长率达210%📊。国家数据局此前披露,中国日均词元调用量已从2024年初的1000亿次跃升至2026年3月的突破140万亿次,两年增长超千倍。

更关键的变化在于Token消耗的结构本身。OpenAI的公开数据显示,在复杂Agent任务中,约85-90%的Token消耗来自工具调用而非模型本身的思考链。这意味着,Token消耗的大头不再是”模型在思考”,而是”模型在干活”——反复调用外部工具、检索数据库、执行多步骤任务。模型规模越大,AI能干的事越多、干得越勤,消耗的Token自然也越多⚡。

这种结构性转变对整个产业链产生了深远影响。一方面,AI原生企业直接受益于Token成本的优化——元大证券指出,DeepSeek V4-Flash的低定价对AI应用层开发商构成显著成本利好,有利于SaaS类公司加速AI能力内嵌。另一方面,纯模型API创业公司的生存空间被急剧挤压——据IT桔子统计,2026年一季度已有超过10家AI应用初创公司停止运营或转型。头部大厂和AI独角兽依靠自有算力储备和长协价,成本上涨幅度远低于中小企业,马太效应正在加速行业洗牌。

国产芯片强势接棒:华为昇腾950PR量产,阿里巴巴、字节、腾讯已下单数十万颗 🇨🇳

与此同时,算力供给端的格局也在发生微妙变化。华为昇腾950PR推理芯片已实现量产,单卡算力达到英伟达对华特供版H20的2.87倍,阿里巴巴、字节跳动、腾讯已向华为下单数十万颗昇腾芯片。华为计划今年出货约75万颗昇腾950PR,样品已于1月发送给客户,下半年全面出货。在FP4低精度推理场景下,国产芯片展现出超越通用GPU的效率。

DeepSeek V4的发布进一步强化了国产算力适配的势头——华为昇腾、寒武纪、海光信息等国产芯片厂商同步宣布对V4的Day-0适配,第一次在旗舰模型上实现了国产芯片与海外GPU的并行验证✅。市场反应也相当热烈:短短半天,华丰科技暴涨12%,海光信息飙升超11%,杰华特大涨16%📈。

华为还计划在2026年四季度发布Atlas 950超节点,支持8192颗昇腾950DT芯片,总算力是英伟达NVL144的6.7倍,内存容量是其15倍。下半年昇腾950超节点批量上市后,Pro版API价格还有望大幅下调。

DeepSeek V4像一个”放大器”:参数在放大,成本压力也同样在放大 🔍

V4的发布,最终像一个”放大器”,将AI产业的成本重构与竞争分化效应推向了极致。

对于应用层来说,V4的低价更像是一场及时雨,加速了AI能力在SaaS层面的渗透,有望催生下一波AI原生应用的爆发。但对于模型层的纯API公司而言,其生存空间正被模型厂商之间的价格博弈所挤压。随着AI自主执行任务的能力快速提升,Token消耗量将持续增长,算力需求只会越来越多。

当然,市场对AI泡沫的担忧也在升温。高盛2026年最新报告指出,AI投资热潮背后已浮现泡沫影子,2025年至2027年美国头部科技巨头在AI基建方面的资本开支预计高达1.4万亿美元,但平均回报率远低于市场预期。穆迪甚至预测了一个极端场景:AI收入增速一旦不及预期,恐慌性抛售可能导致股市暴跌25%,蒸发20万亿美元💭。但也有观点认为,目前谈论AI泡沫论为时尚早,算力基建仍是共识度最高的方向。正如中芯国际赵海军所警示的,当前主流AI芯片的实际有效寿命可能仅为两至三年,一旦算力需求增长不及预期,前期巨额投入将难以通过运营回收。

DeepSeek V4的发布,恰好是这一矛盾最清晰的注脚。大模型的能力越强,消耗的Token就越多;Token需求越大,算力就越稀缺;算力越稀缺,成本压力就越大。技术向前走,成本也向上涨。这既是机遇,也是DeepSeek V4留给整个AI行业最深刻的一道思考题。

⚠️ 风险提示:本文内容仅作为行业信息分享,不构成任何投资建议。人工智能行业技术迭代快速,相关企业面临市场竞争加剧、技术路线变更、商业模式不确定性等风险。大模型API价格上涨可能对中小企业经营造成压力,投资者应充分了解相关风险,独立做出投资决策。

夜雨聆风

夜雨聆风