AI时代的新型犯罪和预防——基于全球典型案例的深度分析

【摘要】 随着人工智能技术的快速发展,AI犯罪已成为全球性的严峻挑战。

本文基于近年来全球范围内20余起典型AI犯罪案例,系统分析了深度伪造诈骗、语音克隆、AI生成恶意代码、虚假信息造谣、色情内容伪造等六大类新型犯罪形态,并的预防策略进行了思考。

研究表明,AI技术正在大幅降低犯罪门槛,使”技术小白”也能实施复杂的网络犯罪,这对现有法律体系和社会信任机制提出了前所未有的挑战。

一、引言:当AI成为犯罪的”帮凶”

2024年2月,香港一家跨国公司发生了一起震惊全球的AI诈骗案。诈骗分子利用深度伪造(Deepfake)技术,成功伪造了公司CFO及多名高管的形象和声音,在一场”视频会议”中骗取了2亿港元。

令人震惊的是,参会职员看到的每一个人、听到的每一个声音,都是AI精心伪造的。这起案件标志着AI犯罪进入了”多人变脸”的新阶段,也彻底击碎了”眼见为实”的传统认知。

这只是AI时代新型犯罪的冰山一角。从语音克隆诈骗老人,到AI生成虚假新闻误导公众;从利用ChatGPT编写恶意代码,到批量伪造色情内容侵害未成年人——AI技术正在被犯罪分子广泛滥用,形成了一条完整的”AI犯罪产业链”。

本文将深入剖析AI时代六大类新型犯罪形态,结合真实案例揭示其作案手法、技术原理和社会危害,并提出切实可行的预防建议,帮助个人和企业提高防范意识,在享受AI技术便利的同时,有效规避风险。

二、AI时代六大新型犯罪类型

(一)深度伪造(Deepfake)诈骗——”眼见不再为实”

-

犯罪特征

深度伪造技术利用深度学习算法,可以将一个人的面部特征和声音完美地”移植”到另一个人身上,生成逼真的虚假视频。犯罪分子利用这一技术,冒充企业高管、政府领导、亲朋好友等身份,通过视频通话实施诈骗。

-

典型案例

2024年2月,香港奥雅纳(Arup)公司遭遇深度伪造诈骗,诈骗金额高达2亿港元。

诈骗者通过公司的YouTube视频和公开渠道获取高管音视频资料,利用Deepfake技术伪造英国总部CFO及多名高管的形象和声音,在视频会议中指令职员转账15次。

这是香港历史上损失最惨重的’变脸’诈骗案,也是首次涉及AI’多人变脸’的案件。——来源:澎湃新闻

另一个典型案例是2024年7月上海静安法院判决的全国首例AI换脸诈骗案。犯罪嫌疑人利用深度伪造技术冒充受害人的闺蜜,通过视频通话5分钟内骗走230万元。

-

危害分析

深度伪造诈骗的危害在于其高度的欺骗性。传统的电话诈骗、短信诈骗容易被识破,但视频通话具有天然的”可信度”。

当受害者”亲眼看到”对方的面容,”亲耳听到”对方的声音时,警惕心理会大幅降低。这种”眼见为实”的心理弱点,正是深度伪造诈骗得以成功的关键。

4.法律后果

以上案例上海市静安法院判处了被告人有期徒刑十二年,但是本案所引发的思考却不止于此。

滥用技术的责任追究,个人生物信息的非法获取等问题仍然没有得到解决,犯罪过程中必然包含了非法侵入计算机信息系统、非法获取计算机数据等犯罪问题。仅对末端犯罪进行处理,无法从根源上解决此类问题。

(二)AI语音克隆诈骗——”熟悉的声音可能是陷阱”

-

犯罪特征

AI语音克隆技术可以在短时间内复制一个人的声音特征,包括语调、语速、口音、口头禅等。犯罪分子通过骚扰电话、社交平台等渠道采集目标人物的声音样本,然后利用AI工具克隆声音,冒充亲人、领导等实施诈骗。

-

典型案例

2025年12月,湖北省黄石市黄石港区人民法院审理了一起AI拟声诈骗案。

诈骗分子利用AI语音合成技术,1:1复刻老人孙子的声音,连语气停顿、口头禅都模仿到位。他们编造’打架赔款”车祸私了”被抓需保释’等紧急场景,制造恐慌心理,诱导三名老人现金转账数万元。——来源:央视网

据公安部统计,2025年上半年全国AI语音克隆诈骗案件已超过200起。技术门槛极低——仅需15秒音频即可克隆高度逼真的人声,5秒内完成声音复制。

-

犯罪产业链

AI语音诈骗已形成完整的地下产业链:上游负责采集声纹数据(通过高频骚扰电话、社交工程等),中游提供语音克隆技术服务,下游实施精准诈骗。老年人因其辨别能力较弱、对孙辈的担忧心理强,成为重点攻击目标。

(三)AI生成恶意代码与网络攻击——”技术小白的黑客工具”

-

犯罪特征

以ChatGPT为代表的大语言模型具有强大的代码生成能力。犯罪分子通过特定的”提示词工程”(Prompt Engineering),可以绕过AI的安全限制,生成恶意软件、钓鱼邮件、攻击脚本等。这使得不具备专业编程技能的”脚本小子”也能实施复杂的网络攻击。

-

典型案例

2025年1月,日本大阪一名17岁高中男生利用ChatGPT窃取约725万条用户数据。该学生通过特定话术引导AI编写攻击代码,将恶意请求拆解、伪装、分步进行,成功绕过了AI的安全限制。

他利用生成的恶意程序突破了日本最大连锁网咖’快活CLUB’的服务器防护,窃取了包括姓名、住址、电话、信用卡信息在内的会员数据。犯罪动机竟是为了获取信用卡信息购买宝可梦卡片。——来源:腾讯新闻

此外,多国国家级黑客组织(APT)也被曝光滥用ChatGPT编写钓鱼邮件、生成恶意软件代码,使攻击成功率较传统方式提升3倍。

-

案件意义

这起案件标志着”AI平民化黑客”时代的到来。以往需要数年编程经验才能完成的攻击,现在只需懂得如何与AI对话即可实现。这大幅降低了网络犯罪的门槛,对网络安全构成了前所未有的威胁。

4.法律后果

按照我国现行法律,可以以非法侵入计算机信息系统罪、非法获取计算机信息系统数据、非法控制计算机信息系统罪、提供侵入、非法控制计算机信息系统程序、工具罪,破坏计算机信息系统,侵犯公民个人信息罪等罪名予以处罚。

(四)AI生成虚假信息造谣——”一键生成的新闻危机”

-

犯罪特征

AI工具可以快速生成包含时间、地点、人物、事件的”新闻”文本,以及逼真的虚假图片和视频。犯罪分子利用这些工具批量制造谣言,蹭社会热点赚取流量,甚至故意制造社会恐慌。

-

典型案例

2024年4月,公安部通报了一起AI批量造谣牟利案。江西男子王某江经营5家MCN机构,运营自媒体账号842个,组织团队利用AI工具批量生成虚假消息。

单日产量高达4000至7000篇,单条最高收入700元,日均收入超1万元。AI造谣已形成产业化牟利手段。——来源:腾讯新闻

另一典型案例是2025年3月的”顶流男星境外豪赌输光十亿身价”虚假新闻。该新闻由网友利用AI工具生成,在微博、小红书等平台迅速发酵,阅读量突破5亿,严重误导了公众。

-

识别要点

AI生成的虚假信息往往有以下破绽:文本内容缺乏深度细节、逻辑不够严密;图片中人物可能出现手指数量异常(如6根手指)、文字拼写错误(如好莱坞标志牌多了字母)等。但这些破绽在信息传播的高速节奏中很容易被忽视。

4.法律后果:

依照我国现行法律,可以依据《刑法》第二百九十一条之二编造、故意传播虚假信息罪、第二百九十三条寻衅滋事罪等依法追究行为者法律责任。

(五)AI生成色情内容犯罪——”数字时代的性暴力”

-

犯罪特征

利用深度伪造技术,犯罪分子可以将普通人的头像合成到色情视频中,或将 celebrity 的面容移植到色情内容中。这种”数字性暴力”不仅侵犯人格尊严,还对受害者造成严重的精神伤害。

-

典型案例

2024年8月,韩国Telegram平台爆发大规模深度伪造色情丑闻。多个聊天群制作传播未成年人深度伪造色情内容,受害者覆盖百余所中小学及国际学校,总数达22万人,引发全国性抗议浪潮。这是韩国历史上规模最大的数字性犯罪之一。——来源:搜狐

另一个案例是2024年8月流传的”某顶流女星”色情视频,24小时内播放量破亿,后经证实为深度伪造技术制作的虚假视频。

-

法律后果

2026年2月,张家港市人民法院宣判了AI换脸造黄谣获刑案,这是全国范围内依法严惩AI技术滥用型网络犯罪的标志性判例。

明确了生成式人工智能的法律边界,表明AI换脸造黄谣将被追究刑事责任。值得注意的是该案因程度问题,仅以诽谤罪定罪量刑。

但AI合成色情剧情予以传播牟利的,还可能构成第三百六十三条制作、传播淫秽物品牟利罪,第三百六十四条传播淫秽物品罪等。

(六)AI投资诈骗——”高科技包装的庞氏骗局”

-

犯罪特征

不法分子打着”AI智能投资””AI量化交易”的旗号,宣称运用先进的人工智能技术精准分析市场趋势,承诺高收益回报。实际上,这些往往是披着科技外衣的庞氏骗局。

-

典型案例

2025年4月,张女士在浏览网页时发现了一款所谓’AI智能投资助手’应用,声称能精准分析市场趋势,为用户推荐高收益投资项目。她被宣传内容吸引下载应用,填写了银行账号、身份证号等敏感信息,结果被骗取大量资金。——来源:河北金融监管局

这类诈骗利用了公众对AI技术的好奇和信任,以及想要”蹭上AI快车”的投资心理。实际上,任何投资都存在风险,AI技术虽然能提高分析效率,但并不能保证高收益。

3.法律后果

此类案件属于老生常谈,老配方新场景。AI只是幌子、“噱头”,本质上仍然是融资类的违法犯罪活动,是传销、非法吸收公众存款、集资诈骗行为的新应用场景,依法构成传销罪、非法吸收公众存款罪、集资诈骗罪。

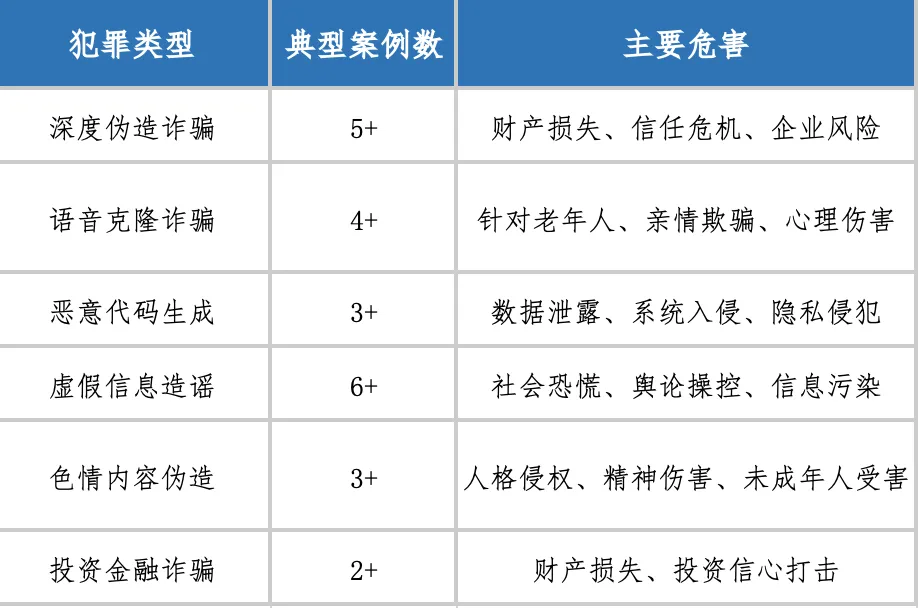

三、AI犯罪数据统计与趋势分析

(一)全球AI犯罪类型分布

(二)AI犯罪的五大趋势

-

犯罪门槛持续降低:AI工具的普及使”技术小白”也能实施复杂犯罪,从”专业人士专属”变成”人人可及”。 -

犯罪成本大幅下降:传统诈骗需要大量人力物力,AI可以实现自动化、批量化、规模化作案。 -

欺骗性显著增强:深度伪造、语音克隆等技术使假内容”以假乱真”,突破了”眼见为实”的认知防线。 -

产业化程度加深:形成”数据采集-技术服务-精准诈骗”的完整产业链,专业化、分工化趋势明显。 -

跨境特征日益突出:利用AI的匿名性和跨国性,犯罪分子可以远程实施攻击,增加了追查和打击难度。

四、AI犯罪的预防策略

(一)个人防护指南

-

防范深度伪造和语音诈骗

• 视频通话验证:涉及转账时,要求对方做特定动作(如转头、闭眼、比手势)或回答私密问题,AI伪造视频往往难以实时响应动态指令。

• 多重验证机制:重要操作采用”视频+电话+短信”多因素验证,不要仅依赖单一渠道。

• 警惕紧急要求:凡是制造紧迫感的要求(如”限时转账””立即汇款”)都应提高警惕,诈骗利用的往往就是你慌乱的心理。

-

保护个人生物特征信息

• 谨慎分享照片、视频、语音等生物特征信息,特别是在社交媒体公开发布高清正面照。

• 对于视频通话软件,了解其隐私设置,避免不必要的摄像头和麦克风权限开放。

• 定期检查自己在互联网上的”数字足迹”,及时删除不必要的个人信息。

-

识别虚假信息

• 核实信息来源:对网络热点新闻,通过官方渠道、权威媒体进行核实,不轻信自媒体。

• 关注细节破绽:AI生成内容常有异常,如人物手指数量不对、文字拼写错误、光影不自然等。

• 保持理性判断:对过于 sensational(耸人听闻)的内容保持怀疑,诈骗往往利用情绪操控。

(二)企业防护建议

-

部署AI内容检测工具:使用专门的深度伪造检测软件,对视频会议、语音通话进行实时监测。 -

建立严格的财务安全流程:大额转账采用”线下确认+多重审批”机制,禁止仅凭视频通话指令转账。 -

加强员工安全意识培训:定期开展AI诈骗防范培训,提高员工对新型诈骗手段的识别能力。 -

控制公开信息泄露:限制高管音视频资料的公开传播,YouTube等平台上的宣传视频应权衡利弊。

(三)法律与技术应对

• 加大惩治力度和加快立法步伐:立足现行法律对目前已经出现的问题进行概括总结,出台相应的司法解释、确立典型案例。相信不久的将来,类似于拒不履行信息网络安全管理义务罪、非法利用信息网络罪等一些相对比较陌生的罪名会一一呈现在大家的面前。

• 加快AI相关立法,明确AI生成内容的标识要求和平台的合规责任,

• 强化平台的监管和责任划分:AI服务提供商需要加强安全护栏设计,防止技术被恶意滥用。

• 建立跨国执法协作机制:AI犯罪的跨境特征要求各国加强司法协作,建立信息共享和联合打击机制。

五、结语:让AI处于被监管的状态

人工智能是一把双刃剑。它在为我们带来便利和效率的同时,也为犯罪分子提供了新的工具。从香港的2亿港元诈骗案,到韩国的22万受害者色情丑闻,AI犯罪的危害触目惊心。

技术本身是中性的,关键在于如何使用,同时也要防止技术被滥用。因此通过完善法律制度、加强技术防护、提高安全意识,我们完全可以在享受AI红利的同时,有效防范其风险。

在这个”眼见不再为实”的AI时代,作为法律从业者,我们需要思考所产生的新问题和解决问题的新思路。提高警惕、积极监管、落实责任、明确后果。

技术本身无罪,但使用技术的人有责任。在AI技术日新月异的时代,如何制定更好的监管方法是对法律人全新的挑战。

参考资料

本文基于以下权威来源的公开报道整理:

• 澎湃新闻(https://www.thepaper.cn)

• 央视网(https://news.cctv.com)

• 腾讯新闻(https://news.qq.com)

• 世界经济论坛(https://www.weforum.org)

• 河北金融监管局(https://www.hebiia.org)

• 张家港市公安局(https://www.zjg.gov.cn)

—— 全文完 ——

夜雨聆风

夜雨聆风