那个一不小心就烧掉几万美元的 AI 工具,终于出了个“保命开关”

如果你最近一直在盯着 AI Coding 产品,很容易把注意力继续放在模型榜单、长上下文、自动改代码成功率这些熟悉的指标上。但 Claude Code 这一轮更新真正值得 LLM Agent 开发者认真看的地方,并不在“它又更强了一点”,而在“它终于开始把 agent runtime 里最难落地、最容易失控、也最容易被企业否掉的那部分问题,做成了显式能力”。

说得更直白一点,这次 changelog 传递出的不是一个“能力继续上探”的信号,而是一个“系统开始成熟”的信号。对做 agent 的人来说,这里面最有价值的不是某个单点技巧,而是 Claude Code 开始把成本路由、多云兼容、事件观测、会话恢复、工具发现这些过去常常散落在平台层和工程规范里的能力,往产品面上提。

这很重要。因为 LLM Agent 的问题从来不只是能不能完成一次任务,而是能不能在长会话、多工具、多环境、多人协作、预算受限、运维可追责的条件下,持续稳定地完成任务。前一个问题解决的是 demo,后一个问题解决的才是 deployment。

而当另一篇关于 AI 经济账的分析,已经把行业现实说得足够刺耳之后,这次更新就更像一种主动校正。那篇文章把整个行业的尴尬揭得很开:订阅制在 agent 式使用场景下越来越难掩盖真实 token 成本,GitHub Copilot 转向按用量计费不是偶然,Claude Code 文档里给出的企业部署平均成本也已经来到每位开发者每个活跃日约 13 美元、90% 用户低于 30 美元。这些数字一旦映射到团队规模,立刻就不再是“好不好用”的问题,而是“这个 agent 系统有没有控制面”的问题。

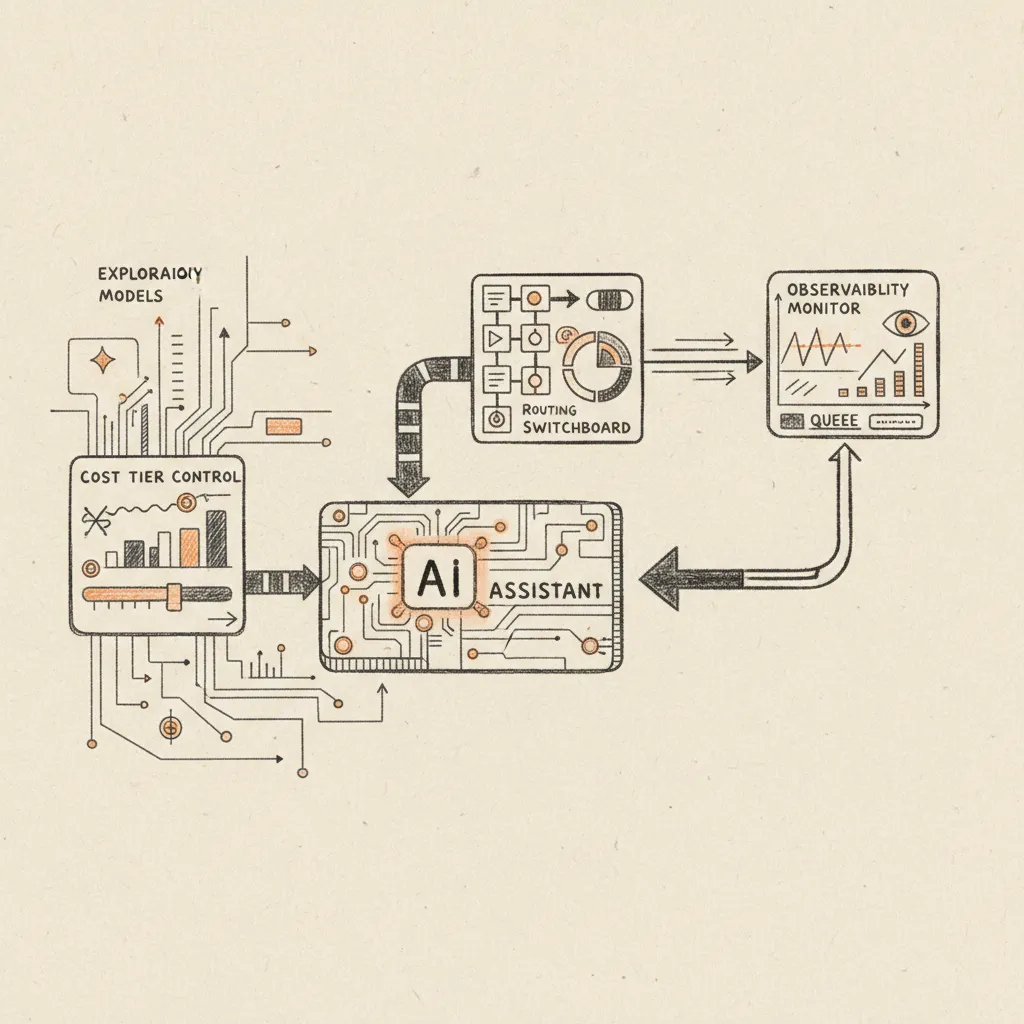

第一层变化:Claude Code 开始把 agent 的模型调用,从黑盒能力变成可路由资源

这次最值得单独圈出来的更新,毫无疑问是 ANTHROPIC_BEDROCK_SERVICE_TIER。新增这个环境变量后,用户可以在 Bedrock 上显式选择 default、flex 或 priority 三种 service tier,并通过 X-Amzn-Bedrock-Service-Tier 请求头把选择送入调用链路。

如果你只把它看成一个云厂商参数,那就低估了它。对 LLM Agent 开发者来说,这其实是在把“模型调用策略”第一次正式做成“运行时策略接口”。

过去很多 coding agent 的默认假设都很相似:只要任务足够重要,就尽量给最强模型、最长上下文、最完整工具链,然后把成本留给订阅方案或者后台补贴去吞。这个阶段能跑通体验,但撑不起组织化部署。因为一旦进入真实工程环境,你很快就会遇到四个问题。

第一,不同任务根本不该消耗同一档算力。生成 commit message、整理变更摘要、跑一次 PR 上下文恢复,和做大规模代码迁移、复杂 refactor 规划、跨工具链调试,根本不是同一类 workload。

第二,不同用户角色也不该共享同一条成本通道。有人做高价值生产任务,有人做探索性试验,有人只是偶发提问;如果全部默认走高成本路径,账单迟早失控。

第三,agent 的成本峰值不是线性的。真正花钱的不是一句问答,而是长会话、多轮规划、反复 tool use、大上下文回填和失败重试叠加后的整条执行链路。

第四,没有显式路由,就没有治理入口。你无法建立团队级别的 policy,也无法把 FinOps、SRE 和平台工程关心的问题接到 agent runtime 上。

service tier 的意义,就在于 Claude Code 现在明确承认:agent 不应该只是“尽可能调用最强模型”,而应该允许开发者和企业把不同工作负载映射到不同成本与时延等级上。对于做 agent framework、agent platform、agent IDE integration 的人来说,这是一种非常关键的产品信号。

因为一旦底层模型提供方和上层产品都开始显式暴露 tier,下一步很自然就会走向更完整的 routing policy:

-

什么任务走 priority,什么任务走default -

哪些操作在预算紧张时自动降到 flex -

哪些用户组具备高优先级配额 -

哪些长会话要根据 token burn rate 自动切换策略 -

哪些后台自动化任务只允许在低成本层执行

这背后不是一个参数问题,而是 agent runtime 从“能力导向”走向“调度导向”。

而这恰好呼应了那篇《AI 的经济账根本算不通》里最刺痛行业的一点:过去所有人都在享受被补贴的智能,直到账单开始回到产品层。文章里拿 Copilot 的按用量计费转向、Anthropic 与 OpenAI 对企业客户的收费现实、以及 Claude Code 每位开发者每天 13 到 30 美元的成本区间做了非常直接的说明。对 agent 开发者而言,这不是行业八卦,而是架构约束。你不把成本控制做成路由能力,迟早就会在生产环境里被成本反噬。

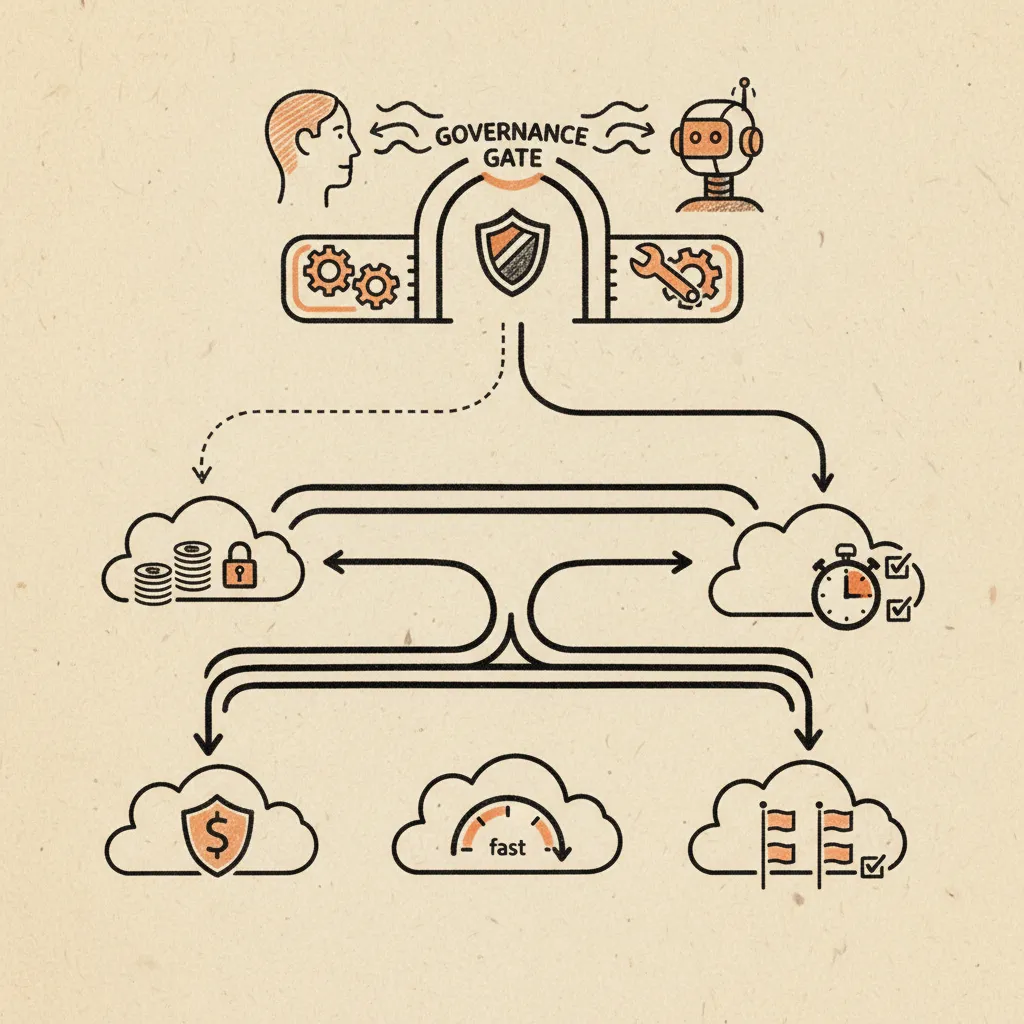

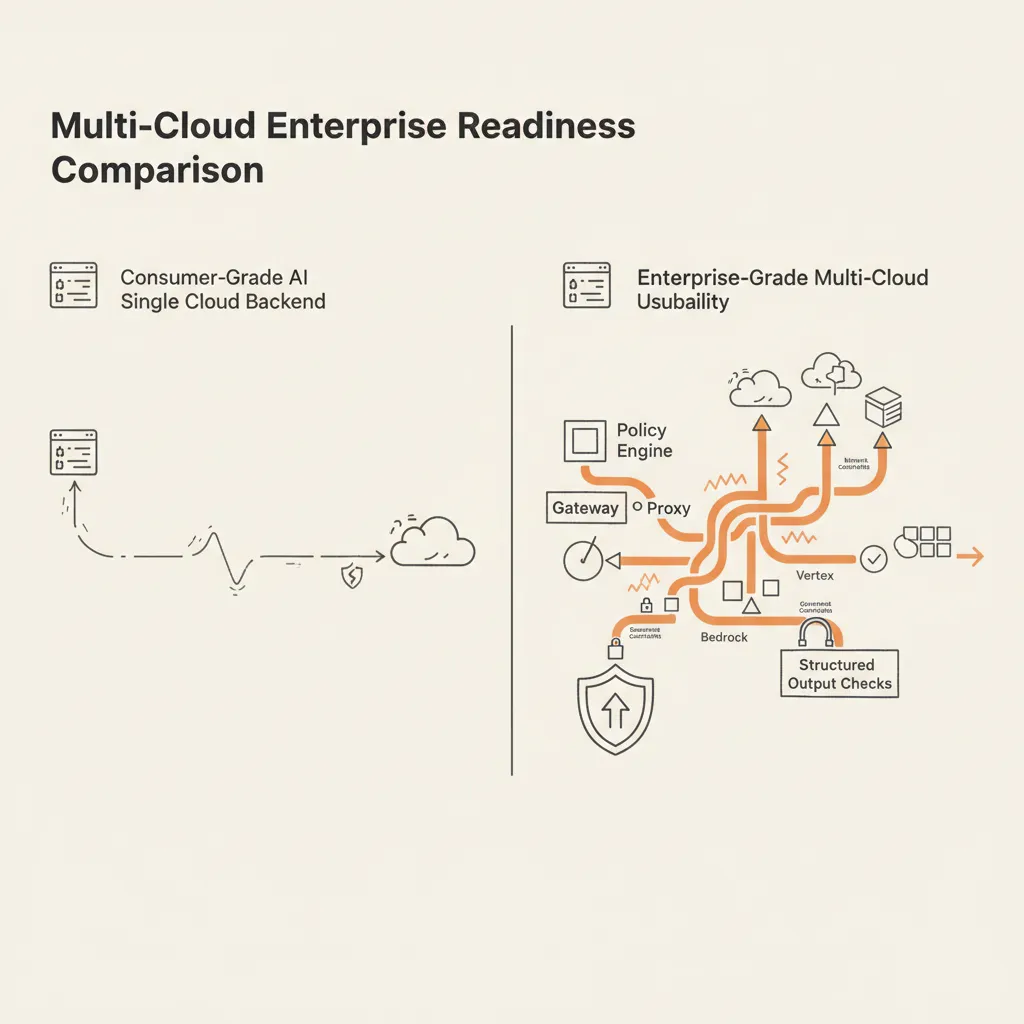

第二层变化:它修的不是云兼容 bug,而是 agent 系统接入企业现网前必须跨过的适配断点

如果说 service tier 解决的是“该不该花这笔钱”,那同一批关于 Bedrock 和 Vertex AI 的修复,解决的就是“这个 agent 系统能不能在企业现场活下来”。

这次 changelog 里几条看起来偏底层的修复,拼在一起特别有代表性。

/model 之前对 Bedrock application inference profile ARN 不显示 Effort 选项,也没有把 output_config.effort 正确传下去;Vertex AI 和 Bedrock 在 session title 生成及其他 structured output 查询上,曾返回 invalid_request_error: output_config: Extra inputs are not permitted;Vertex AI 的 count_tokens endpoint 在代理网关后面会报 400。

如果你是做单机场景的 agent demo,这些问题最多算兼容性边角料。但如果你做的是可进入组织环境的 agent 系统,这些都不是小问题。

因为真实企业环境里的 agent,不是裸奔连一个公开 API。它通常要穿过云账号体系、代理网关、网络出口控制、区域策略、日志审计、配额系统、身份管理,最后才落到模型请求上。越是长生命周期、会自己调工具、会拉长上下文、还要和内部平台对接的 agent,这种基础设施适配越不是附属品,而是主干工程。

其中最典型的是 structured output 兼容。很多 agent 工作流今天都建立在结构化输出之上:计划分解、工具选择、补全 schema、任务摘要、会话标题、状态抽取、交接上下文,背后本质上都是“让模型按结构产出可消费结果”。一旦 Bedrock 或 Vertex 在某些路径上因为 output_config 参数不兼容而报错,这种故障表面发生在一个小接口,实际破坏的是整条 agent orchestration pipeline 的稳定性。

再比如 count_tokens 在代理网关后的 400 错误。很多团队现在已经不是直接把 agent 接到模型 API,而是会放在统一网关、统一认证、统一观测层之后。token counting 本来就越来越重要,因为它关系到预估成本、上下文裁剪、预算守卫、任务拆分、以及是否应该继续长会话。如果 token 统计在企业网关后不稳定,很多 agent runtime 的关键控制逻辑就没有可靠地基。

还有 Effort 参数展示和透传的问题,这也不是 UI 细节。做 agent 的人都知道,只要系统开始支持多模型、多 profile、多 provider,你最终一定会碰到“同一个抽象参数在不同后端上能否真实生效”的问题。如果参数只在界面上看得到、或者在路由层被吞掉,那你以为自己在调 agent 推理强度,实际上只是改了一个幻觉配置。

所以这批修复最关键的地方,在于它释放了一个很现实的产品方向:Claude Code 开始从“接得上多个云”走向“在多云与代理现实里具备真正可用性”。这对 LLM Agent 开发者是重要参考,因为下一阶段竞争不会只看谁能 orchestrate 更多工具,而会看谁能以更低接入摩擦进入客户既有系统。

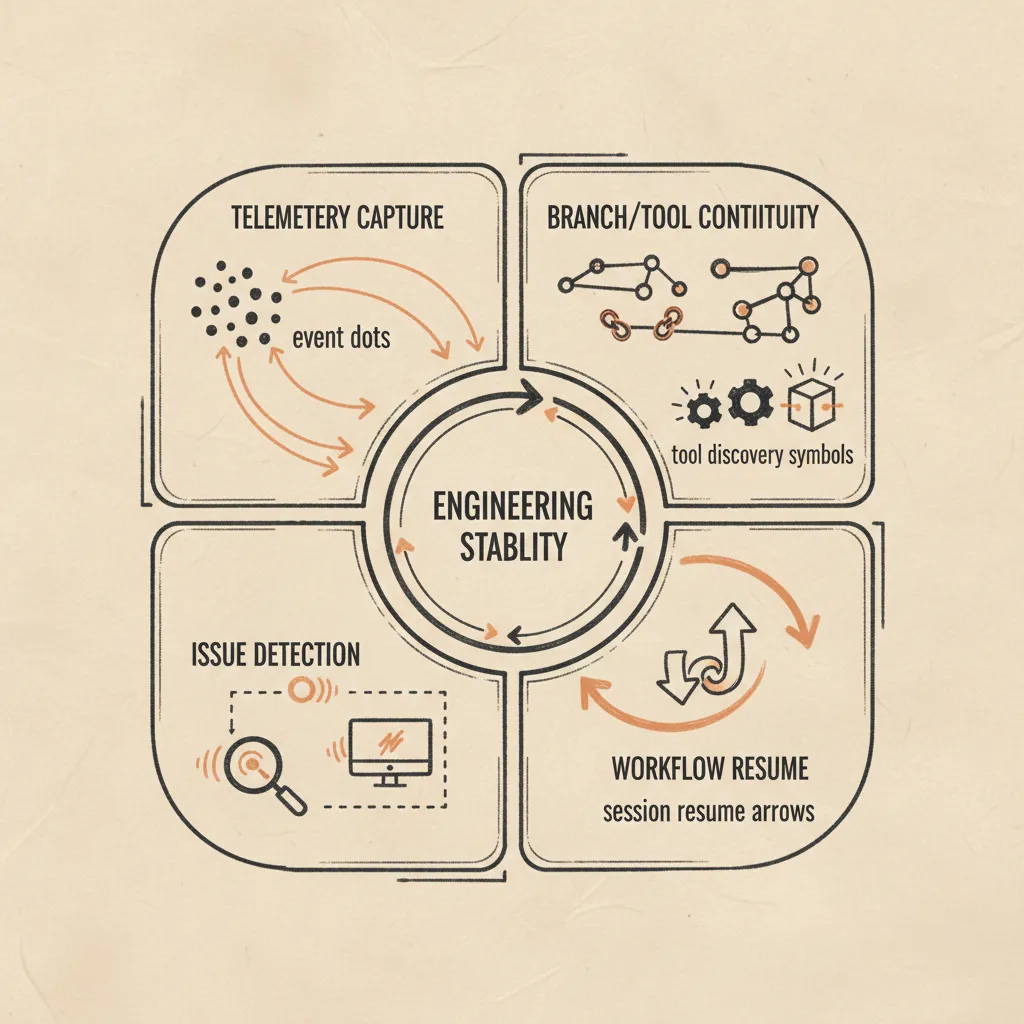

第三层变化:Claude Code 开始把 observability 当成 agent 可靠性的正经组成部分

很多人讨论 agent 还停留在“它能不能做更复杂的事”。但一旦你真的把 agent 放进开发流程,问题会迅速变成另外一套。

为什么这次任务突然贵了两倍?

为什么某类 structured output 总在特定 provider 上失败?

为什么某个 @ mention 解析错了,结果调用错工具?

为什么会话看起来空白,但后台其实执行过?

为什么接进来的 MCP 工具在某些 session 里消失?

为什么远程环境下控制管道被刷爆,导致终端不可用?

这些都不是“模型聪不聪明”的问题,而是 agent 系统有没有可排障性的问答。

这次 OpenTelemetry 相关更新就很值得注意。api_request 和 api_error 事件里的数值属性现在会按数字而不是字符串发出,同时新增了 claude_code.at_mention 日志事件,用来记录 @ mention 的解析。

对普通用户来说,这类更新几乎不会成为 headline;但对做 agent runtime、trace pipeline、tool invocation telemetry 的人来说,这恰恰是最有价值的部分。因为一旦数值属性被正确类型化,你才能更容易把延迟、token、错误率、重试次数、体积等指标接进现有观测系统,做聚合分析、阈值告警和成本归因。否则很多看似有日志的数据,实际上很难用于真正的运维分析。

claude_code.at_mention 更说明问题。Agent 不是只和模型交互,它还要解析用户意图、工具引用、上下文对象、环境状态。@ mention 解析记录看起来很小,但它意味着某些过去只能猜的行为,现在可以被追踪、比对和定位。这是典型的 agent 行为可观测性补丁。

再看其他修复,也都很像在补“运维可解释性”的地基:

-

远程控制会话空闲状态重复重绘、可能淹没 tmux -CC控制管道的问题被修掉了 -

ToolSearch漏掉会话启动后才连接上的 MCP 工具的问题被修掉了 -

settings.json里单个 malformed hooks 条目不再拖垮整个配置文件 -

助手消息偶发空白被修掉了 -

!exit/!quit在 bash 模式下不再错误终止 CLI

这些修复放在 agent 语境下看,几乎都指向同一件事:系统开始承认真实开发现场是脏的、长的、异步的、会漂移的,而且工具接入和会话状态不可能永远保持理想形态。

真正能在生产里活下来的 agent,不是没有异常的 agent,而是出现异常时你知道它在哪一层坏了、为什么坏了、代价是什么、要怎么恢复。Claude Code 这次对遥测和稳定性的投入,等于是在说它想从“强大的 coding assistant”继续往“可以被平台团队接管的 agent 系统”走。

第四层变化:它终于开始认真处理 agent workflow 的连续性,而不是只做一次性会话

Agent 产品有一个常见错觉:只要单次任务表现够好,用户自然会把它纳入工作流。现实并不是这样。

对重度开发者和 agent 平台团队来说,真正有价值的是连续性,不是单点魔法。一次聪明回答没有那么稀缺,能跨会话、跨分支、跨 PR、跨平台把上下文接回来的系统,才是流程级资产。

这次 /resume 支持直接粘贴 PR URL 来找回创建该 PR 的会话,而且覆盖 GitHub、GitHub Enterprise、GitLab 和 Bitbucket,这个改动就非常值得重视。因为它补的是一个很具体但很常见的断点:代码协作对象和 agent 会话对象,过去经常是脱节的。

一旦你开始让 agent 参与真实开发,就会发现 PR 才是团队实际协作的核心单位之一。讨论、回滚、补丁、继续推进、交接上下文,很多事情并不是围绕“某一次 prompt”发生,而是围绕“某一个 PR”发生。能通过 PR URL 找回原会话,等于是在补 agent memory 和代码协作系统之间的一层索引。

对做 agent 的人来说,这是非常值得学习的产品设计。因为很多人都在做长期记忆、任务恢复、会话摘要,但如果这些能力不能挂到开发者真实使用的对象上,比如 PR、branch、issue、deployment、runbook,它们就很难真的变成工作流组成部分。

/branch 的修复也同样重要。之前在回溯时间线场景下会生成坏 fork,并触发“tool_use ids were found without tool_result blocks”这种失败。这个问题表面上像一次分支 bug,实质上更像长生命周期 agent 会话在复杂历史演进中的一致性问题。换句话说,系统不只是要会执行任务,还要能正确维护任务历史。

对 agent 开发者来说,这一点格外关键。因为只要你做的是带工具调用的会话系统,就会不断碰到执行图、消息图、状态快照、工具结果引用、回溯恢复这些问题。单次成功率很容易演示,但时间线一致性、引用完整性、恢复后的可继续执行性,才是决定系统能否在真实工程环境里长期使用的部分。

为什么这一轮更新,对 LLM Agent 开发者尤其值得重视

如果把这些更新拆开看,它们都不算那种会在社交媒体上爆炸传播的大功能。没有一个点像“从零写完整应用”那么戏剧化,也没有一个点像“百万上下文”那么适合当 headline。

但如果你把这些变化合起来看,会发现它们几乎覆盖了 agent 工程化落地最关键的四个控制面。

第一,成本控制面。ANTHROPIC_BEDROCK_SERVICE_TIER 把模型调用从黑盒体验,推向可配置、可路由、可纳入预算策略的资源调度。

第二,接入控制面。Bedrock 和 Vertex AI 的一串修复,说明 Claude Code 在处理真实多云、多代理、多兼容性断点,而不是停留在默认托管环境的顺滑体验里。

第三,运维控制面。OpenTelemetry 数值属性修正、claude_code.at_mention 事件补充,以及一系列稳定性修复,都在把 agent 系统变成可以观测、可以审计、可以排障的对象。

第四,工作流控制面。PR URL 恢复会话、/branch 时间线修复、MCP 工具发现修复,说明它开始认真解决“agent 如何嵌进现有开发流程并保持连续性”。

这四件事放在一起,才构成企业真正会采购、平台团队真正会接入、重度开发者真正会持续依赖的 agent 系统。

而这也正好解释了为什么原文一直把那篇《AI 的经济账根本算不通》拉进来做背景。因为行业现在最核心的矛盾,已经不再是“大家相不相信 agent 有用”,而是“agent 的价值能不能穿过成本、治理、现网兼容和组织流程四道门”。

那篇文章提到的很多数字,在这里都不只是舆论素材。Copilot 走向 usage-based billing,说明补贴逻辑正在退场;Claude Code 文档把企业部署平均成本写成每位开发者每个活跃日约 13 美元、90% 用户低于 30 美元,说明产品方自己也开始把真实成本带到台前;而大团队、长会话、复杂工具链路带来的 token 波动,则说明任何没有 policy layer 的 agent 产品,最终都很难避免被问到一句话:谁来控制账单,谁来承担超支,谁来定义高价值任务配额?

从这个角度看,Claude Code 这次真正重要的更新,不是又证明了自己很会写代码,而是开始证明自己理解 agent 系统在企业里为什么常常死在“最后一公里”。

很多人以为 agent 的最后一公里,是生成质量还不够强。

现实往往不是。

最后一公里更常见的死法是:账单不可控、网关不兼容、日志不可查、工作流接不上、会话恢复不稳定、工具发现不完整、配置一个小错误就整套系统失效。

Claude Code 这轮更新最值得高看的一点,就是它开始系统性地修这些死法。

对做 Agent 的人来说,真正的启发是什么

如果你现在正在做 coding agent、研发助手、自动化开发工作流,或者更广义的 LLM Agent 平台,这次 changelog 至少给出三个非常具体的启发。

第一,不要再把模型能力和运行策略绑死。未来成熟的 agent,一定会把 tier、latency、budget、context size、tool depth、retry policy、provider fallback 做成同一层治理问题,而不是七零八落的工程补丁。

第二,不要把多云支持理解成“多接一个 provider”。真正的多云能力,是当结构化输出、token 统计、代理网关、参数透传、身份认证、标题生成、工具调用都穿过企业边界后,系统还能不碎。

第三,别把 observability 当作上线后补课。Agent 的复杂度决定了它天然需要事件、trace、状态、引用关系和恢复路径的可见性。谁先把这件事产品化,谁就更接近企业级 agent。

如果还要再加一句,那就是第四,工作流对象比对话对象更重要。真正能沉淀在组织里的 agent,不是那种“这次回答真神”的工具,而是能围绕 PR、branch、issue、工具链和团队协作对象持续工作的系统。

所以回到最开头,这次 Claude Code 最重要的更新,确实不是“更强了”,而是“开始把企业最在意的成本和路由管起来”,并顺手把多云兼容、可观测性、工作流恢复这些 agent 工程化的关键控制面补了上来。

这不是最耀眼的一类更新。

但对真正做 LLM Agent 的人来说,这可能恰恰是最该认真研究的一类更新。

因为当一个 agent 产品开始认真谈 tier、谈 token、谈 telemetry、谈 proxy gateway、谈会话恢复、谈工具发现时,说明它想解决的已经不是“这次能不能惊艳你”,而是“你敢不敢把它接进真实系统,并且长期依赖它”。

这才是从 AI 工具走向 agent 基础设施的分水岭。

🎁后台回复「Chat」,可领取特供Plus优惠券或者kicode中转额度,先到(优惠额度越高)先得。

ChatGPT Plus订阅优惠使用方法,参考: 2026最新保姆级教程:国内如何低门槛升级ChatGPT Plus?

Cladue/Codex 最性价比使用方式,参考:2026 保姆级教程:国内如何配置并使用codex(全流程图解)

对文章中提到的操作/信息等感兴趣,可加:

夜雨聆风

夜雨聆风