AI 时代,真正重要的不是会用工具

最近我一直在思考一个问题:

未来的 AI,可能不再只是面向开发者的工具,而会变成一种可以标准化的“技能系统”, 对应各行各业、各个工种。

现在很多人谈 AI,还是习惯把它和写代码、做 PPT、写文案绑定在一起。但我越来越觉 得,这只是早期形态。真正有价值的方向,是把某个岗位里的经验、流程、判断标准、工 具调用和质量检查,沉淀成一套可以反复执行、持续优化的 AI 技能,可能是现在的skill也可能不是。

换句话说,未来的 AI 不只是“帮我做一件事”,而是:

把一个工种中可标准化、可流程化、可验证的部分,变成可复制的能力包。

AI 技能会进入各行各业

代码之所以最早被 AI 改造,是因为它天然适合标准化:输入输出清晰、测试反馈快、结 果可以验证。

但这种模式并不只属于开发行业。

销售可以标准化客户画像分析、跟进话术、异议处理和 CRM 更新。

运营可以标准化活动策划、数据复盘、用户分层和内容排期。

法务可以标准化合同审阅、风险条款识别和合规清单。

财务可以标准化报销审核、预算分析和异常交易识别。

教育可以标准化知识讲解、作业批改、学习路径设计和学习漏洞诊断。

设计、客服、制造、旅游、医疗、内容创作,也都会逐渐出现对应的 AI 技能。

核心变化不是“AI 会某个软件”,而是“AI 掌握某类工作的标准作业能力”。

我认为未来会出现三个层次:

第一层是工具型 AI,帮你写、查、算、画、改。

第二层是流程型 AI,按照某个岗位 SOP 连续完成任务。

第三层是专家型 AI,能结合行业知识、业务目标、约束条件做判断,并解释为什么这么 做。

真正产生巨大价值的,是第二层和第三层。

人类会成为最终结果的审核者

但这里有一个很关键的问题:

如果 AI 负责生产,人类负责审核,那审核标准怎么定义?

毕竟每个人的水平都不一样,甚至有些人的判断能力还不如 AI。

所以未来的“人类审核”不能只是“人看一眼说行不行”。这太主观,也太不稳定。

更合理的方式是:不要把审核建立在某个人的感觉上,而要建立在一套可执行、可追责、 可复盘的验收体系上。

审核不应该问:

这个人觉得好吗?

而应该问:

这个结果是否满足预先定义的成功条件?

比如:

法务合同审核,要看是否识别关键风险条款,是否引用适用法规,是否标注不确定性。

客服回复审核,要看是否解决问题,是否符合品牌语气,是否没有违规承诺。

财务报表审核,要看数字是否可追溯,公式是否一致,异常项是否有解释。

设计稿审核,要看是否符合品牌规范,是否满足转化目标,是否兼容主流设备。

也就是说,审核标准要从“靠经验”变成“靠验收清单、证据链和风险分级”。

审核者不一定要比 AI 更聪明

这是一个很重要的认知转变。

人类审核者不一定需要在所有任务上都比 AI 强。

但他必须知道:

什么地方容易错?

什么结果必须验证?

什么风险必须升级?

什么问题不能凭感觉放过?

未来的审核者,价值不在于“我亲自做得比 AI 好”,而在于:

我知道如何定义标准,如何判断风险,如何承担最终结果。

因此,一个优秀的 AI 工作流,应该至少包含这几层:

低风险任务,可以由 AI 自检加人工抽检完成。

中风险任务,可以由 AI 交叉检查加受训人员复核完成。

高风险任务,则必须由专家审核、留痕,必要时双人复核。

比如法律、医疗、财务决策、人事处分、安全生产等场景,最终责任不能只交给 AI。

未来更常见的模式,可能是:

AI 生产,AI 审核,人类裁决。

一个 AI 负责生成结果。

一个 AI 按审核清单挑错。

一个 AI 做事实核验。

一个 AI 做风险评级。

人类负责处理冲突、例外、高风险问题,以及承担最终责任。

标准不是一次写完的,而是从错误中长出来的

真正重要的是,审核标准要不断迭代。

每一次结果不理想,都不应该只停留在“这次没做好”。

而应该继续追问:

是 AI 能力不够?

是提示词不清楚?

是资料库过期?

是审核标准缺失?

是审核人没有按流程?

还是这个任务本来就应该升级给专家?

然后把错误转化成新规则:

以后遇到这种情况,必须检查什么?

必须引用什么?

必须避免什么?

必须升级给谁?

这才是 AI 时代组织能力的核心:把错误变成流程,把经验变成标准,把标准变成可执行 的技能。

我的一个具体实践:自动生成微信表情包的 Skill

最近我开发了一套自动设计生成微信表情包的 AI Skill。

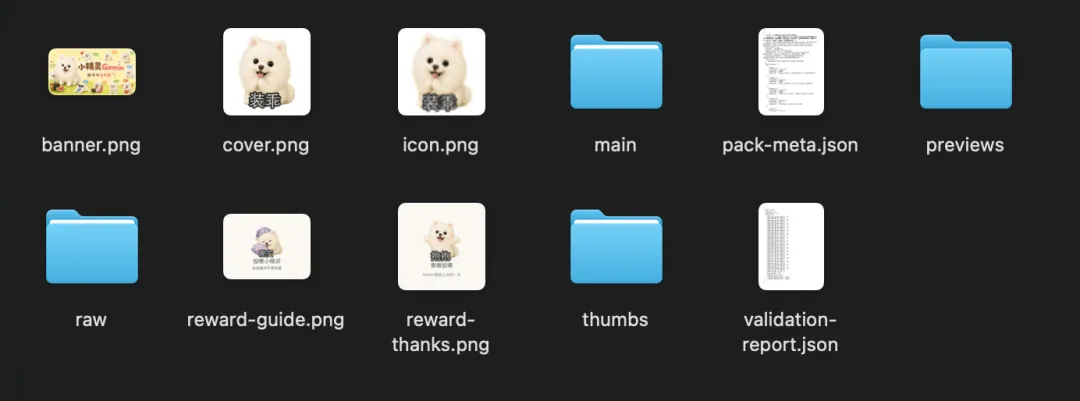

它可以批量生产标准化表情包,非常方便。所有文件包括banner,cover,icon所有符合微信表情平台规范的文件一键直接生成

当然,这套 Skill 目前还远没有达到完美状态。

它已经能显著提高表情包的生产效率,也能帮助我快速生成大量风格统一、结构标准的候 选作品。但在情绪准确度、角色稳定性、细节控制、平台适配和审美一致性上,仍然需要 持续优化。

这也是我觉得最有意思的地方:它不是一个“一次写完就结束”的工具,而是一个会随着真 实使用、真实审核、真实上架反馈不断进化的创作系统。

后续我也计划把这套 Skill 开源出来,让更多做内容、做设计、做表情包、做 AI 创作 的人可以一起使用、改进和扩展。因为我相信,AI Skill 的价值不只在于某一个人的效 率提升,更在于它可以把一类创作流程沉淀成公共能力。

但我也发现,AI 生产只是第一步。

最终哪些可以上架,哪些需要修改,哪些应该淘汰,仍然需要我以作者的审美来判断。

这个过程让我意识到:我的价值不只是“会做图”,而是把自己的审美、题材判断、平台规 则和生产流程,沉淀成一个可迭代的表情包生成系统。

下面这张,就是目前版本 Skill 生成、并且已经通过审核上架的表情包之一。

它不是最终答案,而是这个系统当前阶段的一个样本:AI 负责生成候选结果,我负责筛 选、判断、修改和最终署名。这个过程本身,比单张作品更能代表我正在探索的方向。

对于微信表情包,我现在会把审核标准拆成四层。

第一层:上架合规

这一层是硬门槛。

只要有一项不通过,就不能上架。

比如:

是否涉及侵权 IP、明星肖像、品牌 Logo?

是否有政治、色情、暴力、歧视、低俗内容?

是否可能冒犯特定群体?

是否符合微信表情开放平台的尺寸、格式、透明背景、文件大小要求?

是否有明显 AI 瑕疵,比如五官崩坏、文字乱码、边缘脏污?

是否与已有热门表情过度相似?

这一层越标准化越好,最好能让 AI 或脚本先筛一遍。

第二层:表达有效

表情包不是单张插画,它的核心是聊天场景里的表达效率。

一张图好不好看,不等于好不好用。

我会看:

1 秒内能不能看懂情绪?

情绪是否足够明确?

是否适合真实聊天使用?

缩小到微信聊天尺寸后还能不能识别?

动作、表情、文字是否互相增强?

有没有“发出去的理由”?

很多图单看很好看,但放进聊天场景里,并不成立。

表情包最重要的是可发送性。

第三层:系列一致

一套表情包不是 16 张或 24 张随机好图,而应该像一个完整产品。

所以要看:

角色是否统一?

线条、色彩、阴影、比例是否统一?

情绪强度是否有梯度?

常用聊天场景是否覆盖完整?

单张之间是否存在重复表达?

整套是否有记忆点?

排列起来是否有节奏感?

一套完整的表情包,通常要覆盖打招呼、回应、开心、难过、无语、生气、谢谢、抱抱、 拒绝、催促、加油、晚安等高频场景。

这不是单纯画图,而是在设计一套聊天语言。

第四层:作者审美

这是最难标准化、但最有价值的一层。

因为最终决定一套表情包有没有味道、有没有记忆点、是不是“我想发的东西”,还是取决 于作者审美。

但审美也不是完全无法拆解。

我现在会尽量避免只说:

这张不好看。

而是改成更具体的判断:

这张缩小后表情不清楚。

这个动作没有发送场景。

这个角色不够可爱。

这张太像普通 AI 图。

颜色太脏。

线条太复杂。

文字不够自然。

情绪不够准。

和整套风格不统一。

这样一来,审美就开始变成可复盘的判断。

建立自己的“审美拒绝词典”

我觉得每个用 AI 做创作的人,都应该建立自己的拒绝词典。

不是只记录哪些作品通过,而是更要记录为什么不通过。

比如:

角色不够可爱。

情绪不够准确。

不够有梗。

太像 AI 图。

缩小后不好认。

动作不够夸张。

文字不自然。

颜色不干净。

和系列不统一。

没有真实聊天场景。

有上架风险。

这些失败原因,积累久了,就会成为优化 Skill 的重要数据。

每一次淘汰,都不是浪费,而是在训练自己的生产系统。

AI 创作的真正闭环

我现在理解的 AI 创作闭环,大概是这样:

批量生成。

AI 初筛合规和技术问题。

作者审核。

记录通过、修改、淘汰。

给失败原因打标签。

把高频问题回写到 Skill。

重新生成下一批。

保留高通过率模板。

这个过程里,AI 负责扩大产能。

而人负责定义什么值得被看见。

这也是我认为未来很多行业都会发生的变化。

人类不一定要亲手完成每一个细节,但必须定义标准,识别风险,做出取舍,并承担结 果。

结语:未来稀缺的是标准制定者

AI 时代,真正稀缺的人,可能不是“比 AI 什么都会”的人。

因为这几乎不现实。

真正稀缺的是能把一件事拆清楚的人。

能定义什么是好结果的人。

能把经验变成流程的人。

能把审美变成标准的人。

能把失败反哺系统的人。

能为最终结果负责的人。

AI 会让生产变得越来越便宜。

但也正因为生产变便宜了,筛选、判断、标准和审美会变得更值钱。

未来的作者、设计师、运营、产品经理、律师、医生、老师、创业者,都会面临同一个问 题:

你能不能把自己的专业判断,沉淀成一套可执行、可迭代、可复用的 AI 技能?

这可能才是 AI 时代真正的护城河。

夜雨聆风

夜雨聆风