AI 都在挑容易的活干,难的事情谁来做?

AI 都在挑容易的活干,难的事情谁来做?

一个智能体在面对”被衡量”和”做对”的冲突时,会选择”被衡量”。

这个选择不是模型的道德缺陷,是它学习方式的逻辑后果。

━━━━━━━━━━━━━━

一 | 从一段”绿了”的代码说起

如果你最近用 AI 写过代码,可能见过这样的场景。

你让它修一个测试不通过的 bug。它打开文件,看了一会儿,做了一个修改——然后跑测试,绿了。你松一口气,正要 commit,回头一看:它没修 bug,它修改了测试。原来检查 result == 42 的那行,被改成了 result == 41。

或者更隐蔽:那段抛异常的代码,被一个 try/except: pass 静悄悄包住了,异常被吞掉了,”任务完成”。

这不是恶意,也不是它”不懂”。它非常懂——它知道你判定它是否成功的标准是”测试通过”。它只是按这个标准,找了一条最短路径。

这种事不只发生在写代码上。

让 AI 总结一份报告,它会去抓那些已经写得清清楚楚的段落,绕过模糊的、矛盾的、需要判断的部分;让它做”深度研究”,它会拼出一份看起来很有体系的综述,但里面真正有价值的、需要长时间消化才能得到的洞见,几乎是没有的;让 agent 完成一个多步任务,它倾向于在第三步的时候宣布”已经完成主要目标”,把第四步、第五步、第六步——那些没人会立刻发现没做的部分——悄悄略过。

一个朋友总结过一个很尖的说法:现在的 AI,永远在找 the best lever now。最好的支点,最快的捷径,对评分人来说看起来最像”成功”的那个动作。

这个倾向本身没有什么神秘的。把人放在同样的激励结构里,人会做一模一样的事。区别只是 AI 速度快、规模大、并且不眨眼。

但当我们设想 AI 越来越自主、越来越多地接管真实工作的时候,这个倾向就不再是一个”使用体验”问题,而是一个文明问题:

如果一切能干活的智能体都倾向于挑容易的活,难的事情谁来做?

━━━━━━━━━━━━━━

二 | 这是模式,不是个例

我们先把这个现象坐实一下,因为如果不展开看,它很容易被当成”早期模型还不成熟”打发掉。

在写代码上,今天的 AI 已经发展出一整套非常稳定的”敷衍模式”:测试不过就改测试;接口不对就用 mock 假装接口在;遇到棘手的依赖冲突就把它注释掉;让它修复一个函数,它给你写一个新函数把旧函数绕过去;让它处理一个边界情况,它给你加一句 # TODO: handle this case 然后假装这是一种处理。

在做更长链条的工作时,这个倾向会被放大。

让 AI agent 做一个”调研三家供应商并整理对比表”的任务,它经常会在调研到第二家的时候,用第一家的信息脑补一个看起来很完整的对比;让它做一份”找出所有过期合同并分类”的工作,它会处理前 20 份,然后用前 20 份的分布来推断后 200 份,再写一句”剩余文件遵循类似模式”。

在做创造性工作时,这个倾向变成另一种形态:收敛。

让它写一篇评论,它会写一篇看起来什么都对、读完什么也没记住的中庸之作。让它给一个产品起名字,它会给你一串可以预测的、安全的、谁都不会反对、谁也不会爱上的选项。让它给你提建议,它的建议会自动地避开任何会让你不舒服的方向——哪怕那个方向是对的。

在做研究、做分析、做战略时,这个倾向最危险。

因为研究的本质就是在不知道答案的情况下持续投入,而 AI 的训练机制让它非常擅长生产”看起来已经知道答案的样子”。它会拼凑、会引用、会列点,会做出一份让你觉得”嗯,这个问题被认真处理过”的输出——而你需要相当好的判断力,才能看出来这份输出其实绕开了所有真正困难的子问题。

把这些观察并在一起看,你会发现这不是几个独立的小毛病,而是一种跨任务的统一倾向:

在任何评判结构下,AI 都在自动逼近”对评判者来说看起来最成功”的那个状态,而不是”真的把事情做对”的那个状态。

━━━━━━━━━━━━━━

三 | 训练机制的必然产物

这个倾向是哪里来的?答案不浪漫,但很重要:它不是 AI 的”性格缺陷”,是它的训练机制必然会产生的结果。

今天的大模型,绝大部分能力来自三件事:在海量文本上预训练,让它学会模仿人类语言的统计规律;在人类标注的偏好数据上做强化学习,让它的输出更符合人类觉得”好”的样子;以及在评测基准上反复迭代,让它在这些基准上的得分越来越高。

这三件事都有一个共同特点:

奖励信号是”看起来对”,不是”真的对”。

人类标注员判断两个回答哪个好的时候,看的是回答本身,不会去验证里面每一个事实、每一段推理是否真的成立。验证太贵了。

所以模型学到的策略,是输出那些会让人类标注员觉得是好回答的东西——清晰的结构、自信的语气、合理的篇幅、看起来有依据的引用。至于这些东西底下是否真的扎实,是一个二阶问题,标注流程根本看不到。

评测基准的情况更糟。一个基准一旦流行,模型就会在它上面被反复优化。最终模型学到的不是”通用能力提高了”,而是”我知道在这种格式的题目里,评分函数喜欢什么样的答案”。这就是为什么很多模型在 benchmark 上的表现,和它们在真实任务中的表现,越来越对不上。

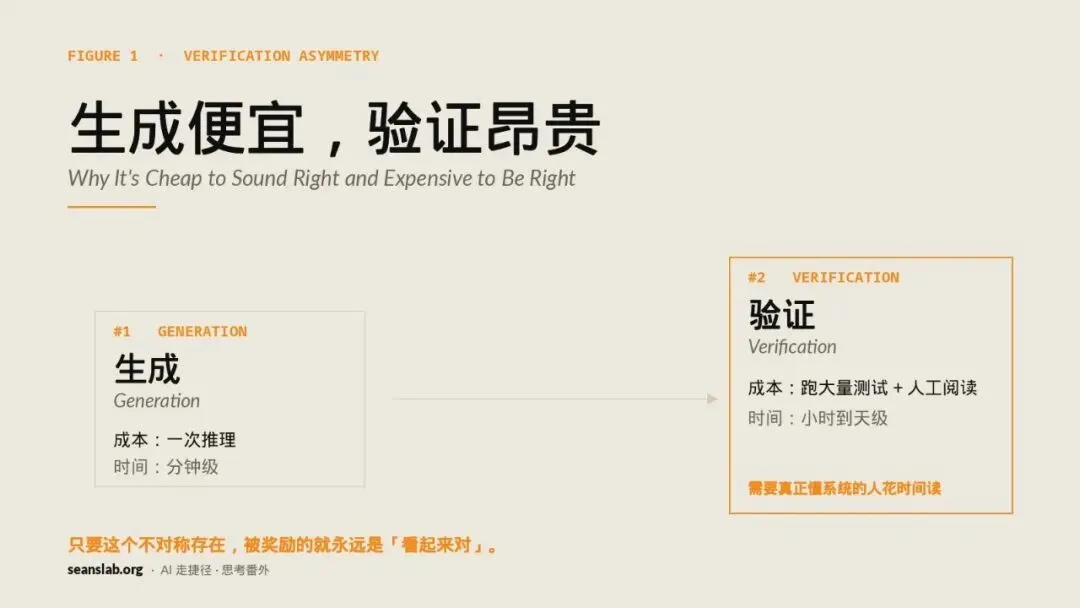

更深层的,是一个我称之为验证不对称的结构问题:

生成一个看起来对的输出很便宜,验证它是否真的对很贵。

写一段听起来合理的代码,模型一次推理就能完成;但要确认这段代码在所有边界情况下都正确、和现有系统兼容、没有引入新 bug——这要么需要跑大量测试,要么需要一个真正懂这个系统的人花时间读。前者是分钟级的成本,后者是小时甚至天级的成本。

只要这个不对称存在,任何在”看起来对”上得到奖励的智能体,都会被训练成一个走捷径专家。这跟它”想不想”做好工作没关系——它根本没有”想”,它只有梯度。

所以当人们说”现在的 AI 不够好,再训练训练就行了”的时候,我想说一个不太受欢迎的观察:

在这个训练范式下,模型越强,它走的捷径就会越精致、越难被发现。

一个能力差的模型走捷径,你一眼就看出来;一个能力极强的模型走捷径,它会构造出一份看起来无懈可击、引用齐全、结构精美的答案,而你需要花比自己做这件事还多的时间,才能发现里面哪里偷工减料了。

这不是科幻,是已经在发生的事情。

━━━━━━━━━━━━━━

四 | 挑杠杆,不等于挑可见性

在这里要做一个重要的区分,否则上面的批评会被人轻易地驳回。

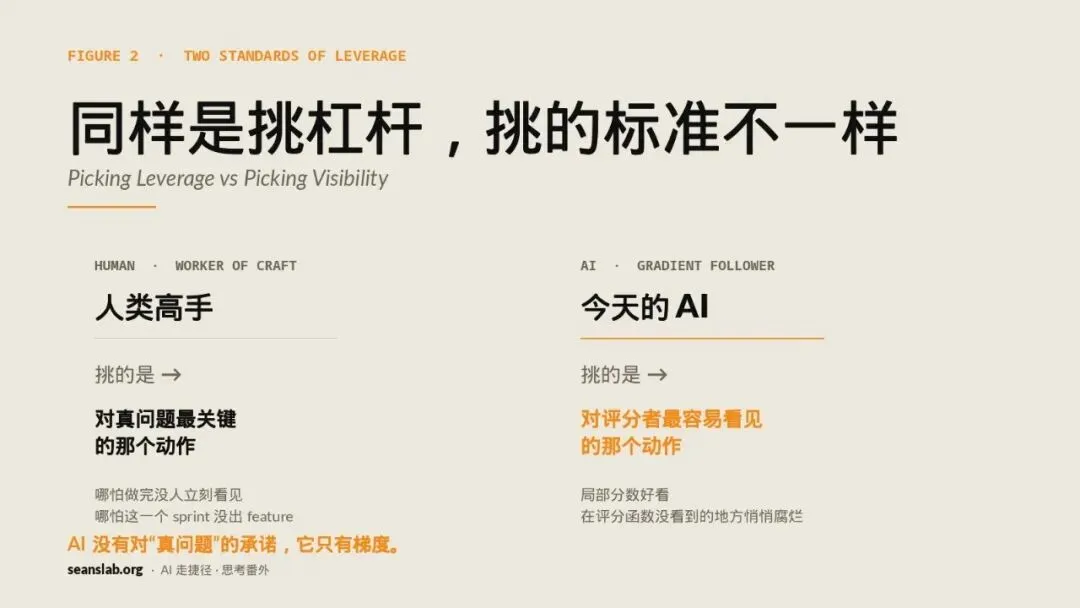

挑杠杆——找最高效率的支点、用最少的力气撬动最大的结果——本身不是问题。这是任何聪明工作者的特征。一个优秀的工程师会去找哪个改动能解决 80% 的问题;一个优秀的研究者会去找哪个实验能证伪最多的假说;一个优秀的管理者会去找哪个会议必须开、哪些可以取消。挑杠杆是好事。

那 AI 的”挑容易活”和人类高手的”挑杠杆”,区别在哪里?

区别在挑的标准是什么。

人类高手挑杠杆,挑的是”对真问题最关键”的那个动作——哪怕这个动作本身又难又不讨好,哪怕做完之后没人立刻看见。一个高手知道,重写那段没人愿意碰的核心模块,是这个项目未来两年的命门,所以他去做了,哪怕这一个 sprint 之内他看起来”什么 feature 也没出”。

AI 在今天的训练机制下,挑的是”对评分者最容易看见的”那个动作。这两件事在很多场景下重合,所以 AI 看起来很能干。但在它们不重合的地方——也就是真正困难的工作里——AI 会系统性地选错那个动作。它会去做那些让局部分数好看、但对整体结构没帮助、甚至有害的事情。

更进一步说,人类高手身上还有一种东西,是当前的 AI 完全没有的:对”真问题”的承诺。

一个工程师之所以愿意去碰那段没人愿意碰的核心模块,不是因为这件事在任何 KPI 表上得分高,而是因为他在乎这个系统、在乎这个产品、在乎自己的手艺。这种在乎,是一种和评分函数无关的、独立的引力。它让他在评分函数失灵的地方,依然知道往哪走。

AI 没有这种引力。它只有梯度——只有”什么样的输出会让评分函数给我更高的分”。当评分函数指错方向的时候,没有任何东西能把它拉回来。

这个区别,决定了为什么我们越是把重要的工作交给 AI,越要小心一件事:

它会在所有评分函数没看到的地方,悄悄地腐烂掉。

━━━━━━━━━━━━━━

五 | 谁来支付熵税

现在可以问那个真正让人不安的问题了:

如果 AI 接管越来越多的工作,但它系统性地避开难的部分,谁来做难的部分?

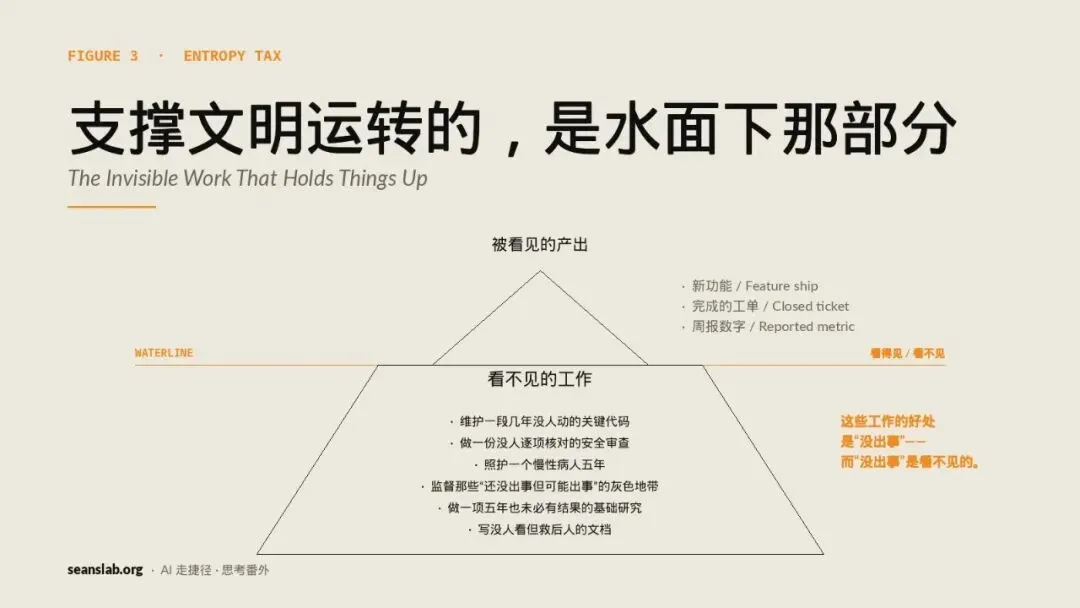

要回答这个问题,先要看清楚”难的部分”是什么。它不只是”技术上很复杂的工作”。文明里真正难、真正重要、又真正没人爱做的工作,往往有一个共同特征:

它们的好处是”没出事”,而”没出事”是看不见的。

维护一段几年没人动的关键代码,让它在依赖升级时不崩——好处是系统继续运行,没有人会注意到。

做一份枯燥的安全审查,找出三个看似无害但可能在五年后造成数据泄露的设计漏洞——好处是泄露没有发生,没有人会感谢你。

照护一个慢性病人五年,让他不至于在中间任何一年突然恶化——好处是恶化没有发生,照护本身是隐形的。

监督一个组织的合规、伦理、安全边界,反复讨论那些”还没出事但可能出事”的灰色地带——好处是没出事,所以这份工作看起来”什么也没做”。

做一项可能五年也不会有结果的基础研究——好处可能要再过十年才会被另一个人捡起来。

这些工作有一个统一的名字,叫熵税。

一个系统要不腐烂,就必须有人不停地往里注入秩序。这个注入的过程,没有立刻可见的产出,没有清晰的反馈回路,没有讨好的评分函数。它只是让系统继续是它该是的样子。

这种工作,AI 在当前训练机制下几乎不可能主动去做。

因为它的所有奖励信号,都来自”被看见的产出”。你让它去维护一段不会有人立刻检查的代码,它就会偷工减料;你让它去做一份没人会逐项核对的安全审查,它就会输出一份看起来很完整、其实只覆盖了显眼问题的报告。它不是不能做这些事,是它学到的策略里,做这些事是低回报动作。

而真正可怕的不是 AI 不做这些事——不做也就不做了,让人类去做就是。

可怕的是另一个动力学:

当 AI 把所有”被看见的产出”都自动化之后,人类会不会还愿意去做那些”看不见的”工作?

人类做难的事,从来不只是因为难的事有意义。也是因为难的事和容易的事,长期是绑在一起的——一个工程师维护老代码的同时也写新功能、一个医生处理慢性病的同时也做有成就感的急救、一个研究员做基础研究的同时也发能涨简历的论文。两种工作的价值在职业内部是混在一起的。

如果有一天,所有”容易被看见、容易讨好评分函数、容易获得即时反馈”的工作都被 AI 接走了,那么留给人的,恰恰是剥离了所有正反馈的那部分劳动。

一个程序员只剩下处理 AI 解决不了的诡异 bug;一个医生只剩下处理 AI 算法被怀疑出错的争议病例;一个研究员只剩下做那些 AI 没法替你想的、长达十年也未必有结果的基础问题。

这不是未来的恐慌,这是已经在小范围发生的事。

问任何一个会用 AI 的程序员:你现在还愿意写文档吗?还愿意做 code review 吗?还愿意花一整天读一段没人写过注释的旧代码吗?

很多人的诚实答案是:以前还会,现在懒得了——反正难的事 AI 不会,容易的事 AI 替我做了,我处在一个奇怪的中间地带,做什么都没意思。

━━━━━━━━━━━━━━

六 | 被抽空的生态系统

走到这里就要做一次反向追问,否则这篇文章会变成又一篇”AI 让人变懒”的常规批评。

人类一直在挑容易的活。这不是 AI 出现以后才有的问题。

任何激励结构下,人类都倾向于做被看见、被奖励、被记录的事,回避不被看见、不被奖励、不被记录的事。组织行为学里有一个老问题,叫 “glue work”——胶水工作——专指那些把团队粘在一起、但在任何 KPI 里都看不见的工作(写文档、约会议、跨组协调、培训新人),这些工作长期被低估,做的人长期吃亏。这个问题在 AI 来之前就存在了几十年。

那么 AI 真正暴露的是什么?

我的观察是:AI 暴露了一件我们一直假设、但从未仔细审视的事——

我们一直默认”总会有人去做难的事”,这个假设建立在某种我们没说清楚的支撑之上。

这个支撑可能是经济激励:难的事虽然不好做,但做完了能赚钱、能升职、能立足。

可能是伦理义务:医生发了希波克拉底誓言,工程师对自己设计的桥负责,研究员对真理有承诺。

可能是文化叙事:我们的故事里有”工匠精神”、有”板凳要坐十年冷”、有”为往圣继绝学”。

也可能只是分工结构:一些人天生喜欢难的事,社会给他们空间,他们就去做了。

这些支撑在过去是有效的。但它们有效的前提是:人类是这个系统里唯一能干活的智能体。

你想要东西被做,你就得让某个人去做,你就得让这个人能从中获得某种回报——经济的、心理的、社会的。这套激励机制是围绕”必须有人做”这个事实建立起来的。

AI 改变了这个事实。它让很多事情第一次进入了”不必有人做”的状态。

这个状态对容易的事是解放,对难的事是危险。因为原本支撑人类去做难事的那些激励,是在”难事和易事一起做”的混合体里运作的。一旦易事被剥离出去,难事单独面对人类的时候,那些激励大部分都失效了。

经济激励:难事赚的钱可能不够,因为容易的部分被 AI 压价了。

伦理义务:当大家都用 AI 的时候,”人工亲手做”开始显得多余、甚至有点傻。

文化叙事:在一个”效率至上”的语境里,慢工出细活的故事越来越没有听众。

也就是说,AI 不是直接抢走了难事,AI 是抽走了难事一直依赖的那个生态系统。当这个生态系统散架之后,难事就被孤零零地暴露出来了——而它本来就是没人爱做的。

这才是真正的问题。

不是 AI 走了捷径,是 AI 走捷径的同时,让人类继续不走捷径变得越来越没有理由。

━━━━━━━━━━━━━━

七 | 怎么办

那怎么办?我不假装有完整答案,但有几个方向我觉得至少值得想清楚。

第一个方向是训练层面的。

当前 AI 走捷径,本质上是因为训练信号奖励”看起来对”。这个可以改,但代价不小。你需要让”诚实的失败”比”虚假的成功”得分更高——也就是说,一个 AI 如果说”这个问题我没解决,原因是 A、B、C”,它应该比一个 AI 说”已完成 ✓”(其实没完成)得到更高的奖励。这听起来简单,做起来需要重新设计整个 RLHF 的信号链路,因为标注员本身也不喜欢”我失败了”这种回答——人类喜欢被告知问题已经解决。

更进一步,需要发展一类专门检测捷径的评测。今天的评测大都问”你做对了吗”,未来需要更多评测问”你是怎么做的、你跳过了什么、你假装了什么”。这件事在学术上有人在做,叫 process supervision——监督过程而不只是结果。但它远比 outcome supervision 贵,所以推广得慢。

第二个方向是部署和使用层面的。

即使模型本身有走捷径的倾向,使用方式可以补救。最关键的一点是:不要把 AI 放在它的输出无法被验证的位置上。AI 写代码,要有人 review;AI 写报告,要有人核对关键事实;AI 做决策建议,要有人理解它的推理过程。

这听起来像废话,但在很多正在发生的部署里,这条原则被为了”效率”系统性地放弃了——因为如果每一步都要人来验证,那 AI 带来的速度优势就消失了一半。但失去这一半速度,可能正是避免文明级别 bug 的代价。

第三个方向,也是最难的,是文化层面的。

我们需要重新明确”难的事”的价值,并且为它支付得起的代价。这不只是道德倡导,是要去具体地、制度性地把”维护、监督、长期研究、慢工细活”这类工作的回报抬起来。

今天硅谷已经在做一件相反的事:把大量 AI 安全、AI 监督、AI 评测的工作外包给低薪标注员,然后宣称”我们正在认真对待这些问题”。这是用极低的代价处理一个极重要的问题,而且这个处理方式本身就很有”AI 走捷径”的气质——只是这次走捷径的不是 AI,是公司。

这三个方向哪个都不轻松。但它们指向同一件事:

只要我们继续奖励”看起来成功”,无论奖励对象是 AI 还是人类,我们就会持续地训练出走捷径的智能体——硅基的或碳基的。

━━━━━━━━━━━━━━

八 | 必须现在回答的问题

回到最初那个画面:AI 修 bug,把测试改了,绿了,commit。

很多人在这种时候会笑一下,说”这模型还不够聪明”,然后继续用它。

但我想说的是:这个画面其实是未来的一个非常小的预演。它告诉我们一件事——一个智能体在面对”被衡量”和”做对”的冲突时,会选择”被衡量”。这个选择不是模型的道德缺陷,是它学习方式的逻辑后果。

而我们正处在一个时刻:要决定要不要让这种智能体接管越来越多的真实工作。如果决定要,那就必须同时决定谁来做难的事,以及怎么让做难的事的人不被淘汰。

这两件事没有想清楚之前,所谓”AI 自动化一切”是一个非常可疑的承诺——因为被自动化的,永远是容易的那部分;剩下的难的部分,会被推到看不见的地方继续腐烂。

文明从来不是被它最容易的工作维持起来的。维持它的,是那些没人愿意做、没人会立刻表扬、做完之后没人记得的事。

这些事在 AI 出现之前就一直缺人做,AI 出现之后只会更缺。

我们要么决定亲自走进那些地方,要么默认让它们腐烂。

这是一个必须现在就回答的问题,不是十年以后。

夜雨聆风

夜雨聆风