使用OPENCLAW玩转魔塔社区:API探索、创空间部署、技能开源全记录

五一假期最后一天,花了一整天深度探索魔塔社区(ModelScope)——从 OpenAPI 接口调用、模型查询、到创空间项目部署、再到封装成小龙虾技能“魔塔社区.skill”并开源到 GitHub,完整走了一遍。

魔塔社区是什么?

魔塔社区(modelscope.cn)是阿里达摩院推出的 AI 模型开放平台,类似于中国的 Hugging Face。核心资源包括:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

对于 AI 开发者来说,魔塔社区是一个从模型选型、数据获取、工具集成到应用部署的一站式平台。

第一步:API 探索

通过让WORKBUDDY自主学习和接口验证,AI弄清楚了魔塔社区提供了两套 API和具体格式:

旧版 API(/api/v1/):模型库、数据集操作,响应用 PascalCase({Code, Data, Success})

新版 OpenAPI(/openapi/v1/):技能中心、MCP 广场、创空间,响应用 snake_case({success, data})

两套 API 共存,调用时需要注意响应格式的差异。

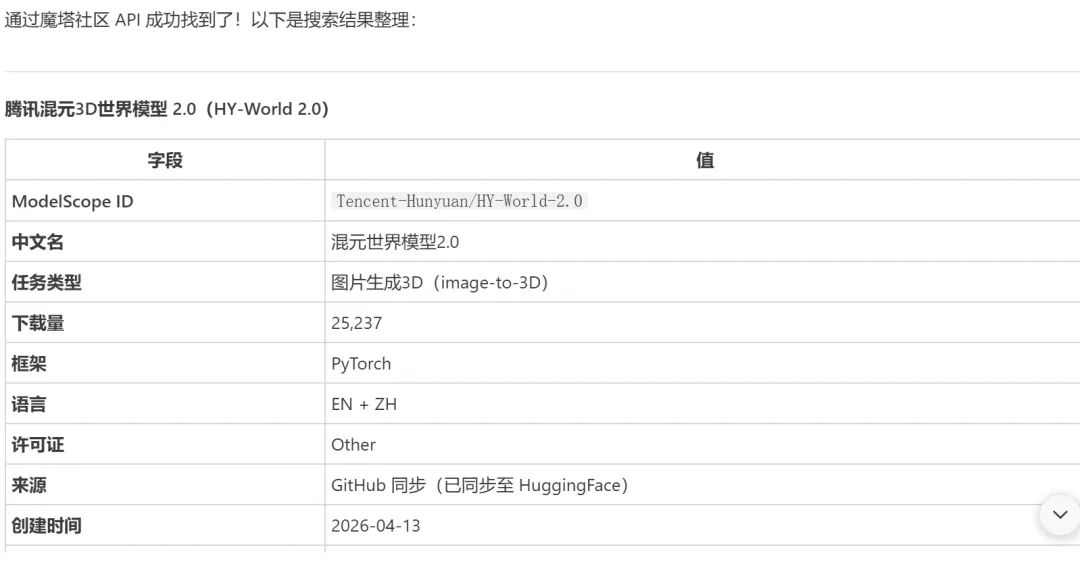

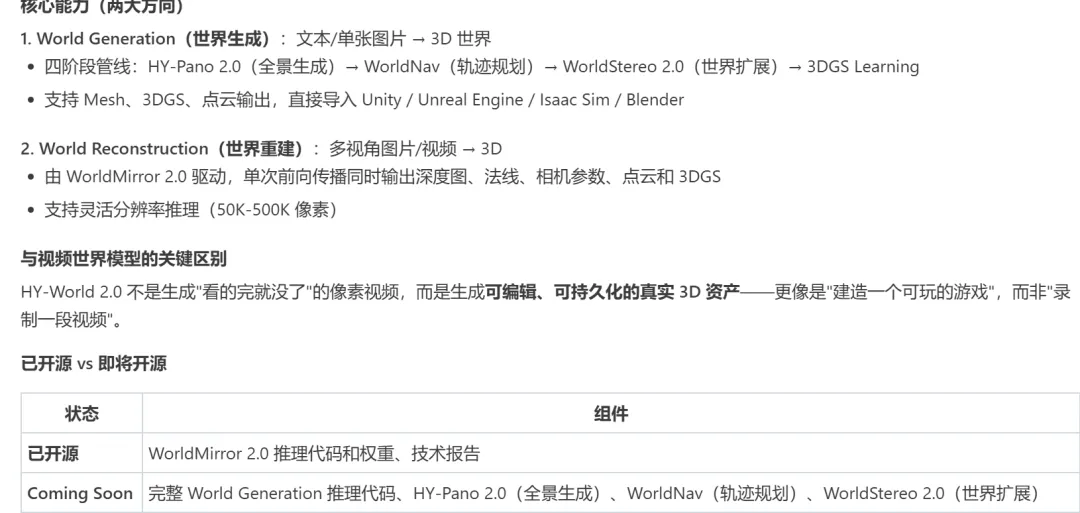

查询混元世界模型 2.0

以腾讯混元世界模型为例,通过 API 搜索模型信息:

curl -s -X PUT “https://www.modelscope.cn/api/v1/models” \ -H “Content-Type: application/json” \ -d ‘{“page_number”: 1, “page_size”: 10, “search”: “混元世界”}’ \ | python -m json.tool

返回结果包含模型名称、描述、下载量、作者等详细信息,格式为旧版 PascalCase。类似地,数据集查询使用 /api/v1/datasets 端点。

技能中心搜索

技能中心是新版 API,8万多条技能,覆盖开发工具、AI 媒体、代码测试、营销 SEO 等领域:

curl -s “https://www.modelscope.cn/openapi/v1/skills?page_number=1&page_size=5&search=股票” \ | python -m json.tool

每个技能返回 install_command,提供三种安装方式:npx、curl、pip,可以直接在 AI Agent 环境中安装使用。

MCP 广场探索

MCP(Model Context Protocol)广场是魔塔社区的热门功能,9400+ 个 MCP 服务器可以扩展 AI 的能力边界:

curl -s -X PUT “https://www.modelscope.cn/openapi/v1/mcp/servers” \ -H “Content-Type: application/json” \ -d ‘{“page_number”: 1, “page_size”: 5, “search”: “高德”}’ \ | python -m json.tool

MCP 详情接口返回 server_config,可以直接复制到 MCP 客户端配置中使用,零成本接入。

MCP 广场热门 TOP 5:

-

Fetch 网页抓取(457K 浏览量) -

高德地图(290K) -

12306 车票(182K) -

必应搜索中文(154K) -

可视化图表(107K)

第二步:创空间部署实战

学会了 API 之后,最关键的是把本地项目部署上去。魔塔的创空间支持 Gradio、Streamlit、Docker、静态站点四种部署模式。

实战案例:运势查询项目

我有一个基于 FastMCP 的运势查询项目(fortune-mcp),包含 MCP 服务端和前端页面,部署过程踩了不少坑:

第一步:创建创空间

curl -s -X POST "https://modelscope.cn/openapi/v1/studios" \ -H "Authorization: Bearer ${TOKEN}" \ -H "Content-Type: application/json" \ -d '{"owner":"chenghd","repo_name":"fortune-mcp","sdk_type":"gradio"}'

第二步:配置项目文件

Gradio 模式有三个硬性要求:

-

入口文件必须叫 app.py -

必须有全局 demo变量(demo = gr.Blocks(...)) requirements.txt

需要包含 gradio>=4.0.0

第三步:Git 推送代码

git push https://oauth2:${TOKEN}@www.modelscope.cn/studios/chenghd/fortune-mcp.git master

注意:魔塔的默认分支是 master(不是 main),这是个容易踩的坑。

踩坑记录

部署过程中遇到了 4 个问题:

坑 1:sdk_type 选择错误

选 docker 模式时,push 代码后不会自动重建。改为 gradio 模式后,push 即自动部署。

坑 2:FastMCP transport 参数

mcp.http_app() 默认使用 streamable-http 传输(注册 /mcp 路由),不是 SSE(/sse 路由)。必须显式指定:

# 错误mcp_app = mcp.http_app()# 正确mcp_app = mcp.http_app(transport=“sse”)

坑 3:创空间代理不转发 /sse

魔搭的 Nginx 代理默认不转发 /sse 路径,MCP 客户端无法直连。解决方案:前端页面改为纯 JS 计算,不依赖后端 MCP 服务。

坑 4:端口冲突

不能使用 8080 端口(平台占用),需要改为其他端口如 7860,且必须绑定 0.0.0.0。

最终部署地址:https://www.modelscope.cn/studios/chenghd/fortune-mcp

运势前端页面

为了让项目更有展示性,我额外开发了一个运势分析单页应用,用 JavaScript 完整移植了 Python 端的算法(Mulberry32 种子随机数、MD5 哈希),支持今日/月/年运势查询和改运建议,配合星空 Canvas 动画背景和毛玻璃卡片效果。项目也通过已有技能自动部署到魔塔社区创空间。

最终部署地址:https://www.modelscope.cn/studios/chenghd/fortune-predictor https://chenghd-fortune-predictor.ms.show/

第三步:封装成 AI 技能--魔塔社区.skill

探索完 API 后,自然想到把这些能力封装成一个 AI 技能,让 AI 助手能够直接调用魔塔社区的全部能力。

技能架构

创建了两个互补的技能:

modelscope-api:API 能力封装

-

覆盖模型库、数据集、技能中心、MCP 广场、创空间五大模块 -

含 Python CLI 辅助工具(搜索、查询、安装) -

Token 自动引导注册流程(无 Token 时提示用户注册) -

完整 API 文档和示例代码

ModelScope-Studio:创空间部署专项

-

本地项目一键部署到创空间 -

MCP 服务自动配置和部署 -

日志分析和故障排查 -

环境变量管理

两个技能配合使用:先用 modelscope-api 查找资源,再用 ModelScope-Studio 部署项目。

技能中的关键设计

双格式响应兼容:

defms_request(url, token=None): headers = {“Authorization”: f”Bearer {token}“} if token else {} r = requests.get(url, headers=headers) d = r.json()if“Data”in d:return d[“Data”] # 旧版 /api/v1/elif“data”in d:return d[“data”] # 新版 /openapi/v1/

Token 引导流程:无 Token 时不报错,而是引导用户到注册页面获取令牌,降低使用门槛。

实战经验内嵌:为避免使用者本地项目 部署到创空间时又要反复尝试,把部署过程中踩过的坑全部写进技能文档,包括 sdk_type 差异、transport 参数、Git 分支要求等。后面用打包好的技能尝试一次部署成功。

第四步:开源发布到 GitHub

技能做好之后,最后一步是发布到 GitHub,让更多人能用。

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

全链路回顾

一天的工作串起来,形成了完整的链路:

API 探索 → 模型/数据集/技能/MCP 查询 ↓创空间部署 → 本地项目上线 ↓踩坑修复 → transport参数/端口/分支/Git推送 ↓封装技能 → AI 可直接调用全部能力 ↓开源发布 → GitHub + ClawHub 技能市场每一步都在上一步的基础上推进,从纯消费(查询 API)到生产(部署项目)再到贡献(开源技能),形成了一个完整的闭环。

几点体会

1. API 文档的质量决定开发效率

魔塔社区的两套 API 格式不统一(PascalCase vs snake_case),一开始很混乱。自己梳理清楚之后写进技能文档,后续用起来就顺畅多了。

2. 踩坑不可怕,记录下来就是资产

部署过程中 4 个坑,每个都花了时间排查。但记录进技能文档后,下次部署直接避过,而且其他使用者也能少走弯路。

3. 封装的核心是降低使用门槛

从 curl 调用 → Python 脚本 → AI 技能封装,每一步都在降低使用门槛。最终用户只需要说”帮我查下混元模型的信息”,AI 就能直接调用 API 返回结果。

4. 开源是最后的检验

只有愿意公开让别人用的东西,才会认真打磨文档和代码。准备发布材料(README、截图、示例)的过程,本身就是一次质量审查。

本文基于 2026 年 5 月 4 日的实际操作整理,所有代码和配置均经过验证。项目地址:https://github.com/Chenghd511/modelscope-api-skill

喜欢的朋友可直接下载,下载前记得给本文点赞和加关注,不时有好东西 分享。

多 OpenClaw 智能体共享 SKILL 库——从探索到落地的完整实录

你的OPENCLAW,为什么总在同一个地方摔倒?---谈小龙虾的自我进化

从张雪峰被AI复活看OPENCLAW思维蒸馏术—1小时打造4人顶级智囊团

给小龙虾装上眼睛:用 OpenClaw 打造一个 AI 视频监控助手

给你的小龙虾OPENCLAW装上IMA大脑- 技能安装全攻略

OPENCLAW怎么安全巡检:你的AI助手可能正在”越狱”?从 ClawAegis 开源看AI AGENT安全

告别单打独斗:OpenCLAWS 帮你组建专属 AI 工作团队(一)

告别单打独斗:OpenCLAWS 帮你组建专属 AI 工作团队(二)

夜雨聆风

夜雨聆风