开源|一款 AI 编程助手统一管理工具,支持 Claude Code、Codex 等多模型一键切换

前言

用过 AI 编程工具的兄弟应该都有这个体会 同时配置多个 AI 编码助手的时候,各种 API Key、各种配置文件、各种模型切换,搞得脑袋疼。

Claude Code 要用 Anthropic 的 API,Codex 又要配置 OpenAI 的,Gemini CLI 再来一个 Google 的。每换个工具就得重新配一遍,不同项目要用不同模型还得手动改配置。这种重复劳动不仅浪费时间,还容易出错。

那有没有一款工具能处理这种现状呢?

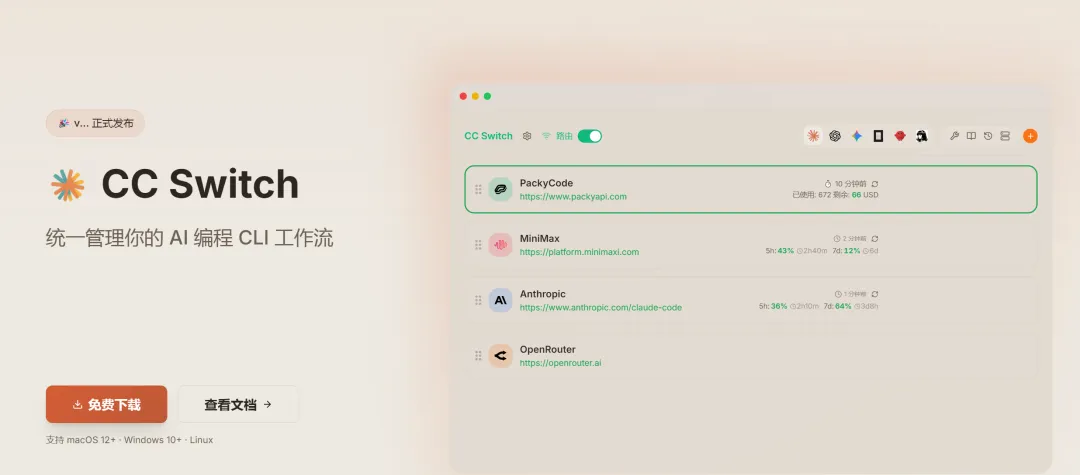

CC Switch 就是来干这件事的。

介绍

CC Switch 本质上是个跨平台的 AI 编程工具配置中心。

它的核心思路很简单:你不再需要手动去改各种配置文件、环境变量、API 设置。CC Switch 把这些工具的统一管理起来,在一个界面里完成所有配置和切换。

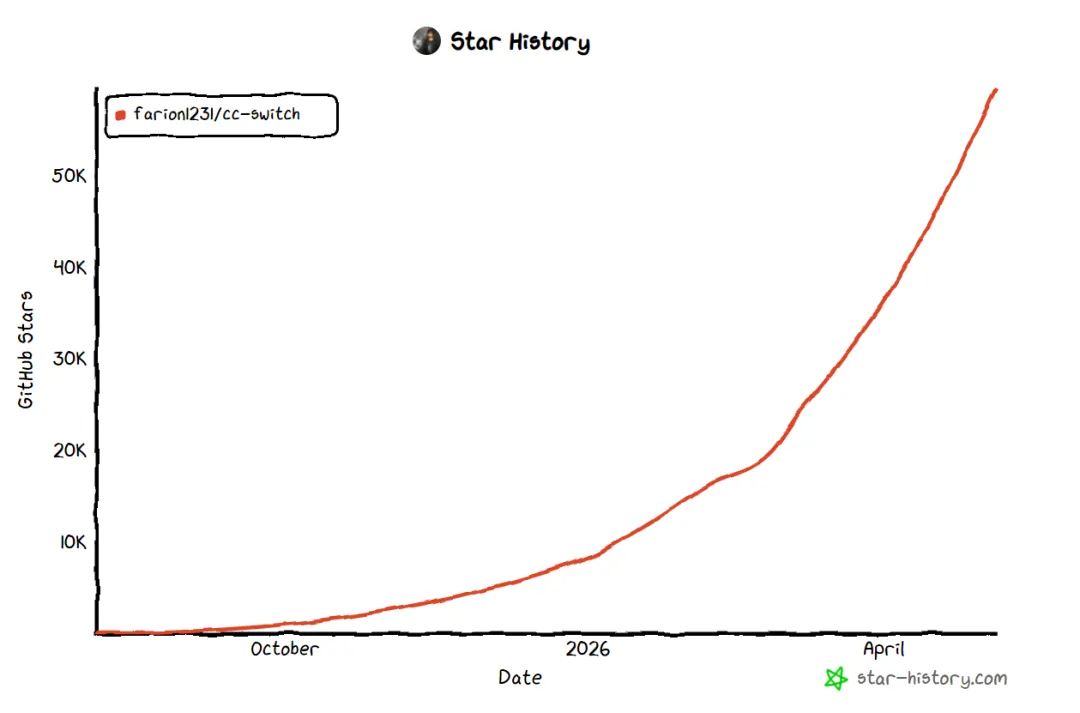

这个项目在 GitHub 上已经拿到了 60.9k 的 star,作者 Jason 是个 36 岁转行的程序员,之前做进出口贸易,自学编程后花了六个月时间写出了这个项目。故事挺励志,但咱们今天重点说工具本身。

CC Switch 支持五个主流的 AI CLI 工具:

-

• Claude Code(Anthropic 的 AI 编码助手) -

• Codex(OpenAI 的 AI 编码工具) -

• Gemini CLI(Google 的 AI 编码 CLI) -

• OpenCode(开源 AI 编码工具) -

• OpenClaw(开源 AI 编码工具)

特点

CC Switch 的功能设计挺务实,没有花里胡哨的东西,都是实际使用中会碰到的场景。

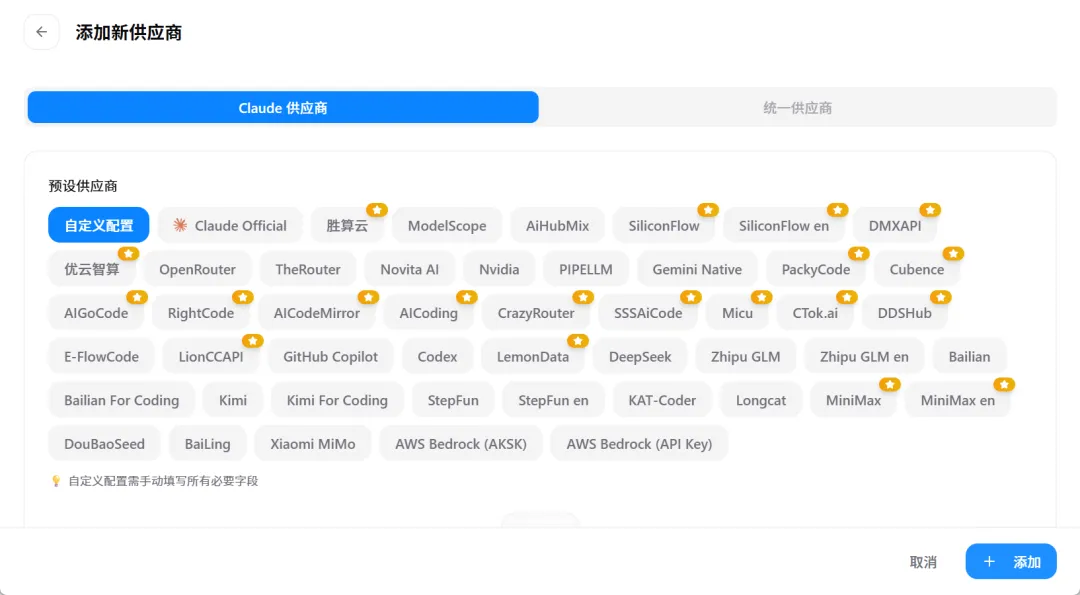

50+ 内置预设是个很实用的功能。AWS Bedrock、NVIDIA NIM、各种社区中继,这些都帮你配好了,复制个 API Key 就能直接用,不用自己去查文档、对参数。

系统托盘快速切换这个设计很人性化。你不用打开完整应用,直接从托盘菜单就能切换供应商,写代码写到一半想换模型,点两下就搞定。

通用供应商的概念也不错。一个配置可以同时同步到多个应用(OpenCode、OpenClaw),不用每个工具单独配一遍。

MCP 管理是另一个亮点。现在 MCP(Model Context Protocol)服务器越来越多,四个应用里分别配置一遍很麻烦。CC Switch 提供了统一的 MCP 面板,支持跨应用管理,还能通过 Deep Link 一键导入。

代理与故障转移功能对国内用户来说很实用。本地代理支持热切换、格式转换、自动故障转移、断路器、供应商健康监控。简单说就是:某个 API 挂了,它能自动切换到备用的,不影响你写代码。

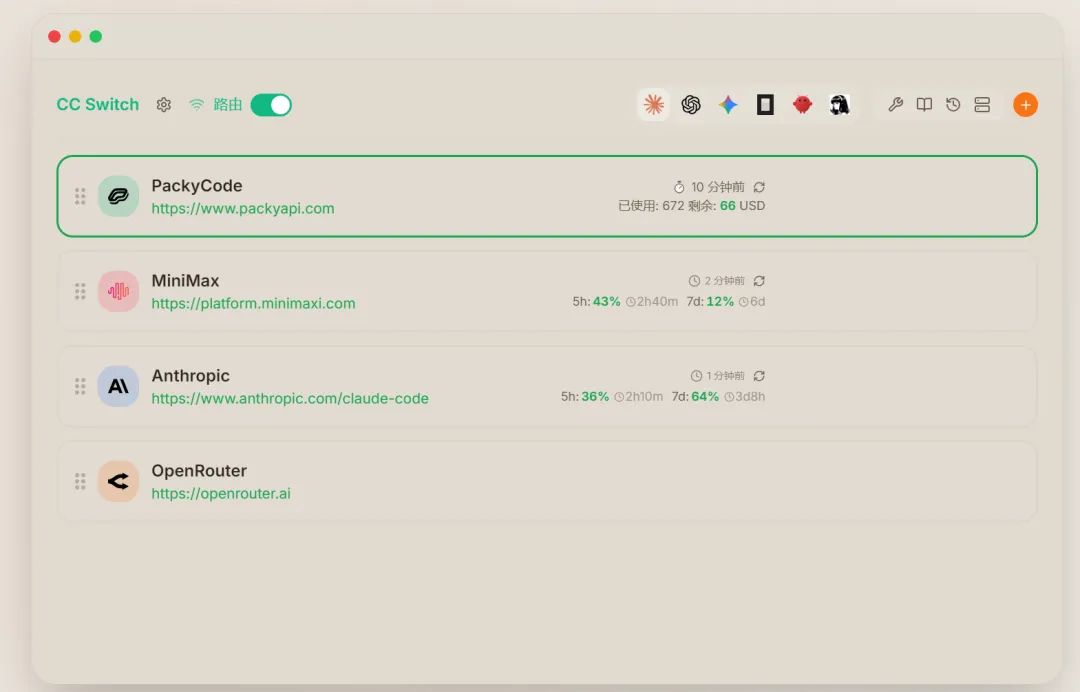

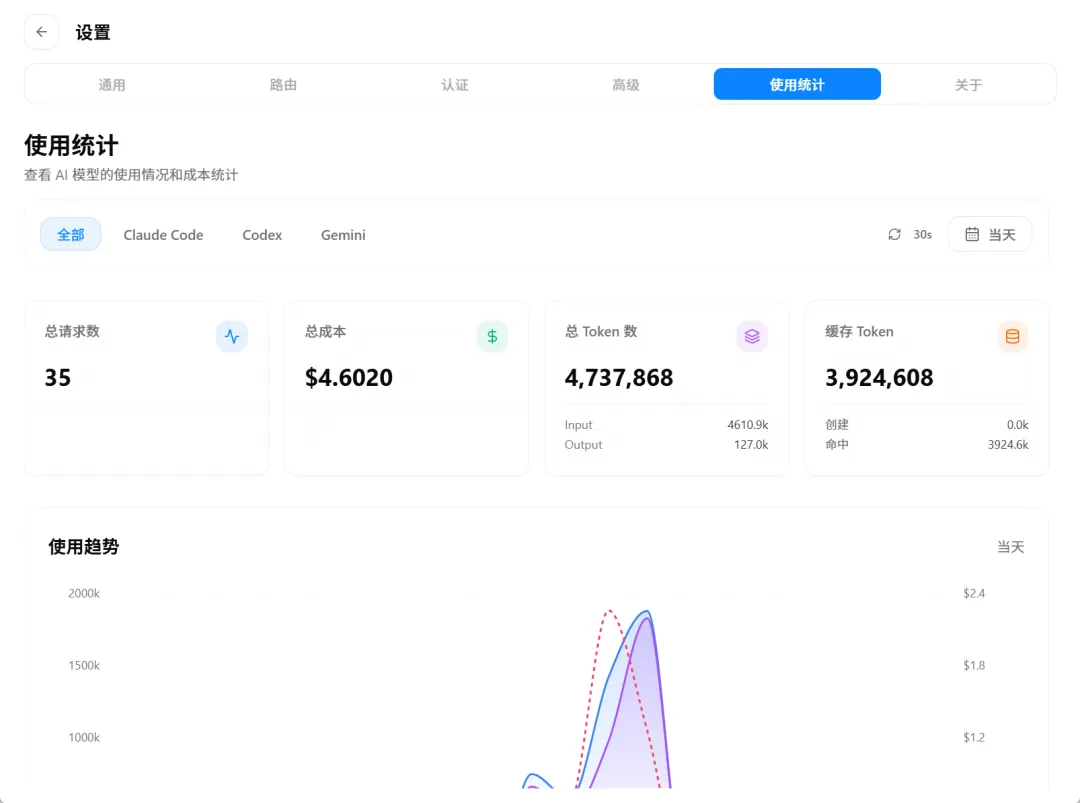

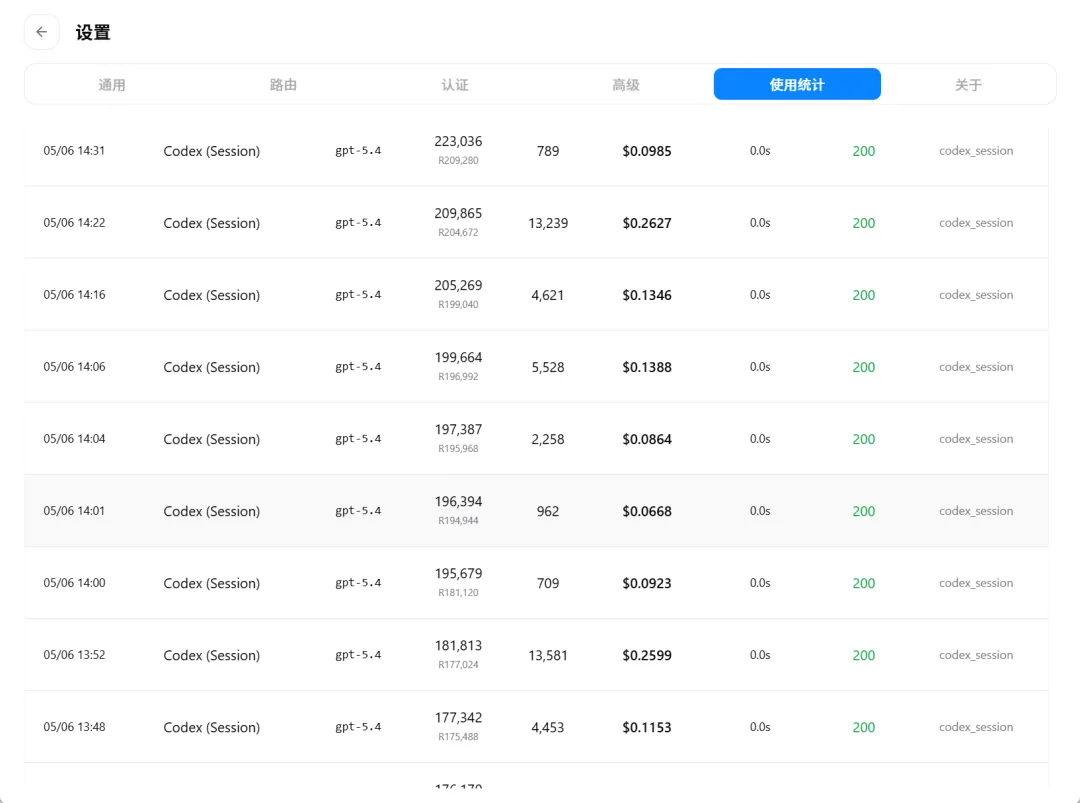

使用量与成-本追踪也是个贴心功能。AI API 调用是要花钱的,CC Switch 提供了使用仪表板,能跟踪支出、请求数和 token 消耗,带趋势图,还支持自定义每模型定价。对需要控制成-本的个人或团队来说,这个功能是刚需。

会话管理器可以浏览、搜索和恢复所有应用的对话历史。有时候你记得之前跟 AI 讨论过某个问题,但忘了在哪个工具里聊的,现在可以在一个地方全部查到。

技术架构

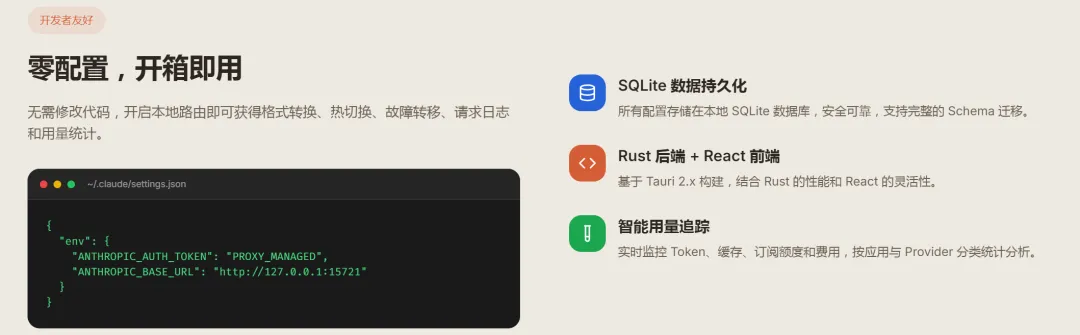

CC Switch 的技术选型比较现代,前端用 React + TypeScript,后端用 Tauri + Rust。

它的架构设计有几个值得说的点。

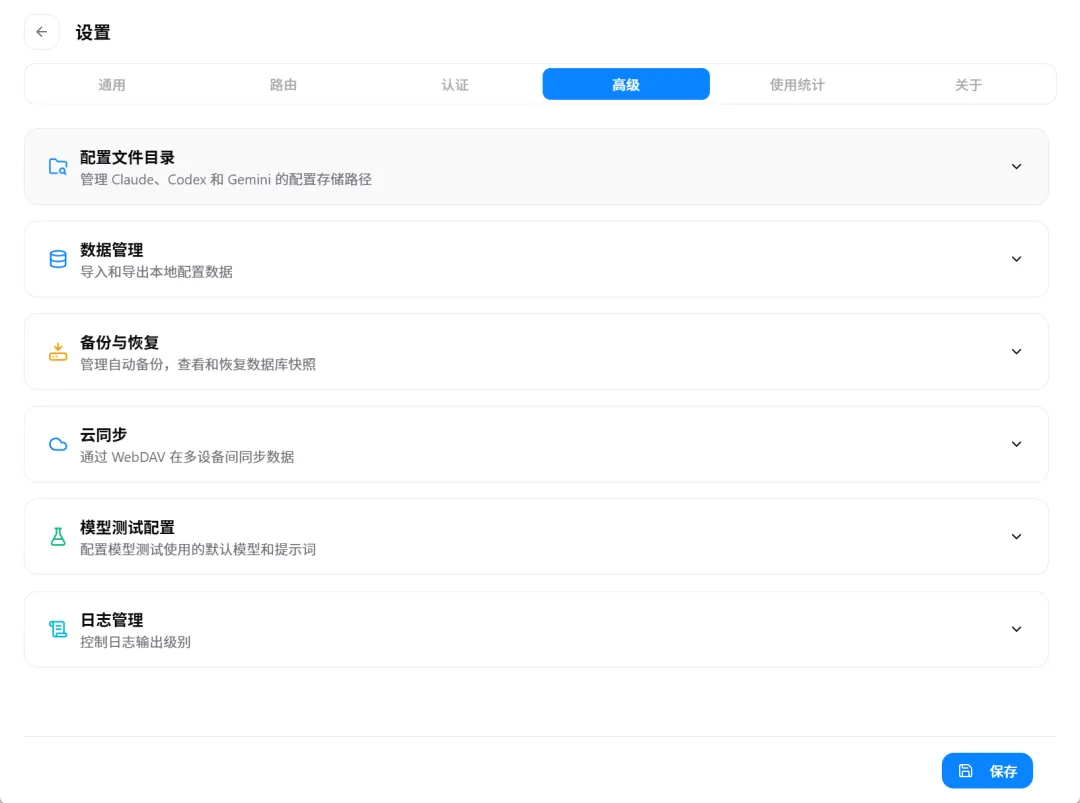

SSOT(单一数据源)原则。所有数据存储在 ~/.cc-switch/cc-switch.db(SQLite 数据库),不管是前端界面操作还是后端服务处理,都从这个数据库读写,避免数据不一致的问题。

双层存储设计。SQLite 存储可以同步的数据(供应商配置、MCP 服务器、提示词、技能),JSON 文件存储设备级的设置(UI 偏好、窗口位置等)。这样的好处是:你的配置可以跨设备同步,但每个设备的个性化设置不会互相干扰。

双向同步机制。切换供应商时,程序会实时写入配置文件;当你在 CC Switch 里编辑当前活跃的供应商时,它也会从实时配置文件里读取最新状态回填到数据库。这样不管你是从 CC Switch 改配置,还是直接在 CLI 工具里改,两边都能保持同步。

原子写入防止配置损坏。它采用”临时文件 + 重命名”的模式来写入配置,而不是原地修改。万一写入过程中程序崩溃,也不会出现配置文件损坏的情况。

并发安全通过互斥锁保护的数据库连接来实现。多个进程同时读写配置的场景在开发环境中很常见,这个设计能避免竞态条件导致的数据错误。

项目采用分层架构:Commands(API 层)→ Services(业务层)→ DAO(数据访问层)→ Database(数据库)。层次清晰,维护起来不费劲。

部署方式

CC Switch 提供了各平台的安装包,开箱即用,不需要从源码编译。

Windows 用户:

-

• 下载 .msi安装包,双击安装 -

• 或者用 .zip便携版,解压就能跑

macOS 用户:

-

• 推荐用 Homebrew 安装,两条命令搞定:

brew tap farion1231/ccswitchbrew install --cask cc-switch-

• 也可以手动下载 .dmg或.zip,包已经过 Apple 代码签名和公证,直接安装即可

Linux 用户:

-

• Debian/Ubuntu 系列用 .deb包 -

• Fedora/RHEL/openSUSE 用 .rpm包 -

• 通用方案用 .AppImage -

• Arch 用户可以直接从 AUR 安装: paru -S cc-switch-bin

开发环境要求(如果你想从源码构建):

-

• Node.js 18+ -

• pnpm 8+ -

• Rust 1.85+ -

• Tauri CLI 2.8+

pnpm install # 安装依赖pnpm dev # 开发模式,支持热重载pnpm build # 构建应用

前端

CC Switch 的前端技术栈比较主流:

-

• React 18 + TypeScript 类型安全,开发体验好 -

• Vite 作为构建工具 热更新速度快,开发效率高 -

• TailwindCSS 3.4 样式框架,快速搭建界面 -

• TanStack Query v5 管理后端 API 调用的缓存与同步,减少重复请求 -

• shadcn/ui UI 组件库,风格简洁 -

• react-hook-form + zod 表单管理和 Schema 验证 -

• @dnd-kit 实现拖拽排序功能(比如拖拽调整供应商顺序)

国际化用 react-i18next,目前支持中文、英文、日文三种语言。

前端代码结构清晰,按功能模块拆分:providers/(供应商管理)、mcp/(MCP 面板)、prompts/(提示管理)、skills/(技能管理)、sessions/(会话管理器)、proxy/(代理面板)等,每个模块独立,方便维护。

后端

后端基于 Tauri 2.8 框架,用 Rust 编写。

选择 Tauri 而不是 Electron 是个明智的决定。Tauri 应用的体积比 Electron 小很多(CC Switch 的安装包只有十几 MB,而 Electron 应用通常是上百 MB),内存占用也更低,启动速度更快。

后端的核心服务包括:

-

• ProviderService 供应商的 CRUD、切换、配置回填、排序 -

• McpService MCP 服务器管理、导入导出、实时文件同步 -

• ProxyService 本地代理模式,支持热切换和格式转换 -

• SessionManager 跨应用的对话历史浏览 -

• ConfigService 配置导入导出、备份轮换 -

• SpeedtestService 测量 API 端点的延迟,帮你选最快的供应商

Rust 的 tokio 提供异步运行时,serde 处理序列化/反序列化,thiserror 统一错误处理。整个后端代码写在 src-tauri/src/ 目录下,按领域拆分成 commands/、services/、database/、proxy/ 等模块。

测试方面,前端用 vitest + MSW(Mock Service Worker)来模拟 Tauri API 调用,后端用 cargo test 跑单元测试。

开源协议

CC Switch 遵循 MIT License 开源协议。

MIT 协议对商用非常友好。你可以自由地使用、复制、修改、合并、发布、分发这个软件,无论是否用于商业目的,只需要保留原作者和许可证的版权声明即可。

对你来说意味着什么?

如果你是公司技术负责人,完全可以放心在团队里推广使用 CC Switch,不用担心许可问题。

如果你想基于 CC Switch 做二次开发,或者把它集成到你自己的产品里,MIT 协议也允许你这么做,只需要保留原作者的版权声明。

即刻体验一波

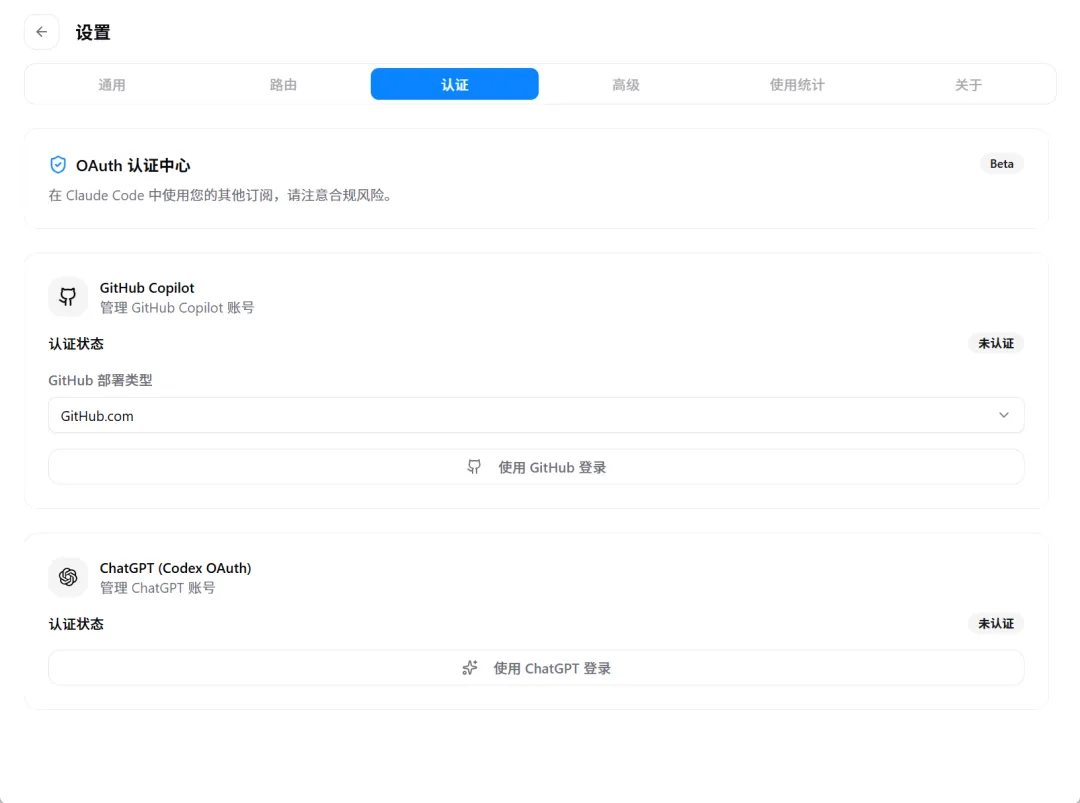

装好 CC Switch 后,首次启动会有一个引导流程,帮你确认登录状态、配置签名绕过等。

主界面里,你可以看到所有已配置的供应商,每个供应商显示 API 类型、模型列表、状态等信息。点击某个供应商可以编辑它的详细配置:API Key、Base URL、模型列表、温度参数等。

系统托盘图标是快速操作的入口。右键点击托盘图标,能看到所有供应商的列表,点击某个供应商就能一键切换,不用打开主窗口。

导入配置很方便。项目提供了 50+ 内置预设,涵盖主流的 API 供应商和社区中继。选择一个预设,填入你的 API Key,就能直接用,不用手动填各种参数。

MCP 管理面板里,你可以添加、编辑、删除 MCP 服务器,还能把配置同步到多个应用。如果你在 GitHub 上发现了一个好用的 MCP 服务器,可以通过 Deep Link 一键导入到 CC Switch。

代理功能在”代理面板”里配置。开启本地代理后,CC Switch 会在本地启动一个代理服务器,把不同格式的 API 请求统一转发到对应的供应商 API,同时提供故障转移、健康监控等能力。

业务场景

场景一:个人开发者同时使用多个 AI 编程工具

你可能在用 Claude Code 写后端,用 Codex 做代码 review,用 Gemini CLI 处理一些特定任务。三个工具的 API 配置各自独立,切换模型要分别改配置。有了 CC Switch,你在一个界面里就能管理所有工具的配置,切换模型也就是点几下的事。

场景二:团队统一 AI 工具配置

团队里每个人都要配置一遍各种 API,新人来了还要手把手教怎么配。用 CC Switch 的导入导出功能,可以把配置导出成一个文件,新人导入后就能直接用,省去重复配置的时间。

场景三:成-本控制

AI API 调用是按量计费的,尤其是 Claude 和 GPT 这类模型,用多了账单挺吓人。CC Switch 的使用仪表板能帮你跟踪每个模型的 token 消耗和花费,哪里花钱多一目了然。你还可以设置自定义定价,按照你们团队实际谈的价格来计算成-本。

场景四:国内网络环境

有些 API 在国内的访问不太稳定,需要配置代理或者用社区中继。CC Switch 的代理功能支持格式转换和自动故障转移,某个端点访问不通会自动切到备用的,不影响开发节奏。

场景五:MCP 服务器管理

如果你在用 MCP 来扩展 AI 工具的能力(比如接入数据库、文件系统、第三方 API),每个工具都要单独配置一遍 MCP 服务器,很繁琐。CC Switch 的统一 MCP 面板能跨应用管理这些服务器,配置一次,多个工具都能用。

说几句实在话

CC Switch 这个工具整体挺实用的,但也不是没有可以改进的地方。

它的功能比较多,第一次打开可能会觉得选项有点多,需要花点时间熟悉界面布局。对只需要简单切换模型的用户来说,有些功能(比如 MCP 管理、Skills 管理、代理配置)可能用不上,但界面上都会显示出来。

另外一个值得注意的地方:CC Switch 需要读取和写入各个 AI 工具的配置文件。虽然它采用了原子写入和自动备份机制,但如果你有高度定制化的配置,建议在第一次使用前先自己备份一下配置文件,以防万一。

项目迭代速度比较快,版本更新频繁。这意味着你能快速用到新功能,但也可能碰到新版本引入的 bug。生产环境使用的话,建议观察一段时间再更新。

结语

CC Switch 处理的是一个真实的痛点 AI 编程工具多了以后,配置管理变得杂乱。它没有被做成云服务,也没有搞付费版,就是个开源的桌面工具,下载就能用。

技术栈选得比较务实,Tauri + Rust 的组合在性能和体积上都有优势,前端用 React + TypeScript 也是主流选择,代码质量看起来不错,分层清晰,测试覆盖也有。

如果你正在同时使用多个 AI 编程工具,或者经常被配置问题搞得烦躁,可以试试这个工具。有 Windows、macOS、Linux 三个平台的安装包,装完就能用。

源码:https://github.com/farion1231/cc-switch

我是刘哥聊技术,开源技术分享博主,独立出海开发者。

日常分享 Java 技术、开源项目和 AI 工具实战经验,欢迎关注交流。

往期项目

开源|一款零服务器代码知识图谱引擎,支持多语言解析、Graph RAG 问答、AI 代理集成的代码分析平台

开源|一款替代 DocuSign 的文档签约平台,支持电子签名、表单填写和 API 集成

开源|一款周增 6000 Star,多个 AI Agent 组建投研团队协作做量化交易Agents

开源|一款 174k Star 的 AI 编码方法论框架,可组合技能系统让 AI 遵循完整工程流程,防止 AI 偷懒跳过流程

了解更多

CC Switch、AI编程工具、Claude Code、开源项目、配置管理

夜雨聆风

夜雨聆风