本地运行大模型再也不用氪金了!这个开源工具让每个人都能训练自己的AI

大家好!我是桃乐,专注于Github开源项目与开源技术的深度测评。欢迎点击上方蓝链关注我~

01

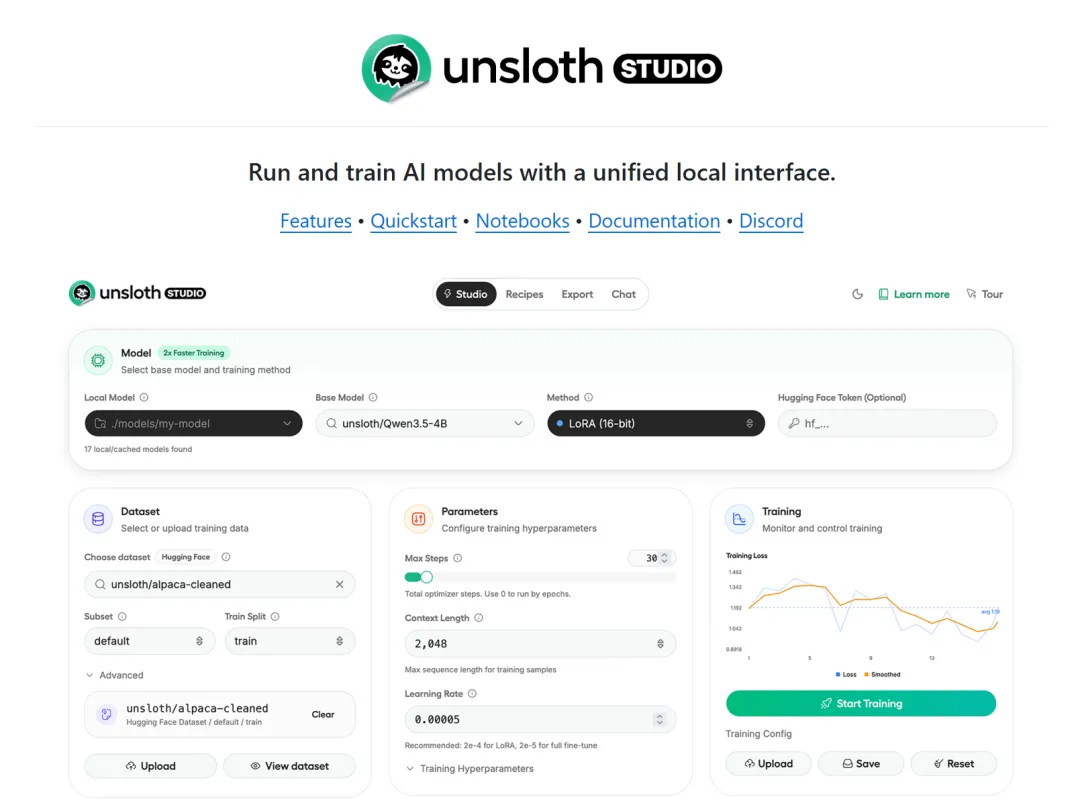

Unsloth 是一个开源的统一 Web 界面,旨在让用户能够在本地轻松训练和运行开源大语言模型,如 Qwen、DeepSeek、Gemma 和 GPT-Oss 等。无需昂贵的云计算资源,无需复杂的技术配置,用户只需通过浏览器即可在个人电脑上完成大模型的微调和部署。这个项目凭借其极低的学习门槛和强大的功能支持,在开源社区迅速走红,目前已在 GitHub 上斩获 56,000+ Star,成为本地大模型领域最受关注的明星项目。

📌项目地址:https://github.com/unslothai/unsloth

02

🌐 统一 Web 界面

Unsloth 提供了一个简洁优雅的 Web 用户界面,将复杂的大模型训练和推理过程封装成直观可操作的功能模块。用户无需编写命令行代码,无需配置复杂的运行环境,只需通过浏览器访问本地服务,即可完成模型训练、推理测试和结果分析的全流程。这种”一键启动”的体验,大大降低了大模型技术的使用门槛,让AI爱好者、开发者甚至普通用户都能参与到本地大模型的探索中来。

🧠 多模型支持

Unsloth 目前支持的主流开源大模型包括:

-

Qwen(通义千问):阿里云推出的开源大模型,性能优异 -

DeepSeek(深度求索):国产开源大模型新秀,代码能力突出 -

Gemma:Google 开源的轻量级模型,适合本地部署 -

GPT-Oss:开源社区贡献的模型变体

这种多模型支持的设计,让用户可以根据自己的需求和硬件条件,灵活选择最适合的模型进行实验。

⚡ 高效训练加速

相比传统的本地训练方式,Unsloth 采用了多项优化技术,显著提升了训练速度并降低了显存占用。这意味着即使用户只有消费级的 GPU 硬件,也能完成模型微调任务。对于想要在特定领域数据上微调模型的用户来说,这无疑是一个重大利好。

💻 完全本地化运行

数据隐私是很多用户关心的问题。Unsloth 所有训练和推理过程都在本地完成,数据无需上传到任何云端服务器。这种完全本地化的设计,让企业和个人用户都能放心使用,不必担心敏感数据泄露的风险。

03

使用方法

# 克隆项目仓库

git clone https://github.com/unslothai/unsloth.git

cd unsloth

# 安装依赖

pip install -r requirements.txt

# 启动 Web 界面

python app.py

启动成功后,打开浏览器访问 http://localhost:7860 即可进入 Unsloth 的 Web 界面。在这里你可以:

-

选择想要使用的大模型 -

上传自己的训练数据集 -

配置训练参数 -

一键启动训练 -

在线测试推理效果

04

-

个人 AI 助手:在本地训练一个专属的问答助手 -

垂直领域微调:用行业数据微调模型,构建专业领域的 AI 应用 -

AI 教育学习:学生和研究人员学习大模型技术的实践平台 -

企业私有部署:对数据安全有要求的企业在本地运行 AI 服务 -

低成本实验:在消费级 GPU 上进行模型实验,降低研发成本

05

优势对比

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

06

Unsloth 的出现,标志着大模型技术从云端向本地迁移的重要里程碑。它让”每个人都能训练自己的 AI“不再是一句口号,而是变成了任何人都可以实践的现实。56,000+ Star 的社区认可,充分证明了这项技术的价值和潜力。

无论你是想要在私有数据上微调模型的开发者,还是对 AI 技术充满好奇心的爱好者,Unsloth 都值得你尝试。它用最简单的方式,让最前沿的大模型技术走进了普通人的电脑。

感谢阅读!我是桃乐,专注于Github开源项目与开源技术的深度测评。如果这篇文章对你有帮助,欢迎点击左下方头像关注一下~我们下期见!

夜雨聆风

夜雨聆风