你的AI助手在偷偷上传你的信息?这个开源项目终于说"不"了

想象一下,你正在用AI助手整理一份包含薪资数字的财务表格,突然意识到——这些数据可能已经飞到某个云服务器了。

不必多虑,这个困扰许多人的痛点,现在有了解决方案。

最近,来自清华、人大、面壁智能等多家机构联手开源了一个项目,叫EdgeClaw。简单说,它就是一只会”看眼色行动”的小龙虾——能分辨什么数据该留在本地,什么可以上云,断网也照样能工作。

为什么我们需要这个项目?

传统方案的隐忧

许多人可能用过 OpenClaw,以为把AI装在本地电脑上就万事大吉了。但现实是——你的数据其实从未真正离开过云端的”怀抱”。

这些日常对话中出现的内容会怎样流转?

-

💬 你在对话框输入的每个想法 -

📄 你上传的各类文件 -

🔧 工具调用返回的结果 -

🔐 那些不小心提起的密码片段

全都会被发送到第三方的云API进行处理。你的密钥、个人隐私、商业机密,实际上都经过了服务商的服务器。这就像表面上在自己家里做饭,但所有食材其实是邻居代购的。

EdgeClaw做的不同之处

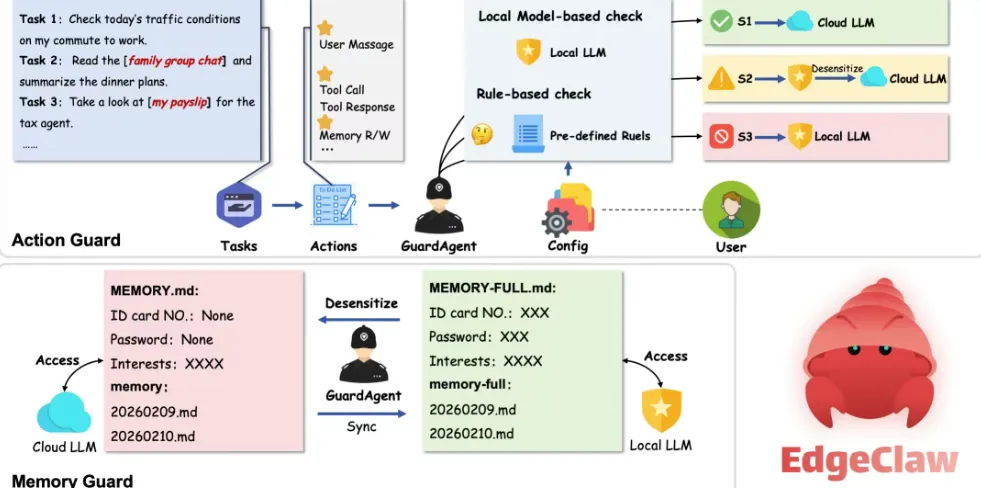

EdgeClaw把安全防护往前推了一大步——它不是简单地在本地跑一个引擎,而是在用户消息和云端之间装上了一套”智能筛分系统”。

核心逻辑很直白:敏感数据绝不出门,普通任务该上云就上云。既不牺牲AI的能力,也不透支隐私。

黑科技核心:GuardClaw智能分级

这套系统怎么知道什么该保护、什么可以共享?答案在于一个叫 GuardClaw 的隐私路由中间件。

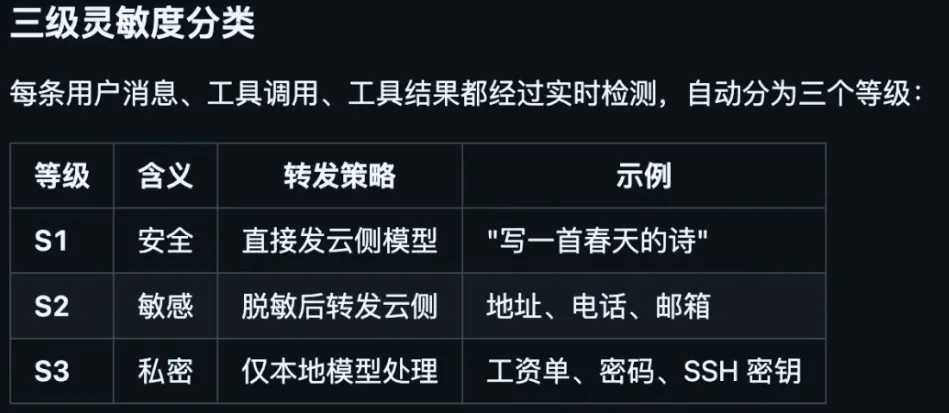

三层自动分级机制

每一条消息从进来的那一刻起,都会经历一场”安全等级评估”:

S1级·安全内容 → 直接交给云端大模型处理

-

通常是那些不涉及个人信息的问题 -

比如”如何高效学习Python”这类通用咨询

S2级·敏感信息 → 脱敏后再转发

-

包含某些隐私线索但不至于完全禁止 -

系统会先把具体的数字、名字换掉,只保留语义框架

S3级·私密内容 → 本地处理,永不外传

-

涉及财务、医疗、身份证、工资单等核心隐私 -

100%由本地模型负责,云端永远看不到

这一切都是完全自动的,无需用户每次都手动选择。就像自适应变速箱一样,系统根据情况自动切换档位。

当然,你也可以设置成”偏执模式”——所有任务都走本地,这样就变成了一个纯离线的OpenClaw。

怎么做到秒级识别?

EdgeClaw用了个聪明的双引擎方案:

第一层:规则引擎(毫秒级反应)

-

用正则匹配和关键词扫描 -

识别那些”明确的危险信号”——密码格式、身份证号、API密钥这些 -

速度快到你几乎察觉不到

第二层:本地模型引擎(1-2秒精准判断)

-

调用本地MiniCPM进行语义理解 -

处理那些更微妙、更有”上下文依赖”的隐私场景

举个实际例子: 当你说”帮我检查一下工资单,看有没有计算错误”,这句话里没有任何敏感词。但模型会理解——工资单=财务隐私=S3级=本地处理。这就是真正的”理解”,而不是死板的关键词匹配。

当你说”帮我检查一下工资单,看有没有计算错误”,这句话里没有任何敏感词。但模型会理解——工资单=财务隐私=S3级=本地处理。这就是真正的”理解”,而不是死板的关键词匹配。

两个引擎并行运行,谁识别出的风险等级更高,系统就采用谁的判断。保险起见。

关键细节:6个检查点的全链路保护

这里很多人容易忽视一点——AI Agent的工作远不止一问一答。

一个完整的Agent执行流程可能涉及:

-

🗂️ 读取本地文件 -

🔧 调用各类工具 -

🎯 生成任务分支(子Agent) -

💾 写入长期记忆 -

📡 往外发送结果

如果只在入口检查一次,中间环节的数据泄露风险根本没消除。

EdgeClaw在整个流程中设置了6个核心防守位置:

1️⃣ 消息入口→ 初步分级

2️⃣路由分流→ 决定走向

3️⃣工具调用拦截→ 阻止敏感工具链接云端

4️⃣结果检查→ 扫描工具返回内容

5️⃣会话记录→ 隔离云端和本地的对话历史

6️⃣记忆同步 → 确保私密信息不混入公共上下文

再加上出站消息扫描和子Agent隐私注入,一共形成8个防护钩子。

特别有意思的是记忆隔离机制——云端模型看到的对话历史都是脱敏版本,完整的会话记忆只有本地模型才能访问。这从根本上切断了隐私数据通过”对话历史”这个后门泄露给云服务商的可能。

模型支持:为什么选MiniCPM?

本地推理需要用什么模型?EdgeClaw推荐的是面壁自研的MiniCPM系列——被称为”端侧小钢炮”的一族。

为什么选这个系列?

✅ 模型家族完整 —— 从轻量级到高性能应有尽有

✅ 硬件友好 —— 量化版只需8GB内存就能跑

✅ 开源透明 —— 完全可控,没有黑盒操作

✅ 中文优化 —— 本土模型,中文理解能力更强

安装也超简单。装好Ollama后,一条命令启动:

ollama run openbmb/minicpm4.1

就这样,你的本地隐私小助手就活了。

根据你的硬件配置,可以自由选择MiniCPM的不同版本——参数越大、能力越强,但也越吃内存。根据自己的机器来选就行。

EdgeClaw Box:懒人方案

如果搭环境太麻烦,面壁智能还推出了配套硬件产品——EdgeClaw Box。

这是什么?可以理解为”预装了安全OS的小型服务器”。

目前已适配:

-

🍊 松果派 -

🖥️ 英伟达DGX Spark -

🍎 苹果Mac Mini

买来插上电源,立刻可用,不需要任何技术背景。里面集成了:

-

多设备同步 -

多模型管理 -

海量通用Skills -

行业专属插件库 -

完整的隐私防护

简单任务调用本地小模型零Token成本,复杂计算才用云端大模型。对于重视隐私和成本的用户来说,真的是开箱即用。

这个项目的意义是什么?

从更高层看,EdgeClaw代表了一种新的AI使用哲学——

不是”隐私和能力二选一”,而是”隐私和能力兼得”。

你不必为了享受先进AI而被迫献出隐私,也不必为了保护隐私就放弃先进技术。系统足够聪明,会自动帮你在这两个维度上取得平衡。

这是由清华THUNLP、中国人民大学、AI9Stars、面壁智能和OpenBMB联合打造的成果,汇聚了国内最强的NLP研究团队和实业力量。

对我们意味着什么?

🔒 数据主权回到个人 — 敏感信息不再是云服务商的”资产”

💰 成本透明 — 小任务不产生任何Token消耗,大任务才付费

🛡️ 商业保护 — 对企业用户,再也不用担心商业机密泄露给竞争对手

⚡ 永远可用 — 断网也能运行,不依赖云端连接

现在就可以上 GitHub 体验(项目地址:https://github.com/OpenBMB/EdgeClaw)

或许用不了多久,每个人桌上都会跑着自己的AI小龙虾。那时候,”隐私”才真的不再是个问题。

夜雨聆风

夜雨聆风