测测你的电脑能不能跑大模型?用这个工具快速自测!

大家好呀,我是飞鱼

之前我想在本地部署一个大模型玩玩,但是不知道我的电脑配置能带动哪些模型。

后面发现了一个网站:https://www.canirun.ai/

❝

它可以去自动检测你的电脑配置,告诉你哪些大模型能够去跑的有多快,哪些你的电脑根本就带不动。

所以你可以再也不用去盲目下载几十G的模型来去碰碰运气了。

具体就是打开网站以后它会自动识别出你的电脑配置:

❝

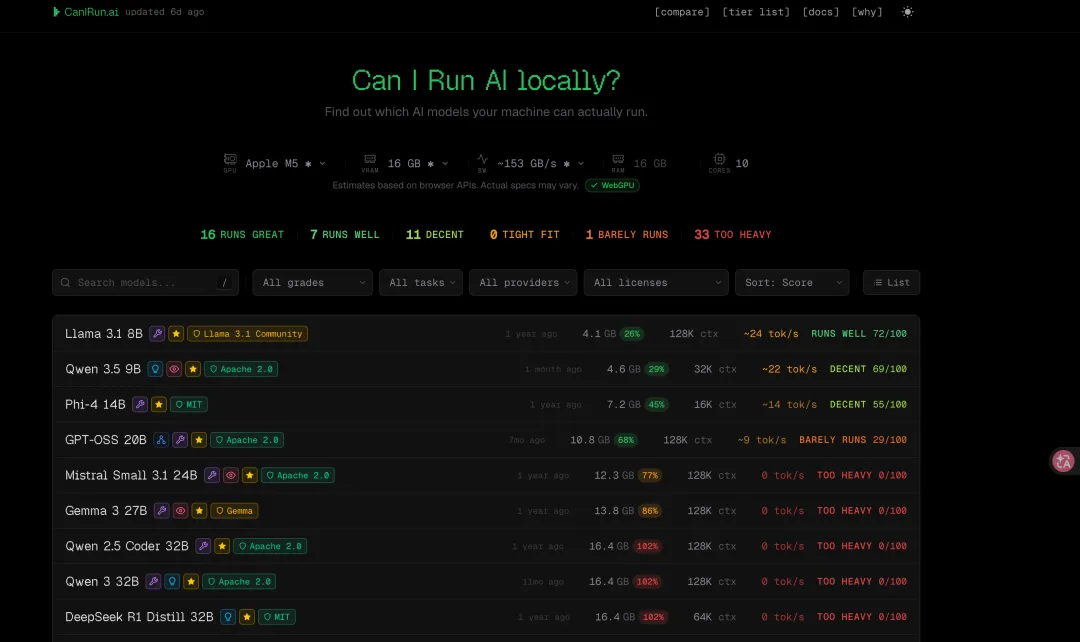

我用的是 Apple M5 的这个芯片,有 16G 的显存,大约 153 G 每秒的内存带宽,以及 16G 的 RAM 的内存,包含 10 核的处理器。

反正不需要你手动去填写任何的参数。

❝

你看像 LLAMA3.18 B,像千问 3.59 B,它都显示我能够去流畅运行。

但是像 Mixtral Small 24 B,Gemma 327 B 这一大模型就超出了内存的限制,直接给我标红了。

简单总结一下这个网站到底能够去做什么。

第一个就是它能够去做你的电脑的自动硬件检测:

❝

你的显存大小、你的内存带宽、你的芯片等等都能检测到。

第二个就是它提供了兼容性的评分:

❝

每个模型对应的是 0~100 的综合评分,并且归入到五个等级。

一眼就能看清哪些是能够去跑的,哪些你根本就带不动。

第三个就是 TOKEN 的速度预估:

❝

不止告诉你能不能跑,还会根据内存带宽去估算实际的推理速度。

通常是每秒大于等于 20Token 才有流畅的对话体验,这个指标非常有用。

第四个就是可以横向对比:

❝

可以直观地去比较不同的模型在同一硬件上的表现差异。

然后我再给大家讲一讲,到底它怎么去用,其实完全零门槛。

第一步就是打开网站,第二步就是等待自动检测了,页面加载好完以后会自动的去读取硬件信息,几秒内就完成了。

❝

那如果数值不准,可以去点击对应的参数手动去修正。

第三步就是按需去筛选以及去选模型,你可以根据评级,根据任务类型去做过滤。

❝

锁定目标模型以后,点击模型名即可跳转到 HuggingFace 或者 LLama 的下载页,直接去上手。

有个实用技巧,你可以把 Sort 改成按照 Speed 排序,可以快速找到在你的设备上跑得最快的模型。

其实很多本地大模型的硬件门槛是对普通用户不透明的:

❝

一个模型几乎可以跑和流畅可用之间的差距往往就是内存带宽的瓶颈,而不是内存大小。

总体而言,这个网站是目前同类工具里面体验最好的一个,不需要注册,不需要安装,即开即用,信息密度高,但是不杂乱。

对于想要去入门本地部署大模型的人,这应该算是最好的工具了。

而对于已经在跑大模型的人,也可以用来去快速对比新发布的模型。

夜雨聆风

夜雨聆风