阿里开源文档解析模型:一个模型搞定 PDF 解析,公式、表格、手写体、信息图、乐谱全都行

Logics-Parsing 是阿里巴巴通义实验室开源的端到端文档解析模型,基于 Qwen2.5-VL-7B 视觉语言模型,通过监督微调(SFT)和强化学习(RL)训练而成。它能将 PDF 页面图像直接转换为结构化 HTML 输出,支持普通文本、数学公式、表格、化学结构式、手写中文等多种内容类型。

传统的文档解析方案要么是流水线拼接(OCR + 版面分析 + 表格识别 + 公式识别),模块多、误差累积;要么是端到端模型但对复杂版面束手无策。Logics-Parsing 用一个模型统一解决所有问题,在自建的 1,078 页基准测试中取得了 SOTA(最优)性能,甚至超越了 GPT-5 和 Gemini 2.5 Pro。

核心特性

1. 端到端,一步到位

-

• 输入:PDF 页面图像 -

• 输出:结构化 HTML -

• 不需要拼接多个模块,一个模型完成 OCR、版面分析、表格识别、公式识别、阅读顺序推断 -

• 告别传统流水线的误差累积问题

2. 强化学习优化版面理解

这是 Logics-Parsing 的核心创新。模型训练分两个阶段:

-

• 第一阶段:监督微调(SFT)——学习生成结构化输出的基本能力 -

• 第二阶段:版面中心强化学习(RL)——通过精心设计的奖励机制,优化三个关键维度: -

• 文本准确性:OCR 识别精度 -

• 版面定位:元素位置的准确性 -

• 阅读顺序:多栏报纸、海报等复杂版面的正确阅读序列

3. 多种内容类型全覆盖

-

• 普通文本:中英文混排,多栏、多段落 -

• 数学公式:行内公式、独立公式块 -

• 表格:复杂合并单元格、嵌套表格 -

• 化学结构式:分子式、反应方程式 -

• 手写中文:手写体识别 -

• 所有类型统一在一个模型中处理,无需切换

4. 基准测试全面领先

在自建的 LogicsParsingBench(1,078 页,9 大类,20+ 子类)上的表现:

|

|

|

|

|---|---|---|

| Logics-Parsing | 端到端模型 | 0.124(英)/ 0.145(中) |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Edit 距离越低越好。一个 7B 参数的模型,在文档解析任务上全面超越 72B 的通用大模型和主流商业工具。

5. 已进化到 Omni 版本

团队已发布 Logics-Parsing-Omni,将解析能力从文档扩展到图像和音视频流:

-

• 统一分类体系:覆盖文档、图像、音视频 -

• 三层渐进式解析:整体检测 → 细粒度识别 → 多层级理解 -

• 证据锚定机制:高层语义描述与底层事实严格对齐,实现”有据可查”的结构化输出

快速开始

1. 环境安装

conda create -n logics-parsing python=3.10

conda activate logics-parsing

pip install torch==2.5.1 torchvision==0.20.1 torchaudio==2.5.1 --index-url https://download.pytorch.org/whl/cu1242. 下载模型权重

# 从 ModelScope 下载

pip install modelscope

python download_model.py -t modelscope

# 或从 Hugging Face 下载

pip install huggingface_hub

python download_model.py -t huggingface3. 运行推理

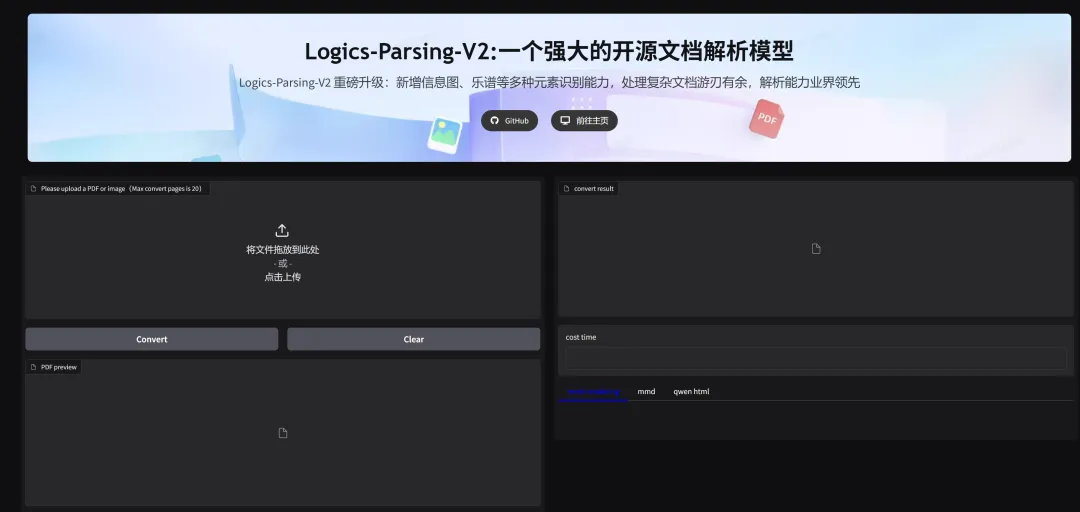

python3 inference.py --image_path 你的PDF图片路径 --output_path 输出路径 --model_path 模型路径4. 在线体验

阿里提供了在线 Demo 平台,可以直接上传 PDF 页面图片体验解析效果,无需本地部署:

-

• 在线 Demo: https://logics.alibaba-inc.com/parsing/

应用场景

场景 1:学术论文解析

传统痛点:论文 PDF 包含双栏排版、数学公式、表格、参考文献,传统工具经常把阅读顺序搞乱,公式识别错误

解决方案:Logics-Parsing 通过强化学习优化阅读顺序推断,双栏论文也能正确解析,公式和表格一并搞定

场景 2:化学/生物文献数字化

传统痛点:化学结构式是图像,传统 OCR 完全无法处理

解决方案:模型在训练中加入了化学公式数据,能直接识别分子结构式并输出结构化表示

场景 3:手写笔记/档案数字化

传统痛点:手写中文识别率低,尤其是混合印刷体和手写体的文档

解决方案:模型专门针对手写中文进行了微调,在手写内容解析上表现突出(Edit 距离 0.252,远优于大多数竞品)

场景 4:企业文档批量处理

传统痛点:合同、报表、说明书格式各异,需要针对不同类型配置不同的解析流水线

解决方案:一个模型统一处理所有文档类型,部署和维护成本大幅降低

常见问题

Q1:模型需要什么硬件?

基于 Qwen2.5-VL-7B,7B 参数量级。推荐使用 NVIDIA GPU(至少 16GB 显存),支持 CUDA 12.4。

Q2:支持中文吗?

完全支持。模型在中英文文档上都进行了训练和评测,中文表现同样优秀。

Q3:和 MinerU、doc2x 等工具相比如何?

在 LogicsParsingBench 基准测试中,Logics-Parsing 在综合指标上全面领先。尤其在化学结构式(Edit 0.519 vs 1.0)和手写内容(Edit 0.252 vs 0.387)上优势明显。

Q4:可以商用吗?

模型基于 Qwen2.5-VL 开源,具体商用条款请参考模型许可协议。

Q5:和 Logics-Parsing-Omni 是什么关系?

Logics-Parsing 专注文档解析,Logics-Parsing-Omni 是其升级版,将解析能力扩展到图像和音视频领域,是一个全模态解析框架。

资源链接

-

• Hugging Face 模型: https://huggingface.co/Logics-MLLM/Logics-Parsing -

• GitHub 仓库: https://github.com/alibaba/Logics-Parsing -

• 在线 Demo: https://www.modelscope.cn/studios/Alibaba-DT/Logics-Parsing/summary

请在微信客户端打开

夜雨聆风

夜雨聆风