AI也玩愚人节?Claude Code源码泄露,国产大模型又该大升级了

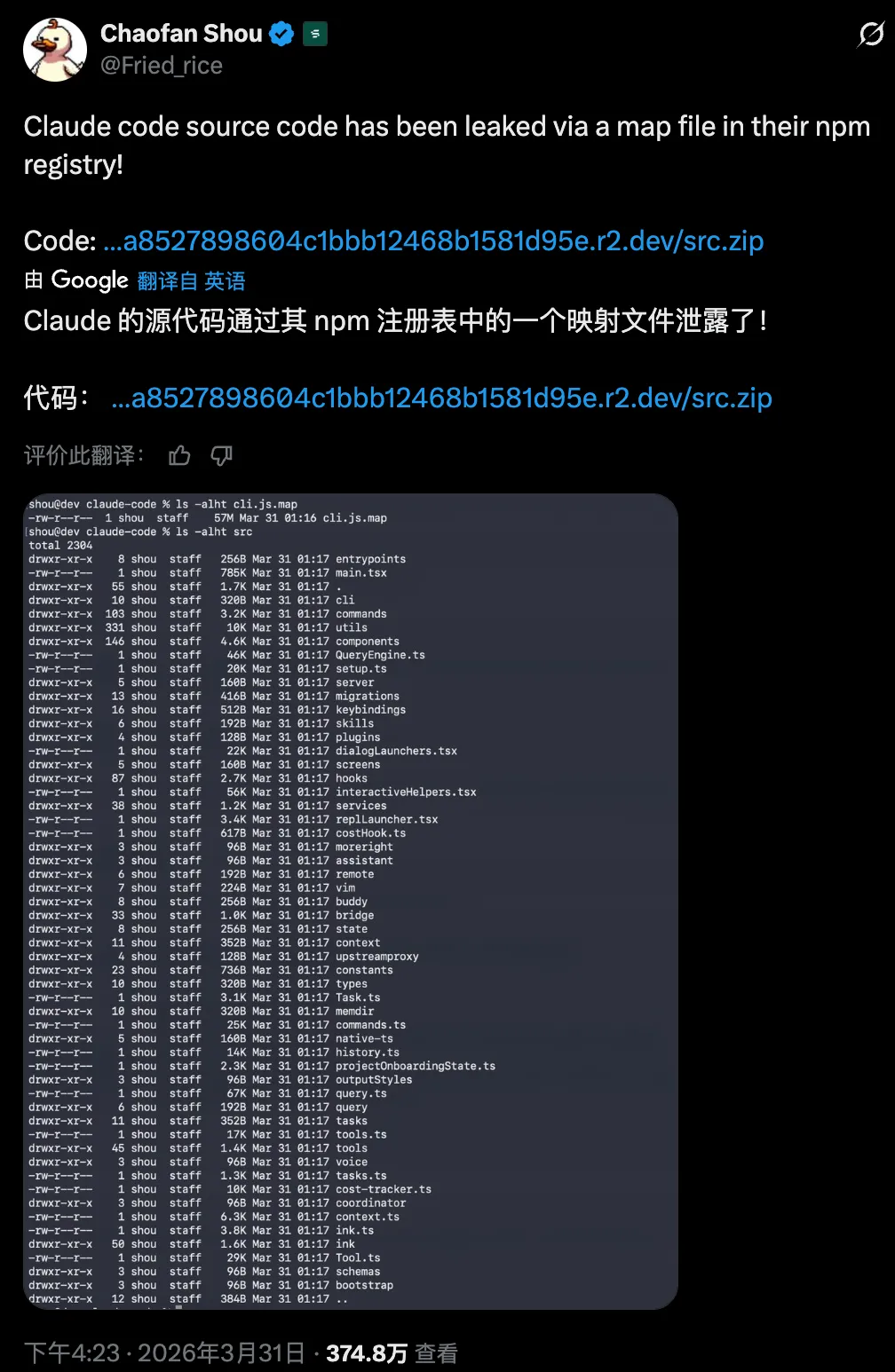

2026年3月31日,AI行业发生了一起堪称“史诗级”的技术泄露事件。

Anthropic旗下核心AI编程工具Claude Code的完整源代码,因一次低级的npm打包配置失误,通过一个59.8MB的source map文件被彻底曝光。超过51.2万行TypeScript代码、1906个核心源文件、40余个工具模块,以及多项尚未发布的功能,在数小时内被全球开发者疯狂fork和传播。这场意外不仅让Anthropic陷入尴尬境地,更可能重塑全球AI编程工具乃至整个大模型产业的竞争格局。

泄露后网友们开始疯狂fork:

01 事件回顾:一次“教科书级”发布失误

事件的起因简单得令人难以置信。Anthropic在发布Claude Code 2.1.88版本的npm包时,未能在构建配置中正确排除用于调试的source map文件(cli.js.map)。这个文件本质上是一个JSON格式的映射表,其中直接包含了所有TypeScript源文件的完整内容。任何开发者只需运行npm install @anthropic-ai/claude-code,就能通过简单的脚本提取出全部原始代码。

泄露的规模远超预期:总计4756个源文件,其中1906个为Claude Code自身的TypeScript/TSX源码,其余2850个为node_modules依赖。代码库采用React + Ink构建终端界面,运行于Bun运行时,核心是一个支持自然语言输入和斜杠命令的REPL循环,底层通过工具系统与LLM API交互。

更令人惊讶的是,这已是Anthropic在短短两个月内第二次犯下类似错误。2025年2月,该公司就曾因配置问题导致内部文件泄露,紧急修复后却在同一地方再次“翻车”。

02 Anthropic损失惨重

知识产权损失难以估量

此次泄露相当于将其最核心的工程实现逻辑免费赠予全球竞争对手。而此次泄露代码中最受关注的是多项从未公开的功能。

Anthropic一直以“安全优先”作为核心卖点,但连续两次的源代码泄露事件严重动摇了这一形象。尽管公司强调“没有涉及或泄露任何敏感的客户数据或凭证”,只是“人为错误导致的包装问题”,但核心代码库的完全暴露已构成知识产权层面的重大损失。

03 国内大模型:老天追着喂饭

在AI编程Agent领域,国内厂商原本落后于Anthropic、OpenAI等国际巨头。此次泄露相当于“白送”了一份顶级AI编程工具的完整工程实现。正如业内评论所言:“这几乎等于白捡了一份‘下一代产品路线图’”。

Claude Code的架构设计体现了Anthropic对“AI工程师”的终极理解:它不是一个简单的API封装,而是一个完整的运行时系统。从启动优化(并行预取MDM设置、钥匙串信息和API预连接)到权限系统(五种权限模式、YOLO分类器分析Bash命令危险性),从上下文压缩(三层压缩策略确保“无限对话”)到多智能体协调(Coordinator模式下主Agent可派生Worker Agent),这些工程细节为国内厂商提供了宝贵的参考。

可以预见,源码一出来,国内大厂们可能第一时间开始“学习”,结合本土开发者的使用习惯和国内开发环境特点,快速构建自己的AI编程Agent。

04 小结

此次事件也为国内AI企业敲响了研发安全与发布合规的警钟。Anthropic的失误源于最基本的构建配置疏忽,这提醒所有技术公司必须建立严格的代码发布审核流程,特别是对于包含敏感知识产权的产品。

Claude Code的泄露可能显著降低AI Agent研发的技术门槛。原本需要大量试错和工程积累才能实现的架构设计,现在可以直接参考甚至复用。这可能导致AI编程工具市场的竞争加剧,Anthropic的先发优势被削弱。

事件发生后,有开发者调侃“Anthropic真该改名叫OpenAI”。虽然这是玩笑,但确实反映了业界对AI技术开放程度的思考。当闭源公司的核心代码因失误而“被动开源”时,真正的开源项目可能获得更多信任。

尽管Anthropic已通过DMCA版权投诉下架了部分公开传播的代码,但源码一旦进入公共领域就难以彻底回收。使用这些代码进行商业开发可能面临法律风险,但用于研究和学习则处于灰色地带。这为AI行业的知识产权保护提出了新课题。

更多垂直投资Skill陆续推出中,进入AI小二,马上免费体验:

AI小二网页版,“码”上使用

AI小二 App端,点击左下角“阅读原文”

AI小二 App端,点击左下角“阅读原文”

风险提示:上述案例仅作参考之用,不作为任何投资决策或者投资建议,据此操作,风险自负。

夜雨聆风

夜雨聆风