Claude源码"泄漏":AI巨头的一次意外"裸奔"与透明化启示

最近,AI圈子里流传着一个消息:Anthropic的Claude Code部分开发代码被意外暴露在GitHub上。一时间,”泄漏”这个词让不少人紧张起来——AI公司的核心机密是不是被公开了?用户数据是不是危险了?

冷静下来仔细想想,这件事远没有想象中那么可怕,反而给了我们一个难得的机会:窥探AI巨头背后的真实工程实践,并重新思考一个问题——AI公司到底该不该更透明?

一、泄漏的到底是什么?先别急着恐慌

消息一出,很多人的第一反应是:”完了,Claude的核心算法被人偷走了。”

但事实并非如此。

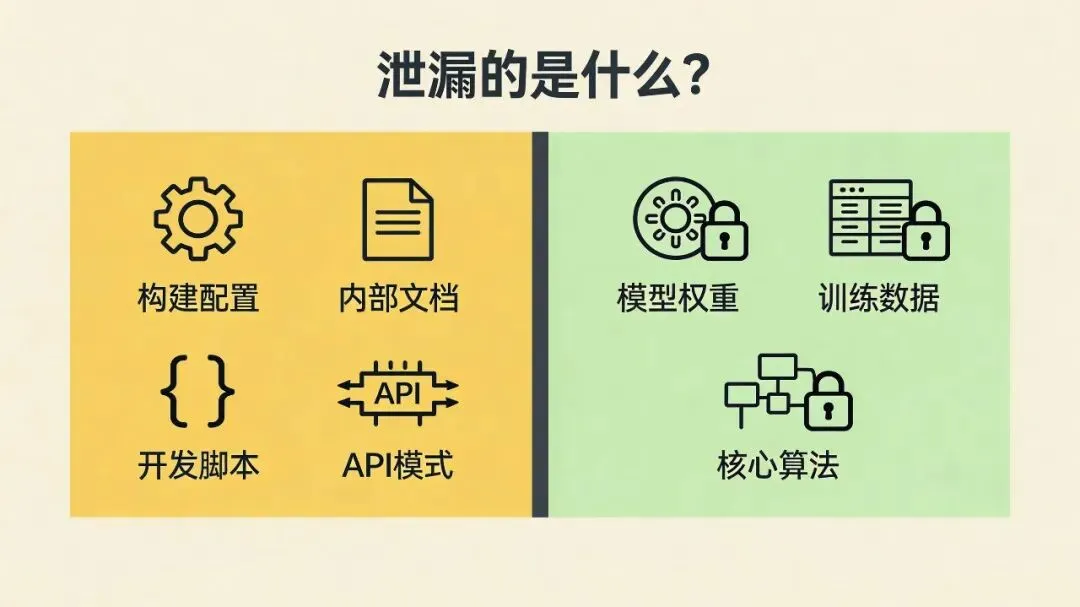

根据目前能查到的信息,这次暴露的内容主要是:

-

• 构建配置文件:告诉开发者怎么把代码打包成产品 -

• 内部文档:团队协作的说明书 -

• 开发脚本:自动化测试、部署的工具 -

• API集成模式:跟其他服务怎么对接

换句话说,这些都是”怎么干活”的工具,而不是”干活的核心能力”。

打个比方:这就像是你偶然看到了一家顶级餐厅的厨房工作流程——厨师用什么锅、怎么安排工序、厨房里有哪些工具。但你并没有拿到那道招牌菜的秘方,更没有学会厨师的刀工和火候掌控。

真正让Claude强大的东西——模型权重、训练数据、核心算法架构——一个都没漏。

所以,先别急着恐慌。

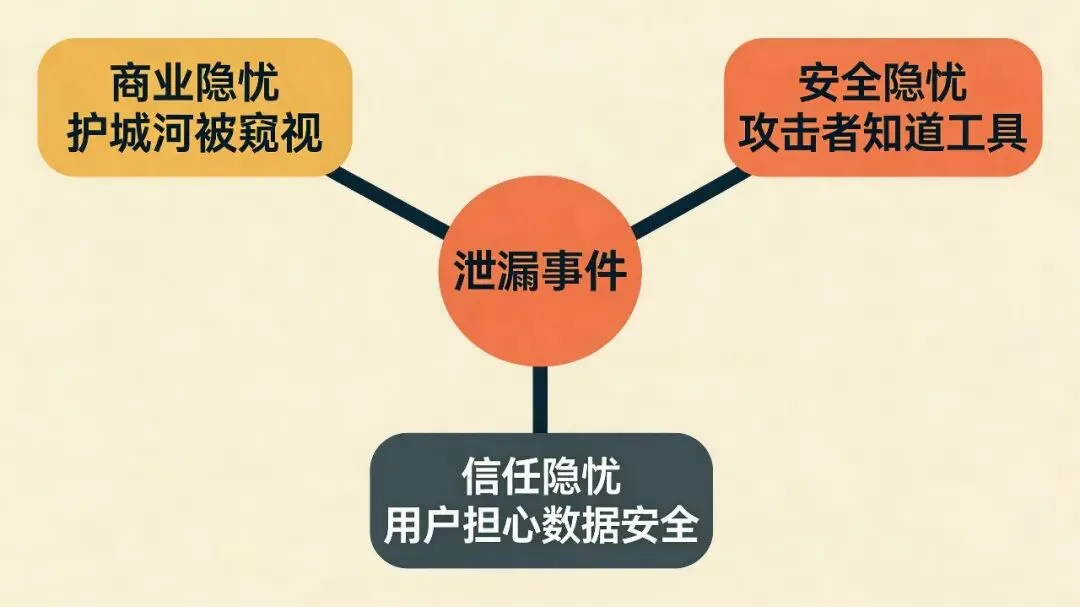

二、负面看:三重隐忧

当然,说”完全没事”也太天真。这次暴露确实带来了一些值得担忧的问题。

商业隐忧:护城河被窥视

AI行业竞争激烈,每家公司都在努力建立自己的技术护城河。虽然这次泄漏的不是核心模型,但暴露开发工具和流程仍然有价值——竞争对手可以看到Anthropic用什么技术栈、怎么组织团队、采用什么开发范式。

这不是致命打击,但确实让人不舒服。就像你精心布置的家,突然被邻居看到了装修方案——不影响房子本身,但你的”独特性”被削弱了。

安全隐忧:攻击者知道了你的工具

从安全角度,暴露开发配置意味着潜在的攻击者获得了更多信息。他们可以研究你用什么框架、什么版本、什么依赖库,从中寻找漏洞。

这就像城堡的防御图纸被人看到了——城墙还是城墙,但攻城的人有了更清晰的目标。

信任隐忧:用户会问”我的数据安全吗”

这才是最微妙的影响。普通用户可能不理解”模型权重”和”构建脚本”的区别,他们只听到”Claude泄漏了”,然后开始担心:”这家公司连自己的代码都保护不好,我的数据在他们那里安全吗?”

信任一旦动摇,修复起来很难。

三、正面看:意外收获的三重价值

但如果我们换个角度,这次”意外透明”也有它的价值。

透明性红利:打破AI公司的黑箱

AI公司向来神秘。它们的网站通常只有漂亮的营销文案,很少透露技术细节。用户不知道模型怎么工作、数据怎么处理、安全措施到底是什么。

这种”神秘”长期积累下来,形成了行业的一个怪现象:越是看不清的东西,人们越是不信任。

这次泄漏,恰恰打破了这种局面。我们第一次看到了顶级AI公司背后的真实工程实践——他们用什么工具、怎么组织开发、有什么样的内部流程。这些信息对理解AI公司的运作方式,远比公关稿有价值。

学习价值:开发者可以借鉴真实经验

对于开发者社区,这是难得的学习素材。你可以看到Anthropic怎么搭建开发环境、怎么写自动化脚本、怎么处理API集成。这些都是真实的生产经验,比任何教程都更贴近实战。

这不是”偷师”,而是”观摩”——就像看一位顶级运动员的训练日常,你学不到他的天赋,但可以学到他的方法。

行业反思:推动”开源 vs 闭源”的深层讨论

这次事件也把一个长期被回避的问题摆到了台面上:AI到底该不该更开放?

过去几年,AI行业的主流叙事是”闭源即安全”。核心技术必须保密,否则会被滥用。但这个逻辑真的成立吗?

看看这次泄漏:暴露的是工程细节,不是模型核心。这说明AI公司的”核心竞争力”和”工程实践”是两回事。前者确实需要保护,后者其实没必要这么神秘。

也许,适度公开工程实践,反而能让行业更健康发展——让更多人理解AI是怎么做出来的,减少神秘感带来的恐惧和误解。

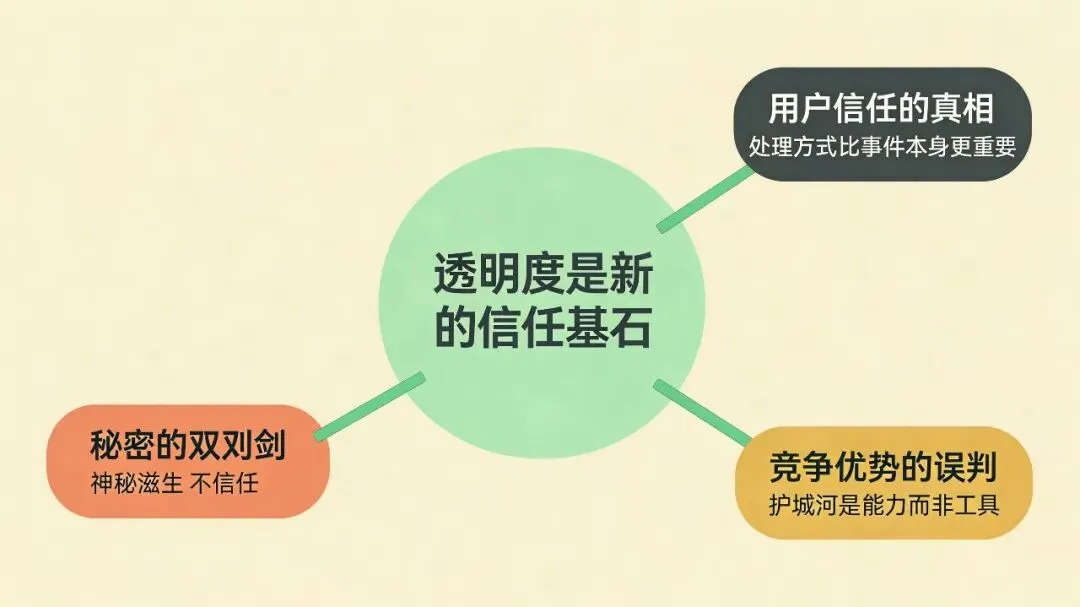

四、辩证深化:泄漏背后的三重悖论

这次事件,表面看是一次安全失误,深层次却揭示了AI行业的几个结构性矛盾。

悖论一:”秘密”的双刃剑

AI公司长期依赖”神秘”来建立护城河。核心技术保密,外界不知道模型怎么训练、用了什么数据、有什么限制。这种神秘感既是保护,也是壁垒。

但神秘也有代价:它滋生了不信任。

用户不知道AI怎么工作,自然会产生疑虑——它会骗我吗?它会偏见吗?它安全吗?这些疑问无法从公关文案中得到答案,只能通过更透明的信息披露来消解。

这次”被迫透明”恰好证明:适度公开可能比绝对保密更安全。暴露工程细节没有伤害核心能力,反而让外界对AI公司有了更真实的认知。

秘密保护的是技术,但透明才能建立信任。

悖论二:”竞争优势”的误判

很多人担心泄漏会让Anthropic”失去优势”。但仔细想想:Anthropic的核心竞争力到底是什么?

是Claude模型的对话能力、推理水平、安全表现。这些来自模型权重和训练方法,不是构建脚本。

暴露开发工具,就像公开了厨师的刀具品牌,但没公开他的刀工训练方法。竞争对手可以买同样的刀,但切不出同样的菜。

这次事件提醒行业:真正的护城河是能力,不是工具。 把精力放在建立真正的技术优势上,而不是过度保护表面的工程细节。

悖论三:”用户信任”的真相

用户看到”泄漏”新闻,第一反应是担心安全。但这种担心基于一个误解:把”代码暴露”等同于”数据泄露”。

两者完全不同。代码暴露是公司自己的工具被看到;数据泄露是用户的信息被偷走。前者伤害公司的保密能力,后者伤害用户的隐私权益。

这次事件恰好没有涉及用户数据。更重要的是,Anthropic的快速响应——发现问题、立即修复、公开说明——恰恰证明了它的安全能力。

如何处理泄漏,比泄漏本身更能反映一家公司的能力。

五、给读者的建议

下次看到”AI公司泄漏”的新闻,别急着恐慌。先问三个问题:

-

1. 泄漏的是什么? 模型核心还是工程细节? -

2. 有没有用户数据? 真正的安全风险在哪里? -

3. 公司怎么应对? 快速修复还是拖延隐瞒?

学会区分”核心机密”和”工程细节”,你就不会被”泄漏”这个词吓到了。

结语

这次Claude源码的意外暴露,更像一面镜子——照出了AI行业长期存在的”透明焦虑”。

AI公司习惯了神秘,用户习惯了猜测,媒体习惯了炒作。三方都在一种不透明的氛围中博弈,却忘了最简单的道理:信任建立在了解之上,而非未知之中。

也许,这场”被迫的透明化实验”,能让行业开始思考一个新方向——不是更神秘,而是更坦诚;不是更封闭,而是适度开放。

因为在AI时代,透明度可能才是新的信任基石。

夜雨聆风

夜雨聆风