开源统一文档解析新SOTA:1.2B参数的MinerU2.5如何超越72B通用VLM

论文标题:MinerU2.5: A Decoupled Vision-Language Model for Efficient High-Resolution Document Parsing

作者团队:Junbo Niu*, Zheng Liu*, Zhuangcheng Gu*, Bin Wang* 等 | 上海人工智能实验室、北京大学、上海交通大学

发布时间:arXiv:2509.22186v2(2025年9月29日)

论文地址:https://arxiv.org/abs/2509.22186

开源地址:https://github.com/opendatalab/MinerU

背景/目标:文档解析是RAG、智能文档分析等下游任务的基础。高分辨率文档图像内容密集、结构复杂,现有端到端VLM方法面临严重的token冗余问题(O(N²)复杂度),而传统流水线方法存在误差传播和布局信息丢失的问题。

方法:提出MinerU2.5,一个1.2B参数的解耦型文档解析VLM,采用粗到细的两阶段解析策略:第一阶段在降采样的缩略图上进行全局布局分析,第二阶段根据布局引导裁剪原始高分辨率图像区域进行精细内容识别。模型基于Qwen2-VL架构,NaViT视觉编码器(675M)+ Qwen2-Instruct语言解码器(0.5B)。

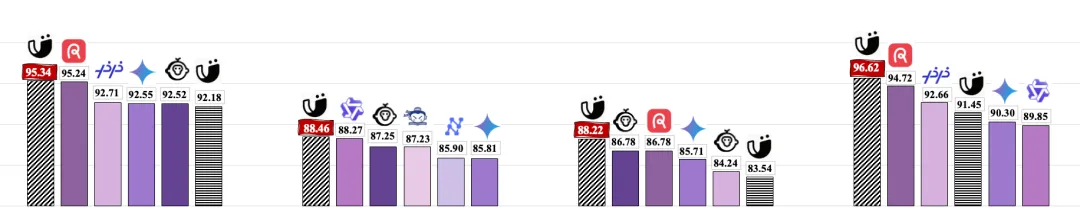

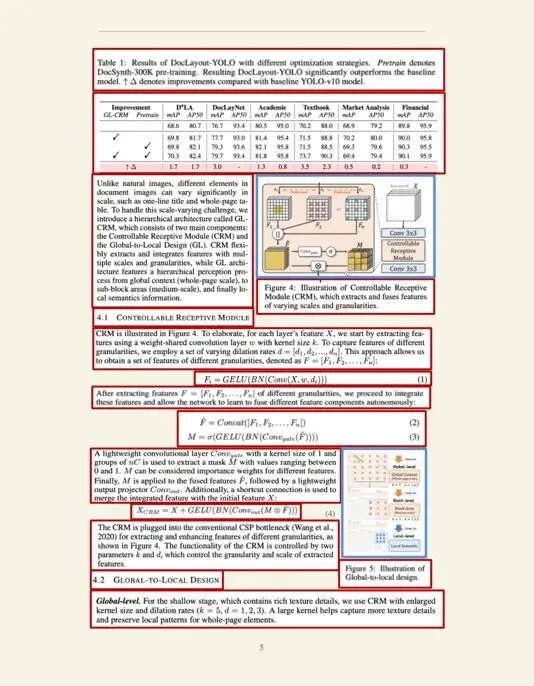

结果:在OmniDocBench上取得SOTA,文本识别、公式识别、表格识别、阅读顺序预测均超越通用VLM(Gemini-2.5 Pro、Qwen2.5-VL-72B、GPT-4o)和领域专用模型(MonkeyOCR、dots.ocr等),同时计算开销显著更低。

结论:解耦策略从根本上解决了高分辨率文档解析中精度与效率的矛盾,两阶段设计增强了可解释性、有效缓解了VLM幻觉问题,并允许两阶段独立优化。

1. 引言

1.1 研究背景与核心问题

文档解析(Document Parsing)是多模态理解的基础任务,支撑着信息提取、RAG和智能文档分析等众多下游应用。与自然图像不同,文档图像具有三大固有挑战:分辨率极高、内容极密集、布局结构极复杂。具体而言:高分辨率和精细布局结构要求模型具备原生分辨率处理能力;文本密集且篇幅长的特点对模型的参数效率和鲁棒性提出了严格要求;OCR成功与否不仅依赖精确的文本识别,更依赖可靠的布局分析和高效的推理。

当前文档解析有两大范式:流水线方法将任务分解为布局检测、阅读顺序预测、文本/公式/表格识别等多个独立模块,每个模块由专用模型处理,可解释性强但存在误差级联问题;端到端VLM方法语义建模能力强,但面临长文档幻觉问题和处理高分辨率输入时的严重效率瓶颈——文档图像中大面积空白或低信息区域造成的token冗余是核心限制因素。

1.2 文献综述与研究缺口

传统流水线方法的代表包括MinerU、Marker等,它们将文档解析分解为串行阶段:布局检测→阅读顺序→文本识别。模块化设计便于单独优化特定子任务,但各阶段之间的误差会级联传播,且面对多栏文本或跨页结构等复杂布局时鲁棒性不足。

通用视觉语言模型(如Gemini-2.5 Pro、Qwen2.5-VL-72B)展现了强大的OCR能力,但存在固有局限:闭源模型昂贵且慢,开源模型需要超大规模参数才能达到最优效果,且在密集文本区域仍存在幻觉问题。

领域专用端到端VLM(如GOT、Ocean-OCR、dots.ocr)用单一模型统一了文本、公式、表格等多种元素的识别,但端到端设计面临可扩展性挑战:联合优化布局和内容在复杂文档上精度下降,而原生分辨率处理引入O(N²)复杂度,token冗余问题在高分辨率输入下尤为突出。

多阶段VLM方法(如Dolphin、MonkeyOCR)尝试将布局分析与内容识别解耦,但各有缺陷:Dolphin使用Swin-Transformer,分辨率固定导致极端宽高比子区域变形;MonkeyOCR在第二阶段使用原生分辨率视觉编码器,但需要多个专用模型,增加了系统复杂性和部署成本。

1.3 研究目标与核心假设

本文目标是设计一个统一的单模型方案,既能保持流水线方法的效率与可解释性,又能获得端到端VLM的语义理解精度。具体而言:通过解耦全局布局分析与局部内容识别,用两阶段策略从根本上解决高分辨率文档解析中精度与效率的矛盾。

2. 研究设计与方法

2.1 模型架构

MinerU2.5的架构灵感来自Qwen2-VL框架,包含三个核心组件:

视觉编码器(NaViT,675M参数):采用NaViT(Native-Resolution ViT),初始化自Qwen2-VL-2B-Instruct,支持动态图像分辨率,使用2D-RoPE进行位置编码,能灵活处理各种分辨率和宽高比输入。尽管Qwen2.5-VL系列采用窗口注意力来提升效率,但这种设计在文档解析任务上会导致性能下降,因此MinerU2.5选择了NaViT。

语言解码器(Qwen2-Instruct,0.5B参数):文档解析任务对大规模语言模型的依赖相对较低,选用0.5B参数解码器。为更好地适应裁剪图像解析的多样分辨率,将原始1D-RoPE替换为M-RoPE,增强了模型在不同分辨率下的泛化能力。

Patch Merger:使用pixel-unshuffle对相邻2×2视觉token进行预处理,在传递给LLM之前聚合视觉token,有效平衡计算效率与任务性能。

图1:MinerU2.5性能亮点(来源:原论文 Figure 1)

2.2 两阶段解析策略(核心创新)

两阶段解析策略是本文的核心创新,旨在解决高分辨率文档解析中token冗余的根本矛盾。

第一阶段:布局分析(Layout Analysis)

将输入图像统一缩放至1036×1036像素的缩略图,在降采样图像上进行快速全局布局分析。这一参数选择经过了系统分析:缩略图太小会导致细节丢失,太大则会触发NaViT的二次复杂度。与保持原始宽高比的缩略图相比,固定尺寸能带来更稳定的边界框定位和更高效的训练。

第二阶段:内容识别(Content Recognition)

模型利用检测到的布局,从原始高分辨率图像中裁剪出关键区域,然后在精细粒度上解析这些区域。裁剪区域以原生分辨率输入,上限为2048×28×28像素,既避免了细节丢失,也防止了过度裁剪导致的冗余计算。

这一解耦策略带来了多重优势:计算成本降低一个数量级(避免了O(N²)复杂度的巨大视觉token);显著增强了可解析性的可解释性;有效缓解了VLM常见的幻觉问题;两阶段可独立优化和迭代。

图2:文档布局分析结果示例(来源:原论文)

2.3 训练流程

MinerU2.5的训练分为三个阶段:

Stage 0(模态对齐):仅训练patch merger内的两层MLP,视觉编码器和语言模型冻结。使用图像-标题对进行语言-图像对齐,使视觉特征投影到LLM嵌入空间。然后解冻所有参数,使用图像字幕、交错文本-图像对、视觉对齐和OCR数据进行视觉指令微调。

Stage 1(文档解析预训练):所有参数解冻,最大分辨率2048×28×28,序列长度8192,使用Layout&OCR数据(690万样本)。

Stage 2(文档解析微调):在Stage 1基础上继续优化。

2.4 数据引擎

为解决文档解析中数据多样性不足、样本不平衡、标注质量不一致等问题,本文开发了一个复杂文档的闭环数据引擎,系统性地收集、处理和生成大规模高质量文档语料库。

3. 结果与发现

3.1 主要发现

全文档解析任务:在OmniDocBench基准上,文本识别(1-Edit)、公式识别(1-Edit)、表格识别(TEDS/CDM)和阅读顺序预测(CDM)等各项指标, MinerU2.5均建立新的SOTA,超越所有通用VLM和领域专用模型。

元素级解析任务:

布局分析:DocLayNet、Market Analysis、Financial等子集上mAP和AP50均领先。

表格识别:PubTables1M等数据集上TEDS指标显著提升。

公式识别:在复杂、长式数学公式和中英文混合公式上实现高质量解析。

计算效率:相比端到端原生分辨率方法,计算成本降低一个数量级,同时保持更高精度。

3.2 关键数据解读

MinerU2.5的核心优势在于精度与效率的双赢。1.2B参数的轻量级设计,在实际部署场景中具有极高的适应性。其两阶段策略从根本上规避了O(N²)复杂度带来的计算爆炸,使得处理长文档和高密度内容成为可能。

4. 讨论

4.1 结果深度解读

MinerU2.5的成功揭示了一个关键洞察:对于文档解析这类任务,”所见即所析”的端到端策略并不总是最优解。将全局布局感知与局部精细识别解耦,既保留了语义理解能力,又获得了针对复杂文档结构的处理能力。这种解耦设计让两阶段可以各自独立迭代优化,这是端到端联合优化所无法实现的。

4.2 理论贡献

本文提出了文档解析中”精度-效率矛盾”的系统解决方案,通过解耦架构从根本上重构了VLM处理高分辨率文档的范式。此外,提出的两阶段训练策略和数据引擎为文档解析领域提供了可复用的方法论。

4.3 实践启示

对于需要处理大量文档的企业和开发者, minerU2.5提供了一个高精度、高效率、可部署的解决方案。其1.2B参数规模可在消费级GPU上运行,大大降低了文档解析AI的应用门槛。

4.4 局限性与未来方向

本文方法依赖布局分析结果的准确性,若第一阶段布局检测出现偏差,第二阶段的内容识别将受到连带影响。未来可探索两阶段联合优化或迭代细化的可能性。

5. 结论

MinerU2.5通过解耦型两阶段解析策略,在1.2B参数轻量级架构下实现了文档解析的SOTA性能。全局布局分析与局部内容识别的分离,不仅从根本上解决了高分辨率文档处理中的计算效率难题,还增强了模型可解释性并有效缓解了幻觉问题。其开源代码和模型权重为学术界和产业界提供了重要的研究与应用基础。

6. 核心参考文献

1. Niu et al. (2025). MinerU2.5: A Decoupled Vision-Language Model for Efficient High-Resolution Document Parsing. arXiv:2509.22186.

2. Wang et al. (2024). Qwen2-VL: Enhancing Vision-Language Models’ Understanding of Visual Content. arXiv.

3. Dong et al. (2024). GOT: General OCR Theory via OCR 2.0 Paradigm. arXiv.

4. Liu et al. (2024). MonkeyOCR: Multi-Stage Document Understanding with Dynamic Resolution. arXiv.

夜雨聆风

夜雨聆风