这么多 AI 工具,我是怎么分工的

这么多 AI 工具,我是怎么分工的

我现在每天同时用好几个 AI 工具:Claude Code、Gemini CLI、Kimi、DeepSeek、ChatGPT、OpenClaw……

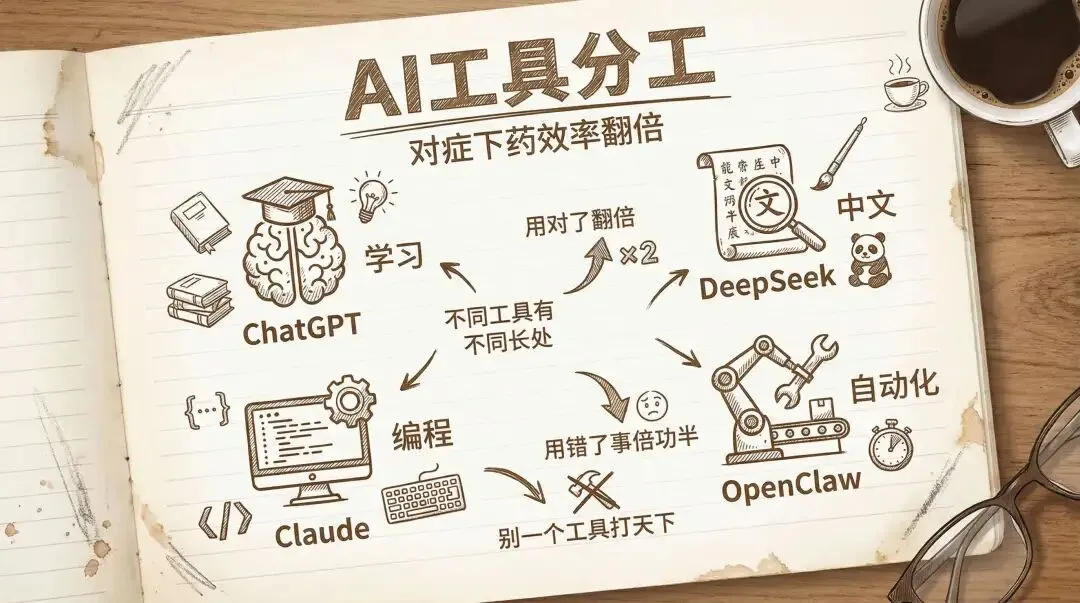

刚开始的时候很混乱,什么事都问 ChatGPT,有时候效果好有时候效果差,也说不清为什么。后来慢慢摸出来一个规律:不同的工具有不同的长处,用对了效率翻倍,用错了事倍功半。

今天分享一下我自己的分工方式。不一定适合所有人,但至少是我实际验证过的。

我的分工逻辑

想通一个概念、学一个新东西 → ChatGPT

ChatGPT 的知识面最广,解释能力最强。你问它一个你不懂的概念,它能用你能理解的语言讲清楚,还能根据你的追问不断深入。

我读论文遇到不理解的方法时,第一个问的就是它。不是让它帮我读论文,而是让它帮我理解论文背后的原理。

写代码、调 bug → Claude Code / Gemini CLI

写代码这件事,我目前的体感是 Claude Code 和 Gemini 都很强,各有优势。Claude Code 在理解复杂上下文方面更好,Gemini 在快速生成和调试方面效率高。

我的习惯是用 Claude Code 做比较复杂的项目(比如论文实验的代码),用 Gemini CLI 做快速的脚本和小工具。

搜中文资料、查最新消息 → DeepSeek / Kimi

涉及到中文内容的搜索和理解,国产模型确实更强。DeepSeek 的中文资料检索能力不错,Kimi 的长文档处理很方便。

我查国内的政策信息、中文论文背景、行业动态的时候,优先用这两个。

自动化工作流、多 Agent 编排 → OpenClaw

需要把多个任务串起来自动执行的时候,OpenClaw 是我的主力。比如每天自动整理信息、多个 Agent 协同完成一个复杂任务。

这个工具的学习曲线比前面几个都陡,但一旦配好了,省的时间是最多的。

画图、做设计 → 专门的图像生成工具

文字类的 AI 工具画图能力都一般。需要高质量图像的时候,我会用专门的图像生成工具,不勉强让文字模型干它不擅长的事。

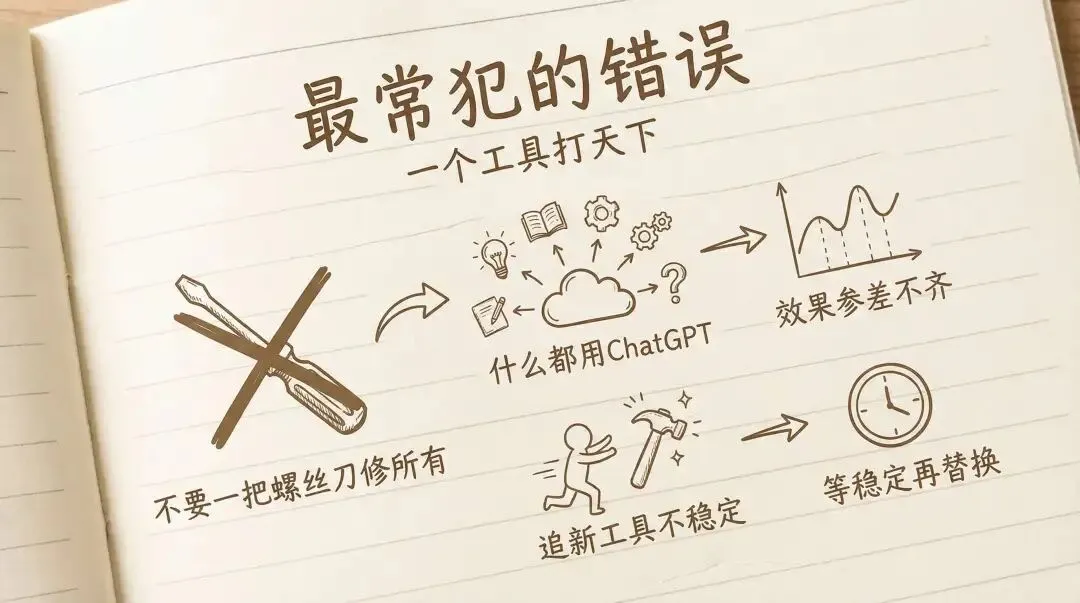

最常犯的错误:一个工具打天下

我以前的问题就是什么都用 ChatGPT。

结果就是:写代码的时候效果不如专门的编程工具,搜中文资料的时候不如国产模型,做自动化的时候不如 OpenClaw。

就像你不会用一把螺丝刀修所有东西一样,AI 工具也需要对症下药。

另一个常犯的错误是盲目追新。每隔几天就有新工具发布,但大部分新工具不稳定、生态不完善、学习成本高。我的原则是:新工具先观望,等稳定了再小规模试用,确认好用了再替换旧工具。

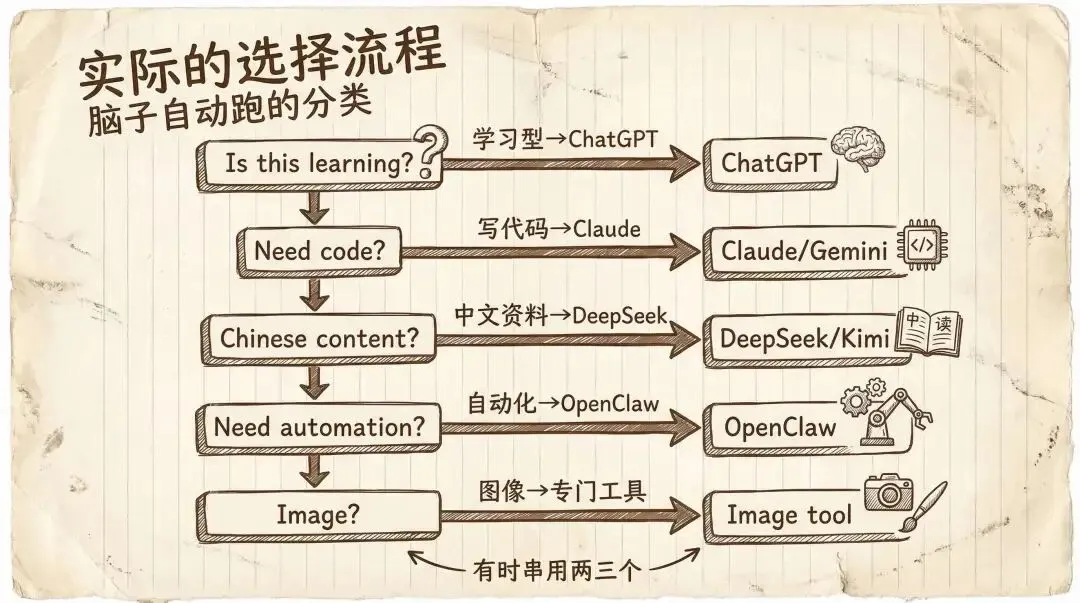

一个实际的选择流程

现在我遇到一个任务,脑子里会自动跑一遍:

这是学习型任务还是执行型任务?学习型的找 ChatGPT。

需要写代码吗?找 Claude Code 或 Gemini。

涉及中文内容吗?找 DeepSeek 或 Kimi。

需要自动化吗?上 OpenClaw。

需要图像吗?用专门的图像工具。

这个分类不是死板的,有时候一个任务会用到两三个工具。比如我写论文实验部分:先用 ChatGPT 理解某个方法的原理,再用 Claude Code 写实验代码,最后用 DeepSeek 搜一些中文参考文献。

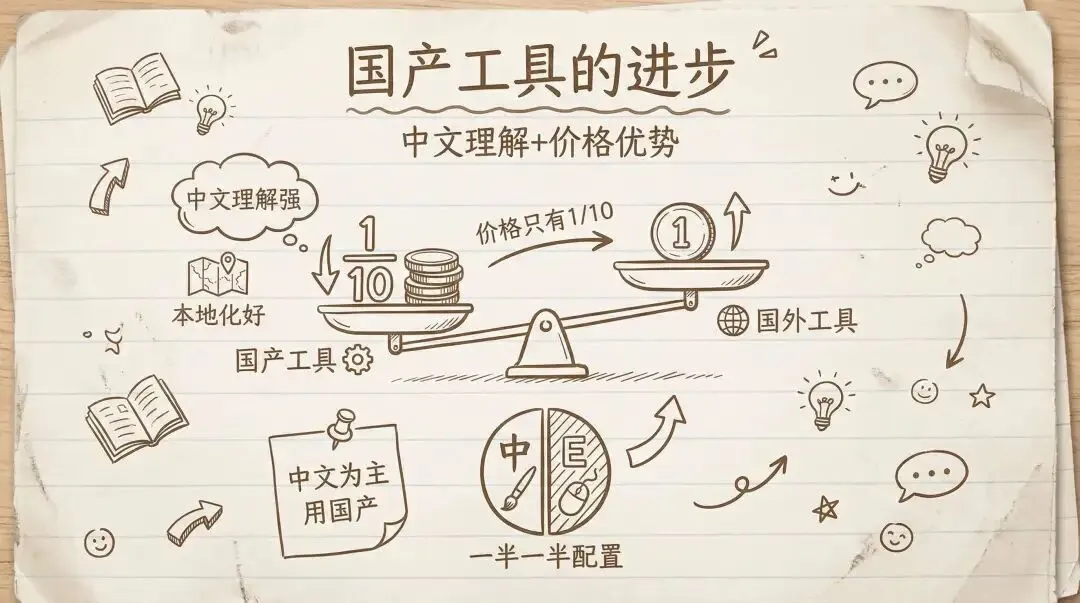

国产工具的进步确实很快

顺便说一句,国产 AI 工具这两年进步很明显。

在中文理解、本地化、价格这些方面,国产工具已经有明显优势了。特别是成本——同样的任务,国产模型的 API 价格可能只有国外的十分之一。

对于中文为主的工作场景,国产工具完全可以作为主力。我现在的工具箱里,国产和国外的比例大概是一半一半。

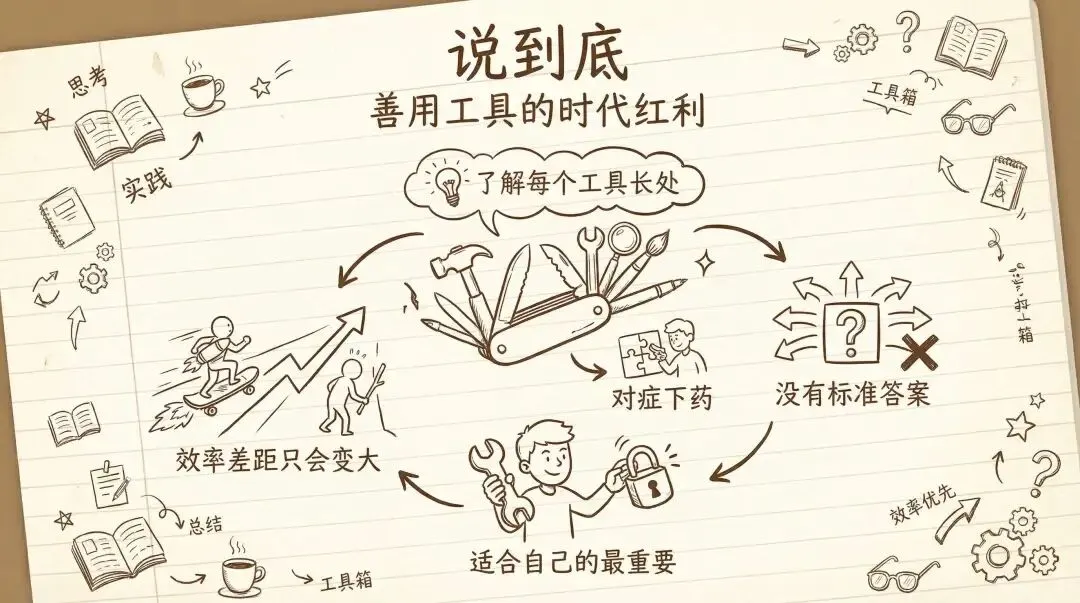

说到底

工具选择这件事,没有标准答案。

我的分工方式是根据我自己的工作场景——研究生、写论文、做实验、搞公众号——摸索出来的。你的场景可能完全不同,适合你的组合也不一样。

但有一个原则是通用的:别用一个工具干所有事。 花一点时间了解每个工具的长处,然后让对的工具做对的事。

这就是这个时代给我们的红利。善用工具的人和不善用工具的人之间的效率差距,只会越来越大。

本文来自「研路炼钢」

夜雨聆风

夜雨聆风