每天解析一款AI工具:ElevenLabs凭什么让AI听起来比人更像人?

01.行业地位:2026声音经济的“金本位”

-

企业渗透力:60%的财富500强企业都在使用ElevenLabs的API来构建其客户服务、企业培训和品牌声纹。 -

分发主权:它是全球最大的“声音克隆(Voice Cloning)”分发平台。在2026年,当你听一首爆款AI翻唱或一个顶级播客时,其背后80%的概率运行着ElevenLabs的V3引擎。 -

跨国桥梁:其实时翻译与配音(Dubbing)技术,让一个中文创作者可以在保持自己原声特征的前提下,同时用29种语言发布视频,且口型与语音完美同步。

02.2026核心特性:从“发声”到“共鸣”

-

ElevenAgents(具备“听感”的对话体):2.0版的Voice Agent不再是机械的问答。它能“听出”用户的语气。如果用户很焦虑,它会自动放慢语速并切换到温和的抚慰音色;它支持原生中断(Interruption),甚至会像真人一样在思考时发出“嗯…那个”这样的语气词。 -

Emotional Context Control(情感精细化控制):2026年的控制台新增了“悲伤度”、“兴奋值”和“讽刺感”滑块。你可以在一段旁白中设定:前10秒是平淡叙述,最后3秒是带有泪感的爆发。 -

Video Sync 2.0(全自研视频同步):不只是配音。ElevenLabs现在的视频生成产品支持“声音驱动视觉”。只要音频里有大笑声,生成的数字人画面就会同步展现极其自然的动态表情,而不是死板的换脸。 -

AIUC-1安全认证:面对深度伪造的风险,ElevenLabs在2026年推出了首个由保险巨头承保的安全认证体系,确保克隆声音的版权溯源与合规使用。

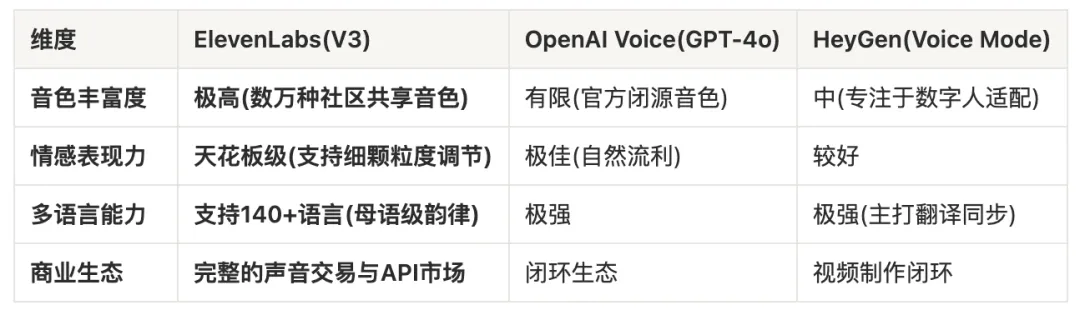

03.2026声音工具权力榜

夜雨聆风

夜雨聆风