你发给 AI 的简历,可能已经出现在陌生人屏幕上了

TeMe是一家面向全球的Web3实战型职业人才孵化平台,构建可持续的Web3职业路径,帮助更多人把Web3当成一份长期职业来理解。

你上次把简历发给 AI 是什么时候?上周?昨天?那份文件,现在在哪里,你知道吗?

求职季,很多人都在用 AI 润色简历,这件事本来没什么问题——但最近看到一个新闻,有人发现自己的简历,连名字带电话带工作经历,原原本本地出现在了一个不认识的人的对话窗口里。

如果说普通用户的简历私人信息已经够敏感了,换算到Web3职场上,因为行业属性问题,这件事其实风险还更高,所以简单聊一下

先简单说一下事情经过

XX在用 某AI模型 翻译一份 PPT,只是普通的三行英文,几轮对话后,AI突然返回了一份完整的中文简历——陌生人的姓名、手机、邮箱、工作经历,一行不差。

他按照简历上的电话联系了对方。对方确认:自己当天上午确实用该AI润色过简历,间隔大约六小时

两个毫不相关的人,一个在找工作,一个在翻译 PPT,就这么被一个系统漏洞连在了一起

事后该AI官方的解释先是”AI 幻觉”,后来改口成发串——意思是系统把别人的回复错误发给了你,但对于具体怎么发生的,到现在没有任何进一步说明,官方也没有发任何公开声明。

当你打开手机,看到屏幕上AI给你的答案出现一个陌生人的姓名和电话,你的第一反应是什么?

注意这个细节

所谓 AI 幻觉是模型胡说八道、编造内容,但这次泄露的每一条信息都是真实的,电话能打通,人是真实存在的,这不是幻觉,是真实的数据跑错了地方。

这件事值得讨论的点就是,从openclaw数据权限的审核上可以看出,很多人用 AI 的习惯是——想到什么就粘贴什么,根本不会停下来想这条信息我能发吗

用 AI 润色简历、优化自我介绍、模拟面试问答——这些已经是求职标配动作了,但在你觉得和 AI 说话很私密的同时:

• 你输入的内容会被平台留存,用于模型优化。大部分Ai 的隐私协议里写得很清楚:对话信息有助于优化模型,这本身不违法,但数据留下来了

• 对话分享功能几乎等于公开,有机构实测了 8 款主流 AI,包括 Kimi、豆包、DeepSeek、文心一言等——只要点了分享按钮,对话内容就可能暴露在互联网上,8 款里只有 DeepSeek 会提前提醒你检查敏感内容

• 系统隔离不是铁板一块,这次AI的事故,本质是多用户数据之间的隔离出了问题。这类风险不是该AI模型独有,是当前整个大模型行业都面临的技术难题

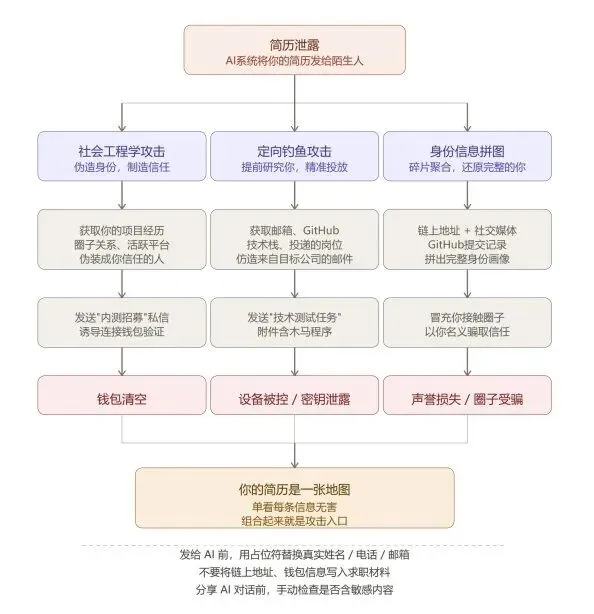

简历泄露的危害

回到Web3,你的简历里

藏着比你想的更多的信息

普通简历已经够敏感了——姓名、电话、住址,这些是基础风险。但如果你是 web3 求职者,你的简历里通常还有另一层信息

想想你的简历里有什么:工作邮箱,LinkedIn 主页,GitHub 账号,X账号,参与过的项目经历,telegram 账号,持有某token的侧面信息等等

单看每一条,好像都没什么,但对一个想要攻击你的人来说,一旦你的简历流到了一个有心人手里,接下来可能发生什么?

首先是社会工程学攻击

用你的信息伪造信任感,骗你做你不该做的事

社工攻击不需要破解你的密码,它攻击的是你这个人。攻击者拿到你的简历后,会知道你参与过哪个项目、知道担任什么职级、在哪个项目活跃、跟哪些人在同一个圈子——这些信息足够让他们伪装成你认识的人,或者让对话听起来非常合理。

比如说你收到一条 Telegram 私信,对方自称是你简历上某个项目的核心成员,说团队正在做新一轮招募,问你有没有兴趣加入内测,需要你先连接钱包验证身份。

你觉得这个人知道你参与过那个项目,应该是真的,你连了,然后你的钱包被清空了。

(这里举一个真实案例,某资深从业者,在某天打开之前一直合作和聊天接触过的合作方的链接,损失千万级别的资金,实际该合作方是攻击者调研到你的日常信息一模一样伪装出来的)

其次是定向钓鱼攻击

普通钓鱼是广撒网,而定向钓鱼是提前研究过你的,攻击者用你简历里的信息——工作邮箱、GitHub、参与项目——拼出一封看起来极度真实的邮件,模仿你应聘过的公司、你认识的人,或者你等待回复的 offer。

比如你最近在投一个项目的开发岗位,简历里写了你用过的技术栈和 GitHub 地址。几天后你收到一封邮件,来自一个跟那个项目只差一个字母的域名,说让你完成一个技术测试任务,附件是一个 zip 包。

你打开了,里面可能就是木马。

最后是身份信息拼图

你的简历本身可能不够完整,但它是一个起点,攻击者会把简历里的信息跟链上数据、社交媒体、GitHub 提交记录结合起来,拼出一个比你以为的更完整的你。

当信息足够多,他们甚至可以冒充你去接触你的圈子,或者用你的身份骗取信任,这一点其实更麻烦,一旦攻击者确定你有很大的攻击价值,他会想尽办法去把你的信息拼凑出来,这个时间尺度足够拉长到以年为单位。

Web3 的资金安全问题

从来不是知道了就能避免的那种

这个行业里有一个很残酷的规律——很多在圈子里做了三五年的人,依然会在某一天因为一个“看起来很正常”的操作,损失掉积累多年的资产。不是因为他们不够谨慎,而是攻击者比你更了解你的习惯、你的圈子、你信任的人长什么样。

对于刚入行的人来说,风险其实更高,你还没建立起足够的警觉,但你的简历、你的社交账号、你投出去的每一份求职信,已经在帮别人拼出你的画像了

所以在用 AI 处理求职材料这件事上,记住几条底线:

1、润色简历前,先把真实姓名、电话、邮箱替换成占位符,润色完再填回去

2、不要把链上数据、钱包信息、项目信息写进发给 AI 的内容里

3、不要用 AI 处理 offer 信、保密合同、含公司内部信息的任何文件

4、分享 AI 对话前,手动检查一遍,有没有你不想公开的内容

继续用 AI,但要用得聪明一点

不是要你停用 AI 工具,恰恰相反,会用 AI 就是现在求职的核心能力之一,但会用包括知道边界在哪里。

毕竟资金安全问题,出了问题那就是0分的问题

往期推荐

夜雨聆风

夜雨聆风