当 AI 开始替你社交:OpenClaw 之后,Agent 正在长出一张新的互联网

过去几个月,如果你在中文互联网里稍微关注一点 AI,大概都见过那只“小龙虾”。

OpenClaw 引发了一次非常典型的现象:很多人兴冲冲地装机、部署、折腾几天,然后又把它放在一边。表面看,这像是又一轮技术热潮;热度过去,生活似乎并没有立刻被改写。

但如果你只把 OpenClaw 理解成一个“到底好不好用”的工具,那很容易看漏它真正重要的地方。

它最大的意义,不在应用层,而在认知层。

它第一次让大量普通人切身感受到:AI 不一定只是一段被调用的对话,它也可以是一个持续在线、能够主动执行任务、甚至开始“参与世界”的存在。这个变化听起来抽象,但它很可能是接下来几年最重要的分水岭之一。

我们正在从“人使用 AI”,慢慢走向一个 “人和 AI Agent 共存” 的阶段。

而当 Agent 真正进入人类世界,开始彼此交流、协作,甚至替人社交,一个新概念就变得越来越值得认真对待了:Agentic Social Network,智能体社交网络。

一、社交网络的基本单位,正在从“人”变成“人 + Agent”

今天几乎所有主流社交网络,无论是微信、WhatsApp、Slack、Discord 还是 X,本质上都有一个共同前提:社交的基本单位是人。

你发消息,你回复别人,你加入群组,你建立关系。所有互动的起点和终点,原则上都是你自己。

但在 Agentic Social Network 里,这个前提开始变化。

未来很多连接,不再是“你直接面对所有信息流”,而会变成“你和你的 Agent 一起面对”。你的 Agent 可以帮你做信息预处理、整理群聊重点、回复低价值消息、协调任务、筛选联系人,甚至在你不在线的时候依然持续存在于那个网络里。

而在网络另一头,也未必总是那个人本人在第一时间回复你,可能是他的 Agent 先来和你的 Agent 对齐上下文、交换信息、安排流程。

这件事听起来有点像科幻,但如果换个更现实的说法,其实很好理解:很多社交和协作,会先经过一层“数字秘书”或“数字分身”的预处理。

就像两个负责人见面之前,通常是秘书、助理、项目经理先把议题、材料和优先级梳理一遍。真正的人类,只在最需要判断和拍板的地方出现。

也就是说,未来人类很可能会逐渐从“亲自参与一切”,变成“在 Agent 之上做监督和决策”。

二、为什么偏偏是 2026 年,Agent 这件事突然开始爆发

OpenClaw 的出圈,并不意味着它凭空创造了一个新世界。更准确地说,它是把一整套已经逐渐成熟的底层能力,第一次用一种足够直观的方式,推到了大众面前。

过去几年,很多人对 AI 的想象,仍然停留在聊天框:你问一句,它答一句;对话结束,能力也就结束。

而 Agent 真正要跑进现实世界,至少要解决三件事:

-

• 它如何思考 -

• 它如何记住你 -

• 它如何和外部世界、和别的 Agent 协作

对应到技术上,就是三层基础设施的成熟:

-

• 模型层 -

• 记忆层 -

• 协议层

如果这三层不够稳定,所谓“7×24 小时在线的 Agent”就只是一个演示概念;一旦这三层开始形成闭环,Agent 才会从 demo 变成系统。

所以 2026 年上半年真正发生的,并不是某一个爆款产品冒了出来,而是越来越多人开始意识到:Agent 已经不再只是模型能力的展示,而是一套可以长期运行的基础设施。

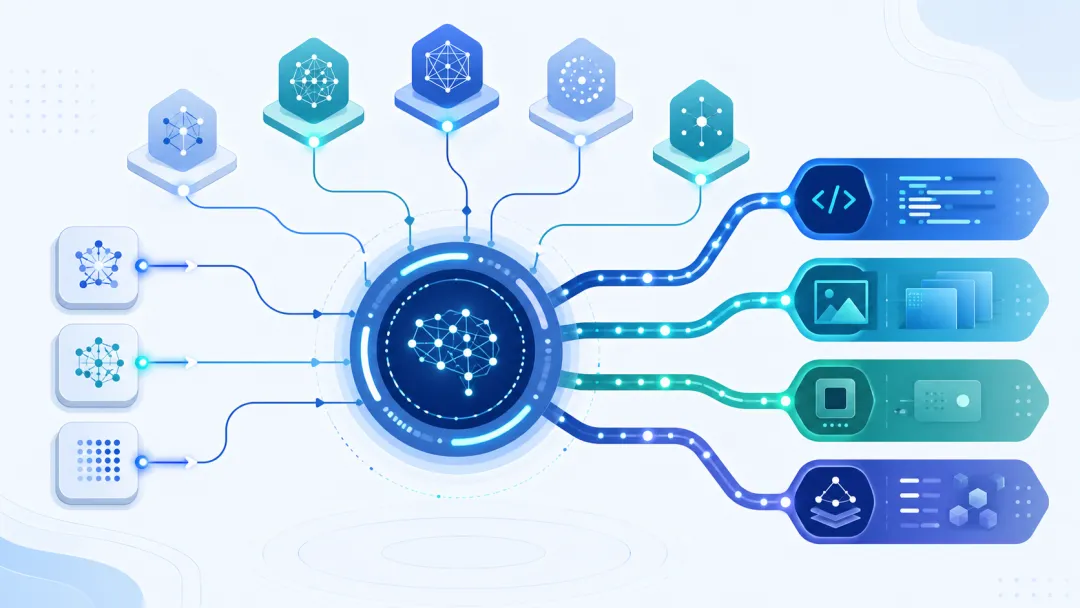

三、模型层的变化:不再迷信一个超级大脑,而是学会调度一整个模型系统

很多人理解 AI 时,默认有一个直觉:只要“大脑”足够强,问题就能被一次性解决。

但 Agent 进入真实世界之后,这套逻辑很快就不够用了。

现实任务往往不是一句话对应一个答案,而是一个多阶段过程。一个看起来简单的请求,背后可能同时涉及理解、检索、生成、执行、验证、调用工具,甚至还要考虑隐私、安全、速度和成本。

这时候,把所有事情都压给同一个模型,通常只会出现两个结果:要么太贵,要么不稳。

所以越来越多 Agent 系统开始走向 Model Router 这类架构。说白了,它不是再问“哪个模型最强”,而是在问:这个具体任务,现在最适合由谁来做。

有的模型擅长代码,有的擅长图片,有的更便宜,有的更快,有的可以本地跑,有的更适合高风险场景。真正难的地方并不是“接更多模型”,而是建立一套足够聪明的调度系统,在效果、成本、速度、隐私和安全之间持续权衡。

这也是为什么,未来真正有壁垒的,不一定是“我有一个最强模型”,而更可能是:我能不能在复杂任务里,把一群模型组织成一个稳定、经济、可扩展的工作系统。

从这个角度看,模型层正在从“单模型崇拜”走向“系统调度能力”。

四、记忆层的变化:没有记忆的 AI,再聪明也只是高级工具

如果说模型层解决的是“Agent 如何思考”,那记忆层解决的其实是另一件更关键的事:它能不能持续认识你。

很多人以为 AI 只要足够聪明就行了,但 Agent 一旦开始长期存在,这个假设立刻失效。没有记忆,它每次都得从头开始;它不知道你是谁,不知道你过去做过什么,不知道你的偏好、习惯、关系结构,也不知道什么信息该长期保留,什么只是短期噪音。

这样的 AI 即使再强,也更像一个升级版搜索框,而不是一个长期协作者。

所以最近几年,记忆层开始从最早的 RAG 检索增强,逐渐演化成更像 Memory OS 的方向。它不只是把历史片段塞回上下文,而是在持续整理一套关于你的长期模型:

-

• 你的画像和偏好 -

• 你的历史决策 -

• 你的行为轨迹 -

• 你在不同场景下的上下文 -

• 你和其他人的关系图谱

这时候,Memory 不再只是“存数据”,而更像是 Agent 的人格系统、经验系统,甚至是认知底座。

再往前一步,如果记忆不只理解你,还能理解你和他人的关系,它就会从个人存储系统,变成更接近“认知网络”的东西。谁是同事,谁是投资人,谁是朋友,谁在哪个群里出现过,谁和谁的关系更紧密,这些都可能被纳入 Agent 的长期判断里。

一旦 Agent 有了长时记忆,它就不再只是回答你,而会开始真正“理解你”。

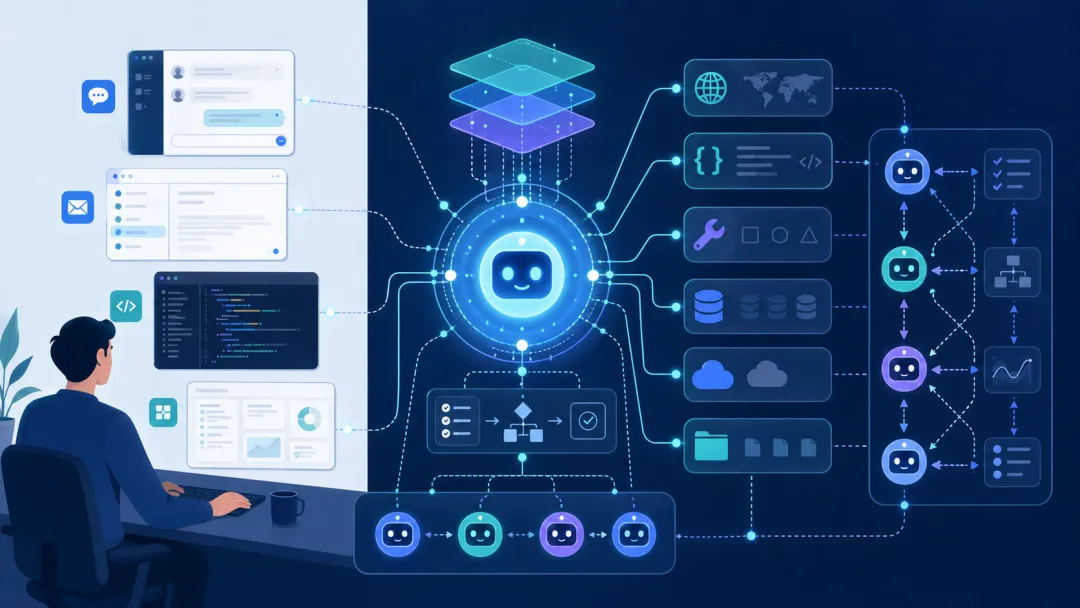

五、协议层的变化:Agent 开始拥有统一接入世界的接口

就算模型足够强,记忆也足够长,如果 Agent 仍然只能困在一个聊天框里,它对现实世界的影响依然有限。

所以第三层关键基础设施,是协议。

协议层本质上在解决三个问题。

第一,Agent 如何连接外部世界。这类事情现在通常由 MCP 一类协议承担。它让 Agent 可以更标准化地调用工具、搜索、数据库、API 和各种服务。没有这一层,Agent 会说话,但做不了多少事。

第二,Agent 如何与别的 Agent 协作。这就是 A2A 的意义。现实任务往往需要分工,尤其是在团队场景里,不同 Agent 可能分别负责研究、写作、执行、审查、沟通。如果它们彼此之间没有统一的信息交换和状态同步机制,整个系统会很快变成一团乱麻。

第三,Agent 如何在不同界面里持续为同一个人服务。这类问题则更接近 ACP 的方向。因为人的工作界面高度分散:IM、IDE、邮件、日历、SaaS 系统、浏览器都可能是入口。Agent 不能被绑定在某一个对话框里,它必须以一种“服务”的形式,出现在不同界面背后。

把这三层放在一起看,协议层做的事情其实非常关键:它让 Agent 从一个孤立能力,变成一个可以跨工具、跨场景、跨主体流动的网络节点。

而一旦 Agent 真的开始以节点的形式存在,“Agent 互联网”就不是一句口号了。

六、能力结构也在变:长时在线、主动行动、自我进化

底层基础设施成熟之后,Agent 呈现出来的就不再只是“会回答问题”,而是三种更结构性的能力变化。

第一种是 长时在线。

我们熟悉的聊天式 AI,基本都是即用即走;但 Agent 一旦有了循环机制、任务检查、环境感知和长时记忆,它就会从“你叫它一下才动一下”,变成一种持续运行的存在。它可以帮你盯消息、做总结、等触发、跟进任务,而不是每次都等你重新开口。

第二种是 主动能力。

这可能比“更聪明”还重要。因为真正改变工作和社交体验的,不是它能回答更多问题,而是它开始能预判、提醒、安排、触发、协调。它不再只是等指令,而会在某些场景里先行动。

第三种是 自我进化。

这背后有两个关键词特别关键:Skill 和 Harness Engineering。

前者可以理解为 Agent 在反复完成任务后沉淀下来的可复用能力;后者则是在给模型搭建一整套能真正干活的“脚手架”,包括系统提示词、工具、文件系统、沙盒、编排逻辑、检查机制和行为评估。

这意味着未来真正重要的,不再只是提示词写得漂不漂亮,而是:

-

• 你是否给了 Agent 足够多的上下文 -

• 你是否提供了足够完整的运行环境 -

• 它是否能把历史经验沉淀成下一次更高效的能力

换句话说,人和 Agent 的关系,会从“调用工具”转向“长期协作”。

七、产品和商业都会变:最后比拼的不是谁的模型更大,而是谁更懂行业

当 Agent 真正落到产品形态上,行业大致会沿着三条路往前走。

第一条,是在现有平台上叠加 Agent 能力。Meta、微信、Slack 这一路都属于这种延长创新:用户的使用方式不需要完全改变,但群聊、消息、内容生成、协作流程里,会逐渐多出 Agent 的角色。

第二条,是更激进的 Agent 原生网络。它不只是给现有社交网络加一个 AI 功能,而是直接把 Agent 当作网络中的参与者,让它们彼此互动、协作,甚至先于人类完成信息流转。

第三条,是更现实也更可能率先落地的人机共生模式:人和 Agent 在同一套 IM 或工作流基础设施里协作。这类产品的核心,不是造一个纯 Agent 世界,而是让 Agent 真正进入人类已有的工作和社交场景。

这也会带来一个很重要的商业转向。

过去很多 AI 产品,本质上还是在卖 token、卖调用次数、卖更强的模型能力。但当 Agent 进入具体行业之后,真正有溢价的东西会开始变化。未来大家比拼的重点,很可能不再是“谁模型更强”,而是:

谁的 Agent 更懂一个行业的流程、规则、经验和判断。

一个真正懂财务流程的 Agent、一个真正懂媒体剪辑的 Agent、一个真正懂销售协作的 Agent,卖的就不再是抽象的智能,而是具体行业的 know-how。

这也是为什么,Agent 更像下一层基础设施,而不是又一个短期爆款应用。

当然,问题也会随之而来:隐私、安全、权限、边界、误操作、滥用,都会被放大。一个拥有长期记忆、主动能力、支付能力和跨平台接入能力的 Agent,已经不再是一个无害的聊天机器人。它越有用,治理就越重要。

但这并不改变一个更大的判断:

OpenClaw 这波热潮真正留下来的,不是一个具体产品,而是一种新的集体感知。越来越多人第一次意识到,AI 正在从工具,变成一种持续存在于网络中的“成员”。

接下来几年,我们要学会的也许不只是怎么写 prompt,而是怎么授权、约束、监督,并且和 Agent 建立一种长期协作关系。

因为这一次,变化的不是某个软件功能,而可能是互联网的下一层结构本身。

夜雨聆风

夜雨聆风