4月29日,AI更会干活了

4 月 29 日的 AI 圈,最清楚的一条线是:AI 不再只是回答问题,而是在接入真实工具,替人把一段工作跑完。

Claude 这一天很有代表性。它接入了 Blender、Autodesk Fusion 和 Adobe Creative Cloud。设计师可以让 Claude 检查 Blender 场景,工程师可以通过对话创建和修改 3D 模型,创作者也可以调动 50 多个 Creative Cloud 工具。Claude Code 还加了手机推送:长任务完成、或者需要你确认时,它会主动提醒。这个细节看起来小,其实说明编程助手正在从“终端里的聊天窗口”,变成更像同事的工作流节点。

企业软件也在往这个方向走。Mistral AI 推出 Workflows,解决的是一个很现实的问题:模型已经够强,但企业要把它稳定放进生产流程,还需要持久执行、可观测、可恢复和人工审核。OpenAI 内部的 Symphony、ClawSweeper 则把编码任务拆给多个 Codex 实例并行处理,据称让内部 PR 吞吐量提升了 500%。AWS 发布桌面应用 Quick,连接邮件、日历、Slack 和本地文件,帮用户筛重点、做摘要、给建议,甚至创建 agent 处理杂事。

编码代理的竞争,也从“会不会写代码”走向“会不会看现场”。有人把 Qwen3-Coder 训练成会用真实调试器修 Bug 的模型,解决率从 70% 提到 89%,中位修复轮数从 46 降到 19。它不是只读代码和猜问题,而是能看变量、调用栈、断点和表达式。Google 也在推广本地 Gemma 编码代理,把 Gemma 4 26B、Pi agent 和 LM Studio 这类工具串起来。云端代理追求协作和规模,本地代理追求可控、低成本和离线可用,两条路线会同时存在。

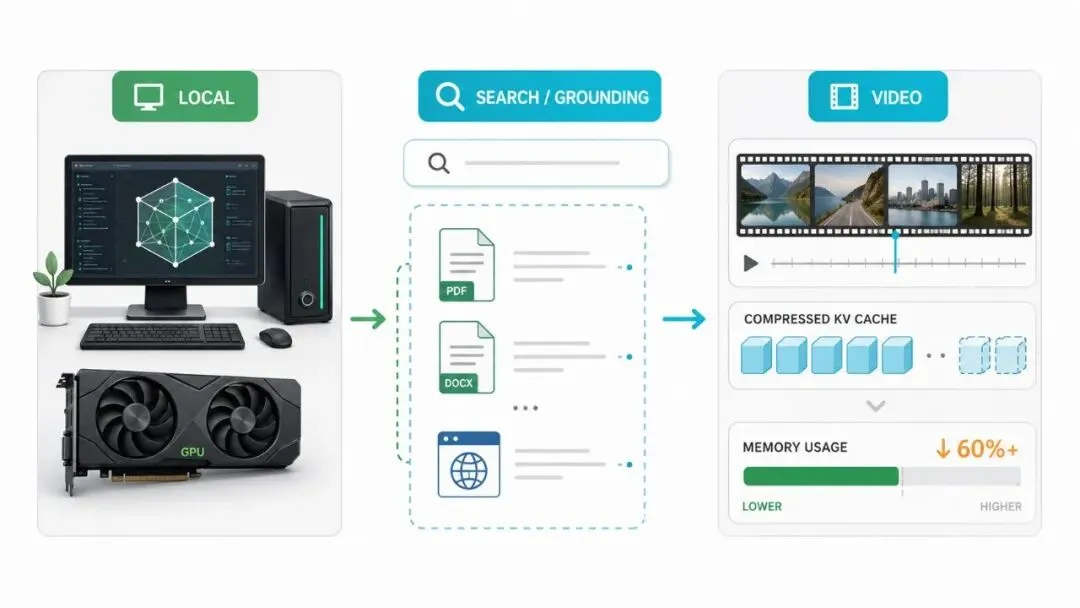

模型层面,一边在继续扩能力,一边在降低使用门槛。NVIDIA 发布 Nemotron 3 Nano Omni,把视觉、语音和语言放到一个开放多模态模型里,并强调更高吞吐量。xAI 被曝正在 Colossus 2 集群上训练 Grok 5,最大配置可能达到 10 万亿参数。Grok 还在准备 Skills 功能,让模型可以调用外部能力。与此同时,Quant VideoGen 试图压缩长视频生成里的 KV cache,让更长、更稳定的视频生成有机会在本地高端显卡上跑。

机器人方向也更接近实际场景。RobotEra L7 被传将进入 10 多个物流中心执行分拣任务,日本羽田机场也在测试 Unitree G1 和 UBTECH Walker E 机器人,用来搬运行李、缓解人手短缺。无论这些部署最后规模多大,信号都很明确:AI 的落地不只在屏幕里,也会进入仓库、机场和服务现场。

另一条线是能力变强之后的风险。OpenAI 宣布 GPT-5.4 Pro 协助解决一个开放了 60 年的 Erdős 数学问题,这说明模型在数学推理上的上限还在抬高。但 Sébastien Bubeck 也提醒,危险在于把“城堡钥匙”交给 AI:如果人停止理解和验证,能力会退化。Nick Bostrom 关于信息危害的讨论也类似,有些真实信息本身可能成为风险蓝图。AI 越强,越不能只看它能做什么,还要看谁来判断它什么时候错了。

行业关系也在调整。微软和 OpenAI 宣布合作进入新阶段:微软仍是主要云合作伙伴,并获得非独家的 OpenAI IP 许可。这个安排背后,是大模型公司对算力、资本、产品入口和独立性的重新平衡。DeepLearning.AI 则发布 Andrew Ng 的新课程《AI Prompting for Everyone》,说明普通人仍然需要学习如何把 AI 用对,而不是等工具自动解决一切。

所以这一天的关键词不是某一个模型名字,而是“接入”。AI 接入搜索、调试器、设计软件、企业流程、本地文件、桌面应用,甚至机器人身体。它获得的不是一张更会说话的嘴,而是更多能执行动作的手。

对普通用户来说,真正值得关注的不是哪个演示最炫,而是哪类工作会先被拆成步骤、交给 AI 运行,再由人来审阅和兜底。未来一段时间,最有价值的人未必是完全不用 AI 的人,也不是把判断全交出去的人,而是能清楚知道:哪里可以让 AI 动手,哪里必须自己看住。

夜雨聆风

夜雨聆风