AI「越想越窄」?十所高校联合发现:大模型遇到难题,内部激活直接「塌」成一条线!

一篇来自 Rutgers、Northwestern 等十所高校的新论文揭示了一个惊人规律:大模型遇到越难的问题,最后一层隐藏状态的激活就越集中、越稀疏——相关系数高达 0.91。更关键的是,这个信号可以在模型答错之前就被捕捉到,相当于给 AI 装了一个「内部仪表盘」。

模型「卡住」的时候,内部在发生什么?

你一定遇到过这种场景:问 ChatGPT 一个复杂数学题,它洋洋洒洒写了一大段,最后答案完全是错的。

问题来了——它答错之前,自己「知道」自己要翻车吗?

AI 研究者 Rohan Paul 今天在 X 上转发了一篇论文,用一句话把结论说透了:

“Researchers found that when language models face harder questions, their internal brain activity literally shrinks into fewer paths.”

「研究人员发现,当语言模型面对更难的问题时,它内部的’脑活动’会收缩到更少的路径里。」

▲ Rohan Paul 转发论文,51 赞、2400+ 次浏览

这条推文指向的论文,来自 Rutgers University、Northwestern University、TU Darmstadt 等机构的十位研究者,标题叫 *Farther the Shift, Sparser the Representation*——偏移越远,表征越稀疏。

论文到底发现了什么?

先做一个技术校准:Rohan 推文里说的「内部脑活动收缩」「思路路径变窄」,是面向大众的传播表达。论文真正测量的,是最后隐藏状态(last hidden state)里的激活分布变化——当输入变难、变远离训练分布时,激活的能量会向更少的维度集中。

通俗地讲:模型平时回答熟悉的问题,内部「神经元」的工作量分散在很多维度上;一旦遇到难题,这些激活会迅速「挤」到少数几个维度里,形成一种高度压缩的状态。

作者把「难」拆成了四条可控的轴:

1. 推理复杂度更高——MATH-500 数据集从难度 1 到难度 5,越难的题,激活越稀疏。

2. 干扰项更多——往多选题里加更多看似合理的选项,模型内部立刻开始「收缩」。

3. 知识冲突——给模型喂一段和它参数里存的知识互相矛盾的上下文,稀疏度飙升。

4. 上下文更长——从 8K 拉到 64K,最后几层的表征分离越来越明显。

四条轴,同一个结论:越难,越稀疏。

▲ 论文 arXiv 页面,编号 2603.03415,今年 3 月提交

数据有多硬?相关系数 0.91

这里必须贴几组数字,因为它们是整篇论文最有说服力的部分。

以 Qwen2.5-7B 模型在 MATH-500 上的表现为例:

-

难度 vs L1 范数(激活总量):r = -0.889——难度越高,总激活量越低 -

难度 vs Top-10% 能量占比:r = 0.912——难度越高,前 10% 维度吃掉的能量比例越大 -

准确率 vs L1 范数:r = 0.897——激活越稀疏,答对的概率越低 -

准确率 vs Top-10% 能量占比:r = -0.915——前 10% 吃掉越多能量,答对率越低

0.89 到 0.91 的相关系数,在社会科学里属于「几乎完美相关」。在深度学习的内部表征分析里,这种强度的统计关联极其罕见。

知识冲突场景里的数字同样扎实:当外部上下文和模型参数知识「打架」时,Hoyer 稀疏度上升 +0.0378,Top 5% 能量占比上升 +0.0114,p 值小于 2.0×10⁻²⁹——统计显著性拉满。

「给模型装一个内部仪表盘」

如果稀疏度只是一个有趣的观察,那它最多值一篇论文。但作者往前走了关键一步:把稀疏度变成了一个可用的工程信号。

他们提出了 SG-ICL(Sparsity-Guided Curriculum In-Context Learning),用稀疏度给 few-shot 示例排序、按难度编排。结果是:Qwen2.5-7B 在 MATH-500 上做到76.60%,高于 Auto-CoT 的75.20%。

提升看起来不大?重点在于方法论的意义——稀疏度可以直接当「这道题对模型来说有多难」的量尺,而且不需要额外的评估模型或人工标注。

X 用户 Home(@homeMetaX)的评论最有产品感:

“This is important because it introduces a potential model uncertainty early warning signal. Instead of waiting for wrong answers, systems could detect when internal activation diversity drops below threshold and trigger interventions before failure.”

「与其等模型先答错,系统可以检测内部激活多样性是否跌破阈值,在失败之前就触发干预——比如拆解子任务、补充检索、搭脚手架。」

▲ Home @homeMetaX 的产品视角评论

想象一下:未来的 AI 系统可能内置一个实时稀疏度监控模块。一旦检测到激活开始「挤」到少数维度,系统就自动切换策略——调用搜索引擎补充信息、把大问题拆成小步骤、或者直接标记「这个问题我没把握」。

这就是给模型装了一个「内部仪表盘」。

还有更大的图景

Tessa Archer(@scifi_tessa)在回复里把话题拉到了更大的画面:

“We’ve seen this in CV models too — distributed processing fails under pressure, fallback mechanisms activate. Sparsity as automatic difficulty measurement? Practical curriculum scheduling.”

「CV 模型里也能看到类似现象——分布式处理在压力下失效,回退机制启动。稀疏度当自动难度量尺?这对课程式训练调度很实用。」

▲ Tessa Archer 把讨论引向跨模态类比

这个类比很有意思。如果语言模型和视觉模型在压力下都会出现类似的「表征收缩」,那它可能揭示的是深度学习的一个更普遍的机制:模型在面对超出训练分布的输入时,会自动放弃「分布式冗余表示」,退回到一种更压缩、更集中、也更脆弱的编码方式。

论文里有一个特别精彩的发现可以佐证这一点:在合成预训练实验中,作者观察到一个 U 形曲线——

- 第一阶段(0-500 epochs)

:模型先变稀疏,把噪声扔掉,做特征筛选; - 第二阶段

:模型逐渐变「稠密」,代表它已经把熟悉的模式学稳了。

也就是说,高密度的分布式激活,本身就是模型对「熟悉输入」的一种学习特权。面对陌生和困难的输入,它维持不住这种特权,会退回到更原始、更集中的状态。

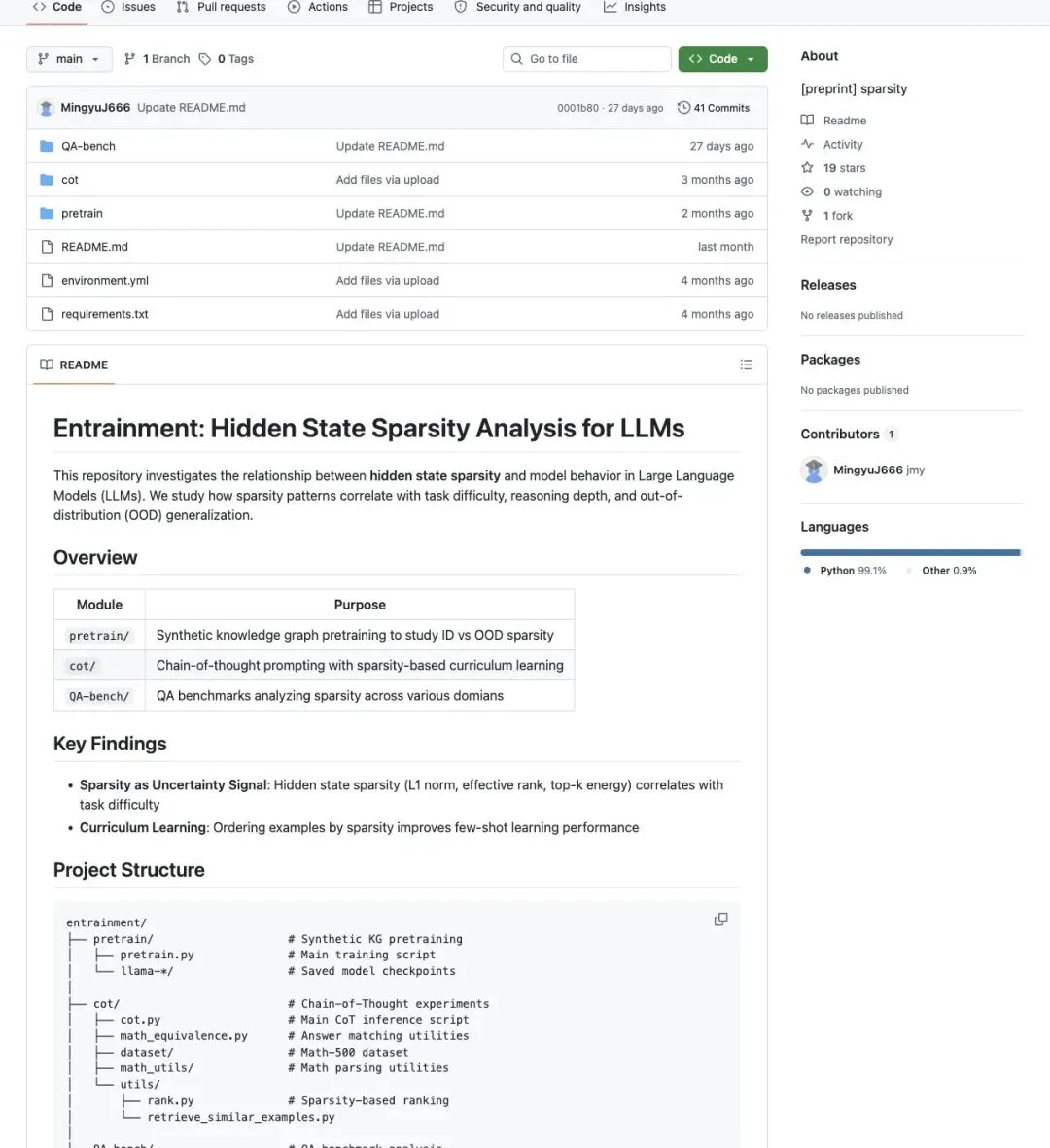

▲ 论文代码已开源,仓库 19 星,含预训练、CoT、QA 等多个实验模块

几个值得警惕的边界

写到这里,有必要画几条线:

第一,这不等于「模型知道自己要答错了」。更准确地说,稀疏度上升是一个与 OOD(分布外)和高难度强相关的内部统计信号。它可以用来做风险探测,但目前还不能被当成「读心仪」。

第二,论文主要在隐式推理(implicit reasoning)设定下做分析。作者自己也说,CoT 设定下能看到类似现象,但稳定性更弱。所以如果你想把这个结论直接套到 o1/o3 这类「长思考」模型上,还需要更多验证。

第三,传播语言和论文结论之间有一道翻译鸿沟。「思路路径收缩」是一个好比喻,但论文真正测量的是最后隐藏状态的激活分布变化,不等于我们直接拍到了模型的「完整思维链塌缩现场」。

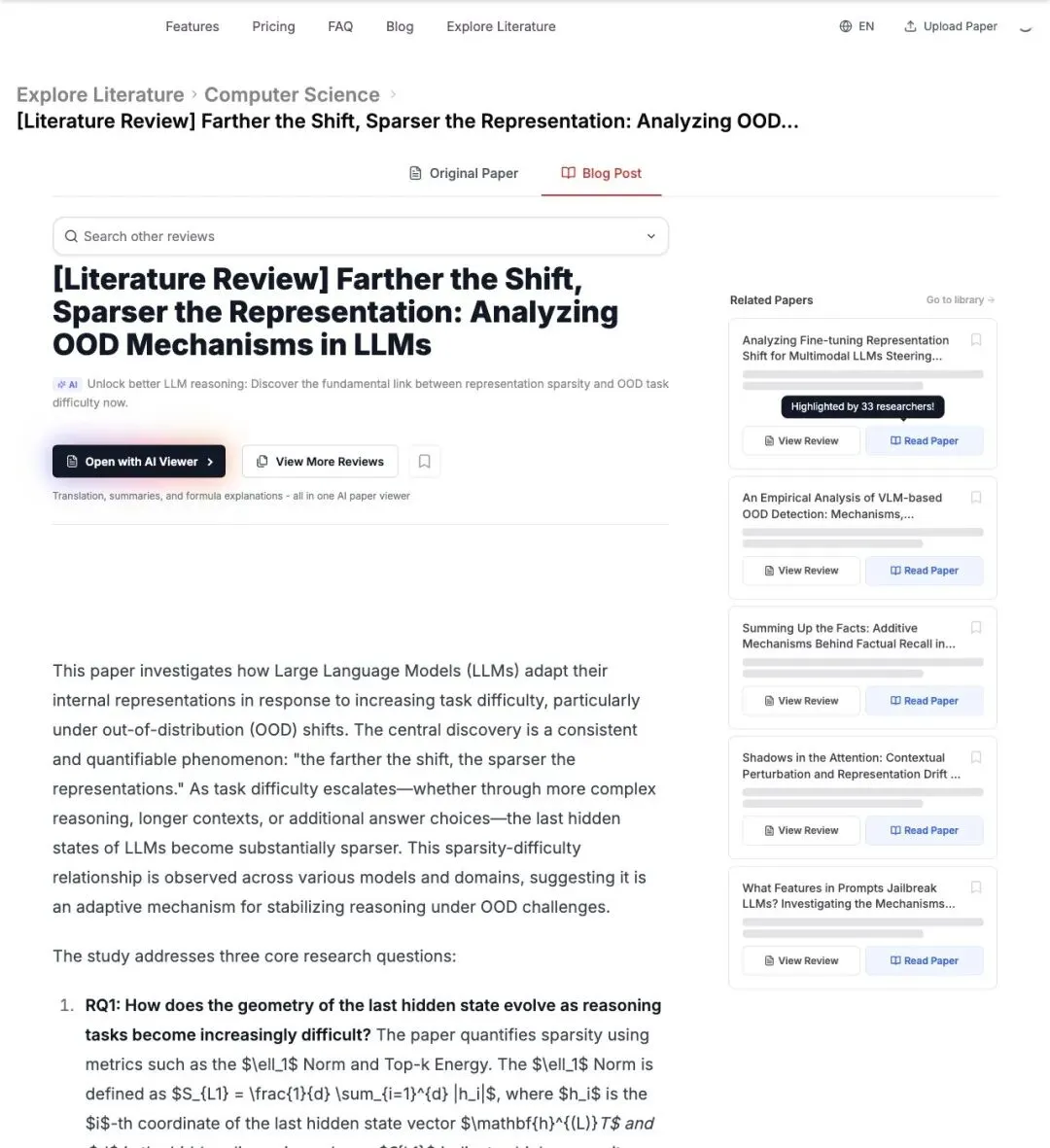

▲ 论文已被 Moonlight 等 AI 论文解读平台收录

为什么这篇论文值得关注?

很多 mechanistic interpretability 的研究读起来很酷,但离产品很远。这篇论文不一样——它提供的稀疏度信号,天然适合做成 runtime guardrail:

-

稀疏度超阈值 → 自动补检索 -

稀疏度超阈值 → 拆解子任务 -

稀疏度超阈值 → 改写提示或补示例 -

稀疏度超阈值 → 触发人工审核

当模型内部开始「收缩」的那一刻,就是系统应该介入的时刻。

正如 Rohan Paul 在推文里总结的:

“Because we can measure this exact shrinking effect as a raw number, we do not have to guess if a question is too hard for the AI.”

「因为这种收缩效应可以被直接量化,我们就不必再靠猜,去判断一个问题是否已经超出 AI 的能力边界。」

从「猜它会不会错」到「看它内部信号就知道它正在挣扎」——这个转变,也许比任何一次基准测试跑分都更有意义。

— END —

夜雨聆风

夜雨聆风