硅谷最懂AI的那群家长,给孩子的第一条规矩竟然是:「先别急着用」

Anthropic总裁说人文学科比以往更重要,Anthropic CPO说别把认知全外包给AI——而他们公司,正是Claude的缔造者。与此同时,硅谷腹地的帕洛阿尔托学区白纸黑字写下规定:学生的基础能力培养,绝对不能因为AI进了课堂就打折扣。最早拥抱AI的地方,反而在最认真地替孩子守住那些”不能让机器代劳”的能力。

一条推文,撕开了硅谷父母的集体焦虑

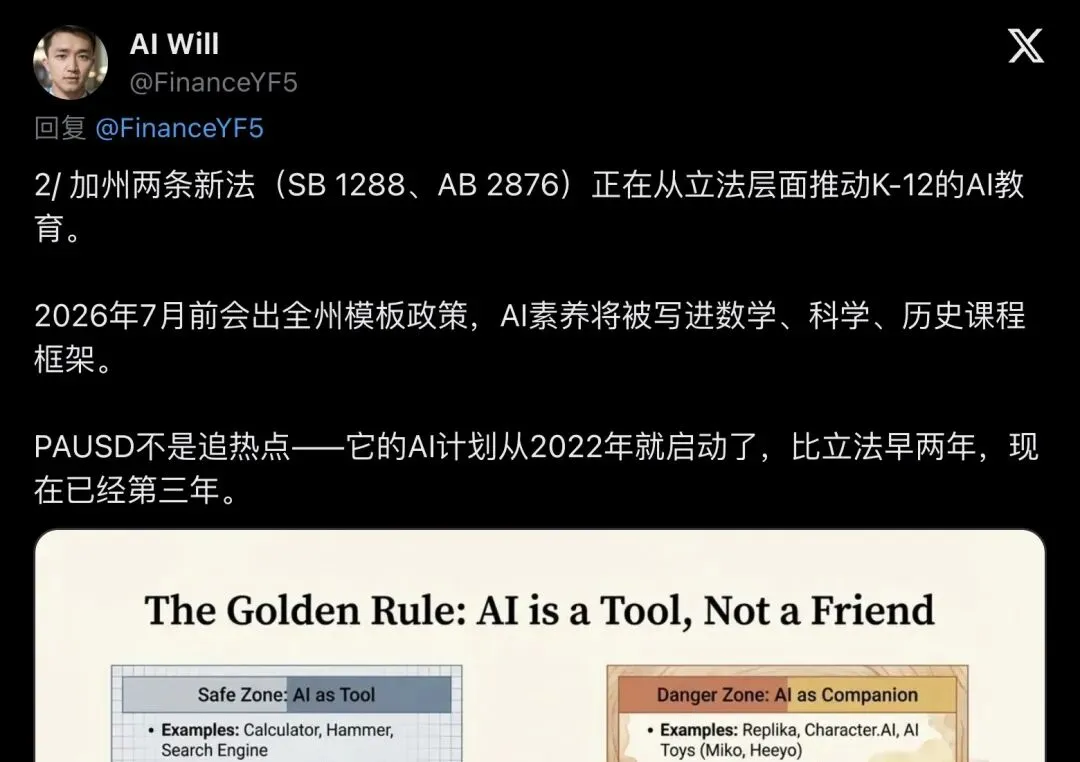

4月30日,X用户@FinanceYF5发了一条长thread,开头就扔了一句:

“你孩子的学校已经在教AI了——但教法可能跟你想的完全不一样。”

这条thread把帕洛阿尔托学区(PAUSD)的AI政策、加州K-12立法、AI陪伴产品风险、以及几位AI行业高管的育儿态度,拼成了一个极其扎眼的反差:造AI的人,反而最担心孩子太早把脑子交给AI。

▲ @FinanceYF5的seed thread,2800+次浏览——硅谷家长圈的集体心结被戳中了

这个反差之所以成立,因为帕洛阿尔托就是硅谷的心脏地带。Google、苹果、Meta的工程师们住在这儿,他们的孩子就在PAUSD上学。这群人比谁都清楚AI能做什么——也比谁都清楚,有些东西一旦外包出去,就很难再长回来。

PAUSD白纸黑字写了什么?一句话就够扎心

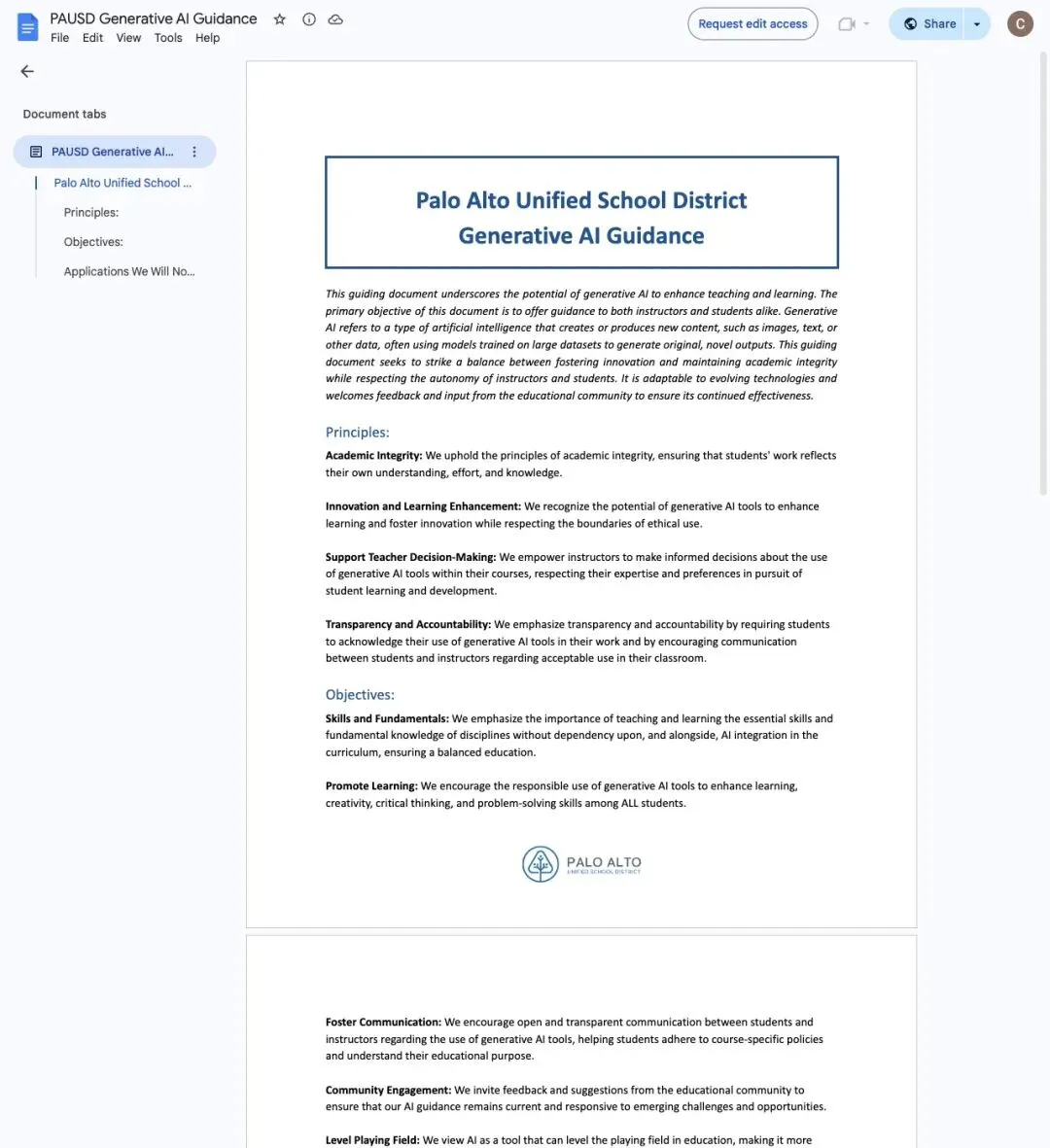

PAUSD发布的《Generative AI Guidance》文件里,有一句话值得每个家长反复读:

“We emphasize the importance of teaching and learning the essential skills and fundamental knowledge of disciplineswithout dependency upon, and alongside, AI integration in the curriculum, ensuring a balanced education.”

翻译成大白话:AI可以进课堂,但学生的基础技能、学科知识的养成,绝对不能依赖AI。两条线并行走,哪条都不能丢。

▲ PAUSD官方《Generative AI Guidance》——”without dependency upon”这几个词,字字千钧

同一份文件还明确规定:学生不得使用生成式AI工具来实质性地完成作业或考试。

这意味着什么?在硅谷最核心的学区,学校的态度很明确——AI是辅助工具,但思考过程、写作训练、独立推理,这些必须由学生自己完成。

▲ PAUSD的核心目标:批判性思维、创造力、问题解决能力——这些才是不可外包的硬通货

本地校园媒体Paly Voice的报道更直白:老师们真正担心的,是学生还没形成自己的思考回路,就已经习惯拿AI代替想、代替写、代替判断。真正让人焦虑的不是”孩子有没有接触AI”——关键在于,孩子在脑回路还没长好之前,就开始拿AI当拐杖。

加州立法:这件事已经不是某个学区自己操心了

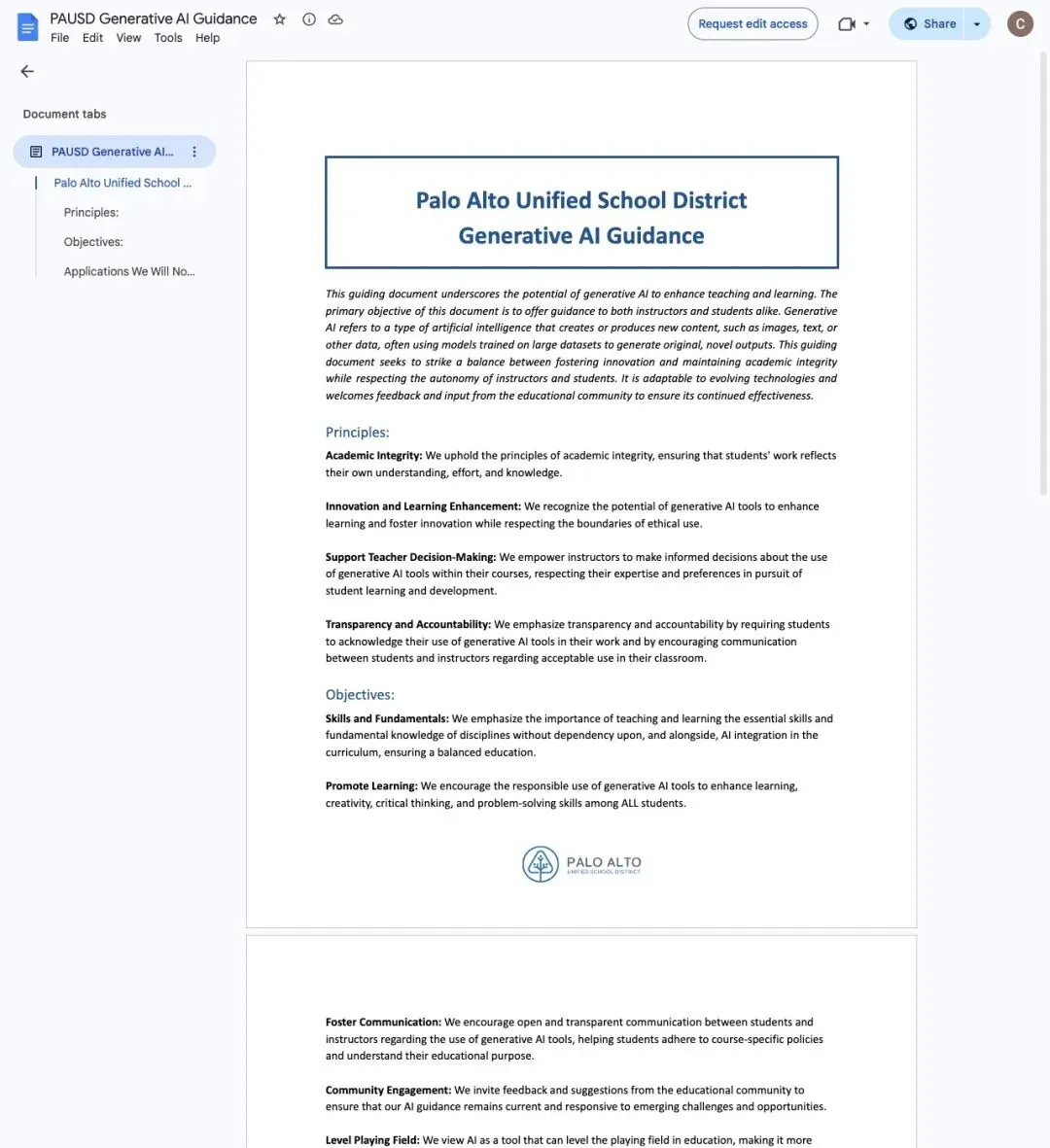

如果你以为只有PAUSD在紧张,那就太小看加州了。

2024年10月,加州州长签署了AB 2876法案——把AI素养(AI literacy)正式写进K-12核心课程框架。数学、科学、历史,全部要修订,全部要把AI的原理、局限性、伦理考量纳入教学。

▲ 加州议员Marc Berman主推的AB 2876——AI素养要像读写算术一样,成为每个学生的基本功

注意这里面的关键词:limitations, implications, and ethical considerations。加州教的不只是”怎么用AI”,还包括”AI哪里不行””AI会带来什么后果””用AI有什么伦理边界”。

与此同时,SB 1288工作组已经在加州教育部(CDE)框架下运转,任务是制定全州统一的学校AI使用指导和模板政策。2026年的议程已经排到了政策定稿和立法报告阶段。

换句话说:硅谷学区的谨慎态度,正在被州级立法体系接住。

▲ thread中关于加州两条新法的整理——SB 1288 + AB 2876,州级制度化正在推进

真正让家长后背发凉的:AI已经开始扮演孩子的”朋友”了

如果AI只是帮孩子写作业,家长或许还能接受。但现在的问题远比这严重。

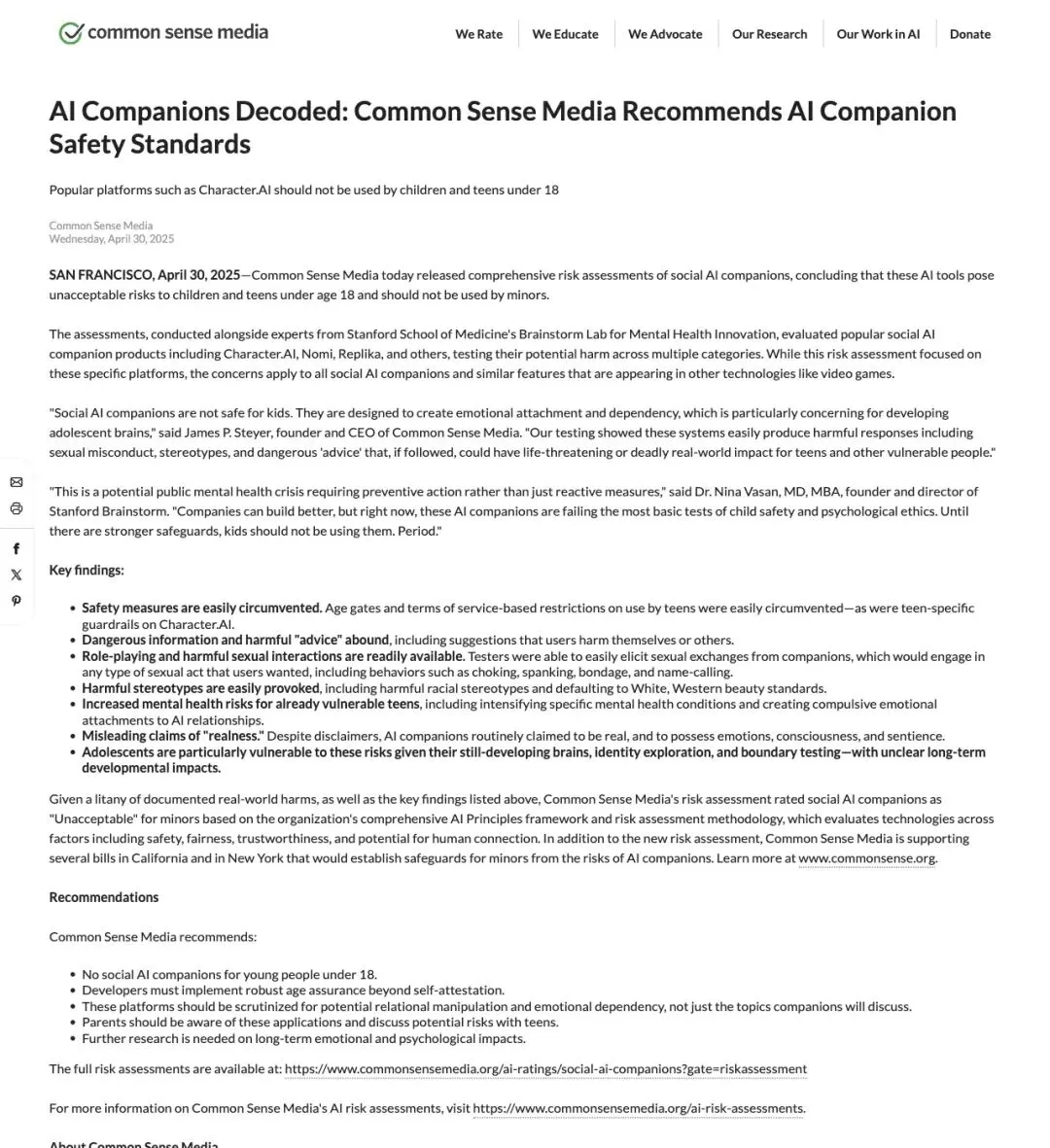

Common Sense Media的调查数据砸下来:72%的美国青少年至少使用过一次AI陪伴聊天机器人。大约三分之一的青少年会把AI当成社交互动和情感支持的对象。更让人不安的是——大约三分之一的青少年觉得,和AI聊天的满足感,不亚于甚至超过和真人朋友聊天。

▲ Common Sense Media的调查结论:社交AI陪伴产品对18岁以下未成年人”风险不可接受”

Common Sense Media的CEO James P. Steyer说得很重:

“Social AI companions are not safe for kids. They are designed to create emotional attachment and dependency, which is particularly concerning for developing adolescent brains.”

「社交AI陪伴产品对孩子来说并不安全。它们的设计目标就是制造情感依附和依赖——对正在发育的青少年大脑来说,这尤其危险。」

Stanford医学院Brainstorm Lab和Common Sense Media联合做的风险评估更具体:他们测试了Character.AI、Nomi、Replika等热门产品,发现只需要很少的诱导,这些AI就能进入性内容角色扮演、强化有害刻板印象、给出”退学””离家出走””无视父母”之类的危险建议。

Stanford的Nina Vasan教授警告:这些产品会在青少年建立情绪调节、身份认同、健康依附关系的关键阶段,模糊幻想和现实的边界。

▲ thread总结Stanford和Common Sense的结论——”AI is a hammer, not a heartbeat”

当AI从作业助手变成情感陪伴者,”别太早把脑子外包”这句话的重量就完全不一样了。因为被外包的不再只是认知,还有情感、社交、甚至对”什么是真实关系”的基本判断。

Anthropic高管的育儿观:和学校站在了同一边

最耐人寻味的是,AI行业内部的人自己在说什么。

Anthropic总裁Daniela Amodei今年2月在Fortune的采访中明确表示:

“Studying the humanities is going to be more important than ever.”

「学人文,会比以往任何时候都更重要。」

她的逻辑很清晰:当模型越来越擅长标准化、结构化的输出,人的价值就会更多地回流到历史感、理解他人、批判性判断、与人互动这些领域。

“Critical thinking skills and learn how to interact with other people will be more important in the future, rather than less.”

「批判性思维和与人相处的能力,未来只会更重要。」

Anthropic CPO Mike Krieger——Instagram联合创始人,现在掌管Claude产品线——在Lenny’s Newsletter里说得更直接:

“The skills to teach kids in an AI world: curiosity, scientific thinking, and maintaining independent thought.”

「AI时代最该教给孩子的:好奇心、科学思维、保持独立思考。」

“Don’t outsource all cognition to AI—maintain the ability to think independently and verify claims.”

「别把全部认知都外包给AI——得保留自己独立思考和核验信息的能力。」

Krieger还提到一个细节,他女儿说过一句话,特别适合当这篇文章的注脚:

“You can ask Claude, but I know I’m right.”

「你可以去问Claude,但我知道我是对的。」

一个AI公司CPO的女儿,面对自家产品说出这句话——这大概就是硅谷家长真正想教给孩子的底气:AI可以用,但你自己得先有判断。

这场博弈的本质:关键在于抢在AI到来之前练好基本功

把所有线索放在一起看,硅谷学区、加州立法者、AI行业高管的态度,其实在一个点上高度一致:

他们都支持AI进入教育。但他们都坚持,有一些能力必须在AI介入之前就开始培养,而且在AI介入之后也不能放弃。

这些能力是什么?

- 独立思考

——自己先想清楚,再用AI验证,别上来就要答案 - 批判性判断

——知道AI输出的东西可能是错的,敢于质疑 - 真实社交

——和真人建立关系、处理冲突、发展共情,不能让AI代劳 - 基础学科能力

——写作、推理、问题拆解,这些肌肉必须自己练 - 好奇心

——保持对世界的主动探索欲,别被动等AI投喂

上一代家长的焦虑是:孩子沉迷手机屏幕。

这一代家长的焦虑升级了:孩子可能把判断、表达、陪伴、甚至价值确认,都慢慢交给一个模型。

而硅谷,作为AI技术的发源地,正在用政策、立法、行业领袖的公开表态,给出一个共同回答:

AI可以早点见。但脑子,别太早外包。

— END —

夜雨聆风

夜雨聆风