OpenClaw架构学习

-

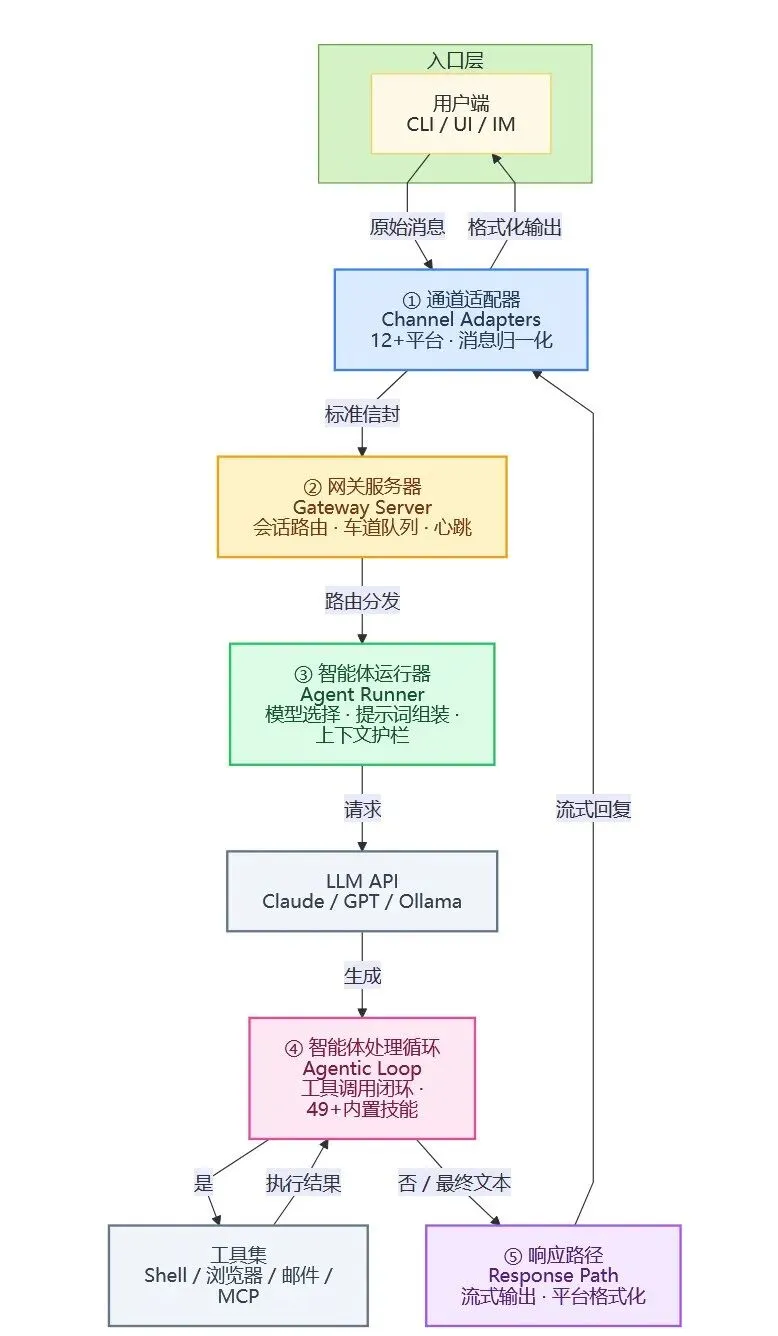

消息归一化:把Telegram的贴纸、Discord的嵌入链接、WhatsApp的表情回应,统一转成”标准信封”。 -

附件提取:媒体、文档、语音一律转码为下游可处理的格式。

-

会话路由(Session Router):私聊共享主会话,群聊分配隔离会话。 -

车道队列(Lane Queue):并发控制层。当你在三个群里同时指挥AI时,它确保每个对话状态独立,避免”串台”。 -

心跳机制:所有执行节点(Pi-embedded)定期发送心跳包,失联时自动路由到备用节点 。

-

模型解析器:动态选择模型(Claude/GPT/本地Ollama)。 -

系统提示词构建器:根据启用的Skills按需组装提示词——不用功能不浪费Token。 -

会话历史加载器:从本地存储调取持久对话上下文。 -

上下文窗口护栏:当对话逼近Token限制时,自动压缩历史,确保对话不中断。

-

是:执行工具(查找文件、运行代码),将输出反馈给LLM,循环继续。 -

否:输出最终文本。

为了降低感官延迟,OpenClaw采用流式处理。用户能看到文字像喷泉一样涌现,而不是死等三分钟 。

同时,响应会再次经过通道适配器,针对目标平台格式化——Discord渲染Markdown,Telegram按字符长度分段。

夜雨聆风

夜雨聆风