APP MCP已死?CLI永生?

Web死了,现在轮到APP和MCP死了。

CLI被捧上神坛,就好象命令行一出,AI就能统治世界。

先是我把飞书客户端卸了! 官方CLI来了,专门为 AI Agent 设计

再是企业微信wecom-cli

一夜之间,从百虾大战升级到了百CLI战。

但CLI是最终解吗?

我们先回到一个最基本的问题,大语言模型,到底是什么?

注意看它名字里的第二个字母:L,Language,Large Language Model

从本质上说,现在的所谓的AI人工智能只是一个文本处理器,输入文本、处理文本、输出文本,这,就是它的全部。

为了让这个文本工具能够伸出手来触碰真实世界,又发明了Function Call、MCP、Tool Use等等,于是就有了Manus、龙虾这样看起来能替人干活的智能体,让人以为AI终于学会了操作。

但对于LLM模型来说,这些东西有本质区别吗?

答案是:几乎没有!

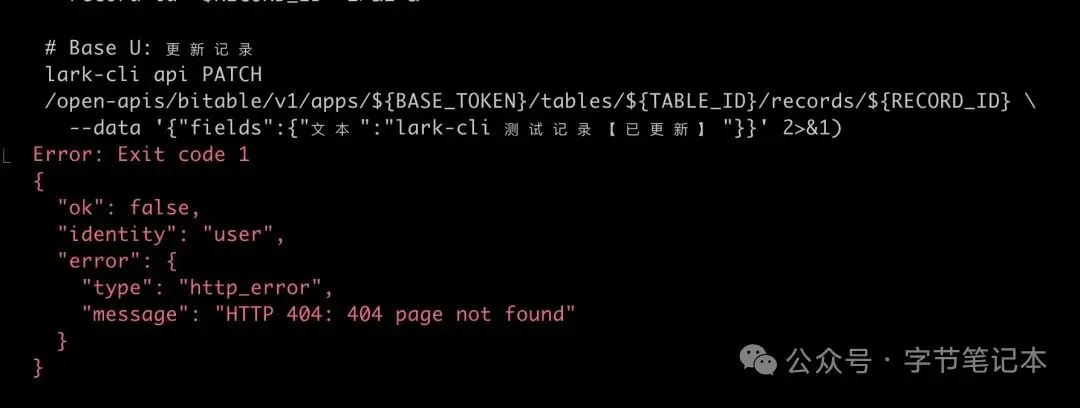

模型调用一个CLI命令,得到一段文本,塞回上下文。

调用一个MCP工具,得到一段JSON,塞回上下文。

调用一个API,同样如此。

比如下面这个企业微信号的CLI请求返回格式。

不管外面的壳长什么样,进到模型,全都是token,全都是待处理的文本,它吐出来的也还是文本。

CLI这个古早的工具其实并没有打开新的世界,它只是把原来图形界面里的能力,重新包了一层模型看得懂的文本的皮。

因为LLM模型能做且只能做的就是阅读和解析文本。

本质上换汤不换药。

那真正改变游戏的是什么?

是开放本身,只用愿意把数据吐出来,模型就能用,数据不开放封着,CLI造得再精美,也没有啥用。

飞书最近出了官方CLI,专门为AI Agent设计。但仔细想想,飞书开放API,是开放行为,和它选择用CLI这种形式包装,是两件事。

很多人把这个因果关系搞反了,不是因为CLI,所以开放了,而是因为开放了,所以CLI才有它的意义。

概念先行,逻辑在后,看透了这一层,才不会被一些制作焦虑的垃圾自媒体牵着鼻子走。

再退一步说,CLI真的对AI友好吗?也未必。

现在大量CLI工具,在设计之初根本没考虑过自动化调用的场景。

比如你让模型跑一个命令,它可能弹出一个交互式提示,等你输密码、等你确认、等你选择,模型傻在那里,进退两难。

类似飞书这种庞大的参数和交互逻辑的CLI,即便是最强的Claude模型也要经历不断的试错重做。

而且很多交互其实界面操作比CLI更加的直观,你在CLI的要做的选项不一定比APP UI界面中的少,但符合人类的操作交互直观和连贯性,对人类友好的交互设计,对机器来说往往是最大的障碍。

所以一切工具好不好用,不在于工具本身,而是它适用的场景。

还有一件事,所有APP Web这类已死的预言都刻意忽略了一点。

人,还是那个最强大的Loop。

Photoshop怎么CLI化?视频剪辑里情绪节奏的拿捏,怎么写进脚本?一张海报的留白,一段音乐的呼吸感,一个品牌决策的直觉判断。

这些东西,不是AI做不到,是”做到”本身没有意义,因为评判的标准活在人的感知里,不在数据库里。

强交互的创意场景、没有强SOP的判断场景,人反而变得更不可替代。

所以未来的分工从来不是AI取代GUI,而是,重复的可标准化的,交给机器,需要感知的,还是羰基生命的工作,机器处理量,人处理质。

所以APP没死,MCP也不会死,CLI也终究只是个过客。

它们都只是在被重新定义,使用者是谁,以及谁来做最后那个判断。

而CLI是一种接口形态,它不是一种信仰,更不需要热捧。

今天它恰好就在AI文本阅读和使用的舒适区,AI用起来顺手,仅此而已。

等多模态真正成熟,模型直接理解屏幕、直接操作像素,CLI同样会显得多余。

到那时,又会有人写一篇新的营销号文章《CLI已死,视觉操作永生》了。

所以,与其追着每一个死不死,不如一个问更真切的问题:

平台的数据,今天能不能有序公开的被Agent调用?

不能,包装得再好看,也只是一座数据孤岛。

开放才是永生的那个东西。

不是CLI,不是MCP,不是任何一种封装。

夜雨聆风

夜雨聆风