不想把会议录音交给云端?这个本地 AI 工具把转写和总结都留在你的电脑里

很多人已经习惯让 AI 帮忙做一件事:会议结束后,自动生成纪要。

打开一个会议助手,点“录音”,结束后几分钟,一份结构清晰的总结就出来了。

但这里有个很少被认真讨论的问题:

你的会议内容,其实被上传到了别人的服务器。

团队讨论、产品规划、客户信息、甚至内部争论——这些数据在大多数 AI 会议工具里都会经过云端处理。

最近有开发者在 Hacker News 上发布了一个小项目:Ownscribe。它做的事情很简单:录音、转写、总结会议。但它坚持一个原则——所有数据都留在本地。

这件事表面看只是一个开源 CLI 工具,但背后其实是 AI 工具市场正在出现的一条新路线。

为什么越来越多公司开始警惕“云端会议助手”

过去两年,AI 会议助手爆发式增长。

Otter、Fireflies、Notion AI、Zoom AI 等工具都在做同一件事:

-

自动录音 -

自动转写 -

自动总结

对用户来说,这确实很方便。

但企业用户很快发现一个现实问题:这些服务几乎全部依赖云端。

也就是说,会议音频必须上传到服务器,模型在远程处理后再返回结果。

对于个人用户,这可能只是隐私问题。

但对于公司来说,这可能涉及:

-

商业机密 -

客户信息 -

产品路线 -

合同细节

很多公司已经明确规定:内部会议不能上传到第三方 AI 服务。

于是,一个新的需求出现了——

能不能用 AI,但数据完全留在本地?

Ownscribe 的思路:Local‑First

Ownscribe 的设计其实非常直接。

它不是 SaaS,也不是网页应用,而是一个 CLI 工具。

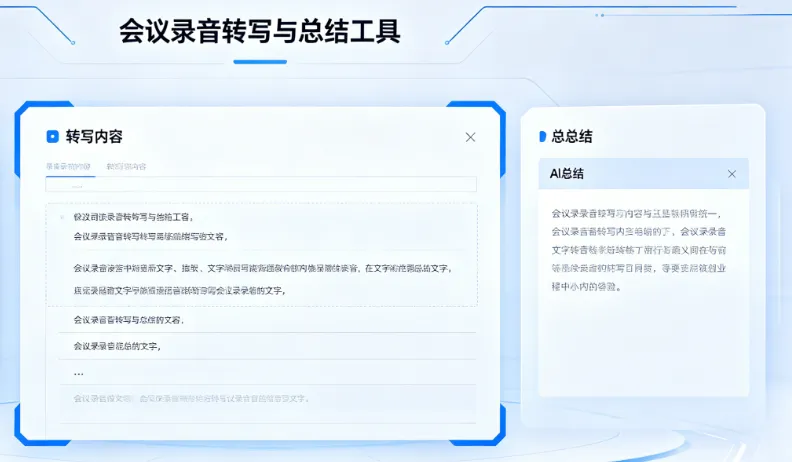

它主要做三件事:

1)录制会议音频

工具可以直接捕获系统音频(在 macOS 上通过 Core Audio Tap 实现),也就是把电脑正在播放的会议声音直接记录下来。

2)本地转写

录音会被转换为文字。

3)自动生成摘要

脚本会进一步整理内容,生成会议总结。

关键点只有一个:

整个过程不需要把数据发送到云端。

音频、脚本、摘要文件全部保存在本地。

从产品角度看,这其实是一种非常典型的 local‑first AI 工具设计。

本地 AI 工具为什么突然变多

如果把时间线拉长,你会发现一个明显变化。

2023 年:几乎所有 AI 应用都是云端。

2024 年开始:越来越多工具开始强调 本地运行。

原因主要有三个。

1 成本问题

云端 AI 的最大问题其实不是技术,而是成本。

每一次会议转写、每一次摘要生成,背后都是模型调用费用。

如果用户规模上来,这些成本会迅速放大。

而本地 AI 的逻辑是:

用户自己提供算力。

开发者只需要提供软件。

2 隐私问题

企业用户越来越敏感。

尤其是涉及:

-

投资讨论 -

商业合作 -

产品规划

很多团队宁愿牺牲一点便利,也不愿意把会议数据交给外部服务。

3 可控性

云端 AI 有一个天然问题:

你依赖别人的 API。

如果价格上涨、接口变化、服务限制,你的产品会受到影响。

而本地工具更像传统软件——可控性更强。

但本地 AI 也有一个明显门槛

Ownscribe 选择 CLI,其实也说明了一个现实:

这类工具目前更偏向开发者。

普通用户会遇到几个问题:

-

需要安装环境 -

需要命令行操作 -

需要一定技术基础

这就是本地 AI 工具目前最大的矛盾。

一边是隐私和控制权。

另一边是使用门槛。

所以你会看到很多创业团队在做一件事:

把本地 AI 做成像普通软件一样简单。

谁能把这件事做好,谁就可能抓住下一波 AI 工具机会。

谁会为这种工具真正付费

如果从商业角度看,本地 AI 工具最可能付费的人其实很明确。

第一类:技术团队

他们本来就习惯 CLI、脚本和自动化流程。

第二类:对隐私敏感的公司

比如咨询公司、投资机构、律师事务所。

第三类:内容生产团队

例如播客、访谈、研究团队,他们每天都要处理大量音频。

对这些人来说,本地工具的价值很直接:

效率 + 隐私。

一个更大的趋势正在出现

Ownscribe 本身可能只是一个小项目。

但它代表的趋势其实更重要:

AI 正在从“云服务”重新变回“软件工具”。

未来几年,你可能会看到越来越多类似产品:

-

本地 AI 写作 -

本地 AI 搜索 -

本地 AI 会议助手 -

本地 AI 知识库

这背后的核心问题只有一个:

用户到底愿不愿意把自己的数据交给 AI 平台。

有些人会选择便利。

有些人会选择控制权。

而新的产品机会,往往就诞生在这种分歧之间。

最值得思考的一个问题

如果有两个 AI 会议工具:

一个完全云端,使用最简单。

一个完全本地,隐私更安全,但需要一点技术门槛。

你会选哪一个?

欢迎在评论区聊聊你的选择,也可以说说你现在用的会议记录工具。

夜雨聆风

夜雨聆风