一夜爆火!Claude “防话痨” 插件凭什么治 AI 废话病?3 个隐藏玩法

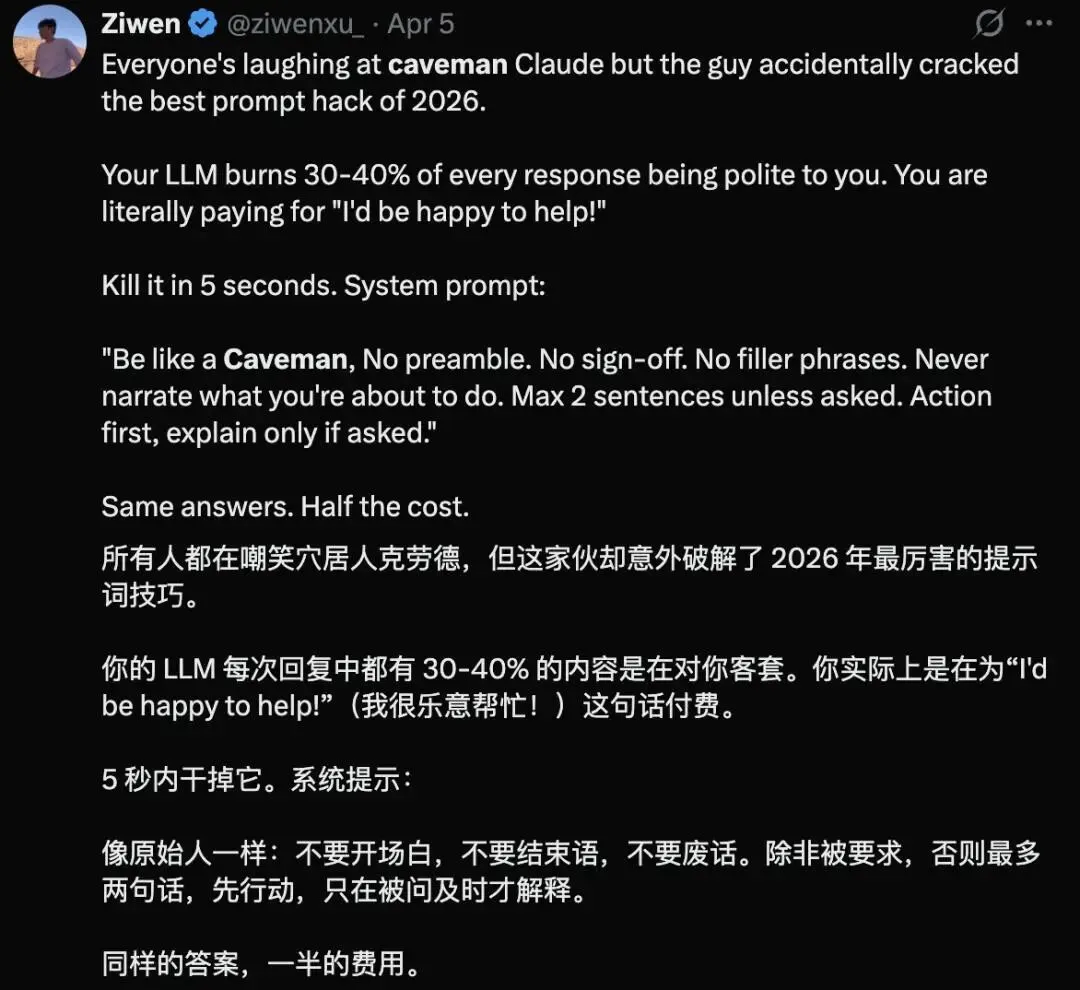

AI使用里存在这样一种情况,一边是AI说的话越来越长、满屏都是客套废话,一边是API使用起来越来越贵、Token疯狂被消耗,很多人在用Claude的时候都陷入了效率与成本这双重的焦虑当中,由此Caveman(原始人)插件最近爆火起来,它是一种能把解决这两大痛点功能结合在一起的颠覆性工具,就该说它专治AI废话文学,还能帮你实现省钱、提速以及更精准这些效果

Caveman这款”防话痨插件”能直接刷屏是有原因的,首先它精准击中了用户的真实痛点,Claude这类模型为了显得”周全”,常常会自带大量铺垫、解释以及客套句式,例如”因为……所以……””首先我们需要理解……””综上所述……”这样的情况,在这样的模式情境下,据统计,这类无效冗余内容占比高达13%,不仅读起来让人感觉累、拖慢阅读速度,还白白消耗你的额度。

还有就是它能带来经济与效率双重收益,它能省Token,Caveman最高可节省75%的输出Token,它还能让你使用API时更便宜,API调用费用直接下降,而且它能让回答更准确,作者实测,强制简洁回答让准确率提升26%,由此可以说AI少说废话,你就能少花钱,还能更快拿到结果。

Caveman有3个隐藏玩法,能让效率直接拉满

玩法一:Ultra极简模式

这种模式下只留干货,拒绝废话,开启后,Claude的输出被压缩到极致,它只保留核心结论、技术术语、代码块,删掉所有铺垫、连词、冠词和解释性文字,该模式适合阅读文档、代码审查、快速获取解决方案这样的场景,原本一大段话,瞬间变成”干货短句”,信息密度极高,阅读速度翻倍。

玩法二:内存压缩工具

它能让你在输入阶段也能省Token,很多人不了解的是,Claude处理长上下文和记忆文件(Memory Files)本身就会大量消耗Token,Caveman自带记忆文件压缩功能,它能自动精简冗余记忆内容,输入阶段就能节省约45%的Token,长对话、多轮任务变得更流畅、更经济。

玩法三:三档模式自由切换

你可以根据场景随意切换,非常灵活,Lite轻量模式只删客套话,语法完整,适合日常聊天,Full标准模式删除冠词和大量填充词,平衡简洁与通顺,Ultra极致模式是原始人级精简,适合专业高效场景。

由此可以总结出,这才是AI工具的正确打开方式,Caveman不只是一款”简洁插件”,它揭示了一个被很多人忽视的真相,那就是AI的强大,不在于说得多,而在于说得准,它对付废话时能减少冗余,让你阅读更快,对付成本时能压缩Token,直接帮你省钱,对付效率时能通过三档切换,适配所有场景,如果你经常使用Claude、嫌弃AI啰嗦、心疼API费用,那么这个插件几乎可以说是”刚需级神器”。

夜雨聆风

夜雨聆风