当AI开始“思考”画面:ChatGPT Images 2.0带来的范式革命与创业地图

2026年4月22日凌晨,北京时间3点整,OpenAI以一场几乎没有任何预告的“深夜王炸”,发布了ChatGPT Images 2.0。没有冗长的预热,没有铺天盖地的宣发——这个代号为“duct tape”的神秘模型,在LM Arena上以匿名的姿态经过了数周的用户测试后,终于揭开了面纱。

此前,GPT-4o在2025年3月实现了原生图像生成,而Images 2.0的发布距离GPT-Image-1.5问世仅相隔数月。如此密集的迭代节奏,本身就在宣告一件事:AI图像生成的竞赛已进入全速冲刺阶段,竞争正从简单的“文生图”转向高实用性的多模态智能。

一、核心进化:从“渲染器”到“视觉思考者”

如果说以往的AI图像生成模型更像一个听话但略显笨拙的“渲染器”——你给我提示词,我尽力画出来——那么Images 2.0则完成了从工具到“视觉思考伙伴”的根本性跃迁。

1. “思考模型”:打破图像生成的“黑箱困境”

Images 2.0最本质的突破,在于首次引入了推理能力。它不再是一个纯粹的生成模型,而是一个会思考的视觉系统。在ChatGPT中,用户可以手动切换到“Thinking”或“Pro”模型,此时Images 2.0会启动一个完整的工作流:联网检索相关信息→对图像结构进行事前推理规划→生成图像→自我复核输出准确性。

这种“事前规划+事后校验”的双重机制,意味着模型能够承担从“想法”到“图像”之间更多的工作。过去,用户需要通过反复调整提示词来“引导”模型理解自己的意图;现在,模型主动承担了这部分认知劳动,在准确性、时效性、一致性至关重要时,思考模型能够自动补齐信息细节,从模糊的意图中直接生成精准的图像。

2. 多图一致性:真正可用的叙事引擎

在漫画创作、分镜设计、系列配图等场景中,角色和风格的一致性一直是AI图像生成的“阿喀琉斯之踵”——每个角色在不同画面中往往“判若两人”,使得AI无法真正用于长叙事创作。

Images 2.0在这一领域实现了里程碑式的突破:单次提示可生成最多8张连贯图像,且系统能够在不同场景切换中,严谨地保持角色形象、物体细节和整体视觉风格的高度统一。OpenAI表示,这将大幅降低漫画页面、社交媒体系列配图及室内设计方案的创作门槛。这是一个从“单帧抽卡”到“连续叙事”的质变。

3. 多语言精准渲染:全球化落地能力

文字渲染是AI图像生成领域最难攻克的技术壁垒之一。DALL-E 3改进了文本渲染,GPT-Image-1.5又前进了一步,但在多语言、长文本、小尺寸文字方面仍有明显短板。

Images 2.0在这一维度实现了质的飞跃。它不仅能够精准渲染英文,在中文、日语、韩语、印地语和孟加拉语等非拉丁语系语言的文本生成方面也有了显著提升,甚至能够完成包含数百字的信息长图、菜单、说明书等密集文本内容。实测中,输入一整首《沁园春·雪》的完整词句,Images 2.0仍能在1分钟内生成字形基本正确的书法风格作品。语言本身正在成为设计的一部分,而不只是“贴上去”的装饰。

4. 物理逻辑与高清画质:从“像”到“是”

初代AI画图常见的手指错乱、物体比例失调、空间透视混乱等问题,在Images 2.0中得到了深度优化。模型对人体的骨骼结构、物体的三维透视、光影的反射逻辑有了更准确的理解,画面噪点大幅减少,纹理细腻度飙升——毛发、布料、金属质感、水面反光等细节达到商用级别。API层面最高支持2K分辨率输出,宽高比范围扩展至3:1和1:3。

二、技术坐标系:为什么这是一次范式跃迁?

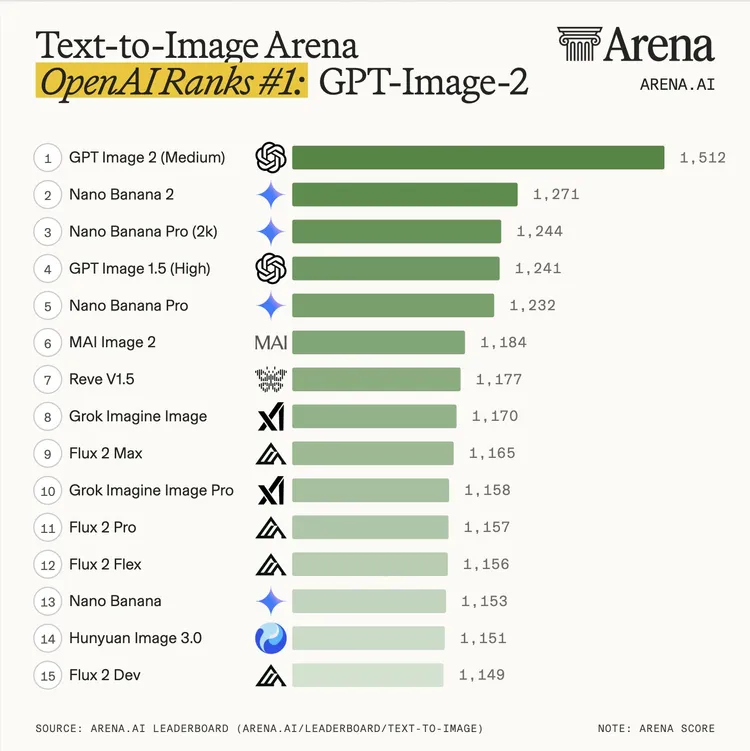

要理解Images 2.0的真正意义,必须将其放在2025-2026年AI图像生成的竞争版图中审视。

1. 竞争格局:三大路径的分化与交汇

当前AI图像生成领域呈现出清晰的三足鼎立之势:

Midjourney代表的是“艺术审美驱动”的路径。V7和V8的迭代方向始终围绕“更美的画面”和“更高效的探索”——V8实现了约5倍的速度提升,并大幅改进了文本渲染能力。但Midjourney的核心哲学仍是“创意搜索”和“美学表达”,在精确遵循指令、像素级可控方面存在天然短板。

谷歌Nano Banana 2(2026年2月发布)代表了“高质量基础模型”的方向。支持最高4K分辨率输出,可在多张图片中保持最多5个角色形象一致,单张画面融合多达14个元素,并在中文乱码、语义理解等问题上有明显修复。其优势在于谷歌生态的深度整合与高质量基础模型能力。

OpenAI Images 2.0则走出了第三条路——推理驱动。它不再只是一个图像生成模型,而是与ChatGPT的思考模型无缝集成,具备联网检索、自我校验、多图一致生成等复合能力。正如行业分析师所言:“竞争正从简单的图像生成转向高实用性的多模态智能”。

2. 架构突破:从两阶段推理到单次生成

据消息源透露,GPT Image 2采用了全新的底层架构,抛弃了GPT-4o的图像生成管线,从两阶段推理转向单次生成模式,这在理论上能同时带来质量提升和渲染加速。虽然OpenAI尚未公布详细的benchmark数据,但从泄露测试和早期用户的反馈来看,该模型在多模态理解、指令遵循和视觉还原度上已处于行业最前沿。

3. 横向对比:谁在哪个维度领先?

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

值得一提的是,Midjourney V8在速度上表现尤为突出,标准生成较V7快约5倍,原生支持2K输出,文字渲染也实现了“从不可读到可用”的突破。Images 2.0在API端最高支持2K分辨率,但V8的“性价比速度”策略——用便宜模式探索、高价模式精修——形成了独特的产品哲学。而Images 2.0则在多图叙事和推理深度上建立了差异化优势。

4. 技术趋势:2026年多模态的主线

从更宏观的视角看,2026年多模态仍是AI核心发展主线,行业正从“连接模态”走向“跨模态原生思考”。商汤科技的NEO-unify项目展示了“理解与生成在同一体系中协同进行”的技术方向。IDC指出,企业需要在2026年认识到,AI的未来不再是单一模型架构,而是更加多样化和专业化的模型生态系统。

Images 2.0的出现,正是这一趋势的集中体现——它不再是“文本→图像”的单向转换,而是将视觉理解、语言推理、联网搜索和图像生成整合为统一的认知链条。

三、行业影响:谁在恐慌,谁在欢呼?

1. 设计师与画师:威胁还是解放?

“这下设计师和画师真的被威胁到了”——这是雷科技在实测后的第一句话。这种焦虑有其现实基础:Images 2.0的生成质量已接近“可直接使用”的商业级别,从杂志封面到产品海报,从UI界面到信息长图,许多传统需要数小时完成的设计工作,现在可以在数秒内完成。

但“设计师被替代”的判断可能过于简单化。更准确的描述是:设计师的角色正在从“执行者”向“策展人”转变。当AI能快速生成大量高质量视觉素材时,设计师的核心价值将更加聚焦于审美判断、品牌调性把控、跨媒介叙事策略等更高层次的创意决策。正如Images 2.0官方博客所言:“图像是一种语言,而不是装饰。好的图像,就像好的句子一样,会进行选择、组织与呈现”。

2. 内容产业:从“降本”到“扩产”

Images 2.0对内容产业的冲击是全方位的:

-

短视频与自媒体:以往需要专业团队完成的封面图、配图、信息图,现在创作者可以在对话中直接生成,真正实现“边写文案边出图”的一体化工作流。

-

漫画与漫剧:这是最直接的受益领域。AI漫剧制作可将传统11个繁复流程精简为4个步骤,制作成本降低高达90%。Images 2.0的8图连续生成和角色一致性保持能力,进一步降低了长叙事内容的创作门槛。

-

电商与广告:可实现与实时数据绑定的个性化商品图、品牌一致的多版本创意测试、自动合规校验的视觉素材。麦肯锡分析显示,AI驱动的个性化可为全球企业增加高达2.6万亿美元的价值。

-

教育与科普:模型可生成原理示意图、信息图表等复杂视觉内容,将抽象概念转化为直观画面,极大提升知识传播效率。

3. 竞争格局:巨头生态的边界正在消融

值得注意的是,模型壁垒正在被打破。Adobe Firefly已整合了超过30种AI图像和视频模型,包括谷歌的Nano Banana 2、Veo 3.1,Runway的Gen-4.5,以及OpenAI的GPT-Image模型。Firefly平台还上线了自定义模型功能,允许创作者和品牌用自己的素材训练AI模型,确保输出符合特定的视觉风格。

这意味着,未来的竞争不再是谁的模型最好,而是谁能构建最完整的创作生态。模型正在从核心竞争力变为基础设施——真正的护城河在生态、工作流和用户数据上。

四、创业者启示录:三个确定性机会

AI图像生成市场正以惊人的速度膨胀——预计2026年将达到151.8亿美元,到2032年将增长至887.1亿美元,复合年增长率为33.63%。但对于创业者而言,真正的机会并不在于“再做一款生图工具”,而是在Images 2.0等基础模型之上,寻找差异化的垂直切入点和价值锚点。

1. 垂直场景的深度渗透:做“最后一公里”的交付者

通用模型的强大并不意味着它能解决所有行业的痛点。恰恰相反,模型的泛化能力越强,垂直场景中的“最后一公里”问题就越凸显——如何将通用的生成能力转化为特定行业的交付物?

参考案例:宠物行业的“团子相机” 。创始人黄志远开发的团子相机,是一款面向宠物行业的AI写真生成工具,通过AI技术为宠物店提供定制化照片、实体文创产品等服务,帮助门店解决获客难、复购难、客单价低等经营痛点。这并不是在做一个“更好的AI模型”,而是在理解一个特定行业的经营逻辑后,用AI工具重构其服务链条。

创业者可以思考的方向:教育培训的课件配图自动化、医疗科普的医学插图生成、建筑设计的方案效果图快速迭代、跨境电商的多语言产品图生成……这些场景中,通用模型的能力足够强大,但需要特定的“包装层”来适配行业的交付标准和工作流程。

2. 确定性编辑与工作流重构:逃离“抽卡模式”的泥潭

AI图像生成目前面临的核心痛点之一是“抽卡模式”——生成效果几乎完全取决于AI自身的理解能力,用户唯一能做的就是反复打磨提示词,每次迭代都意味着重新生成和新的Token消耗。Lica公司提出的解决方案值得关注:将AI生成的图像解析为结构化的可编辑图层,允许用户精确修改特定元素而不需要重新生成整张图像,从而避免“令牌税”并保留已获得的设计状态。

这个痛点背后蕴藏的巨大商业机会:谁能提供“从抽卡到编辑”的基础设施,谁就能在AI图像生成工作流中占据不可替代的位置。美图已经在这一方向上进行了探索——将AI Agent整合至设计产品中,上线了电商商品Agent、海报Agent、视频Agent等,用户输入核心参数后,Agent即可分析并按需求完成处理。这种从“单次生成”到“工作流整合”的演进,将是未来两年的核心竞争焦点。

3. 品牌一致性与“微调即服务”

Images 2.0在遵循具体指令方面实现了质的跃迁,但企业品牌通常有独特的视觉语言——特定的颜色体系、字体组合、排版规则、设计美学。通用模型无法天然掌握这些细节,而每次依赖提示词来“复现”品牌风格,既不稳定也不经济。

Adobe Firefly Custom Models提供了一个商业化模板:允许用户上传10到30张样本图片,训练一个自定义模型,生成符合特定审美的新图像,训练一次目前消耗500积分。对于中小企业和设计工作室而言,这种“微调即服务”的模式具有天然的付费意愿。

创业者可以构建的商业模式:为特定行业或品牌提供“风格微调”服务,建立品牌视觉资产的AI化管理系统,甚至开发“多品牌多风格一键切换”的SaaS工具。随着AI图像生成越来越普及,“保持一致”将比“生成漂亮”更加稀缺和有价值。

4. 商业模式的再思考:从Token计费到价值分成

当前AI图像生成的主流商业模式是订阅制+Token计费——用户按月付费获得一定额度的生成点数。但这一模式的局限性日益明显:它衡量的是“生成次数”而非“创造的价值”。

未来可能出现更多元的变现路径:

-

按结果付费:在电商场景中,按生成的商品图实际产生的转化效果分成

-

版权管理平台:成为AI生成内容的版权确权和交易中介

-

IP孵化工具:帮助创作者从AI生成的视觉素材中培育可商业化的IP资产

-

B端工作流SaaS:围绕特定行业的设计流程构建完整的AI辅助系统,按项目或用户数收费

结语:图像是一种语言,而不是装饰

OpenAI在官方博客中写下了这样一句话:“图像是一种语言,而不是装饰”。这句话或许是对Images 2.0乃至整个AI图像生成领域最深刻的注解。

过去几年,AI图像生成的发展史可以被概括为“让机器学会画画”;而从现在开始,我们正在进入一个新的阶段——“让机器学会用画面思考”。Images 2.0的“思考模型”只是一个开始。当图像生成模型与联网搜索、自我校验、多模态推理深度融合时,AI生成的不再只是“好看的图片”,而是“有意义的视觉表达”。

对于设计师、创作者和企业家而言,这既是一个需要重新思考自身定位的时刻,也是一个前所未有的机遇窗口。基础模型的能力正在快速商品化,真正的价值将来自于谁能最深刻地理解垂直场景的独特需求,谁能构建最流畅的创作工作流,谁能将AI的生成能力转化为可交付的商业成果。

正如中泰证券在2026年AI应用深度报告中所言:“多模态仍将是AI核心发展主线,一方面持续突破模态边界,提升复杂推理与内容创作能力;另一方面向垂直行业轻量化渗透,为大规模商业化落地奠定更确定的环境”。在图像生成从“渲染”走向“思考”的今天,属于创业者的黄金时代才刚刚开始。

一个.md文件冲爆GitHub的背后:当AI编程的瓶颈从模型转向上下文工程

夜雨聆风

夜雨聆风