AI基建的 4.55万亿元花在哪、瓶颈卡在哪、谁在悄悄赚钱

开篇

如果你只看新闻标题,你会以为AI竞赛的关键词是”模型参数”、“GPT-X发布”、“开源vs闭源”。

但如果你接触过任何一个真实在建的智算中心项目,你会发现这些都不是真正决定胜负的变量。

真正决定2026—2028年AI产业格局的,是三件极不fancy但极其昂贵的事:

-

谁能在合适的地方,拿到几百兆瓦甚至吉瓦级别的电力指标

-

谁能把变压器、冷却系统、机柜按时交付到工地

-

谁能在18个月内让一座大型数据中心从荒地变成可用算力

这三件事的背后,是一笔规模惊人但被严重低估的账。

【图1:数据中心建设工地夜景】

一、6500亿美元(4.55万亿RMB意味着什么

2026年,全球超大规模云厂商(以微软、谷歌、亚马逊、Meta、Oracle为主)的AI相关资本开支,预计将达到约6500亿美元。

这个数字孤立看没感觉,放在历史坐标系里就很惊人:

-

美国年度国防预算:约5000亿美元

-

全球油气行业年度资本支出:约6000亿美元

-

全球制药行业年度研发支出:约1000亿美元

-

阿波罗登月计划总投入(通胀调整):约900亿美元

也就是说,仅仅几家科技公司的AI基建,一年的投入,已经超过美国国防、接近全球油气、相当于每年再造一个新行业。

换一个维度理解:6500亿美元对应大约11吉瓦(GW)的新增电力容量。这个量级是什么概念?中国”东数西算”工程八大国家算力枢纽节点,截至2024年底建成的算力中心总规模,折算电力大致也在这个量级附近——也就是说,全球hyperscaler一年的扩张,等同于中国所有枢纽节点过去几年的总和。

这不是泡沫,这是基础设施超级周期。

二、这笔钱具体花在哪

业内通行的估算口径大致如下,以单兆瓦(MW)为基本单位(数据来自一线开发商的项目级测算,有±20%浮动):

前期资本开支(每兆瓦):约5500—6000万美元

-

数据中心土建+电力设施(变压器、配电、备电、冷却基础设施):约5000万美元/MW

-

IT设备(GPU/服务器/网络):约3000万美元/MW——这是单项最大,但已经不是唯一瓶颈

-

其他配套(机柜、机电、施工、软件):约1500—2000万美元/MW

运营开支(每兆瓦):约100—120万美元/年

主要是电力和基础运维。注意这里电力占运营成本的60—70%——这就是为什么”电”比”运维团队”更重要。

收入(每兆瓦):约1500万美元/年(纯IaaS模式)

如果做托管AI云、模型推理服务,单MW年收入可以拉到2000—2500万美元。

回本周期:大约4年——前提是能持续以90%以上的利用率运行。

这个账本告诉我们什么?

第一,只要MW能上线、能被用满,现金流极强。这就是为什么资本愿意源源不断涌入这个赛道。

第二,回本逻辑严重依赖”上线速度”。同样一笔投资,18个月上线和36个月上线,IRR(内部收益率)差距巨大。所有玩家都在拼命压缩建设周期。

第三,真正的不确定性不在GPU价格(那是英伟达的事),而在电力获取速度和建设周期。这是后面要重点谈的。

【图2:GPU服务器机房内部】

三、瓶颈大转移:从”GPU荒”到”电地荒”

2023年到2024年上半年,行业最焦虑的是GPU供应。一卡难求、定金提前两年付、配额按关系分配——那是属于英伟达的黄金时代,毛利率拉到不可思议的水平。

但从2024年下半年开始,瓶颈悄悄迁移了。

现在,真正卡脖子的不是GPU,而是”powered site”——已经通电、可立即上架GPU的场地。

为什么会发生这个迁移?

1. GPU供应正在缓解

英伟达H100/H200/B200产能稳步爬坡,AMD MI300系列、国产芯片也在涌入。GPU不再是”有钱也买不到”的稀缺品。

2. 电力系统不是想扩就能扩

一个10万卡级别的GPU集群,峰值用电相当于一个中型城市。要给这种集群供电:

-

大功率主变压器:全球供应链交付周期从过去的8—12个月延长到18—36个月

-

高压输电线缆:钢芯铝绞线、高压电缆同样紧张

-

电网接入:美国部分地区已经出现”申请接入排队2—4年”的情况

-

发电容量:核心区域(如弗吉尼亚北部)电网容量已经接近饱和

3. 许可与监管成为隐形杀手

地方政府的环境评估、社区听证、土地用途变更,在很多地区比电网扩容还慢。德州、爱荷华、内华达这些地方相对宽松,所以美国大量新数据中心向这些州集中。

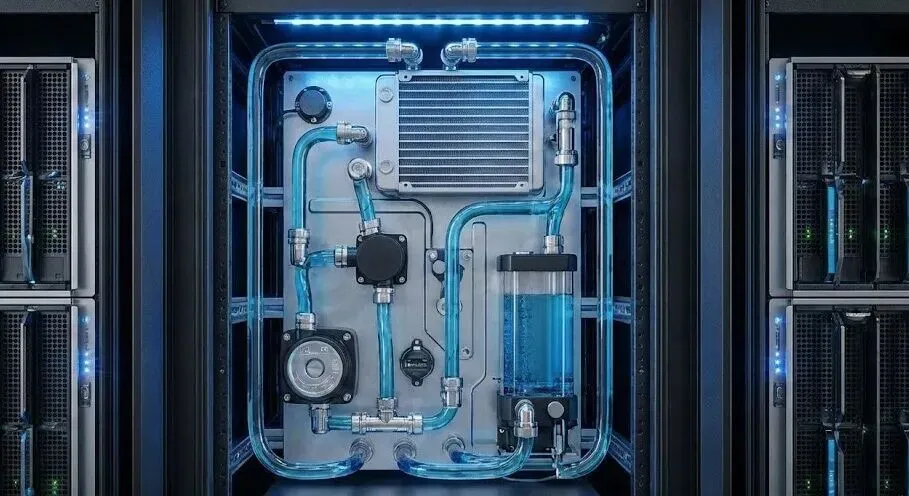

4. 冷却供应链也在紧张

液冷板、CDU(冷量分配单元)、二次侧管路、浸没式冷却液——这一整套基础设施,几年前还是小众市场,现在订单已经排到2027年。冷却厂商的产能扩张速度,远远赶不上GPU功率密度的爬升速度。

行业里有句话很形象:“以前我们优化的是每秒处理多少token,现在我们发现,真正决定一切的是县政府的许可办公室和变压器的交货单。”

这是个非常残酷的转变。它意味着:有钱、有GPU,但找不到地方上电——这不是假设,是2025年很多AI公司正在面对的现实。

【图3:数据中心电力设施】

四、利润池在重新分配

瓶颈迁移直接改变了产业链利润分布。

GPU/芯片层(英伟达、AMD、博通、台积电)

仍然是利润率最高的环节,但定价权在悄悄削弱。当GPU不再是稀缺品,而场地、电力、冷却成为新瓶颈,议价权就开始下移。英伟达的极致毛利率,在未来2—3年大概率会被压缩(虽然依然会很高)。

数据中心开发商/运营商

这是被市场严重低估的环节。每MW年收入1500—2500万美元、回本4年、续约率高、现金流强——这是传统REITs做梦都想要的资产质量。新兴的”Neocloud”(GPU专业云厂商)正在快速崛起。

电力公司与能源资产持有者

可能是最大的隐形赢家。当电力变成稀缺品,长期购电协议(PPA)的谈判权全面倒向卖方。已经掌握存量电力资产的公司——尤其是核电、燃气、可再生能源——正在重新定价。

冷却/热管理供应链

这是个很多人没看清的环节。当GPU功率密度从30kW/机柜爬升到100kW甚至更高,风冷已经物理上不可行,液冷成为唯一选项。这意味着:

-

冷板(cold plate)、CDU、Manifold厂商:订单爆炸

-

浸没冷却液(单相、两相)厂商:从化工副线变成战略物资

-

二次侧水路、压力控制、漏液检测:标准化和工程化空间巨大

-

余热回收与利用:从”环保加分项”变成”经济性必选项”

这一块的产业重构,在国内还远没有充分定价。中国在液冷技术、设备制造、工程实施上有完整产业链,这是少数中国能形成全球竞争力的细分赛道。

电气设备与变压器厂商

ABB、西门子、伊顿、施耐德,加上中国的特变电工、平高电气,都在订单饱和状态。中压/高压开关柜、母线槽、UPS——交付周期全面拉长。这是传统行业里被AI带飞的、最不像AI概念的板块。

【图4:液冷系统细节(冷板、CDU、管路等技术瓶颈】

五、新模式:Neocloud为什么会跑出来

讲完账本和瓶颈,顺理成章的问题是:这场基建竞赛的赢家会是谁?

答案不会是单一的,但有一类玩家值得特别关注:“能源优先”的新型云厂商(Neocloud)。

它们的打法,与传统hyperscaler有本质差异。

传统hyperscaler模式:

找地 → 申请电网接入 → 等变压器 → 建数据中心 → 上GPU → 提供云服务。每一步都被外部依赖卡住,周期长、成本高。

Neocloud模式:

先找电 → 就地建电厂(燃气轮机、可再生) → 在电厂旁边建数据中心 → 同步部署GPU和冷却 → 直接卖给少数大客户(签长期合同)。

这种模式的优势:

-

绕开电网瓶颈:既然电网扩容慢,那就自建电源

-

跳过部分许可流程:发电+用电同址,某些环节简化

-

建设周期短:模块化、并行施工、12—18个月可上线

-

总成本可能更低:不依赖电价上行的电网,锁定能源成本

-

现金流回收快:大客户长期合同,锁定收入

最有代表性的是德州一些大型一体化园区项目——油气资源 + 自建电厂 + GW级数据中心同址布局,直接为头部AI公司供能,完全跳过传统电网瓶颈。

这种模式在中国的对应物会是什么?

我的判断是:“源网荷储一体化” + 西部清洁能源基地 + 大型央企运营商主导的混合形态。

中国的特殊性在于:

-

电网由国家电网/南方电网统一调度,不存在美国那种电网孤岛问题

-

但西部清洁能源(光伏、风电)消纳压力大,跨区输送成本高

-

算力需求中心在东部,能源富集区在西部

-

“东数西算”政策正在试图解决这个错配

这会形成一种有中国特色的Neocloud变体——不一定是民营公司主导,可能是央企+地方政府+电力集团的联合体,在西部建设”能源—算力一体化基地”。这个赛道的玩家不会是单纯的科技公司,而会是”半央企半工程公司”的混合形态。

谁能跑出来,取决于三件事:电力指标的获取能力、跨区调度的政策协调能力、工程建设的实际交付能力。这三项里,科技公司只擅长第三项的一部分。

六、几个被忽视、但很关键的细节

把视野从”hyperscaler vs Neocloud”拉回到产业链具体环节,有几个细节在国内还没被充分讨论。

1. PUE不再是核心指标,WUE和能源结构成为关键

过去十年大家关注PUE(数据中心总能耗/IT设备能耗)。但当电力或清洁能源本身成为瓶颈,单纯压PUE的边际收益越来越小——从1.2降到1.1,只能省几个百分点的电,但建液冷的成本可能拉高10—15%的capex。

未来的核心指标会迁移到:

-

WUE(水效):干旱地区、内陆地区不可忽视

-

CUE(碳效):欧洲、加州等强监管地区已经开始约束

-

能源结构:绿电比例、可再生能源匹配率

2. 余热回收从”加分项”变成”经济选项”

一个10万卡集群每年的废热,相当于一个中型供热厂的产出。在过去,这些热基本被冷却塔散掉了——纯粹的浪费。

但当电费和碳约束同时收紧,余热回收的经济性正在反转。北欧已经有数据中心通过余热回收为城市供暖收钱(不是付费,是创收)。在国内,北方城市的供暖、化工园区的低温热源、工业园区的烘干工艺,都是潜在出口。

3. 算力金融化正在悄悄发生

当数据中心资产具备稳定现金流,它就具备了金融化的条件。已经出现的形态:

-

算力REITs:Equinix、Digital Realty已经是上市REITs

-

算力ABS/CMBS:以IaaS合同为底层资产的资产证券化

-

GPU融资租赁:对中小AI公司是关键工具

这一块在中国的探索比海外慢,但一旦放开,会大幅降低算力建设的资金成本。

七、对不同角色的判断

如果你是AI模型公司或应用公司:

不要只盯着模型,要在2026年提前锁定2027—2028年的算力供给。等价格和供给紧张时再找,基本就晚了。

如果你是投资人:

-

一级市场:关注电力解决方案、液冷供应链、模块化数据中心、余热回收等”非性感”环节

-

二级市场:除了英伟达,关注电气设备、冷却系统、数据中心REITs、特定区域的电力公司

如果你是地方政府或产业园区:

电力指标 + 土地 + 审批速度是吸引算力投资的三件套,缺一不可。仅靠土地优惠没有意义,核心是电。

如果你是传统行业从业者(电力、暖通、化工、土建):

不要因为”我不懂AI”就忽视这个机会。这场基建超级周期需要的恰恰是你们的专业能力。AI公司不缺懂AI的人,缺懂电、懂冷、懂建、懂供应链的人。

结语

AI产业最容易被误解的地方,是把它当成一场”软件竞赛”或”算法竞赛”。

但当6500亿美元真金白银砸下去,你会发现这是一场极其传统的基础设施竞赛——比拼的是电、是钢、是水、是冷却液、是变压器、是工程建设速度。

模型层的胜负,可能在2027年之前就尘埃落定;但基础设施层的格局,会决定未来10—20年AI产业的真实形态。

谁掌握电、谁掌握建设速度、谁掌握冷却供应链——谁就掌握下一个十年的算力定价权。

关于本专栏

这是一个聚焦智能算力基础设施的观察账号。

运营者长期从事算力、能源、热管理交叉领域的研究,有学术背景也有产业一线接触。内容侧重产业判断、技术经济性分析、政策与全球趋势。

不日更、不追热点、不带货、不点评具体公司股票。每周或每两周更新一篇深度分析。

如果你是从业者、研究者、投资人,觉得内容有价值,欢迎关注。

也欢迎在留言区告诉我你想看的话题——液冷、余热、东数西算、算力金融化、海外巨头动向都在选题清单上。

夜雨聆风

夜雨聆风