OpenClaw架构全面解析

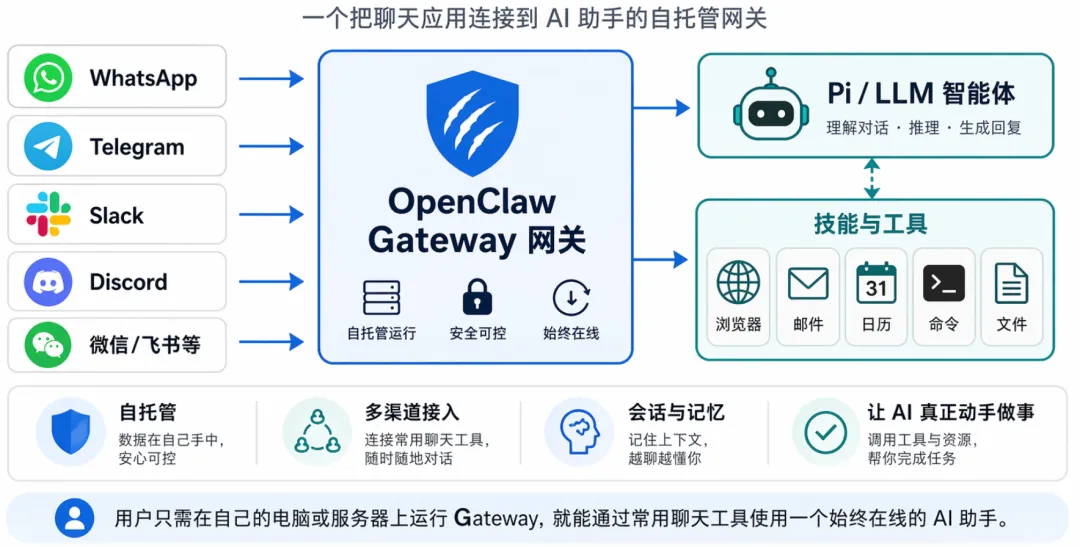

OpenClaw的核心价值,是把用户常用的沟通入口连接到一个自托管 AI 助手上。用户可以通过聊天工具、协作平台、Web 页面或 CLI 发出指令,OpenClaw 负责接收消息、交给 AI 理解,再调用合适的工具完成任务,最后把结果回复给用户。

它和普通聊天机器人的区别在于,普通机器人更多是“回答问题”,而 OpenClaw更强调“执行任务”。用户不是只和 AI 聊天,而是可以让 AI 帮自己处理邮件、整理文档、查询日程、打开浏览器、运行命令,甚至完成更复杂的自动化工作。

这也是 OpenClaw 值得关注的地方:它代表的是一种更接近真实工作流的 AI 助手形态。但也正因为它能调用工具、访问资源、执行动作,安全边界就变得更加重要。

图1 OpenClaw 是什么?

一、OpenClaw 是什么:连接用户入口和 AI 助手的网关

理解 OpenClaw,可以先看一个简单场景。

用户在常用聊天工具或协作平台里发出一句话:

“帮我整理今天的会议纪要,并列出待办事项。”

OpenClaw 会先接收这条消息,识别用户和会话,再把任务交给背后的 AI 智能体。AI 理解任务后,如果需要读取文件、整理内容、查询日程或生成总结,就会调用对应工具。任务完成后,结果会回到原来的入口。

所以,OpenClaw 可以被理解为一个“中间连接层”:一边连接用户熟悉的入口,另一边连接大模型、记忆和工具能力。

它的价值不只是多接几个应用,而是让 AI 助手进入用户日常使用的工作入口,并具备持续处理任务的能力。

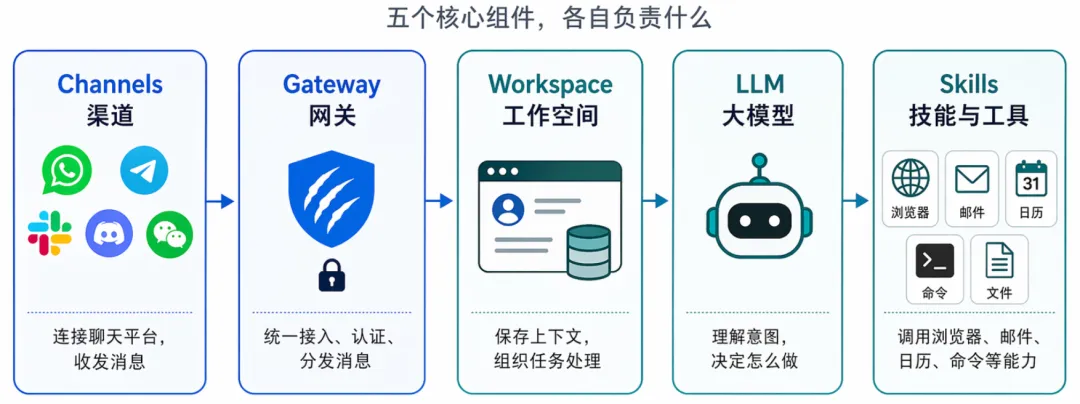

图2 OpenClaw 的整体架构

二、整体架构:入口、网关、工作空间、能力四层

OpenClaw 的架构可以简单分为四层。

第一层是入口层。它连接用户日常使用的沟通、协作和操作入口,例如聊天工具、协作平台、Web 页面、CLI 或其他渠道插件。入口层负责接收用户消息,也负责把结果返回给用户。

第二层是网关层。Gateway 是 OpenClaw 的核心。它负责接收不同入口传来的消息,判断消息来自谁、是否可信、应该进入哪个工作空间,并把处理结果再送回原入口。可以把它理解成整个系统的“总入口”和“分发中心”。

第三层是工作空间层。工作空间负责保存上下文和组织任务。不同任务可以进入不同工作空间,例如个人助理、开发助手、知识库助手、运营助手。这样可以避免不同场景的上下文混在一起。

第四层是能力层。这里包括大模型、记忆、技能和工具。大模型负责理解用户意图,记忆负责保存上下文,技能和工具负责真正执行任务。

这四层连起来,OpenClaw 就不只是一个聊天窗口,而是一套可以接收任务、理解任务并执行任务的 AI 助手系统。

图3 关键组件怎么分工?

三、消息如何变成行动:用户只发一句话,系统做了一整套事

OpenClaw 的工作过程并不复杂。

用户先从某个入口发出指令。入口层接收到消息后,把它交给 Gateway。Gateway 判断消息来自谁、是否可信、应该进入哪个工作空间。工作空间整理上下文,把当前任务交给大模型。

大模型会判断这件事该怎么处理。如果只是普通问答,它可以直接生成回复;如果需要完成真实任务,就会调用技能和工具。

例如,用户说“帮我整理会议纪要”,AI 可能需要读取文档、提炼重点、生成待办清单;用户说“帮我查今天日程”,AI 可能需要访问日历;用户说“帮我修改这段代码”,AI 可能需要读取文件、分析代码并执行命令。

工具完成后,结果会回到大模型。大模型再把结果整理成自然语言,最后通过原来的入口回复给用户。

从用户角度看,这只是一条消息;从系统角度看,它完成了接入、识别、理解、调用工具、生成结果和返回消息的完整过程。

图4 一条消息如何变成行动?

四、Skills 的作用:让 AI 从“会说”变成“能做”

OpenClaw 真正值得关注的地方,是 Skills。

Skills 可以理解成 AI 的工具箱。没有 Skills,AI 主要是在回答问题;有了 Skills,AI 就可以连接真实工具和资源,在授权范围内完成任务。

比如:

-

整理会议纪要,需要读取文档和生成摘要; -

安排日程,需要访问日历; -

查询资料,需要搜索网页或打开浏览器; -

处理邮件,需要连接邮箱; -

修改代码,需要读取文件和执行命令。

这也是 OpenClaw 比普通聊天机器人更有想象力的地方。它把用户的一句话,变成了一个可以被执行的任务。

但风险也正来自这里。AI 一旦能调用工具,就不能只讨论能力,也必须讨论安全。因为它不再只是生成一段文字,而是可能访问文件、执行命令、发送消息或操作外部系统。

图5 Skills 如何让 AI 真正做事?

五、安全问题从哪里来:风险不在聊天,而在执行

OpenClaw 引发安全讨论,核心原因不是它能聊天,而是它能“动手做事”。

一个普通聊天机器人即使出错,通常只是回答错了。但一个能调用工具的 AI 助手,如果权限配置过宽,就可能读取不该读取的文件,执行不该执行的命令,访问不该访问的账号,甚至把错误操作变成真实结果。

OpenClaw 的安全风险,主要来自四个位置。

第一是入口风险。如果外部入口没有做好身份限制,不可信用户就可能向系统发送指令。

第二是工具风险。Skills 让 AI 具备执行能力,但如果技能来源不可信,或者权限过大,就可能成为风险入口。

第三是权限风险。AI 能不能读文件、能不能发消息、能不能执行命令、能不能访问浏览器,都应该有清楚边界。

第四是隔离风险。不同用户、不同任务、不同工作空间,最好不要共享同一套高权限环境。否则一个入口出问题,可能影响整个系统。

所以,OpenClaw 的安全争议,本质上提醒了一个更大的问题:当 AI 助手从“回答问题”走向“执行任务”,系统就必须重新设计权限、隔离和确认机制。

图6 OpenClaw 的安全风险从哪里来

六、安全边界怎么建:让 AI 能做事,但不能越界

对 OpenClaw 这类系统来说,安全不是把所有能力关掉,而是让能力在明确边界内运行。

入口要可信。只有可信用户、可信入口,才能触发 AI 助手。群组或公共入口尤其要谨慎,避免普通消息被误识别成任务指令。

权限要最小。不同技能应该有不同权限。查询、总结、搜索这类低风险任务可以相对自动;读取文件、发送消息、执行命令这类高风险任务,应当有更严格的限制。

工具要分级。不是所有工具都应该默认开放。越接近系统资源、账号凭证和外部发送能力,越需要人工确认或策略限制。

执行要隔离。个人任务、开发任务、企业资料、自动化任务,最好进入不同工作空间。高风险工具也应尽量在受限制的环境中运行。

过程要可追溯。系统应该记录 AI 调用了哪些工具、执行了哪些命令、读取了哪些资源。这样一旦出现问题,才能追溯原因。

可以用一句话概括:

入口要可信,权限要最小,工具要分级,执行要隔离,过程要可追溯。

这比简单说“OpenClaw 有安全问题”更准确。安全问题并不是某一个项目独有的,而是所有“能调用工具的 AI 助手”都会面对的共同问题。

图7 OpenClaw 的五道安全边界

智能体架构系列文章:

AI时代的软件范式变革,Harness Engineering(驾驭工程)带来的启示

小龙虾(OpenClaw)爆火背后的人工智能本质变化:从知识型AI到行动型AI

从OpenClaw看 AI Agent:当人工智能开始“执行任务”

AI时代应用架构演进:从单体、微服务到智能体—阿里云栖2025《AI原生应用生态白皮书》

ChatGPT官方(OpenAI)提出的智能体L1–L5分级

问题三:基模进化是否会挤压企业级垂直类智能体的生存空间?【架构实践方法-智能体架构十问】

问题二:为什么说智能体将成为AI原生应用的主形态?【架构实践方法-智能体架构十问】

问题一:何为智能体,用户真正需要的智能体是什么?【架构实践方法-智能体架构十问】

在智能体浪潮中的冷静思考——重新理解Agent在企业架构中的价值

夜雨聆风

夜雨聆风