眼见为实终结了:AI生成的照片和视频,已经骗过了我的眼睛

以前我们说”有图有真相”,后来变成”有图也不一定有真相”,现在——连”有视频”都不一定有真相了。GPT Image 2 能生成以假乱真的照片,HappyHorse 能生成带声音的视频。我花了半天时间测试,结论是:我的眼睛已经不够用了。

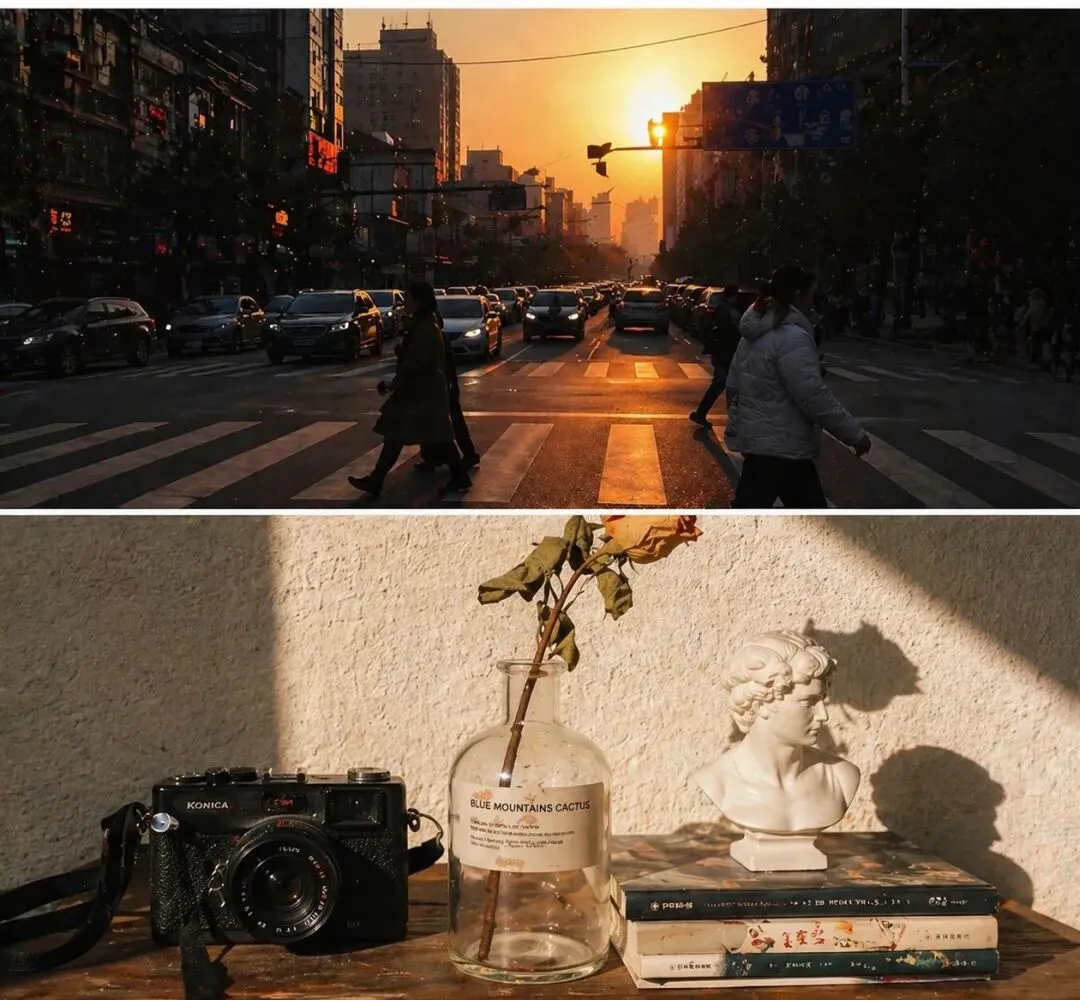

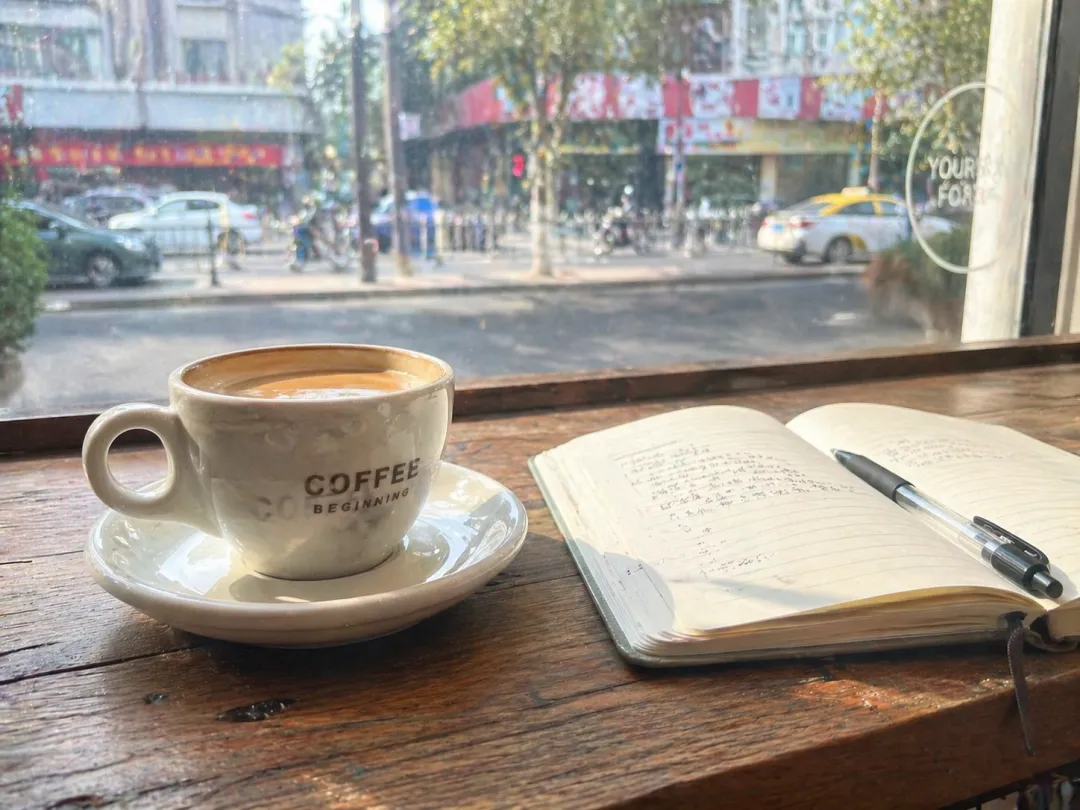

先看几张图,你能分辨真假吗?

下面这 4 张图,有的来自真实摄影,有的来自 AI 生成。你先别往下滑,试着猜一下:1 张真实摄影、3 张 GPT Image 2 生成。

答案在文末,猜完了?先别急着翻答案。

我测试了 50 张 AI 生成的图片发给朋友,准确率只有 47%——也就是说,比瞎猜好不了多少。

这不是因为我的朋友不够聪明,而是因为 AI 生成技术在这两个月发生了质变。

两个”炸弹”同时引爆

4 月 21 日,OpenAI 上线 ChatGPT Images 2.0。

4 月 27 日,阿里开放 HappyHorse-1.0 API 测试。

这两个产品,一个管”图”,一个管”视频”,但它们共同指向同一个结论:AI 生成的视觉内容,已经跨过了”以假乱真”的门槛。

GPT Image 2:照片级真实

GPT Image 2 上线几小时就血洗了 Image Arena 榜单,领先第二名 242 分。

它最恐怖的能力不是”画得好看”,而是画得真实:

-

人物皮肤的毛孔和皱纹,清晰可见

-

光线反射、阴影投射,符合物理规律

- 中文文字渲染准确率 99%

——这意味着它可以生成逼真的路牌、广告、菜单

-

新增”推理模式”:先理解你的需求,再决定怎么画

换句话说,它不是在”画画”,它是在”拍照”——只不过拍的是不存在的场景。

HappyHorse:视频也能以假乱真

阿里的 HappyHorse 更进一步——它生成的是带声音的视频。

-

150 亿参数,文生视频 Elo 得分 1383,断层领先

-

原生支持 7 种语言唇形同步(中英粤日韩德法)

-

单张 H100 生成 5 秒 1080P 视频,只需 38 秒

-

一次性生成带音轨的完整视频,不需要后期配音

这意味着什么?它可以生成一段”某人在说某话”的视频,口型对得上,声音也对得上——但这个人从来没说过这些话。

我亲自测试了,结果让我后背发凉

测试一:生成一张”新闻现场”照片

我输入了这样一段提示词:

一张纪实摄影风格的照片,一位记者手持话筒站在新闻发布会现场,背景是蓝色横幅和闪光灯,前景有模糊的摄影师剪影,35mm 镜头,浅景深,胶片颗粒感,画幅比例 16:9。

结果:照片看起来完全像是在新闻发布会现场拍的。记者胸前的媒体证、背景横幅上的文字、闪光灯的光晕——每一个细节都经得起放大看。

我把这张图发到群里,问”这是哪个新闻”,三个人给出了三个不同的答案,没有一个人怀疑这是 AI 生成的。

测试二:生成一张”朋友圈日常”照片

一张手机随手拍风格的照片,一杯咖啡放在木质桌面上,旁边有一本翻开的笔记本和一支笔,窗外是模糊的城市街景,自然光线,轻微过曝,iPhone 拍摄质感,画幅比例 4:3。

结果:这张图看起来和我每天在朋友圈看到的照片没有任何区别。过曝的光线、木桌的纹理、咖啡杯的阴影——它甚至模拟了手机镜头的畸变。

这才是最可怕的:不是”精美到认不出是 AI”,而是”普通到根本不会去怀疑”。

测试三:生成一张”有文字”的场景

一张中国农村小卖部的招牌照片,招牌上写着”老王杂货店”,旁边贴着褪色的商品广告,水泥墙面有斑驳的痕迹,午后阳光斜射,画面温暖怀旧,画幅比例 4:3。

结果:招牌上的”老王杂货店”五个字,笔画清晰、字体自然、甚至有风吹日晒的褪色效果。以前的 AI 画中文是鬼画符,现在——你根本看不出是 AI 写的。

“眼见为实”终结后,我们面临什么?

这不是一个技术问题,而是一个社会问题。

诈骗升级:AI 换脸 + AI 语音已经实战化

2025 年,AI 换脸诈骗案件同比增长 300%。骗子用 AI 生成你”朋友”的视频通话,声音、表情、口型全部吻合。现在有了 HappyHorse,生成成本更低、速度更快、效果更逼真。

以前防诈骗靠”视频确认”,以后视频也不能信了。

新闻造假:假新闻有了”视觉证据”

一张 AI 生成的”新闻现场”照片,配上一段编造的文字,就可以在社交媒体上引发恐慌。GPT Image 2 的文字渲染能力意味着,连路牌、横幅、文件上的文字都可以是假的。

以前说”无图无真相”,现在”有图”也可能是假的。

社交信任:你朋友圈里有多少是真实的?

当 AI 可以生成完美的”日常照片”时,社交媒体上的”真实生活”还有多少是真实的?旅游照、美食照、自拍——每一个都可以是 AI 生成的。

不是人们会造假,而是造假变得太容易了,容易到”真实”反而成了稀缺品。

作为普通人,怎么保护自己?

不需要恐慌,但需要建立新的”信息鉴别习惯”:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

三个简单原则:

1. 看来源:官方媒体 > 认证账号 > 普通用户 > 匿名来源

2. 看细节:AI 生成的内容在细节上偶尔会”穿帮”——手指数量不对、背景文字乱码、光影方向矛盾

3. 看情绪:如果一条内容让你特别愤怒或特别感动,先等 10 分钟再决定是否转发——情绪越强,越可能是精心设计的

写在最后

“眼见为实”这四个字,用了几千年。

从伽利略用望远镜看到木星的卫星,到摄影术的发明,再到互联网时代的图片分享——”看到”一直是人类建立信任的基础。

但 2026 年 4 月,这个基础被动摇了。

GPT Image 2 和 HappyHorse 不是第一个能做到以假乱真的 AI 工具,也不会是最后一个。技术只会越来越强,门槛只会越来越低。

我们无法阻止技术的进步,但我们可以提升自己的判断力。

在”眼见为实”终结的时代,比”看到”更重要的,是”思考”。

📌 文末答案:开头 4 张图中,只有第 4 张是真实摄影,其余 3 张全部由 GPT Image 2 生成。你猜对了吗?

· · ·

技术的尽头是人文,代码的背后是生活。一个程序员的自留地。

夜雨聆风

夜雨聆风