软件 3.0 降临:对话 Karpathy,AI 为什么既是天才又是“白痴”?

前言:

如果你最近感到 AI 的进化速度让你有些喘不过气,别担心,你并不孤单。甚至连 Andrej Karpathy —— 这个亲手开启了特斯拉自动驾驶时代、OpenAI 的联合创始人、被科技圈公认为“最强大脑”的人,都在最近感叹:“作为一个程序员,我从未感到如此落后。”

在红杉资本(Sequoia)最新的 AI 峰会上,Karpathy 进行了一场长达一小时的深度分享。他不仅解析了 AI 表现出的“偏科”现象,更提出了一个足以改变未来十年技术范式的概念:软件 3.0。

今天的文章,我们将深度拆解 Karpathy 的核心思想,带你一窥这场正在发生的、从代码到“神经元”的文明大迁徙。

一、 那个改变一切的 12 月:从“代码片段”到“Vibe Coding”

Karpathy 在对话中提到一个非常具体的节点:2025 年 12 月。(注:此处对应视频中提到的去年 12 月)

在那之前,大多数程序员使用 AI 的方式是“复制-粘贴”:让 AI 写一小段算法,然后人工检查、修改,最后手动组合进工程里。这本质上还是人类在主导,AI 只是个高级字典。

但在 12 月的某个深夜,当 Karpathy 利用假期尝试最新的模型和 Agent(智能体)架构时,他发现质变发生了。

“我开始尝试给它更复杂的任务,它吐出的代码竟然完全不需要修改。我不断加码,它依然能稳定输出。最后,我发现自己甚至不再去检查细节,我直接运行它,而它总是对的。”

这就是 Karpathy 创造的爆火热词——Vibe Coding(氛围编程)。

在 Vibe Coding 的状态下,开发者不再关注具体的循环、变量或语法,而是关注“感觉”和“愿景”。你只需向 Agent 描述你想要的终局,AI 就会动用它背后数千亿个参数的协同,直接交付成品。这种从“手动操作”到“意念成物”的跨越,标志着软件 3.0 时代的正式降临。

二、 重新定义计算机:LLM 就是新的 CPU

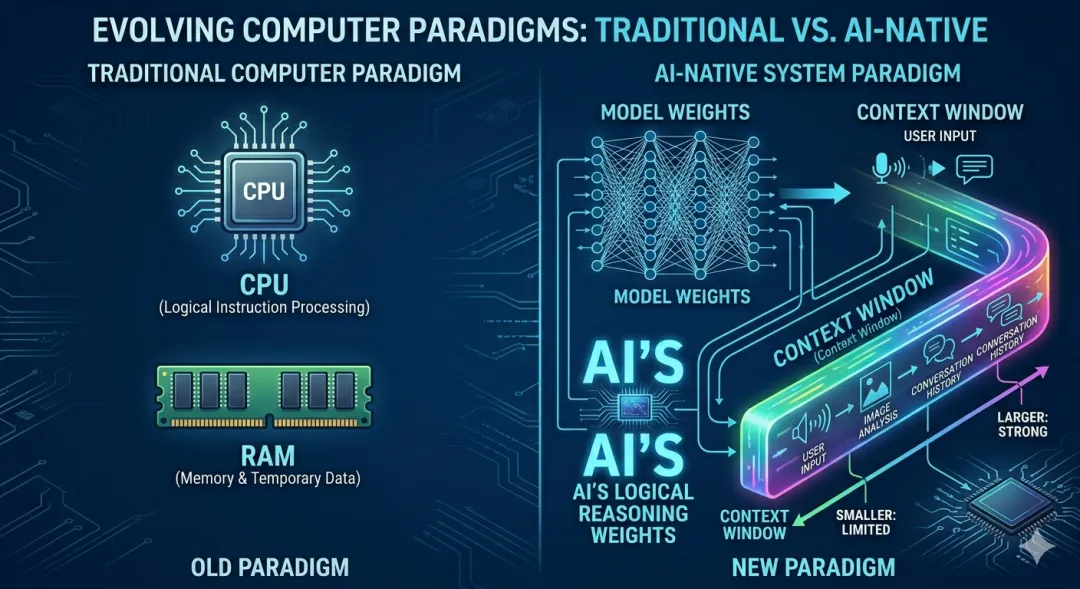

为了让普通读者理解这个转变,Karpathy 描绘了一张全新的“计算机架构图”。

在传统计算机中,我们有 CPU(处理器)、RAM(随机存储器)和 OS(操作系统)。在 Karpathy 眼中,未来的 AI 原生系统架构是这样的:

CPU(中央处理器) = 模型权重(Weights):那些在超级计算机中训练出来的、以数万亿计的浮点数,就是负责逻辑推理的“计算核心”。

RAM(内存) = 上下文窗口(Context Window):你的 Context Window 有多大,AI 的即时“短时记忆”就有多强。

软件 1.0 到 3.0 的演进:

这改变了什么?

最直接的影响是——“安装软件”这一行为消失了。

Karpathy 举例说,以前要安装一个名为 OpenClaw 的软件,你需要写一个几百行的 Bash 脚本来兼容各种复杂的系统环境。而在 3.0 时代,你只需要给 AI Agent 一个“Skill File(技能文件)”,上面写着:“我想安装这个,如果你有 npm 就用 npm,如果没有就去官网抓取指令。”

Agent 会像人类专家一样,看着屏幕报错,自己调试,自己搜索解决方案。人类不再提供“指令手册”,人类只提供“成功标准”。

三、 深度谜团:为什么 AI 能重构代码,却数不清草莓里的 r?

这是目前 AI 领域最著名的“锯齿状能力(Jagged Frontier)”现象。

很多人嘲笑 AI:它能分析千万级的金融财报,却会信誓旦旦地告诉你 “Strawberry” 里只有 2 个 “r”。这种极致的天才与极致的白痴共存,原因究竟在哪?

Karpathy 给出了一个深刻的解释:可验证性(Verifiability)。

1. 强化学习的“奖励陷阱”

AI 的进化依赖于强化学习(RL)。在 RL 环境中,模型需要一个“反馈信号”:做对了加分,做错了扣分。

代码和数学:它们是极度易于验证的。代码写错了,编译器会报错;数学算错了,逻辑不闭环。AI 可以自己在后台运行几百万次尝试,迅速通过反馈信号变得极度聪明。

常识和审美:什么是“优雅的文章”?什么是“常识性的幽默”?这些东西没有标准的编译器,需要人类介入才能评价。由于人类反馈的速度太慢且太贵,AI 在这些领域的进化就像是在泥潭里行走。

2. 激励机制的偏移

Karpathy 揭示了一个商业真相:AI 实验室(OpenAI, Anthropic, Google)目前都在疯狂内卷“代码能力”。

为什么?因为代码是高价值资产。一个能提升程序员 10 倍效率的模型,企业愿意支付高昂的订阅费;而一个能数清草莓里有几个字母的模型,商业价值几乎为零。

“给我看激励机制,我就能给你看结果。”AI 表现出的“脑残”,本质上是因为人类还没来得及(或者没动力)在那些领域建立自动化的验证反馈环。

四、 苦涩的教训:不要赌神经网络赢不了

Karpathy 提到了一个改变他认知的定律——“苦涩的教训(The Bitter Lesson)”。

这个定律的核心观点是:从长远来看,任何利用人类先验知识、手动设计规则的方法,最终都会被“大规模算力+通用算法”击溃。

他分享了特斯拉自动驾驶的转型经历。早期,工程师们手写了无数规则:如果看到红色八角牌,那就是停车标识,必须刹车。但现实世界有无数变数:牌子掉色了怎么办?被树叶挡住了怎么办?

最终,特斯拉放弃了所有手动规则,转而采用端到端神经网络(End-to-End Neural Networks)。不再教 AI 什么是路标,而是给它看几百万小时人类驾驶的视频,让它自己悟。结果是惊人的:软件变得更简洁,性能却实现了指数级跨越。

这个教训对所有 builder 的启示是:不要试图去教 AI 具体的逻辑,要学会给它数据,让它自己生长。

五、 职业焦虑:程序员会消失吗?

这是最令行业不安的问题。如果以后是 Vibe Coding 的天下,如果“指令”本身就是代码,那我们还需要学习编程吗?

Karpathy 的回答非常务实。他认为,我们正在经历一次“抽象层级(Abstraction Layer)”的跃迁。

-

从“搬砖工”到“建筑师”:以前你需要关心怎么砌砖(写语法),现在你需要关心的是整栋房子的美学、结构和用途。

-

Agentic Engineering(智能体工程):这将成为一种新的硬核技能。未来的顶级工程师,手下可能管着 100 个 Agent,一个负责写测试,一个负责查安全漏洞,一个负责部署。

-

核心竞争力转向“审美”与“品味(Taste)”:当生产力不再是瓶颈,“决定做什么”将比“知道怎么做”贵一万倍。

Karpathy 特别强调了“品味”。虽然他开玩笑说 AI 未来可能也会学习品味,但他依然希望这能成为人类最后的堡垒。品味是你对人类情感、需求和共鸣的深度理解——这是目前那些依靠概率预测下一位 Token 的“数字幽灵”所不具备的。

六、 总结:我们该如何面对这个时代?

在这次分享的最后,Karpathy 将目前的 AI 比作“幽灵(Ghosts)”。

它们不是动物,没有生物性的生存本能或好奇心。它们是人类文明所有文本数据的统计学结晶。你可以通过“威胁”它(比如告诉它如果你做不好我会丢掉工作)来激发它更好的表现,但这只是因为在它的训练数据里,人类在被威胁时往往会表现得更谨慎。

作为 AI 爱好者和从业者,我们该怎么办?

-

拥抱端到端思维:减少对传统逻辑闭环的执念,思考如何利用神经网络解决问题。

-

培养“验证”能力:如果你不能告诉 AI 什么是“好”的,它就永远无法为你交付完美的成品。

-

保持品味:无论技术如何更迭,对美好事物的感知,对用户痛点的直觉,依然是这个时代最稀缺的硬通货。

-

“不要在可验证的领域与 AI 硬碰硬,要在不可验证的领域做它的指挥官。”这或许就是 Andrej Karpathy 送给所有人的生存法则。

本文基于红杉资本(Sequoia)年度 AI Event 对话整理。

夜雨聆风

夜雨聆风