AI 终于不再“看截图装懂”了:VideoPrism 与视频大模型战争

很多 AI 模型看视频,其实是在看截图装懂。

一段 10 秒的视频,它抽几张图,看一眼,然后说:

这是喝水。这是进食。这是奔跑。这是摔倒。

听起来好像很聪明。

但你想一下,如果让一个人只看一部电影里的 8 张截图,然后让他说完整剧情,他能说准吗?

大概能猜。

但很容易胡说。

因为视频最重要的东西,往往不在某一张图里,而在两张图之间。

手是怎么伸出去的。杯子是怎么被拿起来的。牛嘴是不是一直在咀嚼。孩子是不是从站立变成摔倒。机器零件是不是从轻微抖动变成异常震动。

这些东西有一个共同名字:

时间。

过去很多模型看见了画面,却没真正看见时间。

于是,视频大模型的战争开始了。

一、旧时代:AI 不是在看视频,是在看几张照片

先说一个很真实的问题。

很多早期视频理解方法,会把视频拆成几帧图片。

比如一段视频有 150 帧,模型不可能每一帧都认真看,于是它抽几帧:

第 1 帧第 20 帧第 40 帧第 80 帧第 120 帧然后用图像模型看这些帧,再把结果平均一下。

这个办法简单、便宜、能跑。

但它有一个致命问题:

它容易把“视频”当成“一堆照片”。

这在粗动作里还凑合。

比如一个人在打篮球,几张图里看到球场、篮球、投篮动作,大概率能猜出来。

但如果是细动作呢?

牛是在进食,还是只是把头放在食槽旁边?人是在正常走路,还是马上要跌倒?工厂设备是在正常震动,还是开始故障?医生看内镜视频时,病灶是在某一帧出现,还是在连续变化中显现?

这时候,只看几张截图就不够了。

因为真正关键的信息,不是“这一帧有什么”,而是:

上一帧到下一帧发生了什么变化。

二、CLIP 的黄金时代:AI 学会了“图文配对”

视频大模型的故事,绕不开 CLIP。

CLIP 做了一件很漂亮的事:

它让图片和文字在同一个空间里见面。

以前模型做分类,大概是这样:

图片 → 类别 0图片 → 类别 1图片 → 类别 2类别 0、1、2 对模型来说只是编号,没有人话意思。

CLIP 换了一个思路。

它让模型看一张图,再看几句话:

a photo of a doga photo of a cow drinkinga photo of a person riding a bike然后判断:

这张图和哪句话最像?

这很厉害。

因为文字本身有语义。

“drinking” 不只是一个编号,它表示喝水。“riding a bike” 不只是一个标签,它表示骑车这个动作。

于是,很多人开始想:

图片可以和文字对齐,视频能不能也和文字对齐?

这条路后来就长出了很多视频-文本模型。

但 CLIP 本身主要还是看图片。它能帮视频理解,但它不是天生为“时间”设计的。

所以问题来了:

AI 到底该怎么真正理解视频?

三、视频江湖开打:各路模型都说自己更懂时间

这几年,视频理解这座山上冲上来了一群高手。

它们路线不同,脾气也不同。

VideoMAE:苦练基本功的学霸

VideoMAE 这一路很像一个学霸。

它的想法是:

我把视频遮住一大部分,让模型自己从剩下的内容里学会补和理解。

VideoMAE V2 是 CVPR 2023 的工作,它把视频 masked autoencoder 做大,用 dual masking 来提升预训练效率,并验证了这种方式可以作为通用视频表征学习方法。

白话说:

遮住视频,让模型猜。猜得多了,它就慢慢知道视频里什么重要。

这条路线强在自监督。

它不一定需要每个视频都有人标注。它可以从大量未标注视频里学基本规律。

这很适合大规模训练。

V-JEPA:不补像素,去学抽象世界

V-JEPA 更像一个哲学派。

它不是执着于把缺失的像素补回来,而是在更抽象的表示空间里预测视频缺失部分。

Meta 官方介绍 V-JEPA 时强调,它是非生成式模型,通过预测视频中被遮住部分的抽象表示来学习视觉表征,而不是直接预测像素。(AI.Meta)

这句话很关键。

因为像素太细了。

一个苹果从左边滚到右边,像素变化非常多。但人看这个视频时,真正关心的是:

苹果在移动。它从左到右。它可能会碰到桌边。

V-JEPA 更关心这种抽象规律。

到 V-JEPA 2,Meta 又把这个路线推向“理解、预测和规划物理世界”的方向,强调从大量自然视频里自监督学习,再用少量机器人交互数据做规划能力。

它想回答的问题不是:

视频里是什么?

而更像是:

世界接下来会怎么变?

InternVideo2:全都要的工程派

InternVideo2 则像一个“全都要”的工程派。

它不是只做一种训练任务。

它把几件事揉在一起:

masked reconstructioncross-modal contrastive learningnext-token prediction也就是:

遮住再重建,视频和文字对齐,还要做生成式预测。

InternVideo2 是 ECCV 2024 的视频基础模型,论文介绍它通过统一 masked video modeling、跨模态对比学习和 next-token prediction,构建多模态视频基础模型,并把视频编码器规模扩展到 6B 参数。

白话说:

它想同时学会看视频、懂文字、做推理。

这条路线很大,很重,也很有野心。

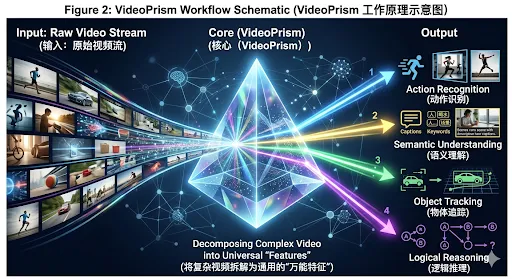

VideoPrism:Google/DeepMind 打出的“通用视频编码器”牌

然后,VideoPrism 出来了。

它的口号不是:

我只做动作分类。

也不是:

我只做视频问答。

它想做的是:

一个通用视频编码器。

Google Research 官方博客说,VideoPrism 是一个 general-purpose video encoder,可以用一个冻结模型生成视频表示,并支持分类、定位、检索、字幕和问答等多种视频理解任务。

论文也把 VideoPrism 定位为:

用一个 frozen model 处理多种视频理解任务。

它不是每个任务都重新训练一个大模型。它更像是先把视频翻译成一份“高质量视频笔记”。

后面你要分类,就接分类器。你要检索,就接检索系统。你要问答,就接语言模型。你要定位,就接定位模块。

它不急着自己回答所有问题。

它先做一件事:

把视频变成机器真正能用的表示。

四、VideoPrism 为什么出现:视频任务太碎了

VideoPrism 的作者们面对的现实问题很简单:

视频任务太碎了。

做动作分类,要一个模型。做视频检索,要一个模型。做视频字幕,要一个模型。做视频问答,又要一个模型。做时间定位,还要另一个模型。

这很不像大模型时代的思路。

在语言模型里,我们已经习惯了:

一个底座,很多任务。

那视频能不能也这样?

VideoPrism 给出的答案是:

先训练一个足够强的视频编码器。它负责看视频、压缩视频、理解视频。后面的任务都来读它输出的视频表示。

这就是 VideoPrism 的核心野心:

做视频世界里的“通用翻译器”。

五、VideoPrism 吃过什么“粮食”?这才是大模型的硬底气

大模型厉不厉害,很多时候先看它吃过什么。

普通实验室做一个动物行为数据集,可能几百段、几千段视频就已经很辛苦。

但 VideoPrism 吃过的东西,是另一个量级。

官方仓库和论文都写到,VideoPrism 的预训练数据包括:

10 亿图文对3600 万高质量视频-文本对5.82 亿带噪声或机器生成文本的视频片段这些数据用于让模型同时从视频本身和视频相关文字中学习。

这很夸张。

普通模型像是在一个小村子里长大。

VideoPrism 更像是从小泡在视频网站、图文网页和海量视频描述里长大。

它不一定懂你的专业任务。它不一定天然懂牛反刍、蚕进食、工业缺陷、医学内镜。

但它已经见过大量基础规律:

物体会移动人会转身手会接触东西状态会持续动作会开始动作会结束画面会变化镜头会移动所以,当你把它拿到一个新任务上时,你不是从零训练一个傻模型。

你是在请一个“看过很多视频的模型”来帮你提特征。

这就是视频基础模型的价值。

六、VideoPrism 到底和其他模型差在哪?

和 CLIP 比:CLIP 会看图,VideoPrism 更认真看视频

CLIP 的强项是图片和文字对齐。

但如果你把视频拆成几帧,再让 CLIP 看每一帧,最后平均一下,它仍然容易丢掉动作过程。

VideoPrism 的定位不一样。

它本来就是视频编码器。

它输入视频帧,输出紧凑的视频 embedding,这些 embedding 可以送进分类器、LLM、检索模型等下游模块。Hugging Face 的 VideoPrism 模型卡也明确写了这一点。

白话说:

CLIP 像一个很会看照片的人。VideoPrism 像一个更专门看视频的人。

和 VideoMAE V2 比:一个靠遮挡学习,一个靠混合视频-文本数据做通用编码

VideoMAE V2 的核心是 masked autoencoder。

它相信:

只要模型能从残缺视频里学会恢复和理解,它就能学到强视频表示。

VideoPrism 也借鉴和改进 masked autoencoding,但它还利用视频相关文本,并加入 global-local distillation 和 token shuffling,让模型主要聚焦视频模态,同时利用视频文本信息。

这两者不是简单谁替代谁。

更像两种修炼方式:

VideoMAE V2:遮住视频,逼模型学视频结构VideoPrism:用海量视频和文字,训练通用视频表示和 V-JEPA 比:一个更像世界模型路线,一个更像通用视频编码器路线

V-JEPA 的故事更接近 Yann LeCun 一直讲的“世界模型”。

它强调:

不要只记像素,要学会预测世界的抽象变化。

VideoPrism 则更偏向:

训练一个强视频编码器,把各种视频任务都接到它上面。

所以它们的气质不一样。

V-JEPA 更像在问:

世界会怎么变?

VideoPrism 更像在问:

我怎样把视频表示好,让很多任务都能用?

和 InternVideo2 比:一个是多模态全家桶,一个是 frozen encoder 打天下

InternVideo2 是很重的多模态视频基础模型路线。

它同时做重建、视频文本对齐、next-token prediction,目标覆盖视频识别、视频文本任务和视频对话。

VideoPrism 的卖点则很清楚:

一个冻结的视频编码器,去服务很多任务。

VideoPrism 论文和官方资料都强调了 single frozen model 这个点,并报告它在 33 个公开视频理解 benchmark 中有 31 个达到 SOTA。

这就像两种武器:

InternVideo2:大型综合战舰VideoPrism:通用视频发动机一个更强调多模态系统能力。一个更强调视频表示底座的通用迁移。

七、VideoPrism 最会讲的故事:冻结模型,打 33 场考试

VideoPrism 最漂亮的卖点,是“冻结”。

什么叫冻结?

就是主模型训练好以后,到下游任务时,不大改主体。

它像一个已经训练好的视频大脑。

你给它一个新任务,它先负责把视频变成好特征。你再在后面接一个小模块来完成具体任务。

这有两个好处。

第一,省事。

不用每个任务都从头训练巨大模型。

第二,能证明它的视频表示够通用。

如果一个冻结模型在很多任务上都能打,那说明它不是只记住了某一个数据集,而是学到了一些更通用的视频规律。

VideoPrism 的论文报告,它在四大类视频理解任务上测试,从公开视频问答到科学视频任务,并在 33 个 benchmark 中有 31 个达到 state-of-the-art。

这句话很适合用来理解它的野心:

它不是每个任务都重新造轮子,而是把一个视频底座拿去参加 33 场考试。

八、VideoPrism 家族:它不只是一个模型名

VideoPrism 后来不只是论文里的一个概念。

它变成了一个模型家族。

Hugging Face 模型卡列出了这些版本:

|

|

|

|

|

|

|---|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

模型卡还说明,VideoPrism-B/L 由一个 Vision Transformer 图像编码器和四层 temporal-attention Transformer 组成,图像和文本编码器初始化自 CoCa,并基于 ViViT 的 factorized video encoder 架构。

白话说:

它不是一个光杆模型。它已经有轻量版、大版、视频版、视频文本版。

这说明它已经从“论文想法”走向“可用工具”。

九、但别神化 VideoPrism:它不是万能药

说到这里,很容易把 VideoPrism 吹成神。

但不能这样。

VideoPrism 很强,但它不是魔法。

它能给你很好的视频特征。但它不一定天然知道你的专业任务到底怎么算。

比如在农业里:

牛嘴动,是反刍还是进食?蚕头碰到叶片,是进食还是只是接触?猪仔趴着,是正常休息还是异常虚弱?植物叶片发蔫,是短期缺水还是病害早期?

这些问题不是通用视频模型看一眼就一定能解决的。

因为专业任务里有很多定义问题。

比如什么叫“进食”?什么叫“接触”?什么叫“异常”?一个状态持续几秒才算?只发生一瞬间算不算事件?

这些不是模型自己能凭空决定的。

所以,真正好的科学应用不是:

我用了 VideoPrism,所以我赢了。

而是:

我先把任务定义清楚,把标注做干净,再用 VideoPrism 这样的强视频模型做底座,最后用真实实验验证它有没有帮助。

VideoPrism 是发动机。

但车能不能跑,还要看车架、轮胎、方向盘和路况。

十、为什么这件事对普通人也重要?

你可能会问:

这不是 AI 论文圈的事吗?跟普通人有什么关系?

关系很大。

因为我们生活里的很多信息,本来就是视频。

短视频平台要理解内容。监控系统要发现异常。医生要看动态影像。机器人要理解动作。自动驾驶要看路况变化。工厂要从视频里发现设备异常。农场要从动物动作里判断健康和福利。

这些都不是单张图片问题。

它们都是:

世界在变化。AI 要看懂变化。

过去 AI 很会看“是什么”。

现在它必须学会看:

发生了什么。什么时候开始。什么时候结束。有没有持续。下一步可能怎样。

这就是视频理解真正难的地方。

十一、视频大模型战争才刚开始

所以,VideoPrism 不是终点。

它只是这场战争里的一个重要节点。

VideoMAE 还在证明 masked video modeling 可以扩展。V-JEPA 还在往世界模型和物理预测走。InternVideo 还在把视频、文本、对话、推理揉成更大的多模态系统。VideoPrism 则押注一个通用 frozen video encoder,用一个底座服务很多任务。

它们争的不是一个排行榜。

它们争的是一个更大的问题:

AI 到底应该怎样理解视频?

是通过遮挡重建?是通过抽象预测?是通过图文对齐?是通过多任务大一统?还是通过冻结视频编码器,把视频先变成万能特征?

现在还没有唯一答案。

但方向已经很清楚:

视频不是一摞图片。视频是时间。

十二、结尾:下一代视觉 AI,要看见过程

过去,AI 看图片。

后来,AI 学会了图文配对。

再后来,AI 开始看视频。

但真正的视频理解,不是看更多图片。

而是看见:

动作如何发生状态如何持续接触何时开始行为何时改变风险何时出现异常何时扩大VideoPrism 这个名字很妙。

Prism 是棱镜。

棱镜把白光拆成不同颜色。

VideoPrism 想做的,是把一段复杂视频拆成机器能理解的东西:

外观动作时间语义关系变化所以它不是一个普通模型名。

它更像一个信号:

AI 正在从“看见画面”,走向“看见过程”。

未来最有价值的视频 AI,不会只是告诉你:

画面里有什么。

它还要告诉你:

事情是怎么发生的。变化是从哪里开始的。接下来可能会怎样。

谁能看懂时间,谁才真正看懂视频。

这就是 VideoPrism 打响的视频大模型战争。

夜雨聆风

夜雨聆风