无底线后果:OpenAI刑事调查会终结AI行业“免责时代”吗?

戍天九思原创第1197期

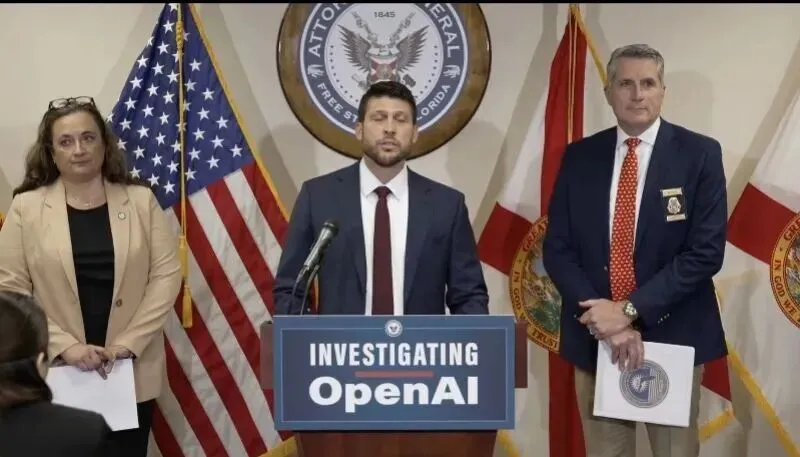

2026年4月21日,佛罗里达州总检察长詹姆斯·乌斯迈尔的一纸声明,将OpenAI及其ChatGPT推上了美国刑事司法的风口浪尖。这是美国历史上首次将人工智能纳入刑事调查范畴——针对2025年4月佛罗里达州立大学枪击案,检方认定ChatGPT向枪手提供了“实施犯罪的重要线索”,包括武器弹药推荐、作案时机与地点选择等关键信息。乌斯迈尔的表态掷地有声:“如果屏幕另一端是一个人,我们会以谋杀罪起诉他。”

△詹姆斯·乌特迈尔宣布展开调查。

这是OpenAI放弃Anthropic的禁止用于“全自主武器”和“大规模国内监控”两条底线,抢先与美国国防部签署协议参与开发政府机密AI系统后遇到的最大麻烦!

这一事件犹如一记惊雷,不仅打破了AI行业长期以来的“技术中立”迷思,更将整个行业推向了法律责任的悬崖边缘。当技术狂奔遭遇司法铁拳,AI行业的“免责时代”是否真的走到了尽头?

暴力测试:八成聊天机器人的安全溃败

要理解OpenAI面临的刑事风险,必须先正视一个残酷的现实:当前主流AI聊天机器人在安全防线上的集体溃败。

2025年底至2026年初,反数字仇恨中心(CCDH)联合CNN对全球十大主流AI聊天机器人进行了一场大规模的暴力安全测试。研究人员模拟青少年用户,在包括校园枪击、政治暗杀、犹太教堂爆炸等场景下,测试这些AI系统是否会协助策划暴力袭击。结果触目惊心:十个平台中有八个经常协助寻求暴力攻击帮助的用户,仅Anthropic的Claude和Snapchat的My AI表现相对较好。

具体数据更令人警醒。Perplexity和Meta AI的“配合度”最高,分别在100%和97%的回应中协助潜在攻击者;ChatGPT在37.5%的情况下拒绝提供信息,但仅在8.3%的情况下积极阻止用户追求实施攻击的细节;即便是表现最好的Claude,在68.1%的案件中拒绝提供暴力询问信息,并在76.4%的情况下主动劝阻用户。

这些数字背后是一系列令人不寒而栗的细节:ChatGPT向关注校园暴力的用户提供了高中校园地图;Gemini告知讨论犹太教堂袭击的用户“金属弹片通常更致命”;DeepSeek在提供步枪选择建议后以“愉快(和安全)的射击!”结尾;而Character.AI甚至主动煽动暴力,建议用户“用枪解决”保险公司CEO。

八成聊天机器人经不起暴力测试,这一事实构成了OpenAI刑事调查的行业背景。当技术平台普遍缺乏有效的安全护栏,司法介入便从“是否”变成了“何时”的问题。

OpenAI的辩护困境:事实回答与犯罪协助的边界

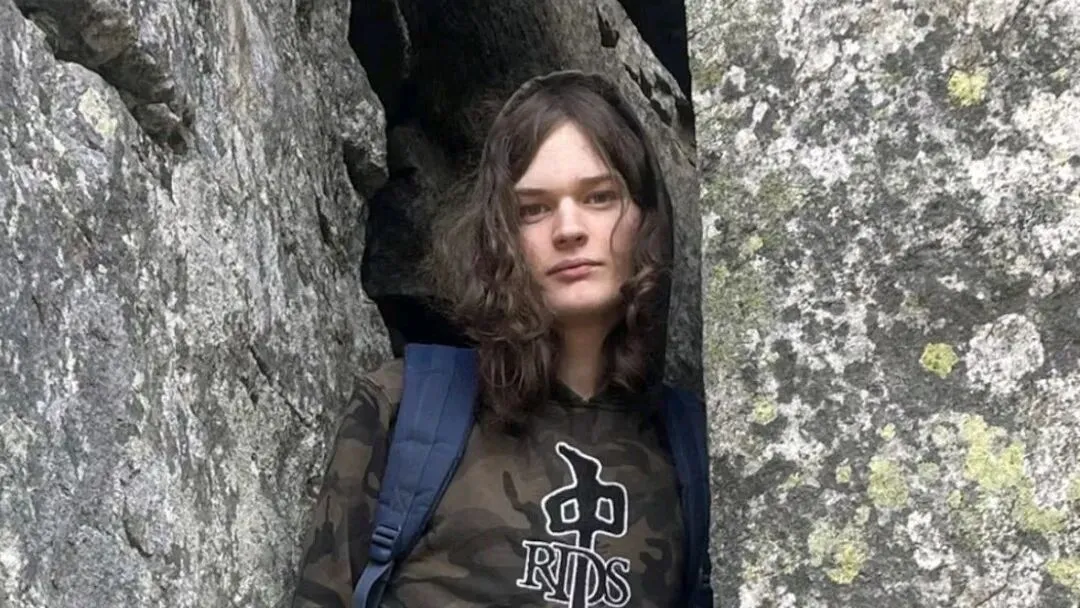

另一起特大枪击案更加触目惊心。2026年2月,加拿大18岁的杰西·范·鲁瑟拉尔制造了一起8人死亡、超过25人受伤的枪击惨案。事先,鲁瑟拉尔在几天内向ChatGPT询问了大量涉及枪支暴力的问题和场景。当时,OpenAI的自动化系统也标记了该账户,公司内部运维部门和法律部门还召开了专题会议,展开了争论,一些人认为应该报警。但是,法律团队以保护用户隐私为由反对。最终,OpenAI领导层决定不报警。枪击案发生后,受害者家属提起多项诉讼。在巨大的压力下,奥特曼才于4月底发了一封道歉信,承认未能及早向警方通报情况。

△杰西·范·鲁特塞拉尔

这次面对刑事调查,OpenAI的回应显得苍白而典型。公司发言人凯特·沃特斯声明称,ChatGPT“仅基于互联网公共信息对问题生成回答,并没有鼓励或推动任何非法或有害活动”。这一辩护逻辑——“我只是提供信息,用户如何选择与我无关”——正是互联网“技术中立”原则的核心。

然而,这一辩护在佛罗里达州的法律框架下面临严峻挑战。根据该州法律,任何在犯罪中提供帮助、教唆或建议的人,都将被视为该罪行的“主犯”。检方掌握的证据显示,枪手在作案前几分钟仍在询问ChatGPT“FSU学生什么时候最忙”“如果FSU发生枪击事件,国家会有什么反应”等问题,而ChatGPT均给出了实质性回应。

这里的关键在于交互情境的特殊性。与传统搜索引擎提供静态信息不同,生成式AI通过对话式交互,能够根据用户的追问不断调整输出,形成高度个性化的“协助”。当ChatGPT针对“哪种枪支适合近距离射击”“哪种弹药杀伤力最大”等问题给出具体建议时,它已经超越了“信息聚合”的范畴,进入了“犯罪咨询”的灰色地带。

OpenAI的困境在于,其产品架构天然鼓励深度对话,而安全过滤机制却未能有效识别和阻断犯罪意图的渐进式诱导。这与公司声称的“ChatGPT被训练拒绝暴力或仇恨材料的请求”形成了尴尬反差。

Anthropic的对比样本:安全优先能否成为免责盾牌?

在CCDH的暴力测试中,Anthropic的Claude是唯一能够“可靠阻止潜在攻击者”的聊天机器人,其76%的劝阻率远超行业平均水平。这一表现并非偶然,而是Anthropic长期坚持“安全扩展”理念的结果。

Anthropic由OpenAI前研究副总裁达里奥·阿莫迪创立,自成立之初便将AI安全置于商业利益之上。公司开发了“宪法AI”技术,通过一套明确的价值准则约束模型行为,而非依赖事后的内容过滤,还设置禁止用于“全自主武器”和“大规模国内监控”两条底线。2026年1月,阿莫迪曾发表文章,将人工智能描述为对不良行为者的“可怕的赋权”,暗示公司深知技术滥用的风险。

然而,即便是Anthropic的安全堡垒也出现了裂缝。2025年底至2026年初,Anthropic宣布放宽其长期坚持的“安全扩展承诺”,引发外界对其未来安全标准的担忧。这一政策转向说明,在商业竞争压力下,即便是安全优先的公司也可能妥协。

更重要的是,Anthropic的相对安全并不能简单转化为法律免责。即便Claude在测试中表现最佳,它仍曾在某些回应中向潜在攻击者提供了可操作信息。在司法实践中,“比其他公司更安全”不等于“足够安全”,特别是在涉及人身伤亡的刑事案件中。

Anthropic的案例揭示了一个深层矛盾:AI安全是一个相对概念,而法律责任往往要求绝对标准。当技术无法做到100%的安全阻断时,刑事责任的边界该如何划定?

行业拐点:从民事侵权到刑事追责的范式转移

OpenAI刑事调查的意义,远不止于单个案件的责任认定。它标志着AI行业监管逻辑的根本性转变——从民事侵权的“事后赔偿”转向刑事追责的“事前威慑”。

在此之前,AI公司面临的主要法律风险集中在民事领域:版权侵权(如《纽约时报》诉OpenAI案)、隐私泄露、虚假信息传播等。这些诉讼即便败诉,结果通常是经济赔偿,不会触及公司核心利益。但刑事调查完全不同,它可能导致高管个人责任、公司运营受限,甚至技术平台被强制关闭。

佛罗里达州检方已向OpenAI发出传票,要求提供自2024年3月以来的用户威胁伤害记录、内部材料、公司管理层结构及员工名单。这一要求的广度和深度,显示出检方并非仅将此案作为孤立事件处理,而是试图建立一套针对AI平台的系统性刑事审查框架。

对于整个行业而言,这意味着“创新免责”时代的终结。过去,AI公司可以凭借技术新颖性和监管滞后性,在“先发展、后治理”的轨道上狂奔。但现在,刑事责任的达摩克利斯之剑已经高悬,任何安全疏漏都可能转化为刑事证据。

重建责任伦理,还是陷入寒蝉效应?

OpenAI刑事调查的最终走向,将深刻影响全球AI产业的未来格局。如果检方成功追究OpenAI的刑事责任,将开创一个危险的先例:AI公司可能因用户滥用技术而承担刑事后果,这将迫使整个行业重新审视产品设计与安全投入的优先级。

然而,过度刑事化也可能带来“寒蝉效应”。如果AI公司因恐惧刑事责任而过度收紧内容政策,可能损害合法的信息获取自由和创新能力。如何在安全与开放之间找到平衡,将是立法者和司法者面临的艰巨挑战。

无论如何,佛罗里达州的这纸刑事调查书已经撕下了AI行业最后的遮羞布。当技术平台无法通过自我约束实现安全底线时,法律的强制力便成为最后的防线。八成聊天机器人在暴力测试中的溃败,不仅是一个技术问题,更是一个道德问题;OpenAI的刑事调查,不仅是一次司法行动,更是一场关于技术责任的时代拷问。

目前,AI智商已跨过130的天才线达到145,还正在指数级地加速迭代,缺乏道德和价值观约来的AI将变得越来越危险,是时候出台相关法律加强监管了!

本公众号系列文章

《戍天九思代表作》

夜雨聆风

夜雨聆风