AI Coding工程化:为什么你的工程体系接不住AI(附五层接收系统)

先说一个反常识的结论:AI Coding最大的问题,不是AI写错代码,而是——AI写对了代码,但写在了错误的边界里。

如果你正在团队里推AI编程,并且已经遇到下面这些情况:

-

AI写的代码没人敢直接合,最后还是靠最靠谱的那个人兜底 -

PR数量翻倍了,但线上问题也翻倍了 -

试点时效率提升40%,一推广就乱成一锅粥

那你遇到的不是模型问题,而是系统问题。

这篇文章不教你写更好的prompt,而是帮你搭一套能“接住”AI的工程系统。读完大约需要6分钟,你可以直接跳到你最关心的那一层。

📑 本文导航(可跳读)

-

一个真实的反面案例 -

AI Coding的本质:非确定性系统 vs 确定性工程 -

五层接收系统(核心) -

为什么必须按顺序来 -

今天的团队,其实分三种

1. 一个真实的反面案例

去年有个团队,花了两个月让AI生成代码,试点时效率提升了40%。推广到全组后,第一周就出了三起production事故——AI擅自修改了共享接口的schema,导致下游服务崩溃。最后他们不得不退回全人工,并总结了一句很扎心的话:

“AI让开发效率提升了3倍,但让错误传播速度提升了10倍。”

这不是个别团队的问题,而是当前90%的AI Coding实践都会踩的坑。OpenAI在Codex落地总结中明确指出:模型能力不是瓶颈,工程系统能否‘接住’AI输出才是。Anthropic在2026年的长时自主编码报告中,也把“harness design”称为前沿表现的关键变量。

2. AI Coding的本质

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

所以真正的问题不是“如何让AI更聪明”,而是:

如何让一个不稳定的系统,在一个稳定的工程体系中可控运行。

这不是Prompt Engineering,而是Production System Design。

我们建设的不是聪明的助手,而是一个接收系统——它能接住AI的输出,约束它、验证它、放行或拒绝它。

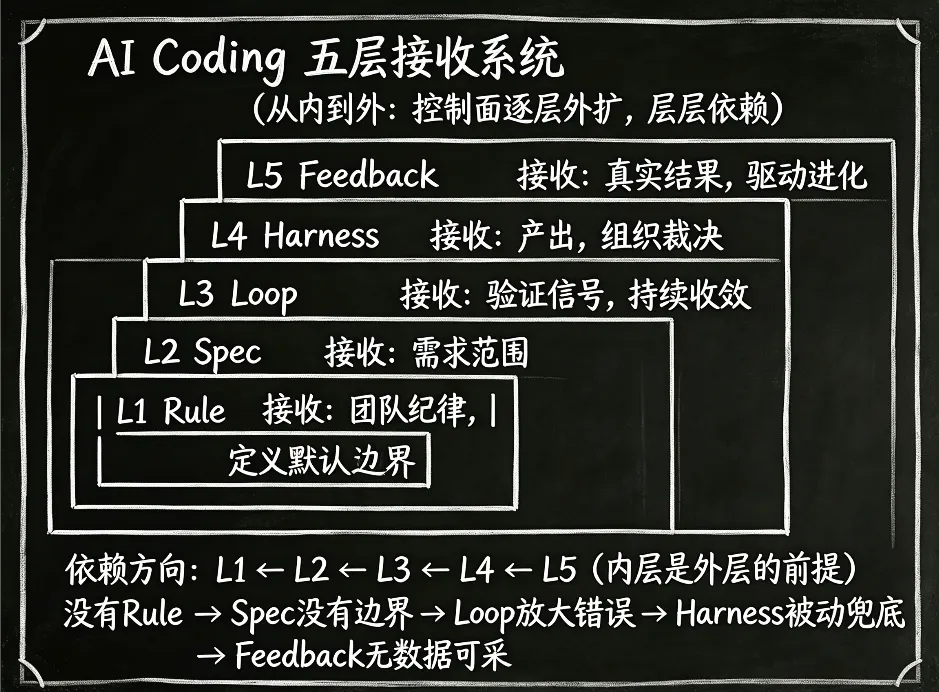

3. 五层接收系统(核心)

我把这条路径总结成五层,每一层都在回答“这一层接收什么”。

L1 Rule:接收团队的纪律边界

接收什么:团队的“不许做”清单。

大多数团队一上来就问“AI能做什么”。但真实项目里最昂贵的错误往往是:改了不该改的接口、扩散了变更范围、在不该结束时说完成了。

Rule不是给AI更多背景,而是把团队纪律写成机器的默认行为。

关键原则:

-

先写NEVER / DO NOT,再写建议 -

先约束高代价错误,再优化实现 -

一旦错误重复出现,必须回写进规则或校验链

⚠️ 写在prompt里的规则本质都是不可信的。真正的护栏是test、lint、type check、CI。Rule只是入口。

OpenAI的AGENTS.md和Anthropic的CLAUDE.md都证明:规则文件在启动时加载,但真正的约束必须由外部工程信号接管。

L2 Spec:接收模糊的需求意图

接收什么:一次变更的范围边界。

有了边界不等于有目标。很多AI Coding失控,本质是需求没有被“工程化表达”,于是AI自然开始扩写:修一个bug顺手重构,补一个状态顺手改契约。

Spec不是更长的prompt,而是变更范围纪律。

一份有效的Spec只需回答5件事:

-

这次解决什么 -

这次不解决什么 -

允许改哪些surface -

哪些contract不能动 -

怎样才算完成

OpenAI在多小时任务文档中把PLANS.md写成living document,要求里程碑、验证命令、完成条件都写清楚。这说明:真正有用的Spec,是把模糊意图压缩成可执行、可审查、可验证的变更。

Rule解决“别乱来”,Spec解决“别跑偏”。

L3 Loop:接收验证失败信号

接收什么:每一次“没通过”的反哺。

即使有Rule+Spec,执行仍然会出错。真正决定AI能不能工作的,不是生成质量,而是有没有收敛机制。

Loop的本质是一个最小步长的局部搜索系统。每一轮都在:

-

读取上下文 → 做最小改动 → 运行验证 → 修复错误 → 更新状态 → 进入下一轮

三个关键约束:

-

改动必须足够小(能被验证器快速裁决) -

状态必须外置(文件/Git/日志,不靠模型“记得住”) -

检查失败必须停止(不能带错前进)

Vercel的ralph-loop-agent和OpenAI对Codex长任务的总结都印证:长任务更可靠,不是因为更长的prompt,而是因为loop提供了结构化上下文和清晰的“done when”例程。

没有Spec,Loop是盲目试错;有了Spec,Loop才是围绕验收条件的收敛系统。

L4 Harness:接收产出并进入组织裁决

接收什么:AI的产出,然后决定放行还是拒绝。

前面三层解决“AI怎么工作”,但真正决定能不能上线的是组织敢不敢信它。

Harness不是某个工具,而是一整套把AI产出纳入验证、提交、评审、放行与追责体系的工程外骨骼。

它通常由几类机制组成:

-

Contract:守住schema、types、interfaces等共享边界 -

Hooks:把lint、typecheck、tests、pre-commit前移 -

CI:仓库级裁决(风险分级、人工review、是否放行)

Anthropic在2026年把harness design称为长时自主编码的前沿关键变量。OpenAI则把testing、checking、review串成可靠性闭环。

没有Harness,AI只是“更快的试错工具”;有了Harness,AI才进入生产系统。

L5 Feedback:接收真实结果并持续进化

接收什么:生产环境或评审中发现的错误模式。

如果没有Feedback:

-

Rule不进化 -

Spec不沉淀 -

Loop不变快 -

Harness只是重复裁决

真正的闭环是:Harness执行结果 → 数据采集 → 反哺Rule/Spec/Loop。

这意味着AI Coding的终局不是一个静态控制系统,而是一个持续自我优化的工程系统。

Feedback不是独立于前四层的新层,而是贯穿所有层的进化引擎。因为它最容易被忽略,我单独列为第五层。

4. 为什么必须按顺序来?

它们不是并列关系,而是强依赖:

-

没有Rule → Spec没有边界 -

没有Spec → Loop放大错误 -

没有Loop → Harness只能末端兜底 -

没有Harness → Feedback无数据可采 -

没有Feedback → 系统不会变强

Rule是最内层(控制agent默认行为)→ Spec再往外一层(控制变更范围)→ Loop将静态约束动态化 → Harness接入组织治理 → Feedback驱动进化。

5. 今天的团队,其实分三种

用AI写代码(工具阶段)把AI当高级补全,生成的代码人肉review,改了再合。试点还行,一推广就崩。

用AI参与开发(协同阶段)有简单的Rule和Spec,AI能跑通一些task,但遇到复杂边界仍然需要人全程盯着。

用AI稳定交付(系统阶段)五层体系已经建立:AI在边界内工作,改动经过自动化验证,错误被回写成规则,团队敢让AI独立提交PR。

大多数人,还停在第一层。

判断你团队在哪一层,只需要看三件事:

-

AI改动是否必须经过自动化验证(不是人兜底)? -

是否存在可重复执行的Loop(不是一次性生成)? -

规则和错误是否会被系统性回写(不是口头提醒)?

如果三件事都没做到:你不是在做AI Coding,你只是在用AI写代码。

写在最后

大多数团队的问题,从来不是模型不够强,而是没有一套能接住AI的工程系统。

从Rule到Feedback,我们真正建设的不是一个更聪明的助手,而是一套可以约束、验证并持续进化AI产出的生产系统。

如果你正在做AI Coding落地、团队工程体系升级,或者AI+开发流程改造——接下来真正该投入的,不是换模型,而是:设计你的AI Coding控制面(Control Plane)。

💬 你的团队在哪一层?踩过哪些坑?欢迎在评论区聊聊。

👍 如果这篇文章帮到了你,点个「在看」让更多人看到。

夜雨聆风

夜雨聆风