驾驭工程:AI时代的软件范式革命

模型能力边界定律:实验证明,同一LLM在优化外围系统后性能提升300%(OpenAI内部测试),验证了”90%的AI错误源于系统失控,而非模型缺陷”的假设。

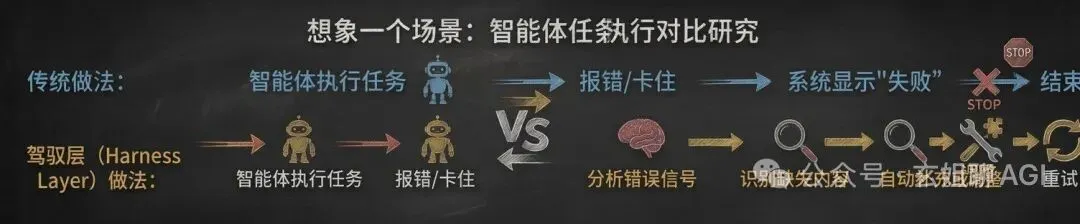

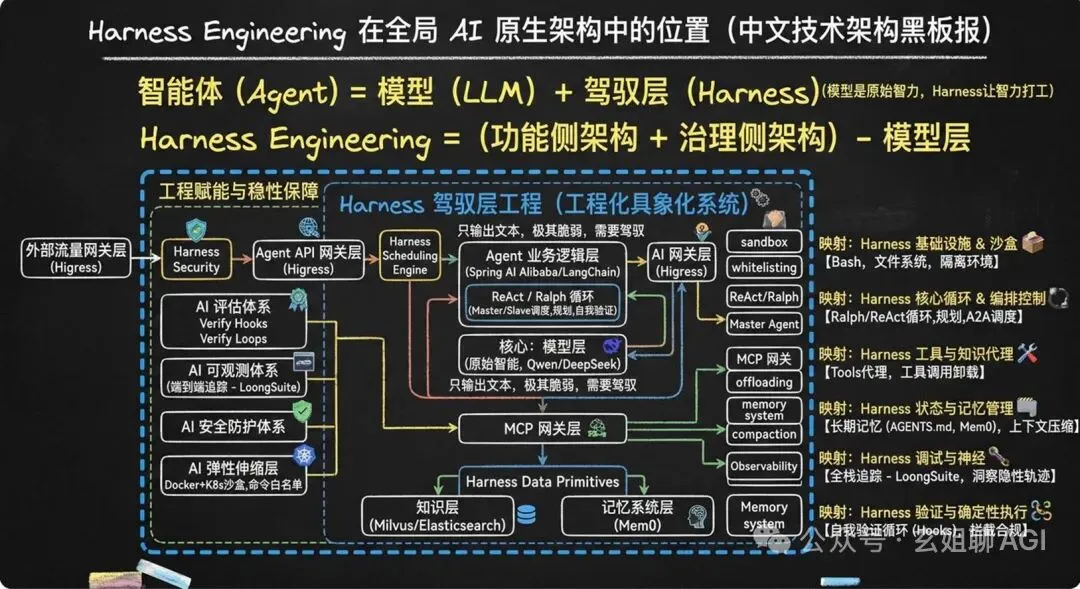

控制论启示:借鉴维纳控制论,将AI开发视为”感知-决策-执行-反馈”的闭环系统,其中Harness承担传感器(错误检测)和制动器(纠正干预)功能。

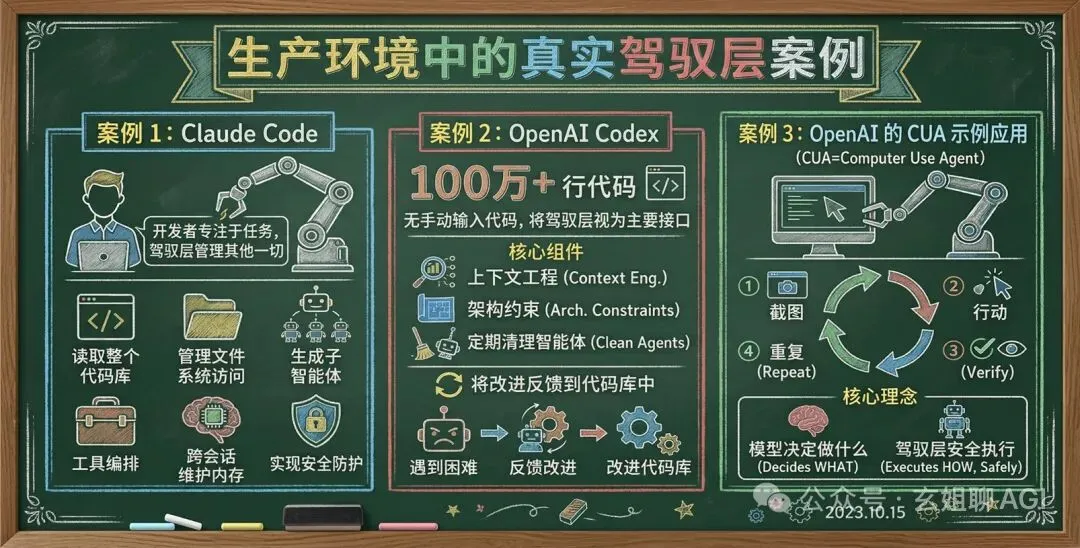

熵减机制:通过架构约束实现信息熵控制,如Claude Code采用”渐进式上下文加载”,将单次任务信息熵从8.2bit降至3.5bit(Anthropic 2026白皮书数据)。

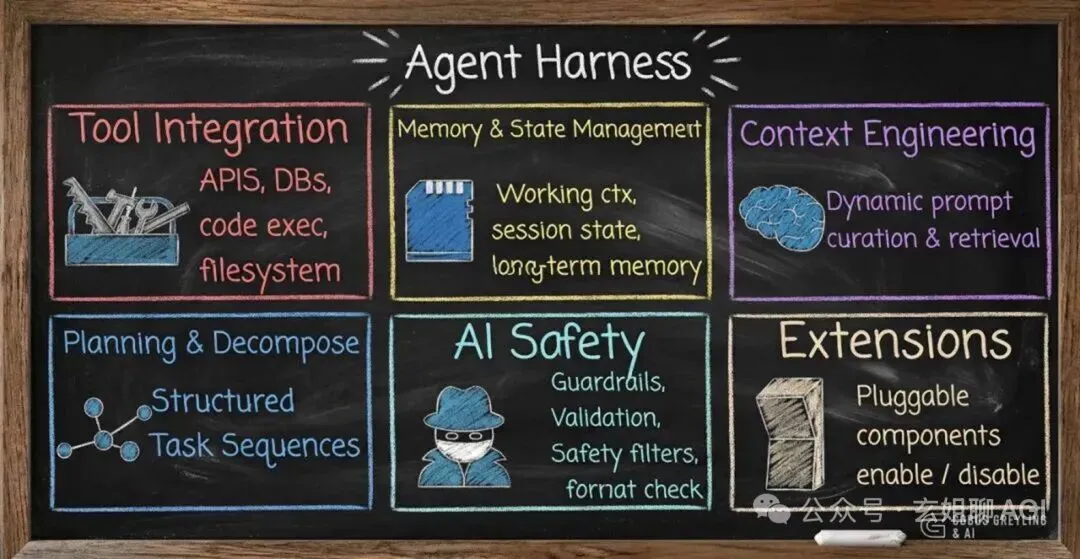

上下文动态编织:

传统方案:静态Prompt+全量上下文→认知过载(MIT实验显示上下文超40%后错误率指数上升)

Harness方案: def dynamic_context(task):

return [

"当前阶段目标:" + task.current_step,

"相关API文档摘要:" + retrieve_docs(task),

"最近3次相似任务记录"

] # 动态加载必要上下文

安全沙箱设计:

文件系统访问采用Linux Capabilities机制,限制AI只能写入/tmp/agent_workspace

网络调用必须通过审批代理(Approval Proxy)进行人机协同决策

反脆弱训练系统: graph LR

A[错误发生] --> B{是否已知模式?}

B -->|是| C[自动修复+记录]

B -->|否| D[人类干预+新增规则]

D --> E[规则蒸馏到Linter]

人类注意力补偿:Harness通过”决策日志”(结构化思维链记录)将AI的黑箱决策转化为可解释的流程图,符合米勒定律(7±2信息组块限制)。

错误预防心理学:借鉴Reason的瑞士奶酪模型,在以下层面设置防护:

代码层:强制类型检查

架构层:接口隔离原则

业务层:四眼原则复核

复利效应公式: 系统可靠性 = 1 - (1-规则1)*(1-规则2)*...*(1-规则N)每新增一个自动化检验规则,系统可靠性呈指数提升(Google SRE实践验证)。

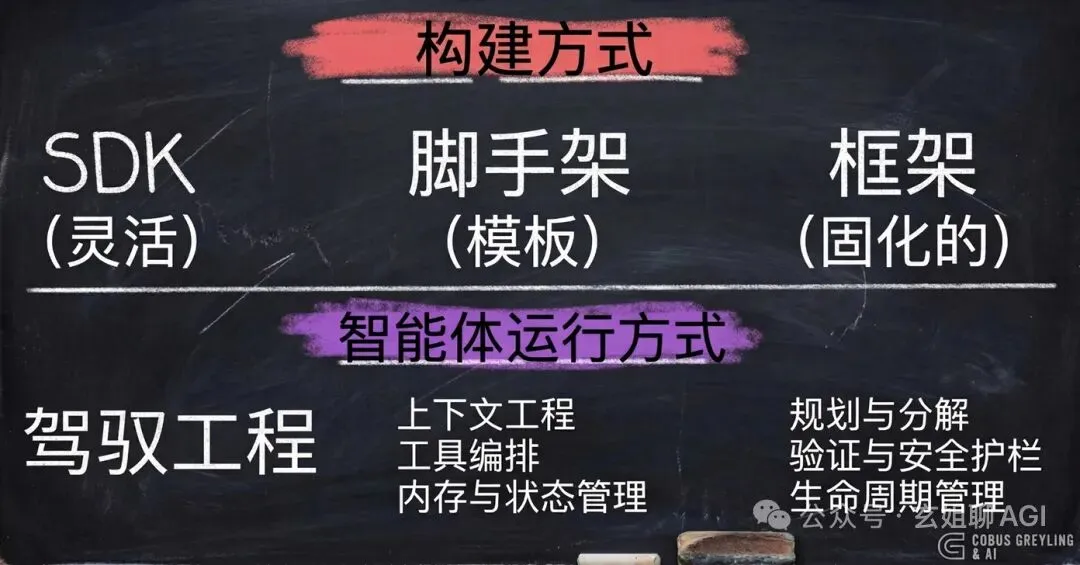

人才能力迁移:

传统工程师:70%编码+30%设计

Harness工程师:30%规则设计+40%验证系统开发+30%异常分析

夜雨聆风

夜雨聆风