本地笔记也可以很“AI”,思源笔记+Ollama,又私有又聪明

各位极友,我是小极君 ✍️

最近开源小模型的能力越来越强——Qwen2.5、Gemma 4 这些参数不大、推理能力却很强的模型,已经能很好地满足日常文案撰写、内容摘要、头脑风暴等需求。

但问题来了:你的文档存在 NAS 上,想用 AI 帮忙润色、总结,却要把内容传到云端 API?隐私安全总是让人不踏实。

不用联网,不用上传,在本地就能跑通 AI 写作全流程。

今天@690研究所带来的这篇教程,手把手教你在极空间上部署 思源笔记 + Ollama,让笔记软件直接调用本地大模型。选中文档,一键生成摘要、扩充内容、提取关键词……所有计算都在 NAS 内部完成,数据不出家门。

隐私、性能、便捷,这次全都要。👇

-

极空间仅提供支持创建Docker镜像的环境,软件功能与注意事项详见该软件内具体使用规则。

-

本文仅代表作者观点,使用第三方解决方案,均非官方正式方案,可能会产生相关风险,请自行斟酌。

最近qwen3.5和gemma4这类小参数开源模型的能力真的是让大家眼前一亮,原来小模型也能有这么强的表现?!特别是在推理以及文案撰写方面已经能够很好的满足咱们的需求了。

那我平时的文档都是存放在NAS上的,通过在NAS上部署思源笔记进行管理,可以说非常好用。同时我在NAS上直接部署完全离线使用,可以在一定程度上确保重要数据不泄露。那思源笔记从V2.0版本开始,内置了非常强大的AI功能支持,并且允许我们用户自定义AI提供商,那咱们在NAS上部署的思源笔记能不能调用同样是部署在NAS上的大模型呢?

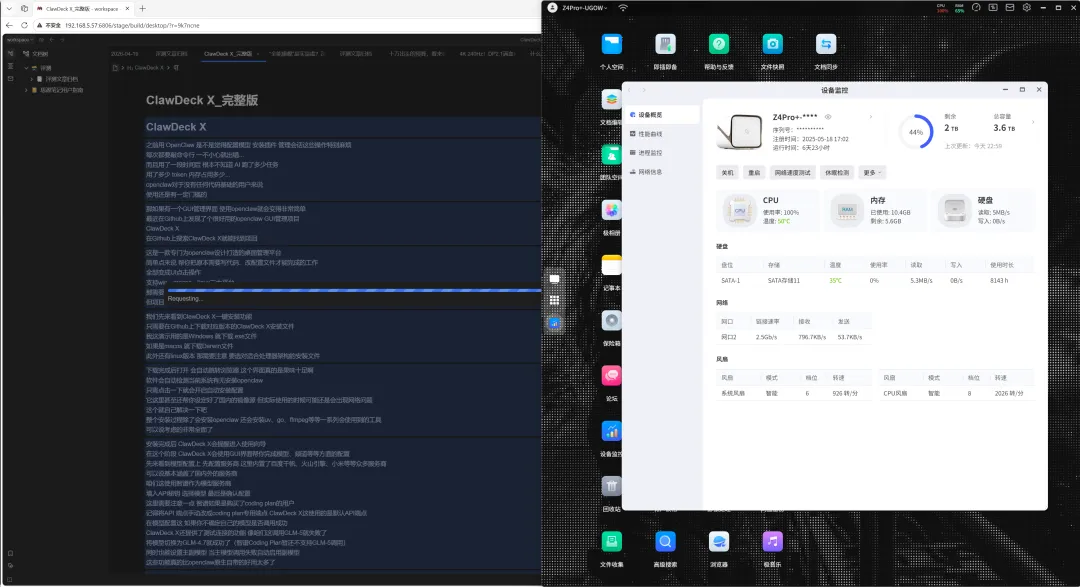

那咱们本篇文章就一起来看看,在极空间上如何使用思源笔记+Ollama搭建本地AI写作系统。我这用的是极空间的Z4Pro性能版,出厂16G内存,除去系统占用和一些Docker容器,跑一些qwen、gemma4的小参数模型没有太大的问题。

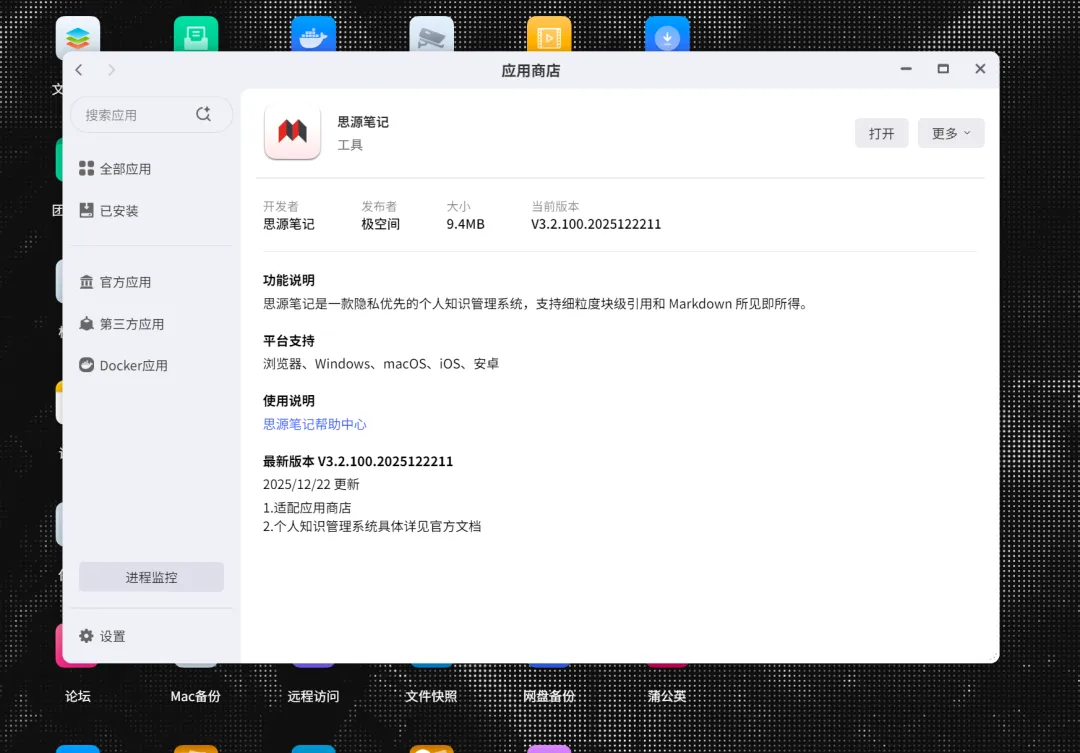

部署思源笔记

那第一步就是要在极空间上部署思源笔记,你可以直接使用极空间应用商店的版本,极空间应用商店的思源笔记版本为V3.4,同样支持AI功能。部署完成后,打开webui页面,输入授权码,这样就进入到思源笔记的webui界面

部署Ollama

同样的极空间的应用商店中也有Ollama,但是需要注意这个Ollama版本是0.18.3,如果是想要跑最新的一些模型,比如gemma4系列,这个版本可能会存在不兼容的情况,那如果你不跑gemma4之类的比较新的模型,也能等极空间更新应用商店的Ollama版本,那咱们这选择的也是自行部署。(Ollama新版本已经在外测中,可以期待一波正式版更新~~)

docker-compose.yml 示例services:ollama:image: ollama/ollama:latestcontainer_name: ollamaports:- "11434:11434"volumes:- ./docker/ollama:/root/.ollamarestart: unless-stopped

使用docker compose进行部署,部署过程需要稍微等待一会儿,有点大。

部署完成后咱们可以使用ollama run 【模型名】命令来拉取模型,那由于咱们NAS的内存只有16G,所以这里建议拉取qwen3.5:4b、gemma4:e2b、qwen2.5:1.5b之类的小参数模型

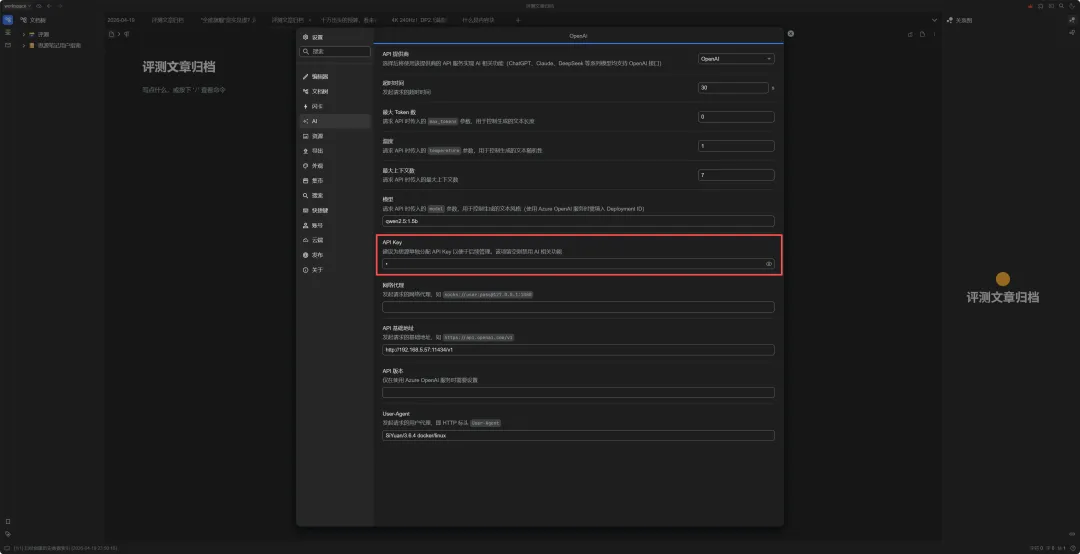

思源笔记接入ollama

进入思源笔记的设置页面,选择AI选项卡,API提供商选择OpenAI,模型选择你在nas上部署的模型,API Key随便填写一个,但是不要空着;API基础地址填写咱们的NAS IP+Ollama端口号/v1,其它的不需要进行变动,就能正常调用咱们在NAS上运行的大模型了。

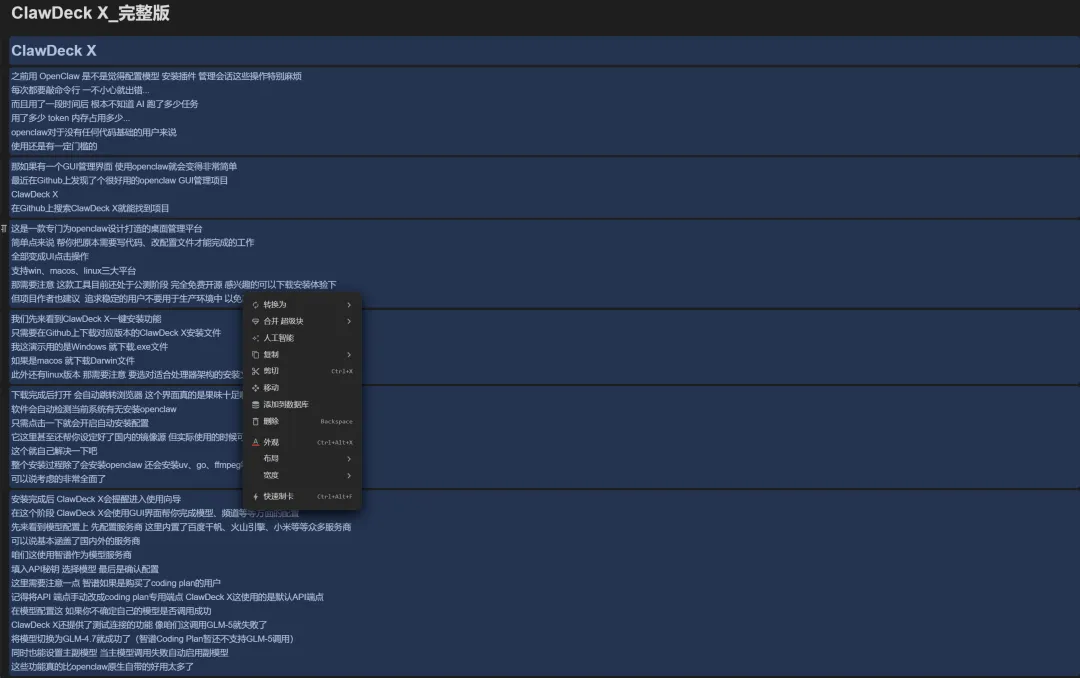

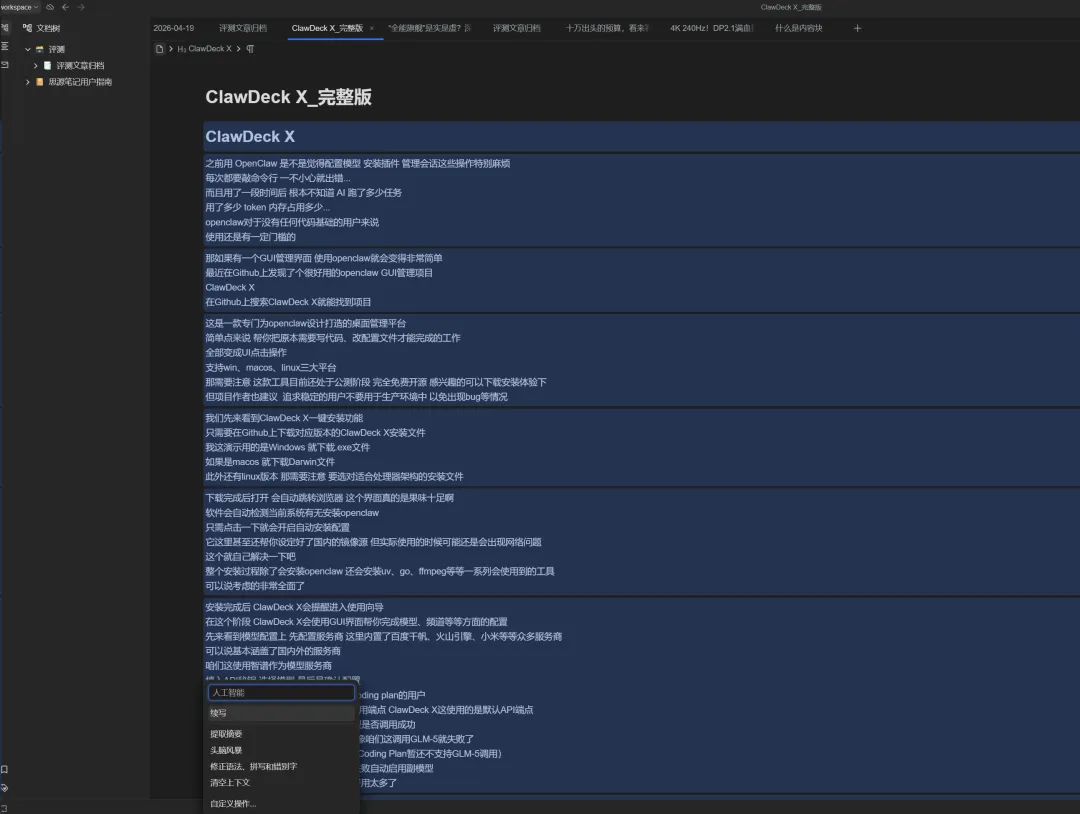

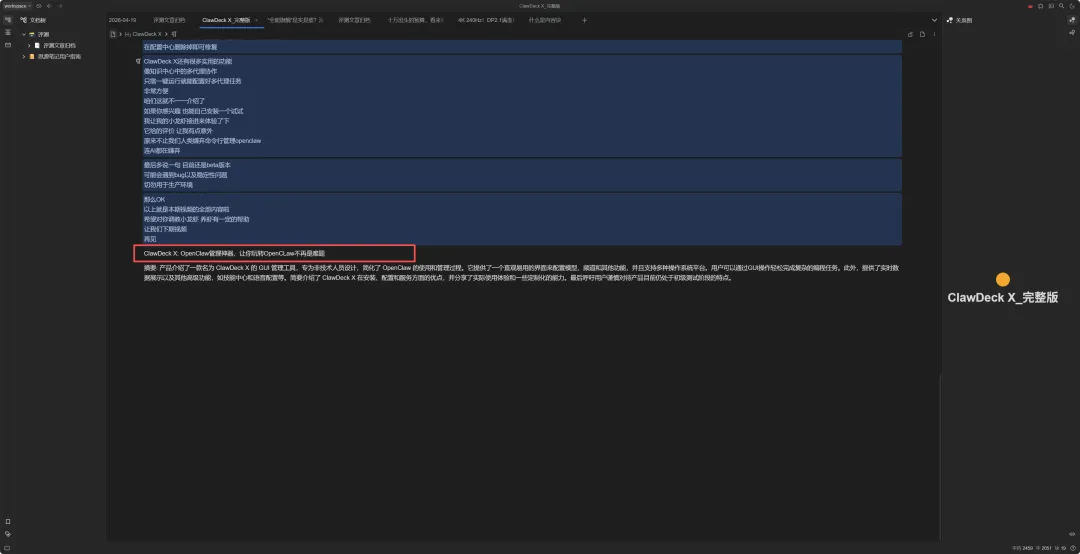

这里会出现一个提示框,我们可以快速选择,比如提取摘要、头脑风暴等等

我这里让人工智能生成当前内容的摘要,可以看到在调用nas上的本地大模型计算时,这个CPU占用率还是比较高的,但在极空间Z4 Pro性能版新散热模具的加持下,CPU温度还保持在一个相对比较低的温度

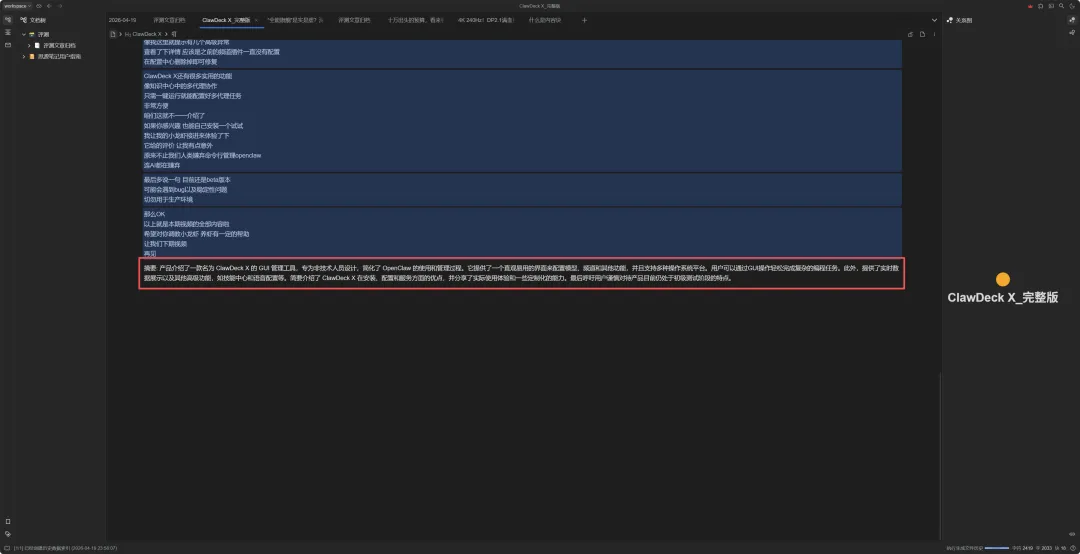

这就是本地模型跑出来的摘要信息,可以看到还是很不错的,内容涵盖的非常全面。

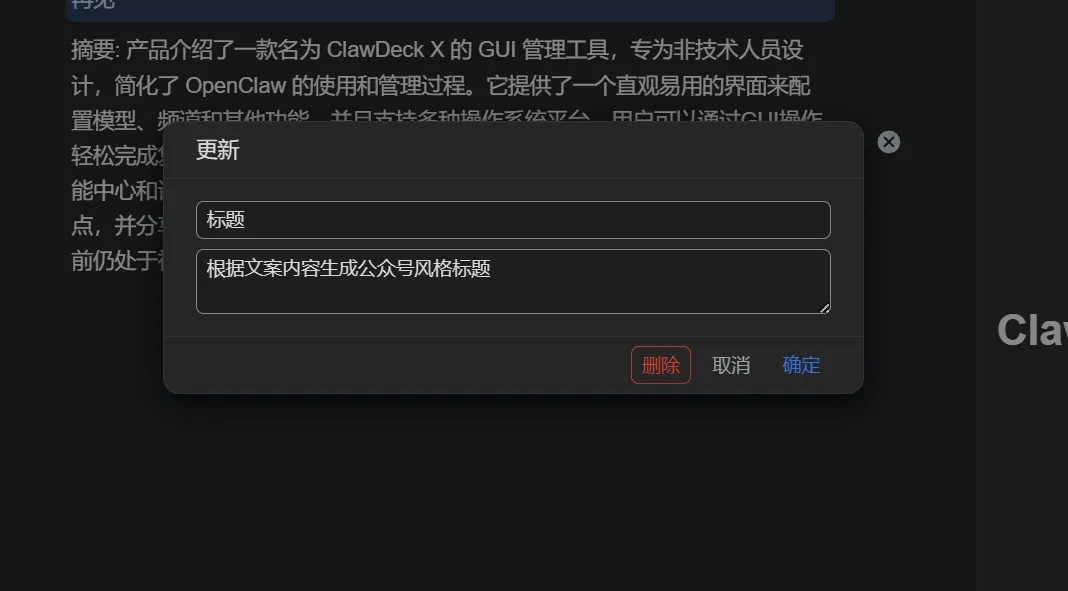

除了可以使用预设的这些人工智能操作之外,还能自定义操作,比如我这可以自定义个让它根据文案内容生成标题。这就是根据文案信息,调用nas本地的大模型生成的标题,这个效果还是很不错的。

从部署思源笔记到拉起 Ollama,再到让笔记软件直接调用本地模型,这套“极空间 + 思源笔记 + Ollama”的组合,真正实现了 “文档在本地,AI 也在本地” 的闭环。

你不需要担心 API 费用,不用担心隐私泄露,更不用折腾复杂的环境。所有操作都在你的极空间上完成,7×24 小时待命,随叫随到。

如果你平时写文档、做笔记多,又希望 AI 能帮上忙但不想把内容交给第三方,这个方案值得一试。另外, Ollama最新版本已经在外测阶段啦,不久就会全量推送正式版,届时小极君再为大家带来应用商店安装使用教程!!!又能水一片啦(bushi)

夜雨聆风

夜雨聆风